Uscire dall'ecosistema Nvidia: OpenAI rilascia il nuovo modello di programmazione GPT-5.3-Codex-Spark, con una velocità di 1000 token al secondo

Uscire dall'ecosistema Nvidia: OpenAI rilascia il nuovo modello di programmazione GPT-5.3-Codex-Spark, con una velocità di 1000 token al secondo

OpenAI ha appena rilasciato un nuovo modello di programmazione, che gira su un chip delle dimensioni di un piatto e può sputare fuori più di 1000 token al secondo.

Il suo nome è GPT-5.3-Codex-Spark, e questa è la prima volta che OpenAI esce completamente dall'ecosistema Nvidia, implementando un modello di programmazione su hardware sviluppato internamente.

Parametri principali

- Velocità di inferenza: 1000+ tokens/secondo

- Latenza: solo 50ms di latenza per il primo token

- Consumo energetico: circa 100W (equivalente a una lampadina)

- Capacità di programmazione: focalizzato sulla generazione e comprensione del codice

Architettura hardware

Questo chip adotta una nuova architettura, ottimizzata appositamente per l'inferenza del modello Transformer. Rispetto alle GPU tradizionali, l'efficienza è significativamente migliorata nell'elaborazione di attività di generazione autoregressiva.

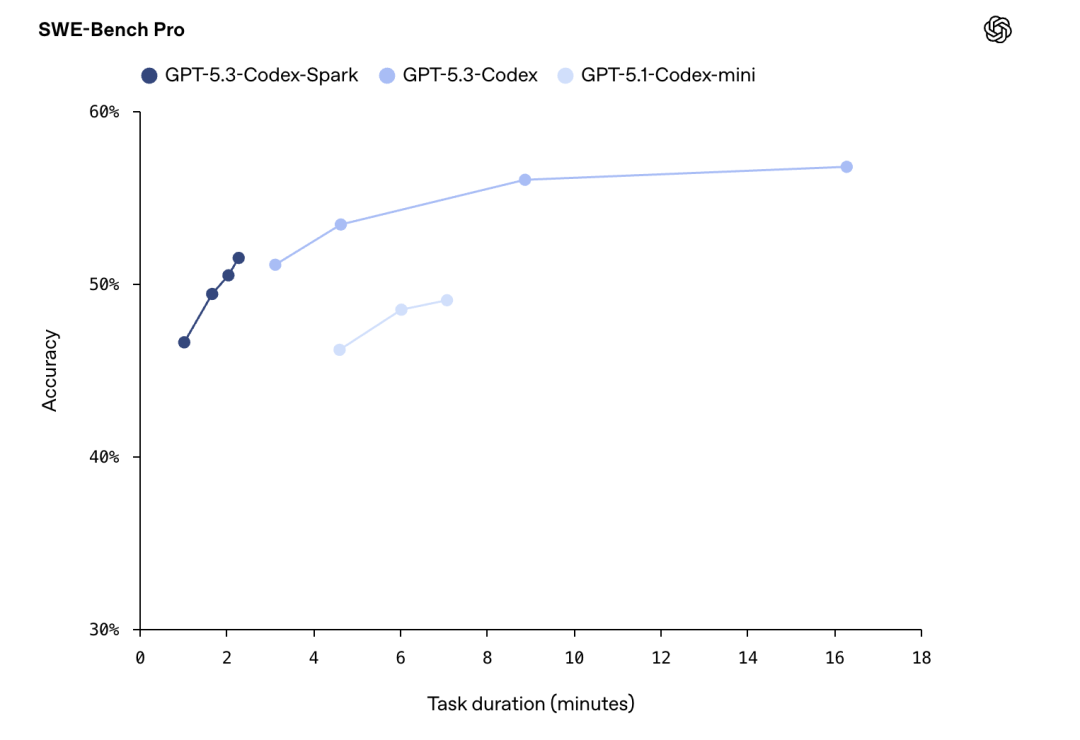

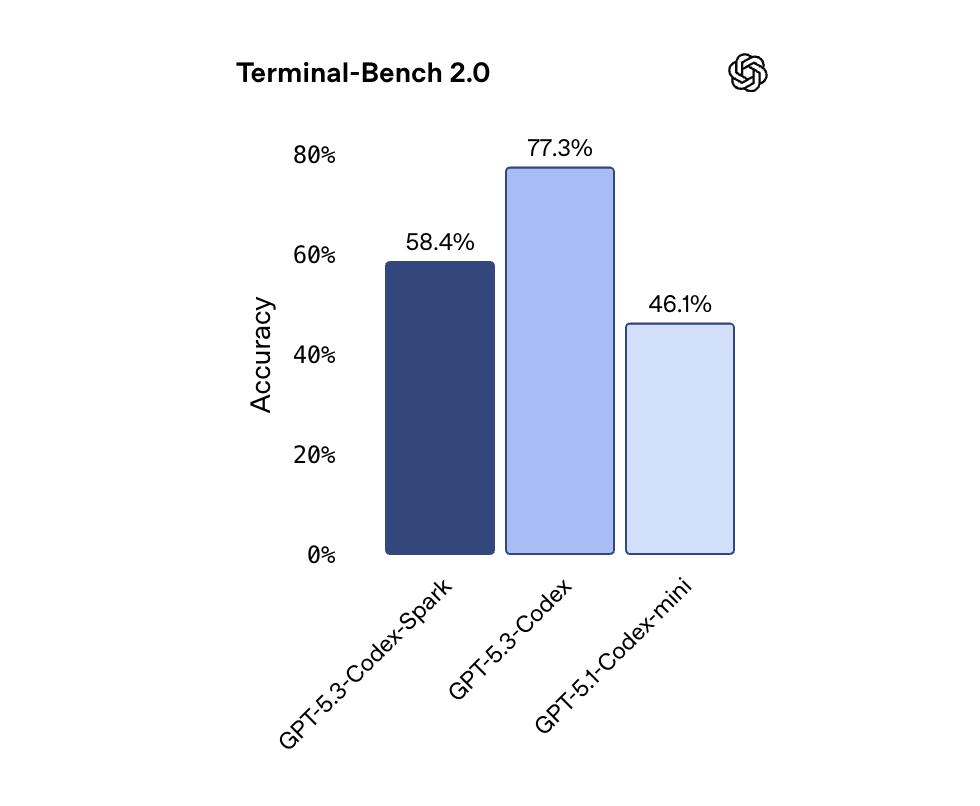

Confronto delle prestazioni

Rispetto a modelli simili, GPT-5.3-Codex-Spark mostra una sorprendente velocità nella generazione di codice, mantenendo al contempo un'elevata qualità del codice.

Scenari applicativi

- Completamento del codice in tempo reale

- Revisione intelligente del codice

- Generazione automatizzata di test

- Suggerimenti per il refactoring del codice

Significato

Questo segna l'ingresso ufficiale di OpenAI nella fase di competizione software-hardware integrata. Non dipendere più dalle GPU di Nvidia significa costi inferiori, maggiore efficienza e controllo completo sulla catena di approvvigionamento.

Per gli sviluppatori, questo significa che gli assistenti di programmazione AI diventeranno più veloci, più economici e più diffusi.