Bryter ut av Nvidia-økosystemet: OpenAI lanserer ny programmeringsmodell GPT-5.3-Codex-Spark, hastighet opptil 1000 tokens per sekund

Bryter ut av Nvidia-økosystemet: OpenAI lanserer ny programmeringsmodell GPT-5.3-Codex-Spark, hastighet opptil 1000 tokens per sekund

Nylig lanserte OpenAI en ny programmeringsmodell som kjører på en brikke på størrelse med en tallerken, og som kan spytte ut over 1000 tokens per sekund.

Den heter GPT-5.3-Codex-Spark, og dette er første gang OpenAI fullstendig bryter ut av Nvidia-økosystemet og distribuerer en programmeringsmodell på egenutviklet maskinvare.

Kjerne Parametre

- Inferenshastighet: 1000+ tokens/sekund

- Latens: Første token-latens kun 50ms

- Strømforbruk: Omtrent 100W (tilsvarende en lyspære)

- Programmeringsevne: Fokuserer på kodegenerering og forståelse

Maskinvarearkitektur

Denne brikken bruker en helt ny arkitekturdesign, spesielt optimalisert for Transformer-modellinferens. Sammenlignet med tradisjonelle GPU-er, er effektiviteten betydelig forbedret ved behandling av autoregressive genereringsoppgaver.

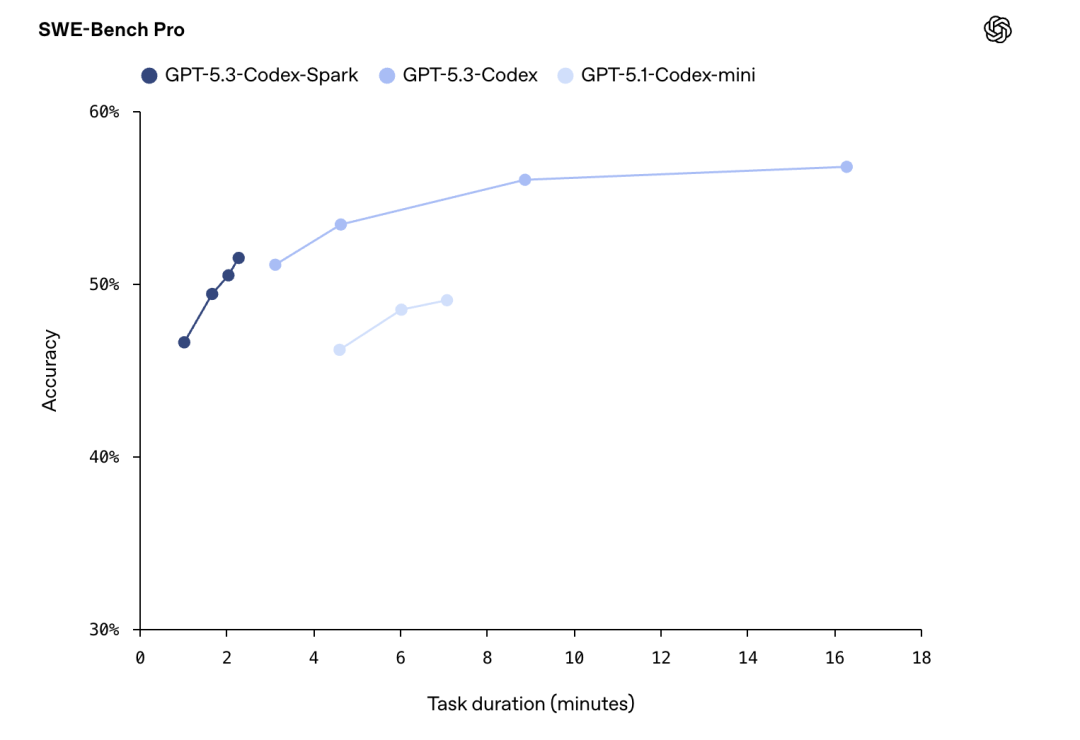

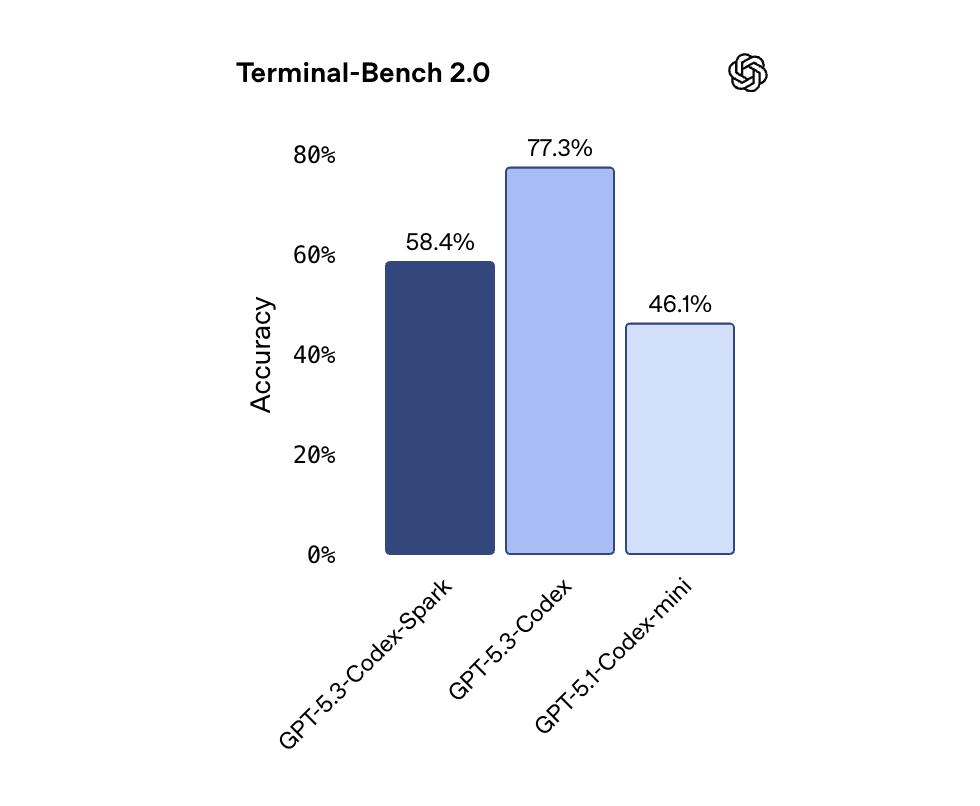

Ytelsessammenligning

Sammenlignet med lignende modeller, viser GPT-5.3-Codex-Spark en overraskende hastighetsfordel i kodegenereringsoppgaver, samtidig som den opprettholder høy kodekvalitet.

Applikasjonsscenarier

- Sanntids kodekomplettering

- Intelligent kodevurdering

- Automatisert testgenerering

- Kodeomstruktureringsforslag

Betydning

Dette markerer at OpenAI offisielt går inn i en konkurransefase med integrert programvare og maskinvare. Å ikke lenger være avhengig av Nvidias GPU-er betyr lavere kostnader, høyere effektivitet og full kontroll over forsyningskjeden.

For utviklere betyr dette at AI-programmeringsassistenter vil bli raskere, billigere og mer utbredt.