Odejście od ekosystemu Nvidii: OpenAI publikuje nowy model programowania GPT-5.3-Codex-Spark, z prędkością do 1000 tokenów na sekundę

Odejście od ekosystemu Nvidii: OpenAI publikuje nowy model programowania GPT-5.3-Codex-Spark, z prędkością do 1000 tokenów na sekundę

OpenAI właśnie opublikowało nowy model programowania, działający na chipie wielkości talerza, który może wyprowadzać ponad 1000 tokenów na sekundę.

Nazywa się GPT-5.3-Codex-Spark. Jest to pierwszy raz, kiedy OpenAI całkowicie odchodzi od ekosystemu Nvidii i wdraża model programowania na własnym sprzęcie.

Kluczowe parametry

- Prędkość wnioskowania: 1000+ tokens/sekundę

- Opóźnienie: Opóźnienie pierwszego tokenu to tylko 50ms

- Pobór mocy: Około 100W (odpowiednik żarówki)

- Zdolności programistyczne: Skoncentrowane na generowaniu i rozumieniu kodu

Architektura sprzętowa

Ten chip wykorzystuje zupełnie nową architekturę, zoptymalizowaną pod kątem wnioskowania modelu Transformer. W porównaniu z tradycyjnymi GPU, jego wydajność jest znacznie wyższa podczas przetwarzania zadań autoregresyjnego generowania.

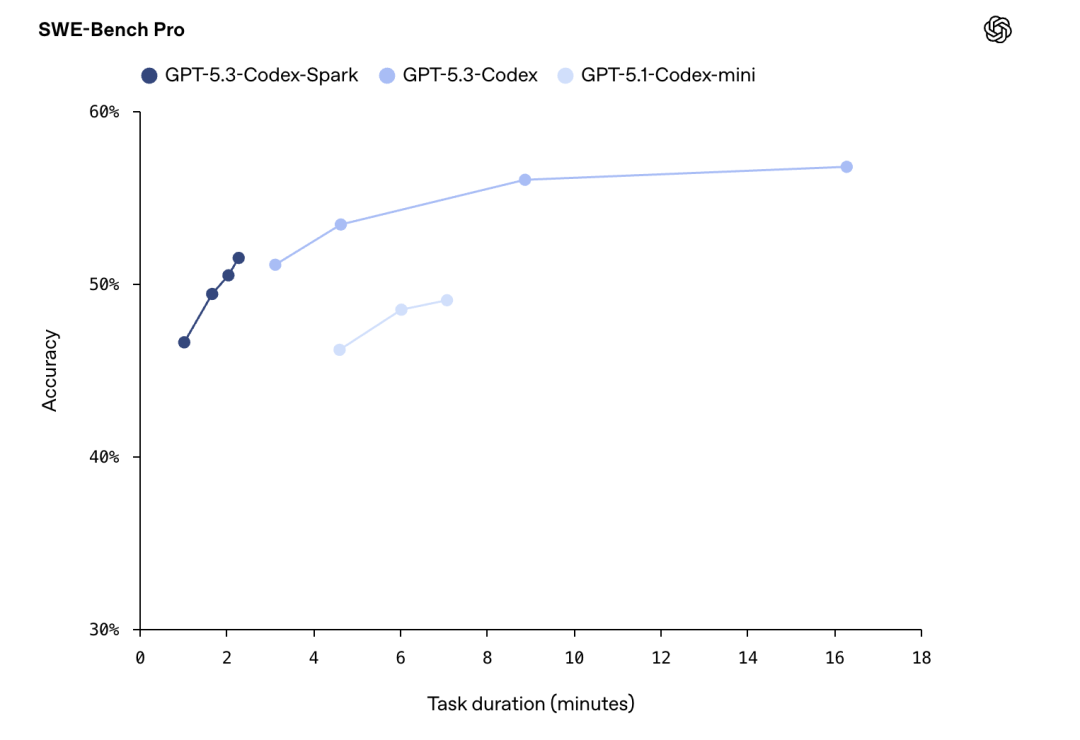

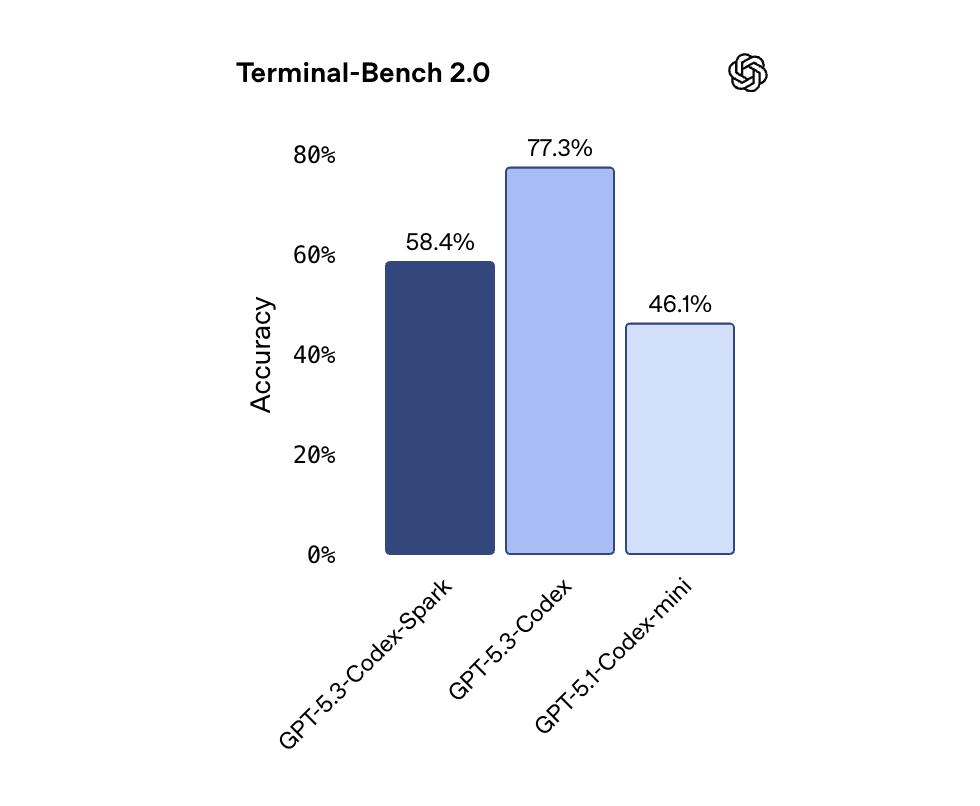

Porównanie wydajności

W porównaniu z podobnymi modelami, GPT-5.3-Codex-Spark wykazuje zdumiewającą przewagę prędkości w zadaniach generowania kodu, przy jednoczesnym zachowaniu wysokiej jakości kodu.

Scenariusze zastosowań

- Uzupełnianie kodu w czasie rzeczywistym

- Inteligentne przeglądy kodu

- Automatyczne generowanie testów

- Sugestie dotyczące refaktoryzacji kodu

Znaczenie

Oznacza to, że OpenAI oficjalnie wkracza w fazę konkurencji oprogramowania i sprzętu. Brak zależności od GPU Nvidii oznacza niższe koszty, wyższą wydajność i pełną kontrolę nad łańcuchem dostaw.

Dla programistów oznacza to, że asystenci programowania AI staną się szybsi, tańsi i bardziej powszechni.