Saindo do Ecossistema da Nvidia: OpenAI Lança Novo Modelo de Programação GPT-5.3-Codex-Spark, com Velocidade de 1000 Tokens por Segundo

Saindo do Ecossistema da Nvidia: OpenAI Lança Novo Modelo de Programação GPT-5.3-Codex-Spark, com Velocidade de 1000 Tokens por Segundo

Recentemente, a OpenAI lançou um novo modelo de programação, executado em um chip do tamanho de um prato, capaz de produzir mais de 1000 tokens por segundo.

Seu nome é GPT-5.3-Codex-Spark, e esta é a primeira vez que a OpenAI sai completamente do ecossistema da Nvidia, implantando um modelo de programação em hardware desenvolvido internamente.

Parâmetros Principais

- Velocidade de Inferência: 1000+ tokens/segundo

- Latência: A latência do primeiro token é de apenas 50ms

- Consumo de Energia: Aproximadamente 100W (equivalente a uma lâmpada)

- Capacidade de Programação: Focado na geração e compreensão de código

Arquitetura de Hardware

Este chip adota um design de arquitetura totalmente novo, otimizado para inferência de modelos Transformer. Comparado com GPUs tradicionais, ele melhora significativamente a eficiência no processamento de tarefas de geração autorregressiva.

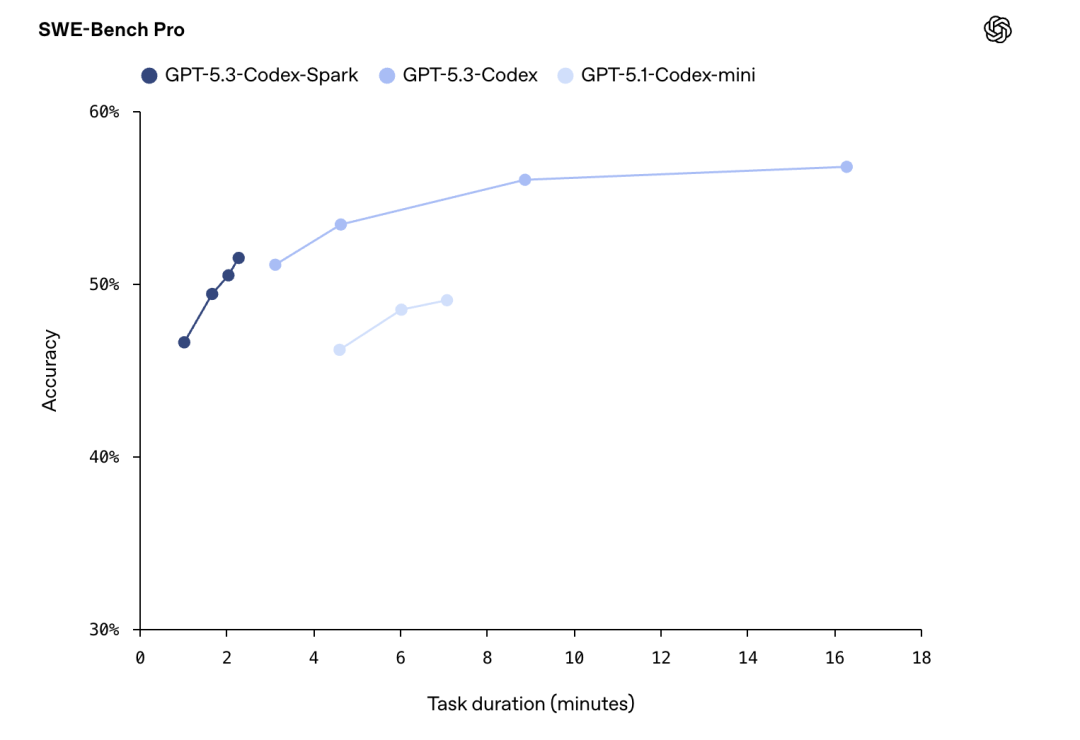

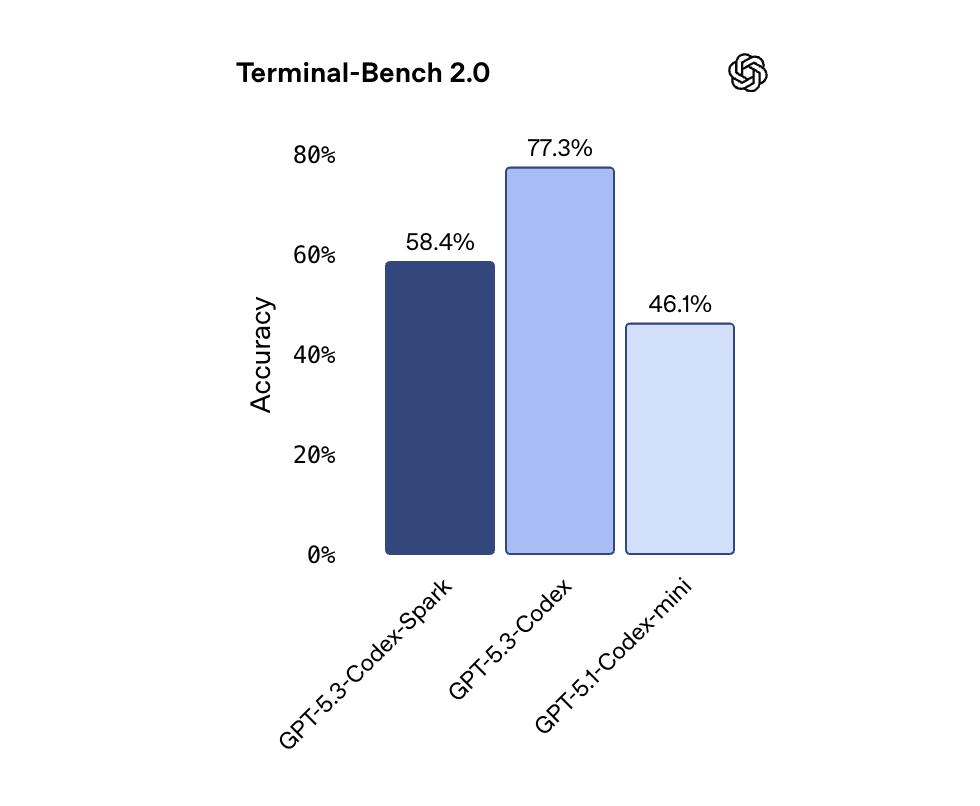

Comparação de Desempenho

Comparado com modelos similares, o GPT-5.3-Codex-Spark demonstra uma incrível vantagem de velocidade em tarefas de geração de código, mantendo ao mesmo tempo uma alta qualidade de código.

Cenários de Aplicação

- Autocompletar código em tempo real

- Revisão inteligente de código

- Geração automatizada de testes

- Sugestões de refatoração de código

Significado

Isso marca a entrada formal da OpenAI na fase de competição de integração de software e hardware. Não depender mais das GPUs da Nvidia significa custos mais baixos, maior eficiência e controle total sobre a cadeia de suprimentos.

Para os desenvolvedores, isso significa que os assistentes de programação de IA se tornarão mais rápidos, mais baratos e mais acessíveis.