Pagtalon sa Labas ng Nvidia Ecosystem: Inilabas ng OpenAI ang Bagong Programming Model na GPT-5.3-Codex-Spark, Bilis na Umaabot sa 1000 Token Bawat Segundo

Pagtalon sa Labas ng Nvidia Ecosystem: Inilabas ng OpenAI ang Bagong Programming Model na GPT-5.3-Codex-Spark, Bilis na Umaabot sa 1000 Token Bawat Segundo

Kamakailan lamang, naglabas ang OpenAI ng isang bagong programming model, na tumatakbo sa isang chip na kasinlaki ng plato, na kayang maglabas ng higit sa 1000 token bawat segundo.

Ang pangalan nito ay GPT-5.3-Codex-Spark, ito ang unang pagkakataon na ganap na lumabas ang OpenAI sa Nvidia ecosystem, at nag-deploy ng programming model sa sarili nilang hardware.

Pangunahing Parameter

- Bilis ng Pag-inferensya: 1000+ tokens/segundo

- Latency: Unang token latency na 50ms lamang

- Konsumo ng Kuryente: Humigit-kumulang 100W (katumbas ng isang bombilya)

- Kakayahan sa Programming: Nakatuon sa pagbuo at pag-unawa ng code

Arkitektura ng Hardware

Ang chip na ito ay gumagamit ng isang bagong disenyo ng arkitektura, na espesyal na na-optimize para sa Transformer model inference. Kumpara sa tradisyonal na GPU, ang kahusayan nito ay makabuluhang napabuti sa pagproseso ng mga self-regressive generation task.

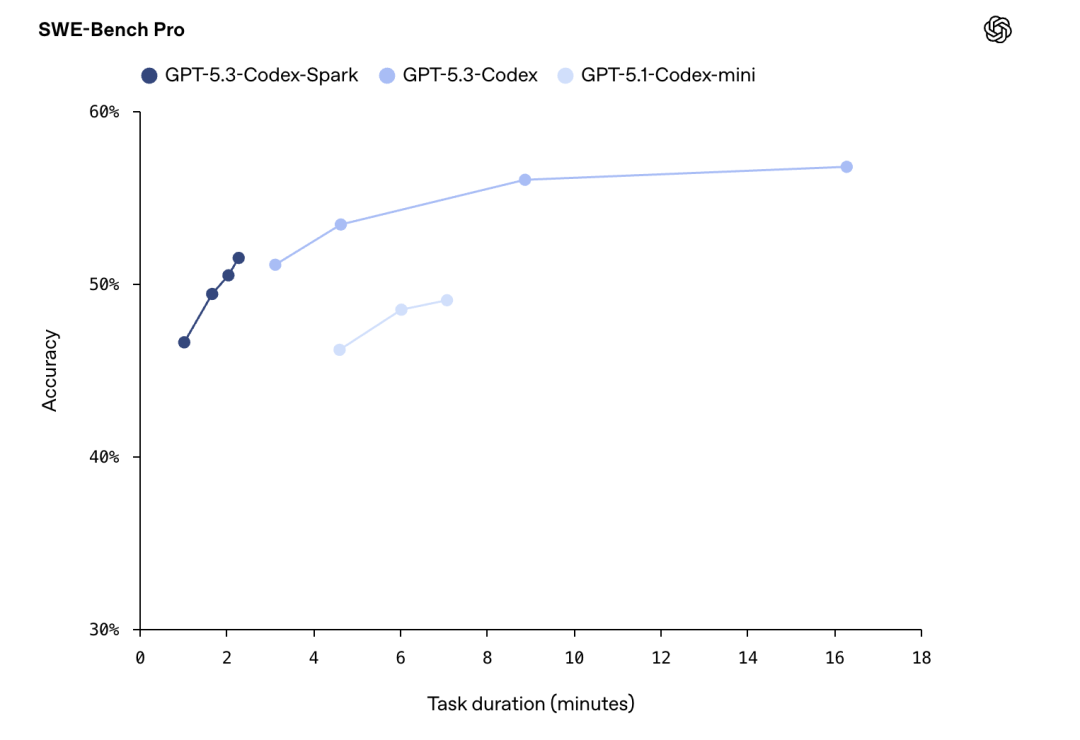

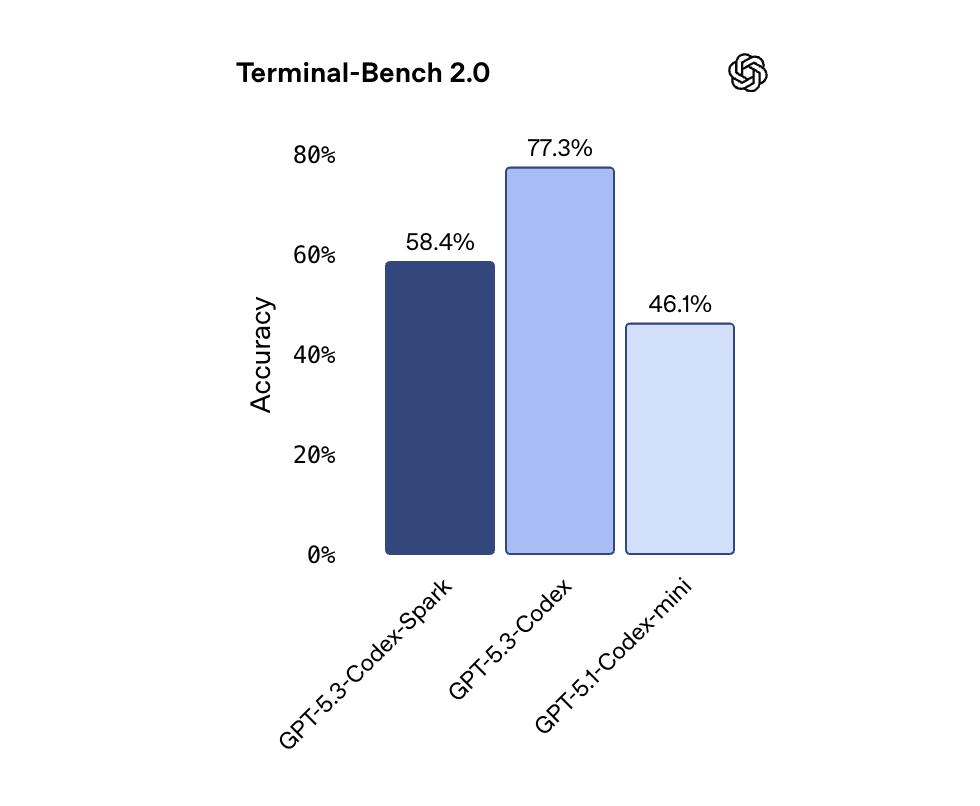

Paghahambing ng Pagganap

Kung ikukumpara sa mga katulad na modelo, ang GPT-5.3-Codex-Spark ay nagpapakita ng kamangha-manghang kalamangan sa bilis sa mga gawain sa pagbuo ng code, habang pinapanatili ang mataas na kalidad ng code.

Mga Sitwasyon ng Aplikasyon

- Real-time na pagkumpleto ng code

- Matalinong pagsusuri ng code

- Awtomatikong pagbuo ng pagsubok

- Mga mungkahi sa pag-refactor ng code

Kahalagahan

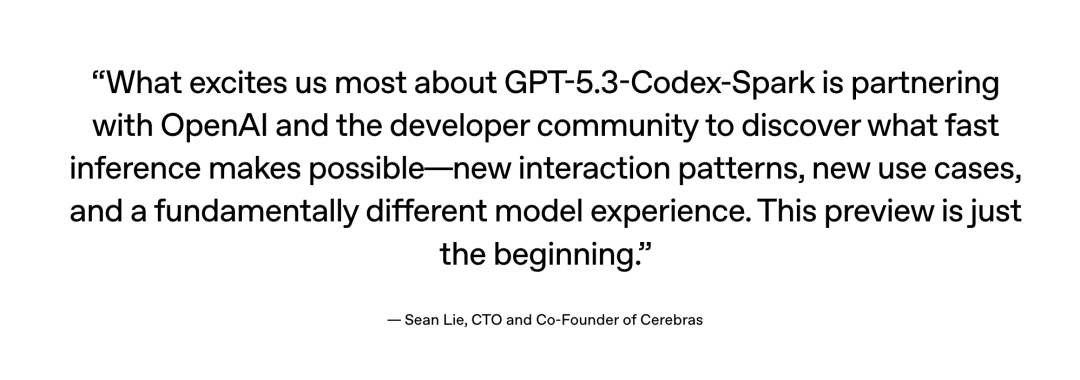

Ito ay nagpapahiwatig na ang OpenAI ay opisyal na pumasok sa yugto ng kompetisyon ng software at hardware integration. Ang hindi na pagdepende sa GPU ng Nvidia ay nangangahulugan ng mas mababang gastos, mas mataas na kahusayan, at ganap na kontrol sa supply chain.

Para sa mga developer, nangangahulugan ito na ang AI programming assistant ay magiging mas mabilis, mas mura, at mas laganap.