CopilotKit: Das Top-SDK zum Erstellen von Full-Stack-AI-Agenten, generativen UIs und Chat-Anwendungen

CopilotKit: Das Top-SDK zum Erstellen von Full-Stack-AI-Agenten, generativen UIs und Chat-Anwendungen

Hintergrundübersicht

CopilotKit ist ein Open-Source-Framework, das speziell für den Bau von AI-Copiloten und agenten-nativen Anwendungen entwickelt wurde. Es hat über 28,9k Sterne auf GitHub und wird von mehr als 100.000 Entwicklern verwendet. Der Kernwert dieses Frameworks liegt in der tiefen Integration von AI-Agenten mit der Benutzeroberfläche, sodass Agenten die UI in Echtzeit steuern, Kontextinformationen übermitteln und UI-Komponenten dynamisch über generative UIs rendern können.

Kernentdeckungen

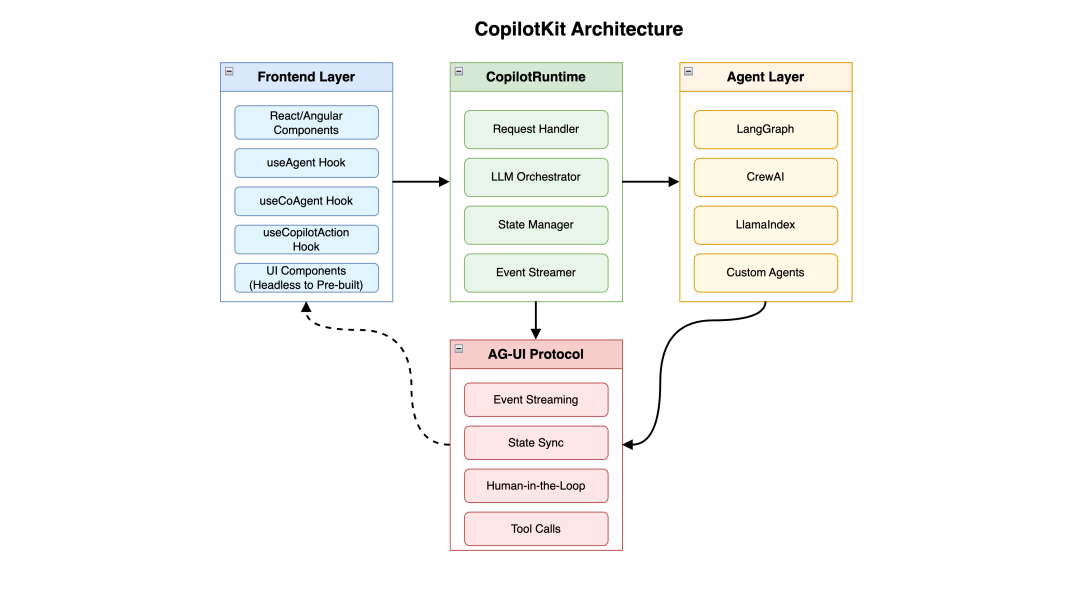

1. Architekturdesign und Kernfunktionen

CopilotKit verwendet ein dreischichtiges Architekturdesign, das aus der Frontend-Komponentenebene, der CopilotRuntime-Laufzeitebene und der Agentenverbindungsebene besteht.

Die Frontend-Komponentenebene bietet ein vollständiges Spektrum von vollständig kopflosen (Headless) UIs bis hin zu vorgefertigten, anpassbaren Komponenten, aus denen Entwickler je nach Bedarf flexibel wählen können. CopilotRuntime fungiert als Backend-Orchestrierungsengine, die für die Verarbeitung von Anfragen aus dem Frontend-Client, das Management von LLM-Aufrufen und die Interaktion mit Agenten verantwortlich ist. Die Agentenverbindungsebene verbindet über das AG-UI-Protokoll mit jedem Agenten-Framework, einschließlich LangGraph, CrewAI, LlamaIndex usw.

Die Frontend-Komponentenebene bietet ein vollständiges Spektrum von vollständig kopflosen (Headless) UIs bis hin zu vorgefertigten, anpassbaren Komponenten, aus denen Entwickler je nach Bedarf flexibel wählen können. CopilotRuntime fungiert als Backend-Orchestrierungsengine, die für die Verarbeitung von Anfragen aus dem Frontend-Client, das Management von LLM-Aufrufen und die Interaktion mit Agenten verantwortlich ist. Die Agentenverbindungsebene verbindet über das AG-UI-Protokoll mit jedem Agenten-Framework, einschließlich LangGraph, CrewAI, LlamaIndex usw.

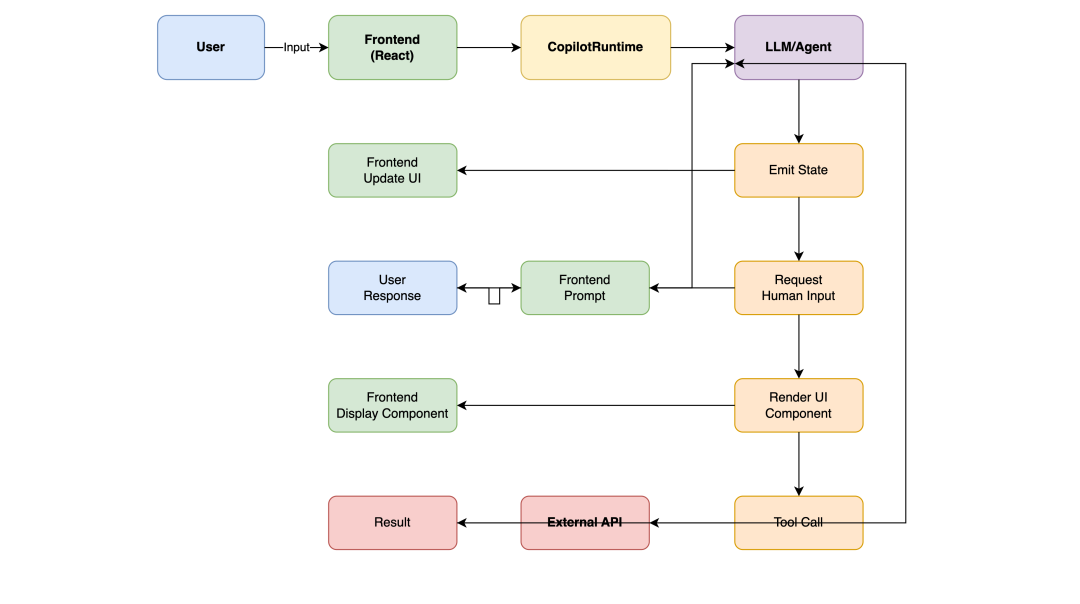

Die Kernmerkmale von CopilotKit umfassen generative UIs, die es Agenten ermöglichen, UI-Komponenten zur Laufzeit dynamisch zu rendern; geteilte Zustände, die eine bidirektionale Zustandsynchronisation zwischen Frontend und Agenten ermöglichen; sowie Human-in-the-Loop, das Agenten unterstützt, während der Ausführung menschliche Eingaben oder Genehmigungen anzufordern. Diese Merkmale machen es möglich, wirklich interaktive AI-Anwendungen zu erstellen, anstatt nur einfache Frage-Antwort-Systeme.

Workflow-Diagramm:

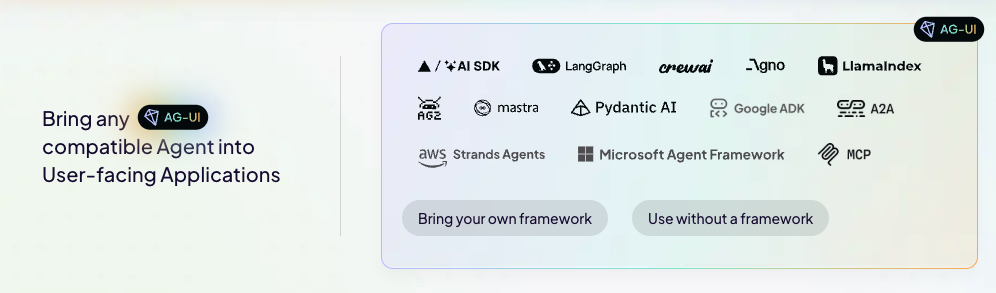

2. AG-UI-Protokoll: Das Fundament des Ökosystems

AG-UI (Agent-User Interaction Protocol) ist ein offener, leichter, ereignisgesteuerter Protokollstandard, der vom CopilotKit-Team eingeführt wurde, um die Kommunikationsweise zwischen AI-Agenten und benutzerorientierten Anwendungen zu standardisieren. Dieses Protokoll wurde von führenden Anbietern und Frameworks wie Google, Microsoft, AWS, LangChain, Mastra, Pydantic AI usw. weit verbreitet angenommen und hat ein wachsendes Ökosystem gebildet.

Das AG-UI-Protokoll löst ein zentrales Problem: Die traditionellen Kommunikationsmuster zwischen Frontend und Backend (Anfrage-Antwort) können die komplexen Anforderungen von Agentenanwendungen nicht erfüllen. Agenten müssen Statusaktualisierungen in Echtzeit streamen, Unterbrechungen und Genehmigungsprozesse verwalten sowie die UI mit dem Agentenzustand synchronisieren, was flexiblere Kommunikationsmechanismen erfordert. AG-UI ermöglicht diese Funktionen durch Event Streaming und unterstützt Echtzeit-Textstreams, Toolaufrufe, Zustandsynchronisation und benutzerdefinierte Ereignisse.

Der aktuelle Bereich der Agentenprotokolle zeigt ein Dreisäulenmodell: AG-UI konzentriert sich auf die Interaktion zwischen Agent und Benutzer, MCP (Model Context Protocol) ist für die Verbindung zwischen Agenten und Tools sowie Daten zuständig, während A2A (Agent-to-Agent) die koordinierte Kommunikation zwischen Agenten behandelt. Bemerkenswert ist, dass AG-UI bereits eine Handshake-Integration mit dem A2A-Protokoll implementiert hat und die Google A2UI-Spezifikation für generatives UI-Rendering umfassend unterstützt.

3. Integration mit gängigen Frameworks

Die Integration von CopilotKit und LangGraph ist eines der ausgereiftesten Anwendungsbeispiele. Durch einfache Konfiguration können Entwickler den LangGraph-Agenten mit dem Frontend von CopilotKit verbinden, um Status zu teilen und Echtzeit-Streaming-Antworten zu ermöglichen. Der Integrationsprozess umfasst in der Regel die Verwendung des useCoAgent-Hooks zur Verbindung des Agenten, das Auslösen von Statusaktualisierungen vom Agenten mit der Funktion copilotkitemitstate sowie die Verwendung von useCopilotAction zur Definition von Unterbrechungspunkten in der Mensch-Maschine-Kollaboration.

Für CrewAI-Entwickler bietet CopilotKit ebenfalls eine sofort einsatzbereite Integrationslösung. Durch das AG-UI-Protokoll können Entwickler jeden CrewAI-Agenten als Frontend-Anwendung mit Unterstützung für Echtzeitinteraktionen bereitstellen. Neben LangGraph und CrewAI unterstützt das AG-UI-Protokoll auch zahlreiche andere Frameworks wie Microsoft Agent Framework, Google ADK, AWS Strands Agents, Mastra, Pydantic AI, Agno, LlamaIndex und viele mehr, was zu echter Interoperabilität zwischen verschiedenen Frameworks führt.

4. Vergleichsanalyse mit ähnlichen Frameworks

Im Vergleich zum Vercel AI SDK gibt es signifikante Unterschiede in der Positionierung von CopilotKit. Das Vercel AI SDK konzentriert sich hauptsächlich auf die Vereinfachung des Streaming-Texttransfers in Chat-Oberflächen und bietet hervorragende useChat-Hooks und UI-Komponenten; CopilotKit hingegen legt mehr Wert auf die tiefgehende Integration von Agenten, generative UI und die Fähigkeit zur Mensch-Maschine-Kollaboration.

Die Beziehung zu LangChain ist eher komplementär als wettbewerbsorientiert. LangChain konzentriert sich auf den Aufbau des "Gehirns" des Agenten (Logik und Workflows), während CopilotKit das "Gesicht, die Stimme und die Hände" dieses Gehirns bereitstellt – nämlich die Schnittstelle zur Interaktion mit der Anwendung. Entwickler verwenden in der Regel LangChain/LangGraph zur Definition der Agentenlogik und bauen dann mit CopilotKit die Benutzerschnittstelle auf.

5. Typische Anwendungsszenarien

Die typischen Anwendungsfälle von CopilotKit decken mehrere Bereiche ab. SaaS Copilot ist das häufigste Anwendungsszenario, bei dem der intelligente Assistent Benutzer durch komplexe Arbeitsabläufe führt und kontextbezogene Hilfe bietet. Co-Creation Copilot betont die Mensch-Maschine-Kollaboration, bei der KI und Benutzer gemeinsam Inhalte erstellen und die Produktivität erheblich steigern. Konversationelles Ausfüllen von Formularen verwandelt mühsame Formulare in natürliche Dialoginteraktionen, sodass Benutzer komplexe Dateneingaben einfach über Chats durchführen können. Forschungsagentenanwendungen, wie die offizielle Demonstration der Forschungs-Canvas-Anwendung, zeigen, wie LangGraph-Agenten tief in das Frontend integriert werden können, um den vollständigen Prozess der Erstellung von Forschungsumrissen, Kapitelverfassungen und menschlichen Genehmigungen zu realisieren.

Schnellstart: Codebeispiel

Grundlegendes Integrationsbeispiel

Hier ist ein minimales, lauffähiges Beispiel für die Integration von CopilotKit mit LangGraph:

Frontend (Next.js/React):

// app/page.tsx "use client"; import { CopilotKit } from "@copilotkit/react-core"; import { CopilotPopup } from "@copilotkit/react-ui"; import "@copilotkit/react-ui/styles.css";

export default function Home() { return (

Forschungsassistent

); }Laufzeit-API-Routen:

// app/api/copilotkit/route.ts import { CopilotRuntime, OpenAIAdapter } from "@copilotkit/runtime"; import { NextRequest } from "next/server";const copilotKit = new CopilotRuntime({ remoteEndpoints: [ { url: process.env.LANGGRAPHURL || "http://localhost:8000" }, ], });

const serviceAdapter = new OpenAIAdapter();

export const POST = async (req: NextRequest) => { const { handleRequest } = copilotKit; return handleRequest(req, { serviceAdapter }); };

Beispiel für geteilte Zustände

// Verwendung von useCoAgent zur Synchronisierung von Frontend- und Backend-Zuständen import { useCoAgent } from "@copilotkit/react-core";

function ResearchCanvas() { const { state, setState } = useCoAgent({ name: "researchagent", initialState: { topic: "", outline: [], currentSection: null, }, });

return (

setState({ ...state, topic: e.target.value })} placeholder="Geben Sie das Forschungsthema ein" />

); }

Beispiel für Mensch-Maschine-Zusammenarbeit (Human-in-the-Loop)

import { useCopilotAction } from "@copilotkit/react-core";

function DocumentEditor() { useCopilotAction({ name: "publishDocument", description: "Vor der Veröffentlichung des Dokuments ist eine Bestätigung durch den Benutzer erforderlich", parameters: [ { name: "title", type: "string", description: "Dokumenttitel" }, { name: "content", type: "string", description: "Dokumentinhalt" }, ], handler: async ({ title, content }) => { const confirmed = await new Promise((resolve) => { showConfirmDialog({ title, content, onConfirm: resolve }); });

if (confirmed) { await api.publish({ title, content }); return "Dokument wurde erfolgreich veröffentlicht"; } return "Veröffentlichung wurde abgebrochen"; }, });

return ...; }`

Typische Anwendungsfälle

Fall 1: SaaS-Intelligent-Assistent

Szene: Ein unternehmensweites Projektmanagement-Tool, das einen KI-Assistenten integriert, um Benutzern zu helfen, Aufgaben schnell zu erstellen, Ressourcen zuzuweisen und Berichte zu generieren.

Wichtige Implementierungspunkte:

- Verwendung der Shared-State-Funktion von CopilotKit, damit die KI die aktuelle Projektansicht in Echtzeit versteht

- Dynamische Darstellung von Aufgabenkarten, Gantt-Diagrammen und anderen Komponenten durch generative UI

- Mensch-Maschine-Kooperationsknoten stellen sicher, dass kritische Operationen (z. B. Löschen von Projekten) eine Bestätigung durch den Benutzer erfordernBenutzer können komplexe Operationen mit natürlicher Sprache durchführen, wie "Hilf mir, die Aufgaben, die nächste Woche fällig sind, dem Frontend-Team zuzuweisen und einen Fortschrittsbericht zu erstellen".

### Fall 2: AI Forschungsassistent

Szene: Akademisches Forschungshilfsmittel, das Forschern hilft, Materialien zu sammeln, die Struktur von Arbeiten zu organisieren und gemeinsam zu schreiben.

Implementierungsdetails:

[[HTMLPLACEHOLDER0]]

### Fall 3: Intelligente Formularausfüllung

Szene: Umwandlung komplexer Versicherungsanträge in dialogbasierte Interaktionen.

Implementierungsdetails:

[[HTMLPLACEHOLDER1]]

## Technische Erkenntnisse

Die technische Implementierung von CopilotKit basiert auf modernen Web-Stacks. Das Frontend verwendet React (unterstützt auch Angular) als Haupt-UI-Framework und bietet Hooks wie useAgent und useCoAgent für das Statusmanagement und die Agenteninteraktion. Der Backend-Laufzeit-CopilotRuntime-Klasse fungiert als zentraler Orchestrator, der Anforderungsvalidierung, LLM-Aufrufe und Streaming-Antworten verarbeitet. Das Kommunikationsprotokoll verwendet Server-Sent Events (SSE) für das Echtzeit-Streaming vom Server zum Client und verarbeitet gleichzeitig Client-Anfragen über HTTP POST.

Die Version v1.50 brachte bedeutende Architektur-Upgrades mit sich, führte eine klarere einheitliche Endpunktarchitektur, bessere Beobachtbarkeit (eingebaute Telemetrie) und eine tiefere Integration mit CopilotKit Next ein, was das Entwicklungserlebnis weiter vereinfachte.

## ZukunftsausblickDie strategische Positionierung von CopilotKit ist es, die Infrastruktur-Ebene für die Entwicklung von Proxy-Anwendungen zu werden. Mit der zunehmenden Akzeptanz des AG-UI-Protokolls durch mehr Anbieter (Microsoft, Google, AWS usw. haben bereits Unterstützung angeboten) entsteht ein Ökosystem für Proxy-Anwendungen, das auf offenen Standards basiert. CopilotKit senkt durch die Bereitstellung von vorgefertigten Komponenten, generativen UI-Mustern und tiefgreifender Framework-Integration erheblich die Hürden für den Aufbau eines produktionsreifen AI Copilot, sodass Entwickler sich auf die Geschäftslogik und nicht auf die Details der zugrunde liegenden Kommunikation konzentrieren können.