Github Täglich Bester Platz 1: Entwicklung eines Echtzeit-Sprach-KI-Agenten, ein Allzweck-Werkzeugkasten

Github Täglich Bester Platz 1: Entwicklung eines Echtzeit-Sprach-KI-Agenten, ein Allzweck-Werkzeugkasten

Habt ihr das auch schon mal erlebt, dass ihr eigentlich einen einfachen Sprach-KI-Agenten entwickeln wolltet, aber durch verschiedene Probleme aufgehalten wurdet, z.B. dass einige im Team Python beherrschen, andere C++? Wenn die einzelnen entwickelten Teile zusammengefügt werden, gibt es Probleme, die Konfiguration der Umgebung kann einen halben Tag dauern, und die Erweiterung der Funktionen wird immer chaotischer, bis die Begeisterung schließlich nachlässt.

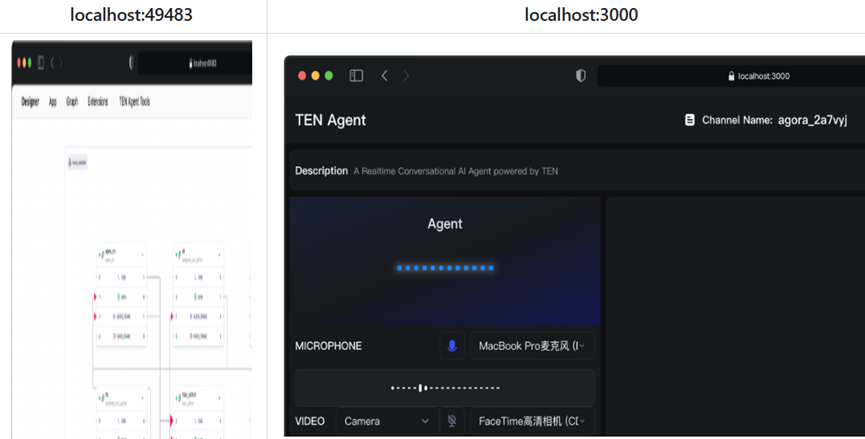

Heute stelle ich euch einen super praktischen Allzweck-Entwicklungswerkzeugkasten vor: TEN-Framework.

Open-Source-Adresse: https://github.com/TEN-framework/ten-framework

TEN Framework ist, als ob diese komplizierten Dinge für euch verpackt wären. Es ist eigentlich ein Framework, das speziell für die Erstellung von Echtzeit-Multimodal-Dialog-KI entwickelt wurde. Ihr könnt es euch als eine fertige Produktionslinie für KI-Sprachassistenten vorstellen. Spracherkennungsmodul, großes Modellmodul, Sprachsynthesemodul, all das ist für euch vorbereitet. Ihr müsst sie nur noch nach euren Bedürfnissen zusammenbauen. Das ist viel einfacher, als das Rad selbst neu zu erfinden.

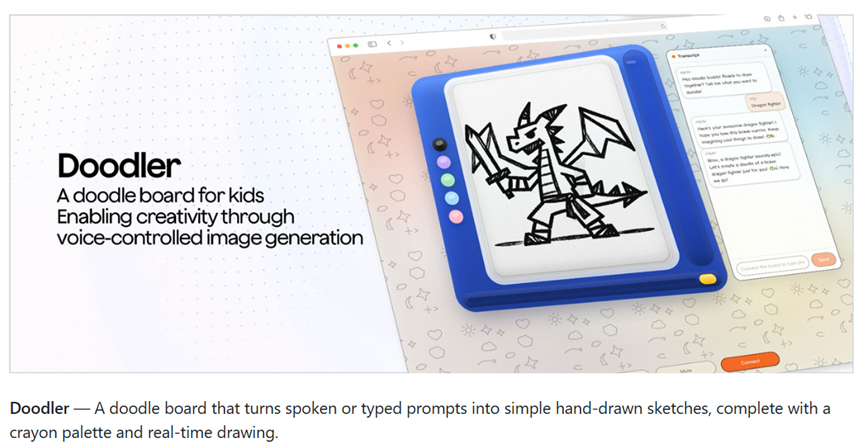

Was es konkret kann, da picke ich zuerst ein paar Dinge heraus, die ich für besonders nützlich halte. Das erste ist ein Mehrzweck-Sprachassistent, der sowohl RTC- als auch WebSocket-Verbindungen unterstützt, mit geringer Latenz und guter Klangqualität. Egal, ob ihr einen intelligenten Kundenservice oder einen persönlichen Sprachassistenten entwickeln wollt, diese Funktion sollte eure Bedürfnisse erfüllen. Interessant ist auch der Doodle-Generator, der malt, was ihr sagt, und zwar im handgezeichneten Stil. Diese Funktion dürfte in Demonstrations- oder Unterhaltungsszenarien sehr beliebt sein.

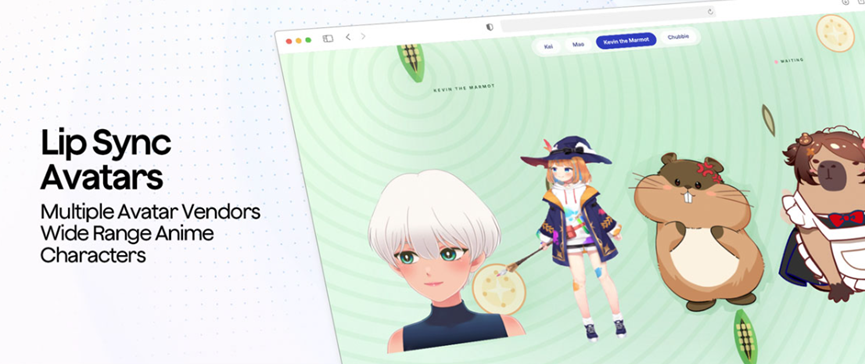

Für Mehrpersonen-Dialogszenarien gibt es auch entsprechende Lösungen. Es verfügt über eine Echtzeit-Sprechererkennungsfunktion, die automatisch erkennt, wer spricht, so dass ihr euch bei der Protokollierung von Besprechungen oder der Transkription von Interviews keine Sorgen über Verwirrung machen müsst. Im Bereich der virtuellen Avatare kann die Mundbewegung des Charakters perfekt mit der Sprache synchronisiert werden, wenn der KI-Assistent spricht. Egal, ob es sich um einen Anime-Charakter aus der zweiten Dimension oder einen realistischen 3D-Avatar handelt, die Mundbewegung passt. Das ist sehr praktisch für Entwickler, die virtuelle Moderatoren oder personalisierte Assistenten erstellen wollen.

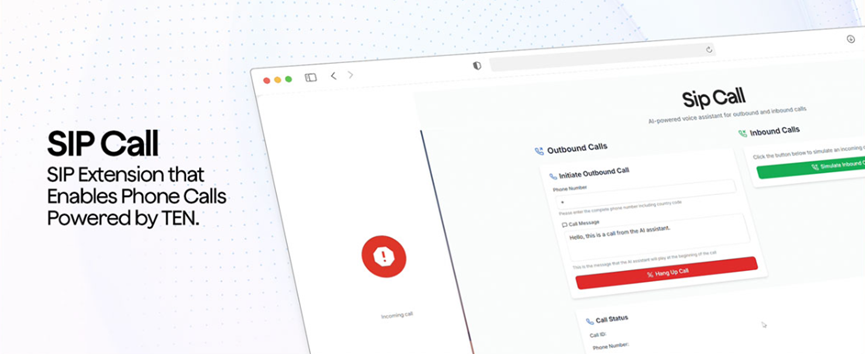

Wenn ihr es zum Telefonieren verwenden wollt, unterstützt es auch das SIP-Protokoll, so dass der KI-Assistent direkt Anrufe entgegennehmen kann. Diese Funktion ist für Unternehmenskunden sehr nützlich, da sie die Integration von intelligentem Kundenservice und Telefonsystemen ermöglicht und so erhebliche Personalkosten einsparen kann. Natürlich verfügt es auch über eine grundlegende Sprache-zu-Text-Funktion, die Sprache in Echtzeit in Text umwandelt, was in Szenarien wie Besprechungsprotokollen und Untertitelgenerierung eingesetzt werden kann.

Neben standardisierten Prozessen bietet es auch viele vorgefertigte Projektvorlagen, egal ob es sich um KI-Agenten-Vorlagen oder verschiedene Erweiterungen und Anwendungsvorlagen handelt. Zum Beispiel LLM-, TTS-Erweiterungsvorlagen und Standardanwendungsvorlagen in verschiedenen gängigen Sprachen, die direkt verwendet werden können. Vom Erstellen eines neuen Projekts bis zum Ausführen der ersten Demo dauert es nur wenige Minuten, was sehr zeitsparend ist.

Für erfahrene Entwickler gibt es auch fortgeschrittene Möglichkeiten, z. B. die Entwicklung eines leistungsstarken Echtzeit-Sprachassistenten, die Verwendung von C++ für die Echtzeit-Audio- und Videoverarbeitung, um eine geringe Latenz zu gewährleisten, die Verwendung von Python für LLM-Inferenz, damit der Assistent zuhören und denken kann. Und die Verwendung von Node.js für die Frontend-Interaktion, damit Benutzer es einfach bedienen können, die gesamte Entwicklungsgeschwindigkeit ist mehr als dreimal so schnell wie bei der herkömmlichen Einzel-Sprachen-Entwicklung.

Oder kombiniert die TEN VAD-Sprachaktivitätserkennungserweiterung, die TTS-Text-zu-Sprache-Erweiterung und die LLM-Erweiterung, um einen vollautomatischen intelligenten Dialogroboter zu erstellen. Die Erweiterungen können nahtlos miteinander verbunden werden, ohne dass ihr selbst komplizierten Integrationscode schreiben müsst.

Derzeit steht dieses Framework kurz vor dem Durchbruch von 10000 Sternen, wer Interesse hat, kann es gerne ausprobieren.