Github Meilleur du jour #1 : Développer un agent IA vocal en temps réel, une boîte à outils universelle

Github Meilleur du jour #1 : Développer un agent IA vocal en temps réel, une boîte à outils universelle

Avez-vous déjà ressenti cela, voulant créer un simple agent IA vocal, mais bloqué par divers problèmes, comme le fait que certains membres de l'équipe maîtrisent Python, tandis que d'autres excellent en C++. Les parties développées par chacun posent problème une fois assemblées, la configuration de l'environnement peut prendre une demi-journée, et l'extension des fonctionnalités devient de plus en plus chaotique, jusqu'à ce que l'enthousiasme disparaisse.

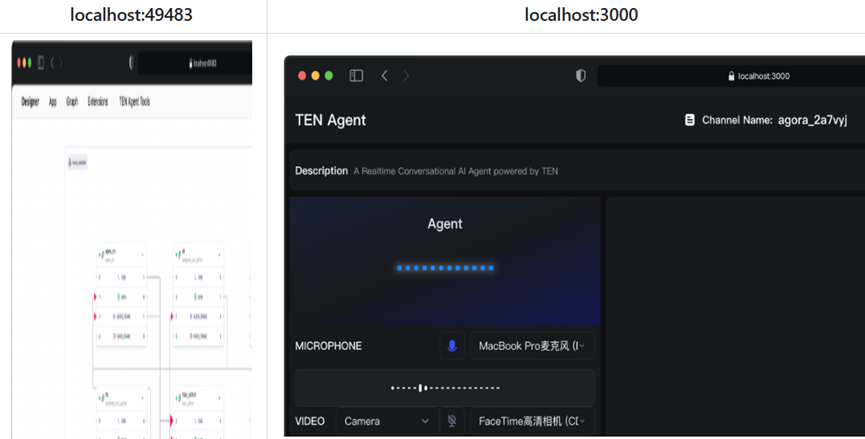

Je vous présente aujourd'hui une boîte à outils de développement universelle super pratique : TEN-Framework.

Adresse open source : https://github.com/TEN-framework/ten-framework

TEN Framework, c'est comme si toutes ces choses complexes étaient emballées pour vous. Il s'agit en fait d'un framework spécialement conçu pour construire une IA conversationnelle multimodale en temps réel. Vous pouvez l'imaginer comme une ligne de production d'assistants vocaux IA prête à l'emploi. Module de reconnaissance vocale, module de grand modèle, module de synthèse vocale, tout cela est préparé pour vous. Ce que vous devez faire, c'est les assembler selon vos besoins. C'est beaucoup plus simple que de réinventer la roue à partir de zéro.

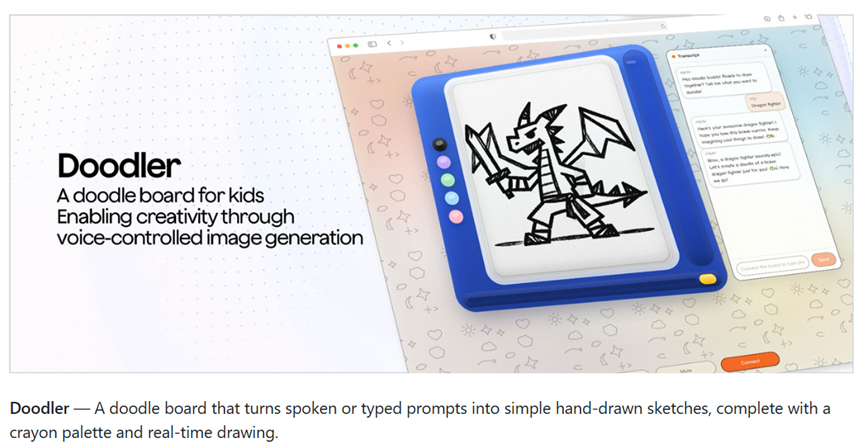

En parlant de ce qu'il peut faire concrètement, je vais d'abord choisir quelques éléments que je trouve particulièrement utiles. Le premier est un assistant vocal polyvalent, qui prend en charge les connexions RTC et WebSocket, avec une faible latence et une bonne qualité sonore. Que vous souhaitiez créer un service client intelligent ou un assistant vocal personnel, cette fonctionnalité peut essentiellement répondre à vos besoins. Il y a aussi un générateur de gribouillis intéressant, vous dites quelque chose et il le dessine, en générant des gribouillis de style dessinés à la main. Cette fonctionnalité devrait être très populaire dans les scénarios de démonstration ou de divertissement.

Il existe également des solutions correspondantes pour les scénarios de conversation à plusieurs. Il dispose d'une fonction de reconnaissance de l'orateur en temps réel, qui peut automatiquement distinguer qui parle, de sorte que vous n'avez pas à vous soucier de la confusion lors de l'enregistrement de réunions ou de la transcription d'entretiens. En ce qui concerne les avatars virtuels, lorsque l'assistant IA parle, la forme de la bouche du personnage peut être parfaitement synchronisée avec la voix. Qu'il s'agisse d'un personnage d'anime bidimensionnel ou d'un humain virtuel 3D réaliste, la forme de la bouche peut correspondre. C'est très pratique pour les développeurs qui créent des streamers virtuels ou des assistants personnalisés.

Si vous voulez qu'il réponde au téléphone, il prend également en charge le protocole SIP, et l'assistant IA peut répondre directement aux appels téléphoniques. Cette fonctionnalité est très utile pour les entreprises. Connecter le service client intelligent au système téléphonique peut permettre d'économiser beaucoup de coûts de main-d'œuvre. Bien sûr, il dispose également de la fonction de base de conversion de la parole en texte, en transformant la parole en texte en temps réel, ce qui peut être utilisé dans les procès-verbaux de réunion, la génération de sous-titres et d'autres scénarios.

En plus des processus standardisés, il intègre également de nombreux modèles de projets prêts à l'emploi, qu'il s'agisse de modèles d'AI Agent ou de divers modèles d'extensions et d'applications. Par exemple, les modèles d'extension LLM, TTS, ainsi que plusieurs modèles d'applications par défaut dans les principaux langages, peuvent être utilisés directement. De la création d'un nouveau projet à l'exécution de la première démo, cela ne prend que quelques minutes, ce qui permet de gagner beaucoup de temps.

Si vous êtes un développeur expérimenté, il existe également des façons avancées de jouer, par exemple, vous pouvez créer un assistant vocal en temps réel haute performance, utiliser C++ pour le traitement audio et vidéo en temps réel, garantir une faible latence, utiliser Python pour l'inférence LLM, afin que l'assistant puisse comprendre et réfléchir. Ensuite, utilisez Node.js pour l'interaction frontale, afin que les utilisateurs puissent facilement opérer. L'ensemble du processus de développement est plus de 3 fois plus rapide que le développement traditionnel en langage unique.

Ou combinez l'extension de détection d'activité vocale VAD de TEN, l'extension de conversion de texte en parole TTS et l'extension LLM, et vous pouvez créer un robot de dialogue intelligent entièrement automatique. Les extensions peuvent se connecter de manière transparente, sans que vous ayez à écrire un code d'intégration fastidieux.

Actuellement, ce framework est sur le point de dépasser les 10 000 étoiles. Si vous êtes intéressé, vous pouvez l'essayer.