Github Miglior Primo del Giorno: Sviluppa Agenti AI Vocali in Tempo Reale, Cassetta degli Attrezzi Universale

Github Miglior Primo del Giorno: Sviluppa Agenti AI Vocali in Tempo Reale, Cassetta degli Attrezzi Universale

Avete mai avuto la sensazione di voler creare un semplice agente AI vocale, ma di essere bloccati da vari problemi, come ad esempio avere membri del team esperti in Python e altri in C++? Quando si uniscono le parti sviluppate separatamente, sorgono problemi e la configurazione dell'ambiente può richiedere molto tempo. L'espansione delle funzionalità diventa sempre più caotica, fino a quando l'entusiasmo svanisce.

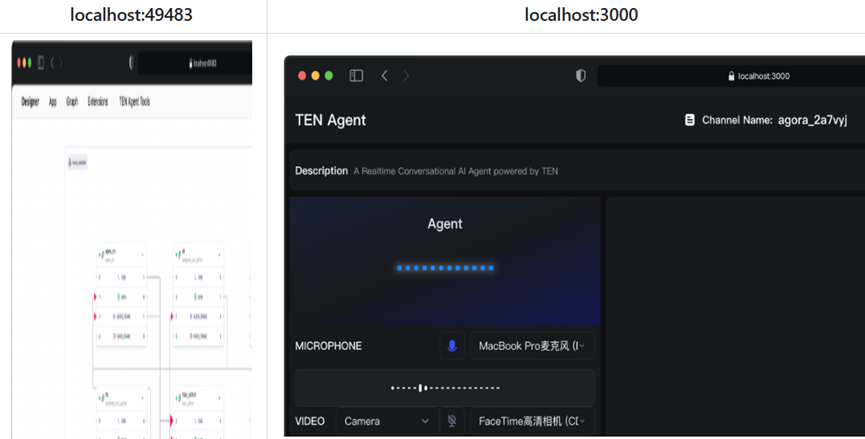

Oggi vi presento una cassetta degli attrezzi di sviluppo universale super utile: TEN-Framework.

Indirizzo open source: https://github.com/TEN-framework/ten-framework

TEN Framework è come se avesse impacchettato tutte queste cose complesse per voi. In realtà, è un framework appositamente progettato per costruire AI conversazionali multimodali in tempo reale. Potete immaginarlo come una linea di produzione di assistenti vocali AI già pronta. Moduli di riconoscimento vocale, moduli di modelli di grandi dimensioni, moduli di sintesi vocale, sono tutti preparati per voi. Tutto quello che dovete fare è assemblarli in base alle vostre esigenze. Questo è molto più semplice che reinventare la ruota da soli.

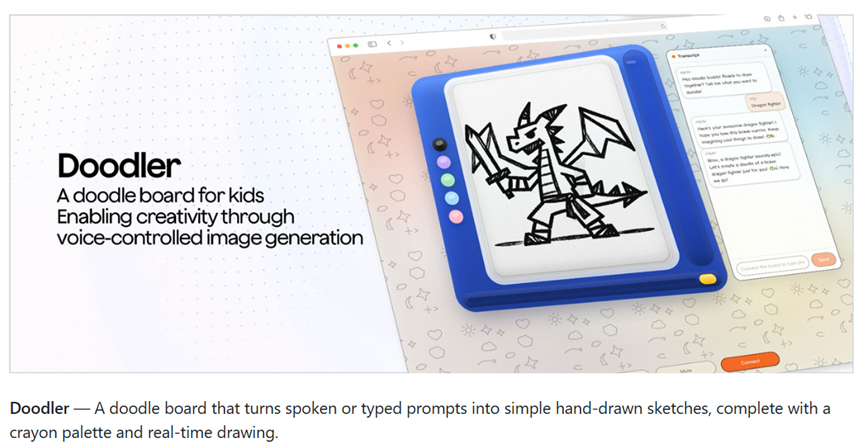

A proposito di cosa può fare in concreto, vorrei prima parlare di alcune cose che trovo più pratiche. La prima è un assistente vocale multiuso, che supporta sia connessioni RTC che WebSocket, con bassa latenza e buona qualità del suono. Sia che vogliate creare un servizio clienti intelligente o un assistente vocale personale, questa funzione può sostanzialmente soddisfare le vostre esigenze. È interessante notare che ha anche un generatore di scarabocchi: qualunque cosa diciate, lo disegna, generando scarabocchi in stile disegnato a mano. Questa funzione dovrebbe essere molto popolare negli scenari dimostrativi o di intrattenimento.

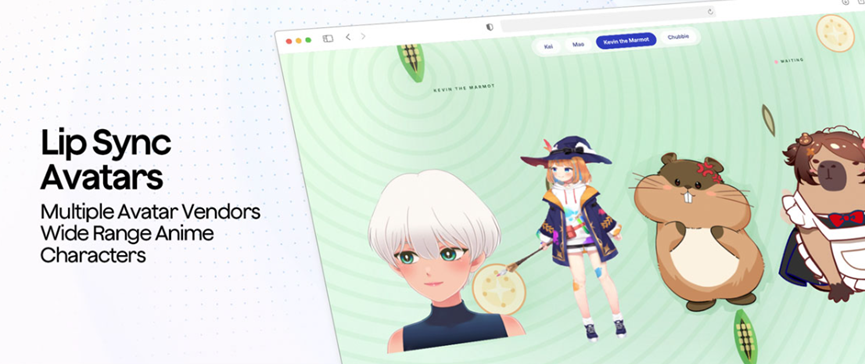

Ci sono anche soluzioni corrispondenti per scenari di conversazione multipla. Ha una funzione di riconoscimento del parlante in tempo reale, che può distinguere automaticamente chi sta parlando, in modo da non doversi preoccupare della confusione durante la registrazione di riunioni o la trascrizione di interviste. Per quanto riguarda gli avatar virtuali, quando l'assistente AI parla, la forma della bocca del personaggio può essere perfettamente sincronizzata con la voce. Che si tratti di personaggi anime bidimensionali o di esseri umani virtuali 3D realistici, la forma della bocca può essere abbinata. Questo è molto conveniente per gli sviluppatori che creano streamer virtuali o assistenti personalizzati.

Se volete che risponda al telefono, supporta anche il protocollo SIP e l'assistente AI può rispondere direttamente alle chiamate. Questa funzione è molto utile per gli utenti aziendali. Collegando il servizio clienti intelligente al sistema telefonico, è possibile risparmiare molti costi di manodopera. Naturalmente, ha anche la funzione base di trascrizione vocale in testo, trasformando la voce in testo in tempo reale, che può essere utilizzata in scenari come verbali di riunioni e generazione di sottotitoli.

Oltre ai processi standardizzati, ha anche molti modelli di progetto già pronti, sia modelli di AI Agent che vari modelli di estensioni e applicazioni. Ad esempio, modelli di estensione LLM, TTS e diversi modelli di applicazione predefiniti in lingue principali possono essere utilizzati direttamente. Dalla creazione di un nuovo progetto all'esecuzione della prima demo, ci vogliono solo pochi minuti, risparmiando molto tempo.

Se siete sviluppatori esperti, ci sono anche modi avanzati per giocare, come creare un assistente vocale in tempo reale ad alte prestazioni, utilizzare C++ per l'elaborazione audio e video in tempo reale per garantire una bassa latenza e utilizzare Python per l'inferenza LLM, in modo che l'assistente possa capire e pensare. Quindi utilizzare Node.js per l'interazione front-end, in modo che gli utenti possano operare facilmente. L'intera velocità di sviluppo è più di 3 volte più veloce dello sviluppo tradizionale in una singola lingua.

Oppure, combinando l'estensione di rilevamento dell'attività vocale VAD di TEN, l'estensione di sintesi vocale TTS e l'estensione LLM, è possibile creare un robot di dialogo intelligente completamente automatico. Le estensioni possono essere collegate senza problemi, senza dover scrivere complicati codici di integrazione.

Attualmente, questo framework sta per superare le 10000 stelle. Se siete interessati, potete provarlo.