Github वरील दररोजचा सर्वोत्तम पहिला क्रमांक: रिअल-टाइम व्हॉइस एआय (AI) इंटेलिजेंट एजंट, मल्टीपर्पज टूलबॉक्स विकसित करा

Github वरील दररोजचा सर्वोत्तम पहिला क्रमांक: रिअल-टाइम व्हॉइस एआय (AI) इंटेलिजेंट एजंट, मल्टीपर्पज टूलबॉक्स विकसित करा

तुम्हाला कधी असा अनुभव आला आहे का, की तुम्हाला एक साधा व्हॉइस एआय (AI) इंटेलिजेंट एजंट तयार करायचा आहे, पण तुम्ही अनेक समस्यांमध्ये अडकला आहात, जसे की तुमच्या टीममधील काही जण Python मध्ये तर काही C++ मध्ये चांगले आहेत. जेव्हा तुम्ही दोघांनी विकसित केलेले भाग एकत्र जोडता, तेव्हा समस्या येतात, वातावरण सेट करण्यात तुमचा बराच वेळ वाया जातो, आणि तुम्ही जसे फिचर्स वाढवता तसतं ते अधिक गोंधळात टाकणारे ठरतात, आणि शेवटी तुमचा उत्साह कमी होतो.

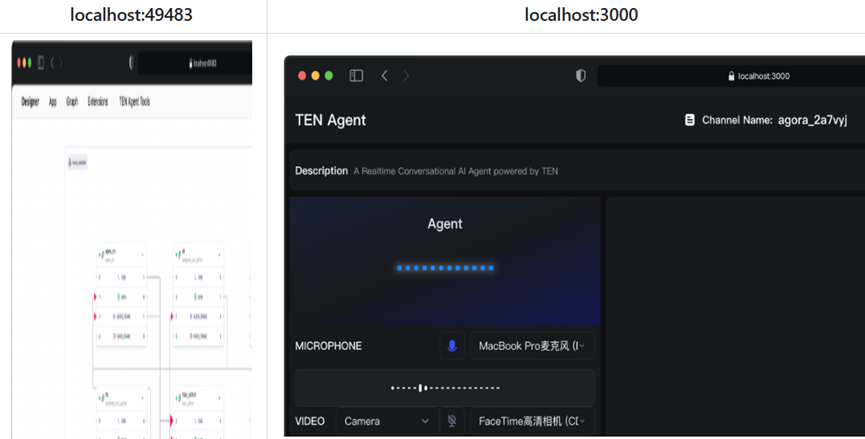

आज मी तुम्हाला TEN-Framework नावाच्या एका अतिशय उपयुक्त मल्टीपर्पज डेव्हलपमेंट टूलबॉक्सची ओळख करून देणार आहे.

ओपन सोर्स ॲड्रेस: https://github.com/TEN-framework/ten-framework

TEN Framework हे तुमच्यासाठी या सर्व क्लिष्ट गोष्टी एकत्र बांधण्यासारखे आहे. हे रिअल-टाइम मल्टीमॉडल संभाषणात्मक एआय (AI) तयार करण्यासाठीचे एक फ्रेमवर्क आहे. तुम्ही याला एआय (AI) व्हॉइस असिस्टंट उत्पादन लाइन म्हणून समजू शकता. व्हॉइस रेकग्निशन मॉड्यूल, मोठे मॉडेल मॉड्यूल, व्हॉइस सिंथेसिस मॉड्यूल, हे सर्व तुमच्यासाठी तयार आहेत, तुम्हाला फक्त तुमच्या गरजेनुसार ते एकत्र करायचे आहेत. हे स्वतःहून चाक नव्याने बनवण्यापेक्षा खूप सोपे आहे.

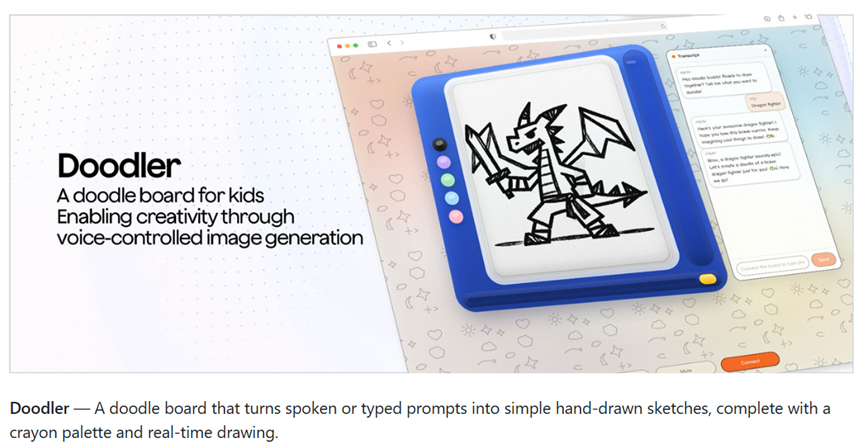

हे नेमकं काय करू शकतं याबद्दल बोलायचं झाल्यास, मला जे जास्त उपयोगी वाटतात त्यापैकी काही निवडतो. पहिले म्हणजे मल्टीपर्पज व्हॉइस असिस्टंट, जे RTC आणि WebSocket या दोन्ही कनेक्शन पद्धतींना सपोर्ट करते, कमी लेटेंसी (latency) आणि चांगली ऑडिओ क्वालिटी (audio quality) देते. तुम्हाला स्मार्ट कस्टमर सर्व्हिस (smart customer service) किंवा पर्सनल व्हॉइस असिस्टंट (personal voice assistant) तयार करायचा असेल, तरी हे फिचर तुमच्या गरजा पूर्ण करू शकते. यात एक मजेदार डूडल जनरेटर (doodle generator) आहे, तुम्ही जे बोलता ते ते काढते, आणि ते हाताने काढलेल्या शैलीतील डूडल (doodle) तयार करते. हे फिचर डेमो (demo) किंवा मनोरंजनाच्या उद्देशाने खूप लोकप्रिय होऊ शकते.

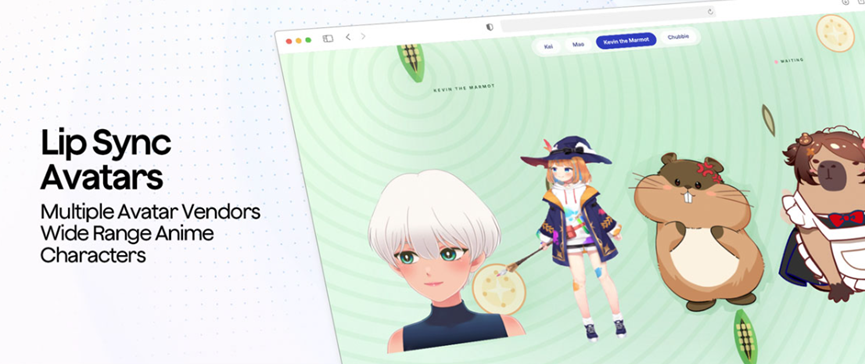

एकापेक्षा जास्त व्यक्तींच्या संभाषणासाठी देखील यात सोल्यूशन्स (solutions) आहेत. यात रिअल-टाइम स्पीकर रेकग्निशन (real-time speaker recognition) फिचर आहे, जे आपोआप ओळखते की कोण बोलत आहे, ज्यामुळे मीटिंग रेकॉर्ड (meeting record) करताना किंवा मुलाखतीचे ट्रांसक्रिप्शन (transcription) करताना गोंधळ होण्याची शक्यता नाही. व्हर्च्युअल इमेजच्या (virtual image) बाबतीत, एआय (AI) असिस्टंट बोलत असताना, पात्राचे ओठ व्हॉइससोबत पूर्णपणे सिंक (sync) होतात. हे कार्टूनमधील ॲनिमे (anime) पात्र असो किंवा 3D मधील व्हर्च्युअल माणूस असो, ओठांची हालचाल जुळते. व्हर्च्युअल यूट्यूबर (virtual youtuber) किंवा पर्सनलाइज्ड असिस्टंट (personalized assistant) बनवणाऱ्या डेव्हलपर्ससाठी (developers) हे खूप सोपे आहे.

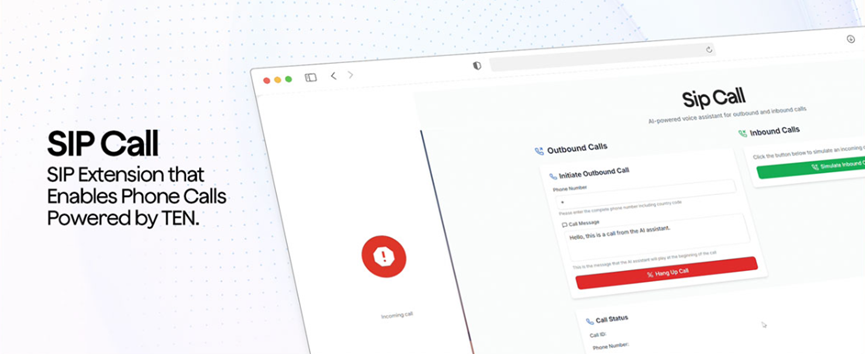

जर तुम्हाला याला फोन कॉल रिसीव्ह (receive) करायला लावायचा असेल, तर ते SIP प्रोटोकॉलला (protocol) सपोर्ट करते, एआय (AI) असिस्टंट थेट फोन उचलू शकतो. हे फिचर एंटरप्राइज युजर्ससाठी (enterprise users) खूप उपयोगी आहे, स्मार्ट कस्टमर सर्व्हिसला (smart customer service) टेलिफोन सिस्टीमशी (telephone system) कनेक्ट केल्याने मनुष्यबळाचा खर्च वाचतो. अर्थात, यात मूलभूत व्हॉइस-टू-टेक्स्ट (voice-to-text) फिचर देखील आहे, जे रिअल-टाइममध्ये (real-time) व्हॉइसला टेक्स्टमध्ये (text) रूपांतरित करते, मीटिंग नोट्स (meeting notes) आणि सबटायटल्स (subtitles) तयार करण्यासाठी याचा उपयोग होतो.

स्टँडर्डाइज्ड (standardized) प्रक्रियेव्यतिरिक्त, यात अनेक रेडी-मेड (ready-made) प्रोजेक्ट टेम्प्लेट्स (project templates) आहेत, मग ते एआय (AI) एजंटचे (agent) टेम्प्लेट (template) असो, किंवा विविध एक्सटेंशनचे (extensions) आणि ॲप्लिकेशन्सचे (applications) टेम्प्लेट (template) असो. उदाहरणार्थ, LLM, TTS एक्सटेंशन टेम्प्लेट्स (extension templates), आणि काही मुख्य भाषांमधील डिफॉल्ट ॲप्लिकेशन टेम्प्लेट्स (default application templates) थेट वापरले जाऊ शकतात. नवीन प्रोजेक्ट सुरू करण्यापासून ते पहिला डेमो (demo) रन (run) करेपर्यंत काही मिनिटे लागतात, त्यामुळे वेळेची बचत होते.

जर तुम्ही अनुभवी डेव्हलपर (developer) असाल, तर तुम्ही प्रगत गोष्टी करू शकता, जसे की C++ वापरून रिअल-टाइम ऑडिओ (real-time audio) आणि व्हिडिओ (video) प्रोसेसिंग (processing) करून कमी लेटेंसीसह (latency) हाय-परफॉर्मन्स (high-performance) रिअल-टाइम व्हॉइस असिस्टंट (real-time voice assistant) तयार करणे, आणि Python वापरून LLM इन्फरन्स (inference) करणे, ज्यामुळे असिस्टंटला (assistant) ऐकायला आणि विचार करायला मदत होईल. Node.js वापरून फ्रंट-एंड इंटरॅक्शन (front-end interaction) तयार करणे, ज्यामुळे युजर्सना (users) सहजपणे ऑपरेट (operate) करता येईल, आणि संपूर्ण डेव्हलपमेंटची (development) गती पारंपरिक सिंगल-लँग्वेज डेव्हलपमेंटपेक्षा (single-language development) 3 पट जास्त असेल.

किंवा TEN चे VAD व्हॉइस ॲक्टिव्हिटी डिटेक्शन एक्सटेंशन (voice activity detection extension), TTS टेक्स्ट-टू-स्पीच एक्सटेंशन (text-to-speech extension) आणि LLM एक्सटेंशन (extension) एकत्र करून, तुम्ही एक पूर्णपणे ऑटोमेटेड (automated) इंटेलिजेंट (intelligent) संभाषण बॉट (bot) तयार करू शकता, एक्सटेंशन्स (extensions) एकमेकांशी सहजपणे कनेक्ट (connect) होतात, तुम्हाला स्वतःहून क्लिष्ट इंटिग्रेशन कोड (integration code) लिहिण्याची गरज नाही.

सध्या, हे फ्रेमवर्क लवकरच 10000 स्टार्स (stars) पार करेल, ज्यांना स्वारस्य आहे ते वापरून पाहू शकतात.