Avaliação do MiniMax M2.5 da 稀宇 (Xi Yu)

Avaliação do MiniMax M2.5 da 稀宇 (Xi Yu)

Conclusão curta: Enraizar-se para baixo, crescer para cima

Informações básicas

A geração anterior do 稀宇, o M2.1, devido a problemas técnicos, embora tenha apresentado um progresso significativo na programação, ficou atrás do M2 em termos de capacidade lógica. Felizmente, o M2.5 resolveu basicamente os problemas técnicos e a capacidade voltou ao normal. Comparado ao M2, o progresso do M2.5 é de aproximadamente 17%.

No entanto, parte do progresso é obtido por meio de cadeias de pensamento mais longas e exploração mais profunda do espaço de solução. O consumo médio de Token do M2.5 está entre os 6 maiores de todos os modelos testados, quase o dobro do concorrente Sonnet. Felizmente, o poder computacional da 稀宇 é garantido e o custo não é alto. Embora a programação não consiga substituir o Sonnet sem pontos cegos, o uso diário é totalmente viável. O M2.5 finalmente alcançou o objetivo que o M2.1 queria alcançar.

Resultados Lógicos

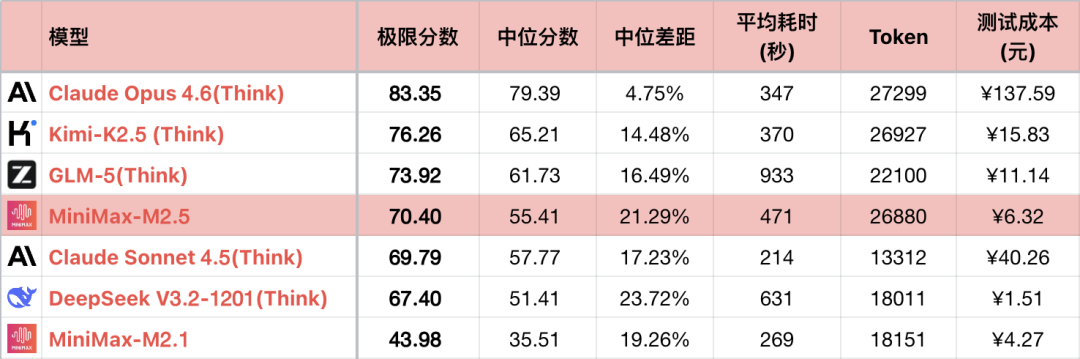

*1 A tabela mostra apenas alguns modelos comparáveis para destacar as relações de comparação e não é uma classificação completa.

*2 Para questões e métodos de teste, consulte: Avaliação Horizontal da Capacidade Lógica de Grandes Modelos de Linguagem - Ranking Mensal de 26-01. Adicionada a questão #56.

*3 A lista completa é atualizada em https://llm2014.github.io/llm_benchmark/

*4 O vermelho é limitado ao período do Festival da Primavera, representando alegria, sem outro significado.

Como o M2.1 é uma versão com bugs e capacidade lógica excepcionalmente baixa, a comparação intergeracional abaixo será feita apenas entre o M2 e o M2.5.

Melhorias

- Inferência Estável: O M2.5 pode manter as restrições iniciais e os detalhes do contexto durante processos de inferência mais longos. Portanto, em algumas questões que não são difíceis, mas exigem "foco", a pontuação do M2.5 melhorou significativamente. Por exemplo, na questão #4, Rotação do Cubo Mágico, o M2.5 é o 8º modelo global a obter pontuação máxima. No entanto, a maioria dos três grandes da América do Norte pode obter pontuação máxima de forma estável, enquanto o M2.5 só consegue acertar uma vez com baixa probabilidade, mostrando uma diferença significativa.

- Programação: Conforme mencionado anteriormente, o M2.5 não consegue substituir o Sonnet em todos os aspectos, principalmente devido à quantidade limitada de conhecimento de programação. Em situações que exigem experiência, habilidades, diferenças de API de versão, etc., o M2.5 tem dificuldade em identificar problemas por conta própria sem dicas e geralmente precisa de várias rodadas para reduzir gradualmente o problema. Mas isso já é um grande progresso em relação ao M2. No teste de projeto C, a maioria dos modelos nacionais fica presa nas primeiras 2 rodadas, enquanto o M2.5 se tornou o primeiro modelo nacional a romper até a 8ª rodada. Embora o M2.5 tenha deficiências óbvias no uso de OpenGL e na imaginação espacial, com a capacidade de Agent otimizada, ele pode tentar e errar continuamente, convergindo para a solução correta. Além disso, vale a pena notar que o M2.5 "fala" menos ao trabalhar na programação, quase apenas produzindo um breve resumo após concluir o trabalho final, sem emitir ideias no meio do caminho. Outros projetos ainda estão em teste e serão atualizados posteriormente.

- Capacidade de Cálculo: A capacidade de cálculo do M2 não é excelente, e o M2.1 é ainda pior. O M2.5 fez melhorias eficazes a partir de um ponto de partida baixo. Na maioria dos cálculos simples, o M2.5 tem uma pequena probabilidade de alta precisão, mas na maioria das vezes ainda existem erros de cálculo, grandes erros e incapacidade de entender as fórmulas. O treinamento nesta área ainda é insuficiente. Como um modelo orientado por Agent, a capacidade de cálculo não é uma necessidade rígida, e o cálculo da série Claude também está atrasado há muito tempo.

Deficiências

- Seguimento de Instruções: Comparado ao M2, o aumento no seguimento de instruções não é grande. A probabilidade de obter pontuação máxima em algumas questões simples é maior, mas também não é estável. Existem casos de descarte aleatório de instruções ou adulteração de instruções, mas observando o conteúdo da cadeia de pensamento, o modelo percebeu todas as instruções, e o problema aparece na saída final. O desempenho geral está atrás de outros modelos na primeira linha. Na programação, também haverá casos de desconsiderar os requisitos de codificação e as normas do projeto. Por exemplo, no projeto C, é estipulado que o eixo Z das coordenadas esteja para cima, mas o M2.5 mudou arbitrariamente para o eixo Y para corrigir outro bug. O uso diário requer atenção extra ao controle.

- Alucinações: O nível de alucinação do M2.5 não mudou significativamente em relação ao M2. Na maioria das questões relacionadas ao contexto, as pontuações máximas dos dois são consistentes. Mesmo na questão #43, Cálculo do Número Alvo, o M2.5 cometerá alguns erros de baixo nível que apenas os modelos de segunda linha cometem, como usar números repetidamente e perder números.

O Historiador Cibernético Diz

Os fabricantes nacionais gastaram mais de meio ano explorando como os modelos de programação devem ser feitos. Os primeiros modelos que afirmavam ser substitutos do Sonnet pareciam semelhantes apenas no efeito de geração de "uma frase". Sua organização interna de código, engenharia e, mais importante, a capacidade de iteração de várias rodadas são muito inferiores. Isso também faz com que os programadores domésticos geralmente desconfiem dos modelos nacionais e prefiram usar o Claude, mesmo correndo o risco de ter suas contas bloqueadas.

Com o MiniMax M2 e M2.1 revertendo preliminarmente a reputação, a geração M2.5 avança a usabilidade da programação de modelos nacionais. De fato, ainda existe uma lacuna abrangente entre o M2.5 e o nível Opus declarado oficialmente, mas enquanto houver pessoas dispostas a confiar e dispostas a usar, as coisas se desenvolverão em uma direção melhor. Desta forma, o M2.5 é de fato um passo sólido que a 稀宇 deu em direção ao objetivo da vitória.