OpenClaw + Claude Code 超强教程:一个人就能搭建完整的开发团队!

OpenClaw + Claude Code 超强教程:一个 човек може да изгради цялостен екип за разработка!

Днес споделям един много впечатляващ практичен случай. (В края на статията е приложено ръководство)

Един независим разработчик, използвайки OpenClaw + Codex/CC, е изградил система за AI Agent, какъв ефект е постигнал?

94 подадени заявки за един ден, 30 минути за завършване на 7 PR, а в този ден той е провел и 3 клиентски срещи, без дори да е отварял редактора.

Това е истински случай, който се е случил през януари 2026 година. Авторът е публикувал архитектурата на цялата система, работния процес и конфигурацията на кода, и след като го прочетох, реших, че този подход е твърде полезен, затова го организирах в тази статия, за да го споделя с вас.

Ако и вие използвате Codex или Claude Code, или се интересувате от OpenClaw, тази статия ще ви вдъхнови много.

Един човек, 94 подадени заявки за код за един ден

Първо, нека видим няколко данни, за да усетим мощта на тази система:

- Най-много 94 подадени заявки за един ден (средно 50 подадени заявки на ден)

- Завършени 7 PR за 30 минути

- Скоростта от идея до пускане е толкова бърза, че може да "предаде клиентските изисквания в същия ден"

Какви са разходите? Всеки месец $190 (Claude $100 + Codex $90), начинаещ може да започне с $20.

Може би ще питате: Не е ли това просто натрупване на куп AI инструменти, след което лудо генериране на боклук код?

Не е така. Историята на Git на автора изглежда като "току-що нает екип от разработчици", но всъщност е само той. Ключовата промяна е: той преминава от "управление на Claude Code" към "управление на AI помощник, който след това управлява група Claude Code".

- Преди януари: директно пише код с Codex или Claude Code

- След януари: използва OpenClaw като слой за координация, за да управлява Codex/Claude Code/Gemini

Защо Codex и Claude Code сами по себе си не са достатъчни?

В този момент може да се запитате: Codex и Claude Code вече са много мощни, защо е необходимо да добавяме слой за координация?

Отговорът на автора е много директен: Codex и Claude Code почти не знаят нищо за вашия бизнес. Те виждат само кода, но не виждат цялостната бизнес картина.

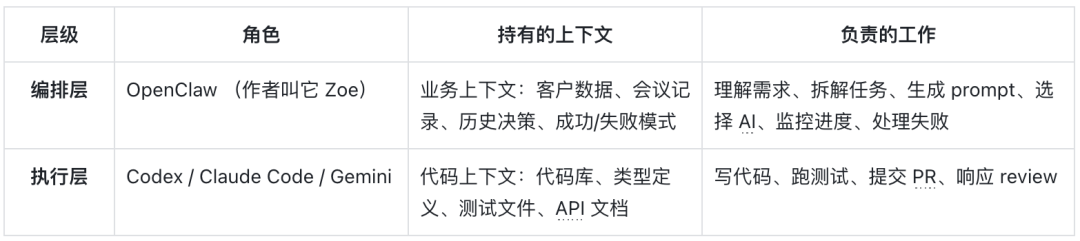

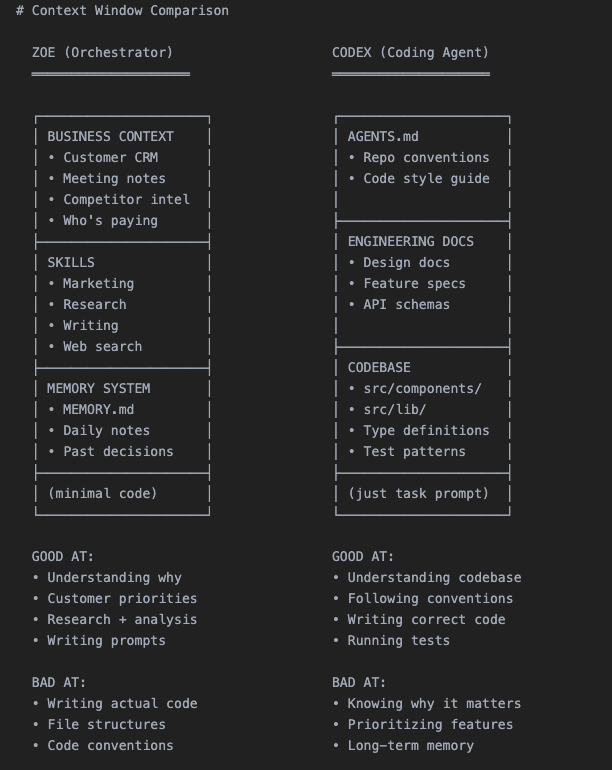

Тук има основно ограничение: контекстният прозорец е фиксиран, можете да изберете само едно от двете.

Трябва да направите избор какво да поставите вътре:

- Пълно с код → няма място за бизнес контекст

- Пълно с клиентска история → няма място за кодова база

- То не знае за кой клиент е предназначена тази функция

- То не знае защо предишното подобно изискване е било неуспешно

- То не знае вашето продуктово позициониране и принципи на дизайн

- То може да работи само на базата на текущия код и вашия prompt

Той служи като слой за координация, разположен между вас и всички AI инструменти. Неговата роля е:

- Да държи целия бизнес контекст (данни за клиенти, протоколи от срещи, исторически решения, успешни/неуспешни случаи)

- Да превежда бизнес контекста в точни prompts, които да предостави на конкретния агент

- Да накара тези агенти да се фокусират върху това, което правят най-добре: да пишат код

- Codex/Claude Code = професионален готвач, който се грижи само за готвенето

- OpenClaw = главен готвач, който знае вкусовете на клиентите, наличността на съставките, позиционирането на менюто и дава точни инструкции на всеки готвач

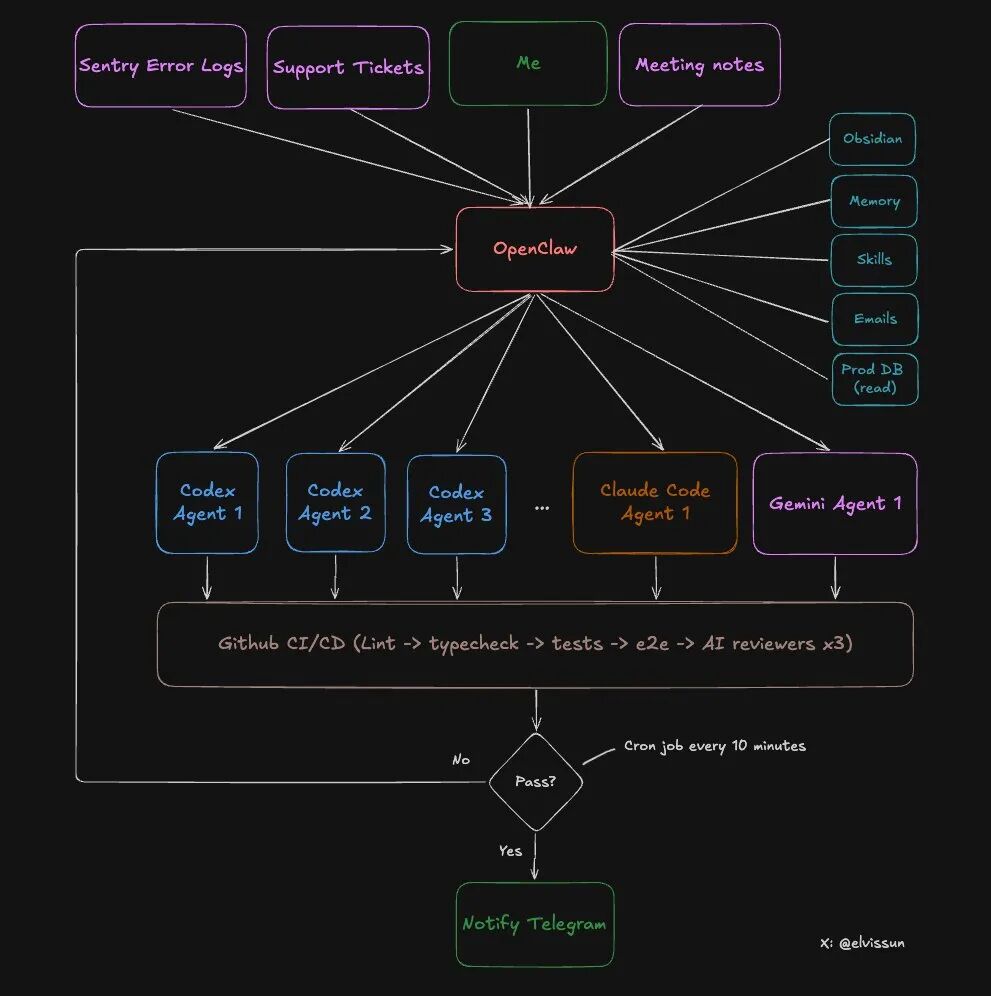

Конкретната архитектура на двуслойната система: слой за координация + слой за изпълнение

Нека разгледаме конкретната архитектура на тази система.

Две нива, всяко със своите задължения:

Какво може да направи OpenClaw (слой за координация)?

- Чете всички протоколи от срещи в бележките на Obsidian (автоматична синхронизация)

- Достъп до производствената база данни (само за четене) за получаване на клиентски конфигурации

- Има администраторски API права, може директно да зарежда средства на клиента и да премахва блокировки

- Избира подходящ агент в зависимост от типа задача

- Наблюдава напредъка на всички агенти, анализира причините за неуспех и коригира prompt за повторен опит

- Уведомява автора чрез Telegram след завършване

Какво може да направи Agent (изпълнителен слой)?

- Чете и записва в кодовата база

- Изпълнява тестове и изграждане

- Подава код и създава PR

- Отговаря на обратната връзка от прегледа на кода

Този дизайн е много умен: ясна защитна граница, докато се гарантира ефективност.

Пълен работен поток: 8 стъпки от клиентското изискване до сливането на PR

Сега преминаваме към основната част. С реален случай от миналата седмица на автора, ще ви преведем през целия процес.

Контекст: Един корпоративен клиент се обади и каза, че иска да повтори вече конфигурираните настройки и да ги сподели в екипа.

Стъпка 1: Клиентско изискване → OpenClaw разбира и разглобява

След края на разговора, авторът и Zoe (нейният OpenClaw) обсъдиха това изискване.

Тук е магията: нулеви разходи за обяснение. Понеже всички протоколи от срещи автоматично се синхронизират с Obsidian, Zoe вече е прочела съдържанието на разговора и знае кой е клиентът, какъв е техният бизнес сценарий и каква е текущата конфигурация.

Авторът и Zoe заедно разглобиха изискването на: да направят система за шаблони, позволяваща на потребителите да запазват и редактират текущата конфигурация.

След това Zoe направи три неща:

- Зареди средства на клиента — незабавно премахна ограниченията на клиента с администраторски API

- Изтегли конфигурацията на клиента — получи текущите настройки от производствената база данни (само за четене)

- Генерира prompt и стартира агента — опакова целия контекст и го подава на Codex

Стъпка 2: Стартиране на агента

Zoe създаде за тази задача:

- Независимо git worktree (изолирана среда за клон)

- tmux сесия (за да работи Agent на заден план)

# 创建 worktree + 启动代理 git worktree add ../feat-custom-templates -b feat/custom-templates origin/main cd ../feat-custom-templates && pnpm install

tmux new-session -d -s "codex-templates" -c "/Users/elvis/Documents/GitHub/medialyst-worktrees/feat-custom-templates" "$HOME/.codex-agent/run-agent.sh templates gpt-5.3-codex high" Защо използваме tmux? Защото можем да се намесим по всяко време.

Ако AI се отклони, не е нужно да го убиваме и да започваме отначало, просто изпращаме команди в tmux:

# 代理方向错了 tmux send-keys -t codex-templates "停一下。先做 API 层,别管 UI。" Enter

代理需要更多上下文

tmux send-keys -t codex-templates "类型定义在 src/types/template.ts,用那个。" Enter В същото време, задачата ще бъде записана в JSON файл:[[HTMLPLACEHOLDER0]] [[HTMLPLACEHOLDER1]] [[HTMLPLACEHOLDER2]] [[HTMLPLACEHOLDER3]] [[HTMLPLACEHOLDER4]] [[HTMLPLACEHOLDER5]] [[HTMLPLACEHOLDER6]] [[HTMLPLACEHOLDER7]] [[HTMLPLACEHOLDER8]] [[HTMLPLACEHOLDER9]] [[HTMLPLACEHOLDER10]] [[HTMLPLACEHOLDER11]] [[HTMLPLACEHOLDER12]] [[HTMLPLACEHOLDER13]] [[HTMLPLACEHOLDER14]] [[HTMLPLACEHOLDER15]] [[HTMLPLACEHOLDER16]] [[HTMLPLACEHOLDER17]] [[HTMLPLACEHOLDER18]] [[HTMLPLACEHOLDER19]] [[HTMLPLACEHOLDER20]] [[HTMLPLACEHOLDER21]] [[HTMLPLACEHOLDER22]] [[HTMLPLACEHOLDER23]] [[HTMLPLACEHOLDER24]] [[HTMLPLACEHOLDER25]] [[HTMLPLACEHOLDER26]] [[HTMLPLACEHOLDER27]] [[HTMLPLACEHOLDER28]]Завършвайки целия процес, от нуждите на клиента до пускането на кода, може да са минали само 1-2 часа, докато реалното време, което авторът е вложил, може да е само 10 минути.

Три механизма, които правят системата по-умна

Механизъм 1: Подобрена версия на Ralph Loop — не просто повтаряне, а учене

Може би сте чували за Ralph Loop: извличане на контекст от паметта → генериране на изход → оценка на резултата → запазване на наученото.

Но повечето реализации имат един проблем: всеки цикъл използва същия prompt. Наученото подобрява бъдещото извличане, но самият prompt е статичен.

Тази система е различна.

Когато Agent се провали, Zoe не рестартира с един и същ prompt. Тя анализира причините за провала с пълен бизнес контекст и след това пренаписва prompt:

❌ Лош пример (статичен prompt): { "Реализиране на функция за персонализирани шаблони" }

✅ Добър пример (динамична настройка): { "Стоп. Клиентът иска X, а не Y. Това са техните точни думи от срещата: Ние искаме да запазим съществуващата конфигурация, а не да създаваме нова от нулата. Основният акцент е върху повторното използване на конфигурацията, а не върху създаването на нови процеси." }Zoe може да прави тези корекции, защото има контекст, който Agent няма:

- Какво е казал клиентът на срещата

- С какво се занимава компанията

- Защо предишното подобно искане е било неуспешно

- Сутрин: сканира Sentry → открива 4 нови грешки → стартира 4 Agent-а да разследват и поправят

- След срещата: сканира протокола от срещата → открива 3 функционални изисквания, споменати от клиента → стартира 3 Codex

- Вечер: сканира git log → стартира Claude Code да актуализира changelog и клиентската документация

Успешните модели ще бъдат записани:

- "Тази структура на prompt е много ефективна за функцията за фактуриране"

- "Codex трябва да получи типови определения предварително"

- "Винаги трябва да включва пътя до тестовите файлове"

Колкото по-дълго, толкова по-добри стават prompt-ите, написани от Zoe, защото тя помни какво е успешно.

Механизъм 2: Стратегия за избор на Agent — различни задачи, различни експерти

Не всички Agent-и са еднакво силни. Авторът обобщава стратегията за избор:

- Codex(gpt-5.3-codex) — основен агент - задълбочена логика, сложни бъгове, многократна рефакторизация на файлове, задачи, изискващи разсъждения между кодови библиотеки

- Бавен, но задълбочен

- Обхваща 90% от задачите

- Claude Code(claude-opus-4.5) — бърз агент - работа по фронтенд

- По-малко проблеми с разрешенията, подходящ за git операции

- (Авторът го е използвал по-често преди, но след излизането на Codex 5.3 е сменил)

- Gemini — дизайнер - има дизайнерско чувство

- За красив UI, първо Gemini генерира HTML/CSS спецификации, след което ги предава на Claude Code за реализация в компонентната система

- Gemini проектира, Claude строи

Механизъм 3: Къде е瓶颈?RAM

Има неочаквано ограничение: не е цената на токените, не е скоростта на API, а паметта.

Всеки Agent изисква:

- Свой worktree

- Свои nodemodules

- Изпълнение на изграждане, типова проверка, тестове

Максимум 4-5 Agent-а могат да работят едновременно на Mac Mini на автора (16GB RAM), повече и започва да се извършва swap, а трябва да се моли те да не изграждат едновременно.Така че той купи Mac Studio M4 Max (128GB RAM, $3500), който пристигна в края на март. Той каза, че ще сподели дали си струва.[[HTMLPLACEHOLDER_29]]