OpenClaw + Claude Code Tutoriel Puissant : Un seul individu peut construire une équipe de développement complète !

OpenClaw + Claude Code Tutoriel Puissant : Un seul individu peut construire une équipe de développement complète !

Aujourd'hui, je partage un cas pratique très impressionnant. (Le tutoriel est à la fin de l'article)

Un développeur indépendant a utilisé OpenClaw + Codex/CC pour mettre en place un système d'Agent IA. Quel a été le résultat ?

94 soumissions en une journée, 7 PR complétés en 30 minutes, et ce jour-là, il a également eu 3 réunions avec des clients, sans même ouvrir l'éditeur.

C'est un événement réel qui s'est produit en janvier 2026. L'auteur a rendu public l'architecture, le flux de travail et la configuration du code de l'ensemble du système. Après l'avoir lu, j'ai trouvé que cette approche valait vraiment la peine d'être apprise, alors j'ai organisé cet article pour le partager avec vous.

Si vous utilisez également Codex ou Claude Code, ou si vous êtes intéressé par OpenClaw, cet article vous apportera beaucoup d'inspiration.

Un seul individu, 94 soumissions de code en une journée

Commençons par quelques données pour ressentir la puissance de ce système :

- Maximum de 94 soumissions en une journée (moyenne de 50 soumissions par jour)

- 7 PR complétés en 30 minutes

- La vitesse de mise en ligne est si rapide qu'elle permet de "livrer les demandes des clients le jour même"

Et le coût ? 190 $ par mois (Claude 100 $ + Codex 90 $), un débutant peut démarrer avec seulement 20 $.

Vous vous demandez peut-être : est-ce qu'il a simplement empilé une multitude d'outils IA et généré frénétiquement du code inutile ?

Non. L'historique Git de l'auteur ressemble à celui d'une "équipe de développement récemment embauchée", mais en réalité, il n'est qu'une seule personne. Le changement clé est : il est passé de "gérer Claude Code" à "gérer un majordome IA, qui gère ensuite un groupe de Claude Code".

- Avant janvier : écrire du code directement avec Codex ou Claude Code

- Après janvier : utiliser OpenClaw comme couche d'orchestration, pour gérer Codex/Claude Code/Gemini

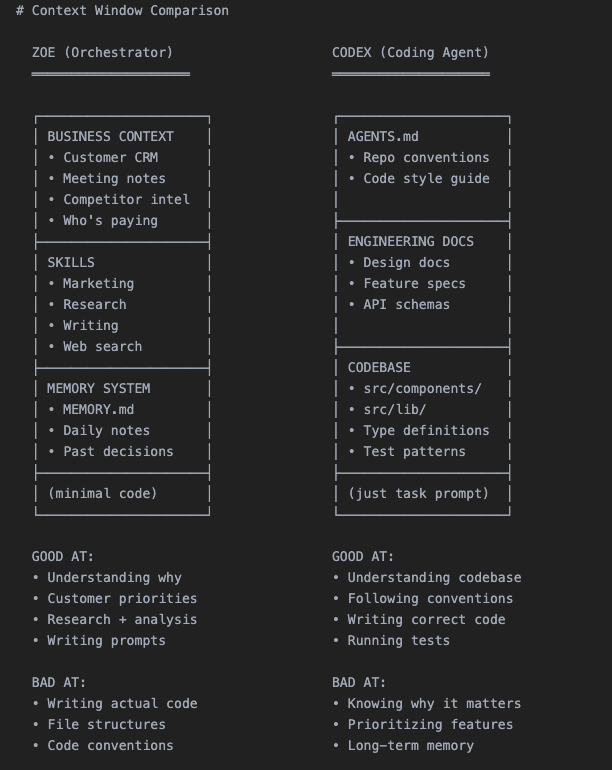

Pourquoi Codex et Claude Code ne suffisent-ils pas lorsqu'ils sont utilisés séparément ?

À ce stade, vous pourriez vous demander : Codex et Claude Code sont déjà très puissants, pourquoi ajouter une couche d'orchestration ?

La réponse de l'auteur est très directe : Codex et Claude Code ne connaissent presque rien de votre entreprise. Ils ne voient que le code, sans comprendre le tableau d'ensemble des affaires.

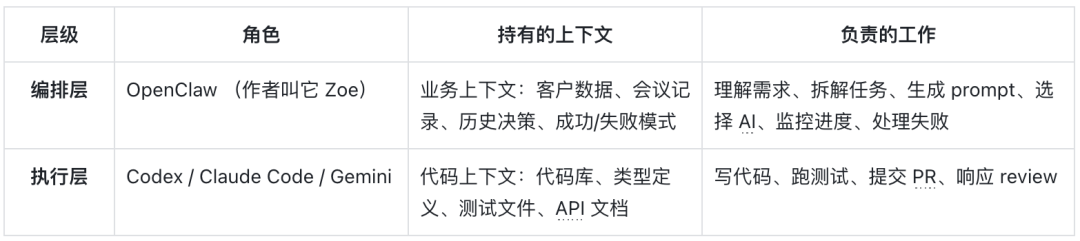

Il y a une limitation fondamentale ici : la fenêtre contextuelle est fixe, vous ne pouvez en choisir qu'une.

Vous devez faire un choix sur ce que vous y mettez :

- Remplir de code → Pas d'espace pour le contexte commercial

- Remplir de l'historique client → Pas d'espace pour la base de code

- Il ne sait pas pour quel client cette fonctionnalité est développée

- Il ne sait pas pourquoi la dernière demande similaire a échoué

- Il ne connaît pas votre positionnement produit et vos principes de conception

- Il ne peut travailler qu'en fonction du code actuel et de votre prompt

Il agit comme une couche d'orchestration, se situant entre vous et tous les outils IA. Son rôle est :

- Détenir tout le contexte commercial (données clients, comptes rendus de réunion, décisions historiques, cas de succès/échec)

- Traduire le contexte commercial en prompts précis, à fournir à des Agents spécifiques

- Permettre à ces Agents de se concentrer sur ce qu'ils font le mieux : écrire du code

- Codex/Claude Code = Chef cuisinier professionnel, se concentre uniquement sur la cuisine

- OpenClaw = Chef de cuisine, connaît les goûts des clients, les stocks d'ingrédients, le positionnement du menu, et donne des instructions précises à chaque cuisinier

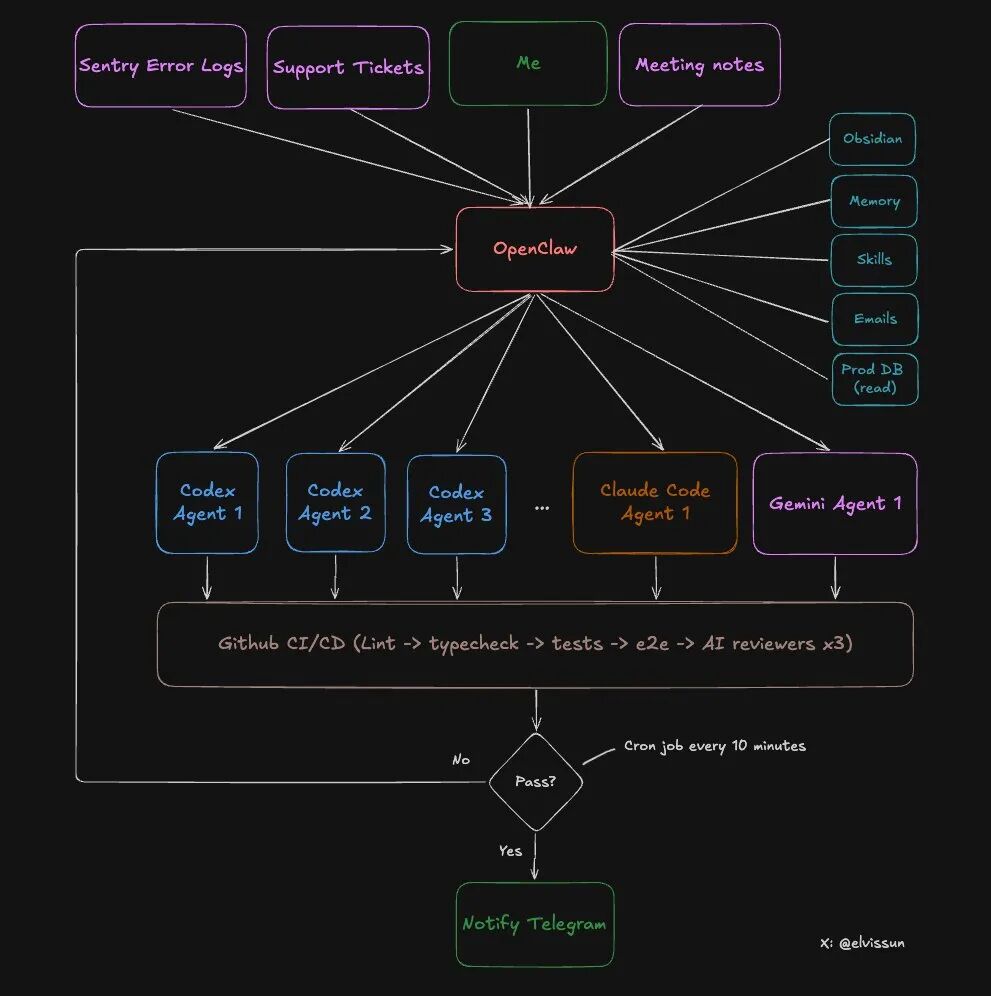

Architecture spécifique du système à double couche : couche d'orchestration + couche d'exécution

Voyons l'architecture spécifique de ce système.

Deux niveaux, chacun avec ses propres responsabilités :

Que peut faire OpenClaw (couche d'orchestration) ?

- Lire tous les comptes rendus de réunion dans les notes Obsidian (synchronisation automatique)

- Accéder à la base de données de production (permissions en lecture seule) pour obtenir la configuration client

- Avoir des permissions API administratives, permettant de recharger directement le client et de lever les blocages

- Choisir le bon agent en fonction du type de tâche

- Surveiller l'avancement de tous les agents, analyser les raisons des échecs et ajuster le prompt pour réessayer

- Notifier l'auteur via Telegram une fois terminé

Que peut faire l'Agent (couche d'exécution) ?

- Lire et écrire dans le dépôt de code

- Exécuter des tests et des constructions

- Soumettre du code et créer des PR

- Répondre aux retours des revues de code

Ce design est intelligent : les frontières de sécurité sont claires, tout en garantissant l'efficacité.

Flux de travail complet : 8 étapes de la demande client à la fusion de la PR

Entrons maintenant dans la partie centrale. Avec un cas réel de l'auteur de la semaine dernière, je vais vous faire traverser le processus complet.

Contexte : un client entreprise a appelé, disant qu'il souhaitait réutiliser leurs paramètres déjà configurés et les partager au sein de l'équipe.

Étape 1 : Demande client → OpenClaw comprend et décompose

Après l'appel, l'auteur et Zoe (son OpenClaw) ont discuté de cette demande.

La magie ici : coût d'explication nul. Parce que tous les comptes rendus de réunion sont automatiquement synchronisés dans Obsidian, Zoe a déjà lu le contenu de l'appel, sait qui est le client, leur scénario commercial et leur configuration existante.

L'auteur et Zoe ont décomposé la demande en : créer un système de modèles permettant aux utilisateurs de sauvegarder et d'éditer la configuration existante.

Ensuite, Zoe a fait trois choses :

- Recharger le client — Utiliser l'API administrateur pour lever immédiatement les restrictions d'utilisation du client

- Récupérer la configuration client — Obtenir les paramètres existants du client à partir de la base de données de production (lecture seule)

- Générer un prompt et démarrer l'agent — Emballer tout le contexte et le fournir à Codex

Étape 2 : Démarrer l'agent

Zoe a créé pour cette tâche :

- Un worktree git indépendant (environnement de branche isolé)

- Une session tmux (permettant à l'Agent de fonctionner en arrière-plan)

# 创建 worktree + 启动代理 git worktree add ../feat-custom-templates -b feat/custom-templates origin/main cd ../feat-custom-templates && pnpm install

tmux new-session -d -s "codex-templates" \ -c "/Users/elvis/Documents/GitHub/medialyst-worktrees/feat-custom-templates" \ "$HOME/.codex-agent/run-agent.sh templates gpt-5.3-codex high Pourquoi utiliser tmux ? Parce que cela permet d'intervenir en cours de route.

Si l'IA s'égare, il n'est pas nécessaire de tout arrêter et de recommencer, il suffit d'envoyer des instructions directement dans tmux :

# 代理方向错了 tmux send-keys -t codex-templates "停一下。先做 API 层,别管 UI。" Enter

代理需要更多上下文

tmux send-keys -t codex-templates "类型定义在 src/types/template.ts,用那个。" Enter En même temps, la tâche sera enregistrée dans un fichier JSON.[[HTMLPLACEHOLDER0]]

[[HTMLPLACEHOLDER1]]

[[HTMLPLACEHOLDER2]]

[[HTMLPLACEHOLDER3]]

[[HTMLPLACEHOLDER4]]

[[HTMLPLACEHOLDER5]]

[[HTMLPLACEHOLDER6]]

[[HTMLPLACEHOLDER7]]

[[HTMLPLACEHOLDER8]]

[[HTMLPLACEHOLDER9]]

[[HTMLPLACEHOLDER10]]

[[HTMLPLACEHOLDER11]]

[[HTMLPLACEHOLDER12]]

[[HTMLPLACEHOLDER13]]

[[HTMLPLACEHOLDER14]]

[[HTMLPLACEHOLDER15]]

[[HTMLPLACEHOLDER16]]

[[HTMLPLACEHOLDER17]]

[[HTMLPLACEHOLDER18]]

[[HTMLPLACEHOLDER19]]

[[HTMLPLACEHOLDER20]]

[[HTMLPLACEHOLDER21]]

[[HTMLPLACEHOLDER22]]

[[HTMLPLACEHOLDER23]]

[[HTMLPLACEHOLDER24]]

[[HTMLPLACEHOLDER25]]

[[HTMLPLACEHOLDER26]]Le processus complet, de la demande du client au déploiement du code, peut ne prendre que 1 à 2 heures, alors que l'investissement réel de l'auteur peut n'être que de 10 minutes.

Trois mécanismes pour rendre le système plus intelligent

Mécanisme 1 : Version améliorée de Ralph Loop — Pas seulement répéter, mais apprendre

Vous avez peut-être entendu parler de Ralph Loop : tirer le contexte de la mémoire → générer une sortie → évaluer le résultat → sauvegarder l'apprentissage.

Mais la plupart des implémentations ont un problème : le prompt utilisé à chaque boucle est le même. Ce qui est appris améliore la récupération future, mais le prompt lui-même est statique.

Ce système est différent.

Lorsque l'Agent échoue, Zoe ne redémarre pas avec le même prompt. Elle analyse la raison de l'échec avec le contexte commercial complet, puis réécrit le prompt :

❌ Mauvais exemple (prompt statique) : { "Implémenter une fonctionnalité de modèle personnalisé" }

✅ Bon exemple (ajustement dynamique) : { "Stop. Le client veut X, pas Y. Voici leurs mots lors de la réunion : Nous souhaitons conserver la configuration existante, plutôt que de créer une nouvelle depuis le début. L'accent doit être mis sur la réutilisation de la configuration, pas sur la création de nouveaux processus." }Zoe peut faire ce genre d'ajustement parce qu'elle a un contexte que l'Agent n'a pas :

- Ce que le client a dit lors de la réunion

- Ce que fait cette entreprise

- Pourquoi une demande similaire a échoué la dernière fois

- Le matin : scanner Sentry → découvrir 4 nouvelles erreurs → lancer 4 Agents pour enquêter et corriger

- Après la réunion : scanner les comptes rendus → découvrir 3 fonctionnalités mentionnées par les clients → lancer 3 Codex

- Le soir : scanner le git log → lancer Claude Code pour mettre à jour le changelog et la documentation client

Les modèles de succès seront enregistrés :

- "Cette structure de prompt est très efficace pour la fonctionnalité de facturation"

- "Codex a besoin d'obtenir les définitions de type à l'avance"

- "Il faut toujours inclure le chemin du fichier de test"

Plus le temps passe, meilleur est le prompt écrit par Zoe, car elle se souvient de ce qui peut réussir.

Mécanisme 2 : Stratégie de sélection d'Agent — Trouver des experts pour différentes tâches

Tous les Agents ne sont pas également puissants. Voici la stratégie de sélection résumée par l'auteur :

- Codex(gpt-5.3-codex) — Principal - Logique backend, bugs complexes, refactorisation multi-fichiers, tâches nécessitant un raisonnement à travers plusieurs dépôts de code

- Lent mais complet

- Représente 90 % des tâches

- Claude Code(claude-opus-4.5) — Candidat rapide - Travail frontend

- Moins de problèmes de permissions, adapté aux opérations git

- (L'auteur l'utilisait plus souvent auparavant, mais a changé après la sortie de Codex 5.3)

- Gemini — Designer - A un sens esthétique

- Pour une UI élégante, laissez d'abord Gemini générer les spécifications HTML/CSS, puis confiez-les à Claude Code pour les mettre en œuvre dans le système de composants

- Gemini conçoit, Claude construit

Mécanisme 3 : Où est le goulot d'étranglement ? RAM

Il y a une limitation inattendue : ce n'est pas le coût des tokens, ce n'est pas le taux d'API, mais la mémoire.

Chaque Agent a besoin de :

- Son propre worktree

- Ses propres nodemodules

- Exécuter des constructions, des vérifications de type, des tests

Le Mac Mini de l'auteur (16 Go de RAM) peut faire fonctionner au maximum 4-5 Agents en même temps, au-delà, il commence à swapper, et il faut prier pour qu'ils ne construisent pas en même temps.Donc, il a acheté un Mac Studio M4 Max (128 Go de RAM, 3500 $), qui arrivera fin mars. Il a dit qu'il partagerait alors s'il en valait la peine.

Vous pouvez aussi le construire : de zéro à opérationnel en seulement 10 minutes

Vous voulez essayer ce système ?

La méthode la plus simple :

Copiez cet article entier dans OpenClaw et dites-lui : "Implémentez un système de cluster Agent pour ma base de code selon cette architecture."

Ensuite, il va :

- Lire la conception de l'architecture

- Créer des scripts

- Configurer la structure des répertoires

- Configurer la surveillance cron

Vous devez préparer :

- Un compte OpenClaw

- Accès API à Codex et/ou Claude Code

- Un dépôt git

- (optionnel) Obsidian pour stocker le contexte commercial

2026 : une entreprise d'un million de dollars pour une personne

L'auteur a dit quelque chose à la fin qui m'a semblé très inspirant :

"Nous verrons de nombreuses entreprises d'un million de dollars pour une personne apparaître à partir de 2026. Le levier est énorme, appartenant à ceux qui comprennent comment construire des systèmes d'IA d'auto-amélioration récursive."

C'est à quoi cela ressemble :

- Un orchestrateur IA comme votre extension (comme Zoe pour l'auteur)

- Déléguer le travail à des Agents spécialisés, traitant différentes fonctions commerciales

- Ingénierie, support client, opérations, marketing

- Chaque Agent se concentre sur ce qu'il fait le mieux

- Vous restez concentré et en contrôle total

Il y a trop de contenu généré par IA de mauvaise qualité. Diverses exagérations, divers démos flashy de "centres de contrôle de tâches", mais rien de vraiment utile.

L'auteur dit qu'il veut faire le contraire : moins d'exagération, plus de documentation du processus de construction réel. Des clients réels, des revenus réels, des soumissions réelles mises en production, et aussi de réels échecs.

Cet article s'arrête ici.

Récapitulatif des points clés :

- Architecture à double couche : la couche d'orchestration détient le contexte commercial, la couche d'exécution se concentre sur le code

- Automatisation complète : un processus en 8 étapes de la demande à la PR, la plupart des tâches réussies du premier coup

- Apprentissage dynamique : pas d'exécution répétée, mais ajustement de la stratégie en fonction des raisons d'échec

- Coûts maîtrisables : à partir de 20 $/mois, utilisation intensive 190 $/mois

Adresse de référence :[[HTMLPLACEHOLDER_27]]