OpenClaw + Claude Code 超强教程:一个人就能搭建完整的开发团队!

OpenClaw + Claude Code 超强教程:一个人就能搭建完整的开发团队!

Dziś dzielę się niesamowitym przypadkiem praktycznym. (Na końcu artykułu znajduje się poradnik)

Niezależny deweloper stworzył system AI Agent z użyciem OpenClaw + Codex/CC. Jakie efekty osiągnął?

94 zgłoszenia w jeden dzień, 7 PR w 30 minut, a w tym dniu odbył również 3 spotkania z klientami, nie otwierając nawet edytora.

To wydarzyło się naprawdę w styczniu 2026 roku. Autor ujawnił całą architekturę systemu, workflow i konfigurację kodu. Po zapoznaniu się z tym, uznałem, że ten pomysł jest wart nauki, więc zebrałem to w ten artykuł, aby się z Tobą podzielić.

Jeśli również korzystasz z Codex lub Claude Code, lub jesteś zainteresowany OpenClaw, ten artykuł dostarczy Ci wielu inspiracji.

Jedna osoba, 94 zgłoszenia kodu w jeden dzień

Najpierw przyjrzyjmy się kilku danym, aby poczuć moc tego systemu:

- Maksymalnie 94 zgłoszenia w jeden dzień (średnio 50 zgłoszeń dziennie)

- 7 PR w 30 minut

- Szybkość od pomysłu do wdrożenia tak szybka, że można "dostarczyć wymagania klienta tego samego dnia"

A jakie są koszty? 190 dolarów miesięcznie (Claude 100 dolarów + Codex 90 dolarów), początkujący może zacząć od 20 dolarów.

Możesz zapytać: czy to tylko zbiór narzędzi AI, które generują śmieciowy kod?

Nie. Historia Git autora wygląda jakby "właśnie zatrudnił zespół deweloperski", ale w rzeczywistości jest tylko jedna osoba. Kluczowa zmiana polega na tym, że przeszedł od "zarządzania Claude Code" do "zarządzania AI asystentem, który zarządza grupą Claude Code".

- Przed styczniem: bezpośrednio używał Codex lub Claude Code do pisania kodu

- Po styczniu: używa OpenClaw jako warstwy orkiestracyjnej, aby zarządzać Codex/Claude Code/Gemini

Dlaczego Codex i Claude Code osobno nie są wystarczające?

W tym momencie możesz pomyśleć: Codex i Claude Code są już bardzo silne, dlaczego potrzebna jest dodatkowa warstwa orkiestracji?

Odpowiedź autora jest bardzo prosta: Codex i Claude Code prawie nic nie wiedzą o Twoim biznesie. Widzą tylko kod, nie widzą pełnego obrazu biznesowego.

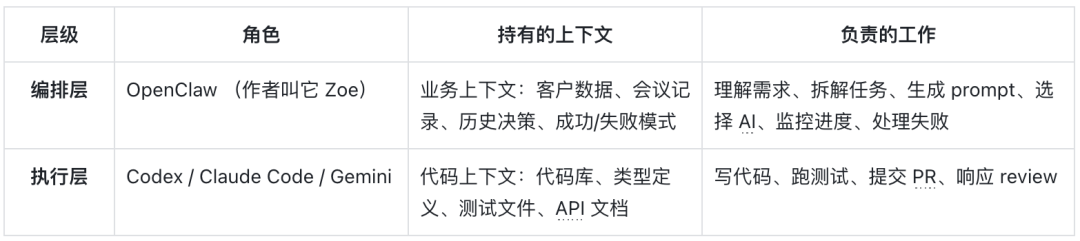

Istnieje tu fundamentalne ograniczenie: okno kontekstowe jest stałe, możesz wybrać tylko jedno.

Musisz zdecydować, co włożyć:

- Wypełnić kodem → brak miejsca na kontekst biznesowy

- Wypełnić historią klientów → brak miejsca na repozytorium kodu

- Nie wie, dla którego klienta ta funkcjonalność jest tworzona

- Nie wie, dlaczego ostatnie podobne wymaganie się nie powiodło

- Nie wie, jakie są Twoje pozycjonowanie produktu i zasady projektowania

- Może pracować tylko na podstawie aktualnego kodu i Twojego promptu

Działa jako warstwa orkiestracyjna, znajdując się pomiędzy Tobą a wszystkimi narzędziami AI. Jego rola to:

- Posiadanie całego kontekstu biznesowego (dane klientów, notatki ze spotkań, decyzje historyczne, przypadki sukcesu/porażki)

- Tłumaczenie kontekstu biznesowego na precyzyjne prompt, które są przekazywane konkretnym agentom

- Umożliwienie tym agentom skupienia się na tym, co robią najlepiej: pisaniu kodu

- Codex/Claude Code = profesjonalny kucharz, który tylko gotuje

- OpenClaw = szef kuchni, który zna gusta klientów, zapasy składników, pozycjonowanie menu, wydaje precyzyjne polecenia każdemu kucharzowi

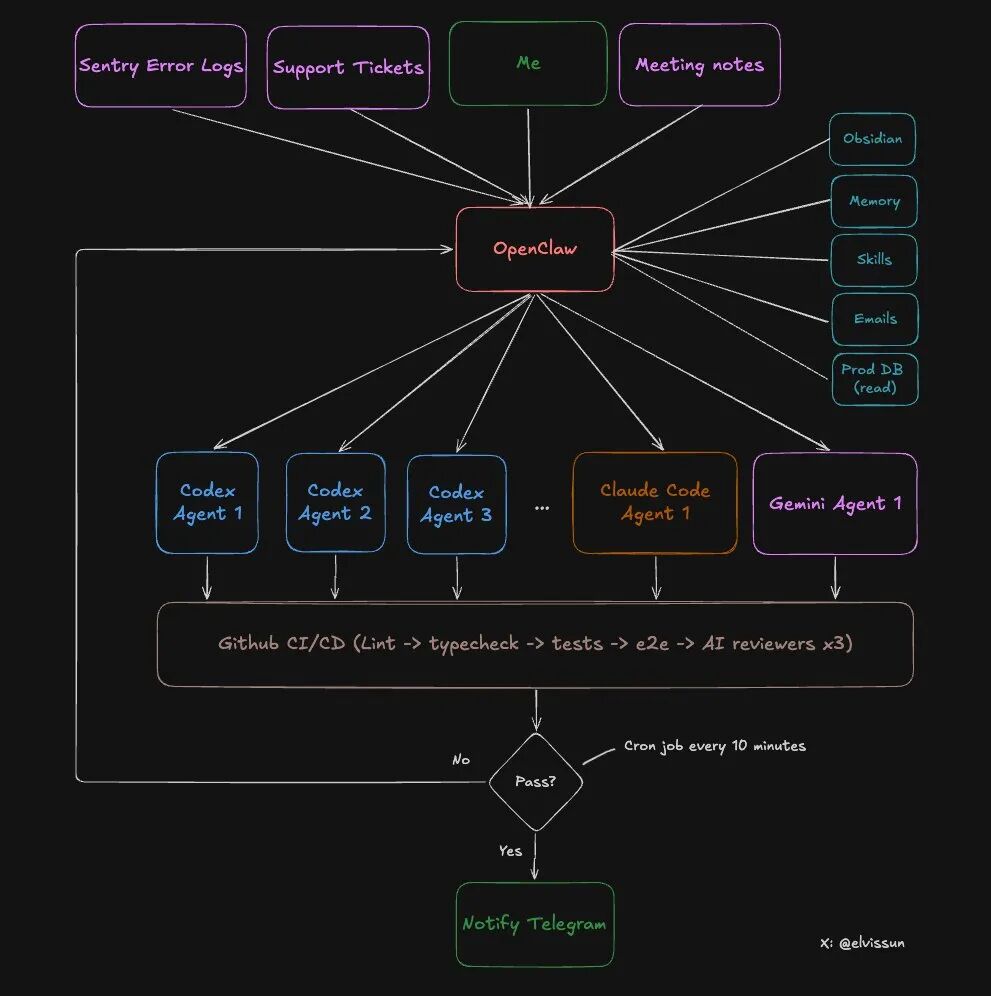

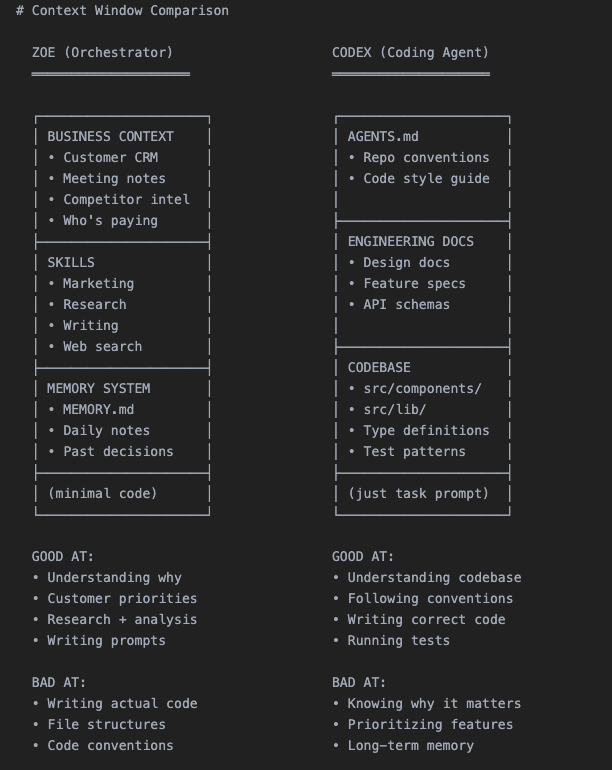

Konkretna architektura systemu dwuwarstwowego: warstwa orkiestracyjna + warstwa wykonawcza

Przyjrzyjmy się konkretnej architekturze tego systemu.

Dwie warstwy, każda z własnymi zadaniami:

Co może zrobić OpenClaw (warstwa orkiestracji)?

- Odczytać wszystkie protokoły spotkań z notatek Obsidian (automatyczna synchronizacja)

- Uzyskać dostęp do bazy danych produkcyjnej (tylko do odczytu) w celu uzyskania konfiguracji klienta

- Posiada uprawnienia API administratora, może bezpośrednio doładować klienta i usunąć blokady

- Wybiera odpowiedniego agenta w zależności od typu zadania

- Monitorować postęp wszystkich agentów, w przypadku niepowodzenia analizować przyczyny i dostosować prompt do ponownego uruchomienia

- Po zakończeniu powiadomić autora przez Telegram

Co może zrobić Agent (warstwa wykonawcza)?

- Odczytywać i zapisywać w repozytorium kodu

- Uruchamiać testy i budować

- Składać kod i tworzyć PR

- Odpowiadać na uwagi dotyczące przeglądu kodu

Ten projekt jest sprytny: granice bezpieczeństwa są jasne, a jednocześnie zapewniają efektywność.

Pełny przepływ pracy: 8 kroków od wymagań klienta do scalania PR

Teraz przechodzimy do kluczowej części. Użyjemy prawdziwego przypadku autora z zeszłego tygodnia, aby przeprowadzić Cię przez pełny proces.

Tło: Klient biznesowy zadzwonił, mówiąc, że chciałby ponownie wykorzystać swoje już skonfigurowane ustawienia i udostępnić je w zespole.

Krok 1: Wymagania klienta → OpenClaw rozumie i dzieli

Po zakończeniu rozmowy autor porozmawiał z Zoe (jego OpenClaw) o tym wymaganiu.

Cudowna rzecz: zerowy koszt wyjaśnienia. Ponieważ wszystkie protokoły spotkań są automatycznie synchronizowane z Obsidian, Zoe już przeczytała treść rozmowy, wie, kim jest klient, jaki jest ich scenariusz biznesowy i jakie mają obecne ustawienia.

Autor i Zoe razem podzielili wymagania na: stworzenie systemu szablonów, który pozwoli użytkownikom zapisywać i edytować istniejące konfiguracje.

Następnie Zoe wykonała trzy rzeczy:

- Doładowała klienta — natychmiast usunęła ograniczenia korzystania z API administratora

- Pobranie konfiguracji klienta — uzyskała istniejące ustawienia klienta z bazy danych produkcyjnej (tylko do odczytu)

- Wygenerowała prompt i uruchomiła agenta — spakowała cały kontekst i przekazała go do Codex

Krok 2: Uruchomienie agenta

Zoe stworzyła dla tego zadania:

- Oddzielne git worktree (izolowane środowisko gałęzi)

- Sesję tmux (aby Agent mógł działać w tle)

# 创建 worktree + 启动代理 git worktree add ../feat-custom-templates -b feat/custom-templates origin/main cd ../feat-custom-templates && pnpm install

tmux new-session -d -s "codex-templates" \ -c "/Users/elvis/Documents/GitHub/medialyst-worktrees/feat-custom-templates" \ "$HOME/.codex-agent/run-agent.sh templates gpt-5.3-codex high Dlaczego używamy tmux? Ponieważ można wprowadzić interwencję w trakcie.

Jeśli AI zboczy z kursu, nie trzeba zabijać i zaczynać od nowa, wystarczy wydać polecenia w tmux:

# 代理方向错了 tmux send-keys -t codex-templates "停一下。先做 API 层,别管 UI。" Enter

代理需要更多上下文

tmux send-keys -t codex-templates "类型定义在 src/types/template.ts,用那个。" Enter Jednocześnie zadanie będzie rejestrowane w pliku JSON:[[HTMLPLACEHOLDER0]] [[HTMLPLACEHOLDER1]] [[HTMLPLACEHOLDER2]] [[HTMLPLACEHOLDER3]] [[HTMLPLACEHOLDER4]] [[HTMLPLACEHOLDER5]] [[HTMLPLACEHOLDER6]] [[HTMLPLACEHOLDER7]] [[HTMLPLACEHOLDER8]] [[HTMLPLACEHOLDER9]] [[HTMLPLACEHOLDER10]] [[HTMLPLACEHOLDER11]] [[HTMLPLACEHOLDER12]] [[HTMLPLACEHOLDER13]] [[HTMLPLACEHOLDER14]] [[HTMLPLACEHOLDER15]] [[HTMLPLACEHOLDER16]] [[HTMLPLACEHOLDER17]] [[HTMLPLACEHOLDER18]] [[HTMLPLACEHOLDER19]] [[HTMLPLACEHOLDER20]] [[HTMLPLACEHOLDER21]] [[HTMLPLACEHOLDER22]] [[HTMLPLACEHOLDER23]][[HTMLPLACEHOLDER24]] [[HTMLPLACEHOLDER25]] [[HTMLPLACEHOLDER26]] [[HTMLPLACEHOLDER27]] [[HTMLPLACEHOLDER28]]Pełny proces od potrzeb klienta do wdrożenia kodu może zająć tylko 1-2 godziny, podczas gdy rzeczywisty wkład autora może wynosić tylko 10 minut.

Trzy mechanizmy, które czynią system mądrzejszym

Mechanizm 1: Ulepszona pętla Ralph — nie tylko powtarzanie, ale uczenie się

Możesz słyszeć o pętli Ralph: pobieranie kontekstu z pamięci → generowanie wyjścia → ocena wyników → zapisywanie nauki.

Jednak większość implementacji ma jeden problem: każdy cykl używa tego samego promptu. To, co zostało nauczone, poprawia przyszłe wyszukiwanie, ale sam prompt jest statyczny.

Ten system jest inny.

Kiedy Agent zawodzi, Zoe nie restartuje z tym samym promptem. Ona analizuje przyczyny niepowodzenia, mając pełen kontekst biznesowy, a następnie przepisuje prompt:

❌ Zły przykład (statyczny prompt): { "Zrealizuj funkcję szablonów niestandardowych" }

✅ Dobry przykład (dynamiczna regulacja): { "Stop. Klient chce X, a nie Y. Oto ich dokładne słowa z spotkania: Chcemy zachować istniejącą konfigurację, a nie tworzyć nową od podstaw. Skup się na ponownym użyciu konfiguracji, nie na tworzeniu nowego procesu." }Zoe może dokonać takiej regulacji, ponieważ ma kontekst, którego Agent nie ma:

- Co klient powiedział na spotkaniu

- Czym zajmuje się ta firma

- Dlaczego podobne potrzeby w przeszłości zawiodły

- Rano: skanowanie Sentry → odkrycie 4 nowych błędów → uruchomienie 4 Agentów do badania i naprawy

- Po spotkaniu: skanowanie notatek ze spotkania → odkrycie 3 funkcjonalności wspomnianych przez klientów → uruchomienie 3 Codexów

- Wieczorem: skanowanie logów git → uruchomienie Claude Code do aktualizacji changelogu i dokumentacji dla klientów

Skuteczne wzorce są zapisywane:

- "Ta struktura promptu jest bardzo skuteczna dla funkcji fakturowania"

- "Codex musi otrzymać definicje typów z wyprzedzeniem"

- "Zawsze należy uwzględniać ścieżki do plików testowych"

Im dłużej, tym lepsze promptu pisze Zoe, ponieważ pamięta, co może odnieść sukces.

Mechanizm 2: Strategia wyboru Agenta — różni eksperci do różnych zadań

Nie wszyscy Agenci są równie silni. Autor podsumował strategię wyboru:

- Codex(gpt-5.3-codex) — główny gracz - logika backendu, złożone błędy, refaktoryzacja wielu plików, zadania wymagające wnioskowania między repozytoriami kodu

- Wolny, ale dokładny

- Stanowi 90% zadań

- Claude Code(claude-opus-4.5) — zawodnik szybkościowy - prace frontendowe

- Mało problemów z uprawnieniami, odpowiedni do operacji git

- (Autor wcześniej częściej go używał, ale po wydaniu Codex 5.3 przeszedł na niego)

- Gemini — projektant - ma estetykę projektowania

- Dla ładnego UI, najpierw pozwól Gemini wygenerować specyfikację HTML/CSS, a następnie przekaż Claude Code do realizacji w systemie komponentów

- Gemini projektuje, Claude buduje

Mechanizm 3: Gdzie jest wąskie gardło? RAM

Jest tu niespodziewane ograniczenie: nie koszt tokenów, nie szybkość API, ale pamięć.

Każdy Agent potrzebuje:

- Własnego worktree

- Własnych nodemodules

- Uruchamiania budowy, sprawdzania typów, testów

Autorowy Mac Mini (16 GB RAM) może jednocześnie uruchomić maksymalnie 4-5 Agentów, więcej i zaczyna się swap, a trzeba się modlić, żeby nie budowały się jednocześnie.Więc kupił Mac Studio M4 Max (128GB RAM, 3500 dolarów), który dotarł pod koniec marca. Powiedział, że wtedy podzieli się, czy to się opłaca.

Możesz to zbudować: od zera do działania w 10 minut

Chcesz spróbować tego systemu?

Najprostszy sposób:

Skopiuj cały ten artykuł do OpenClaw i powiedz mu: "Na podstawie tej architektury, zaimplementuj dla mojej bazy kodu system klastra Agentów."

A potem on:

- Przeczyta projekt architektury

- Stworzy skrypty

- Ustawi strukturę katalogów

- Skonfiguruje monitorowanie cron

Musisz przygotować:

- Konto OpenClaw

- Dostęp do API Codex i/lub Claude Code

- Repozytorium git

- (opcjonalnie) Obsidian do przechowywania kontekstu biznesowego

2026: milionowa firma jednej osoby

Autor na końcu napisał zdanie, które uważam za bardzo inspirujące:

"Zobaczymy wiele milionowych firm jednej osoby, które pojawią się od 2026 roku. Dźwignia jest ogromna, należy do tych, którzy rozumieją, jak budować systemy AI do samodoskonalenia."

To wygląda tak:

- AI jako koordynator jako twoje przedłużenie (jak Zoe dla autora)

- Delegowanie pracy do wyspecjalizowanych Agentów, którzy zajmują się różnymi funkcjami biznesowymi

- Inżynieria, wsparcie klienta, operacje, marketing

- Każdy Agent koncentruje się na tym, w czym jest najlepszy

- Ty pozostajesz skoncentrowany i masz pełną kontrolę

Teraz jest zbyt wiele śmieciowych treści generowanych przez AI. Różne hype, różne efektowne dema "centrum kontroli zadań", ale bez naprawdę użytecznych rzeczy.

Autor mówi, że chce robić odwrotnie: mniej hype'u, więcej dokumentowania prawdziwego procesu budowy. Prawdziwi klienci, prawdziwe przychody, prawdziwe wdrożenia do środowiska produkcyjnego, a także prawdziwe porażki.

To wszystko na teraz.

Podsumowanie kluczowych punktów:

- Dwuwarstwowa architektura: warstwa orkiestracji posiada kontekst biznesowy, warstwa wykonawcza koncentruje się na kodzie

- Pełna automatyzacja: 8 krokowy proces od wymagań do PR, większość zadań udaje się za pierwszym razem

- Dynamiczne uczenie się: nie powtarzanie, ale dostosowywanie strategii w oparciu o przyczyny porażek

- Koszty pod kontrolą: start od 20 dolarów/miesiąc, intensywne użycie 190 dolarów/miesiąc

Adres referencyjny:[[HTMLPLACEHOLDER_29]]