Qwen 3.5 Udgivet: 397B Parametre Åben Vægtmodel, Omkostningerne Reduceret med 60%

Alibaba har netop udgivet Qwen 3.5-397B-A17B. Dette er den første åben vægtmodel i Qwen 3.5-serien.

Kerne Data

- Samlede parametre: 397B

- Aktiverede parametre: 17B per pass (spars MoE)

- Gennemstrømning: 8.6x-19x højere end Qwen 3-Max

- Omkostninger: 60% lavere end Qwen 3

- Sprogunderstøttelse: 201 sprog (udvidet fra 119 sprog)

Dette er ikke bare simpel parameterstabling. Dette er en omdefinering af effektivitet.

Arkitektonisk Innovation

Qwen 3.5 bruger en hybrid arkitektur:

- Gated Delta Networks + spars MoE

- Hybrid lineær opmærksomhed: De fleste lag bruger lineær opmærksomhed, hver 4. lag bruger fuld opmærksomhed

- Indfødt multimodal: Ikke tilføjet senere, men trænet fra bunden

Der er teknisk analyse på X:

"Qwen3.5-397B-A17B: Hybrid linear attention + sparse MoE with large-scale RL environment scaling." — @Alibaba_Qwen

Betydningen af denne arkitektur er: at opnå ydeevne tæt på en 400B model med 17B aktiverede parametre. Udledningsomkostningerne er reduceret betydeligt.

Ydelsespåstande

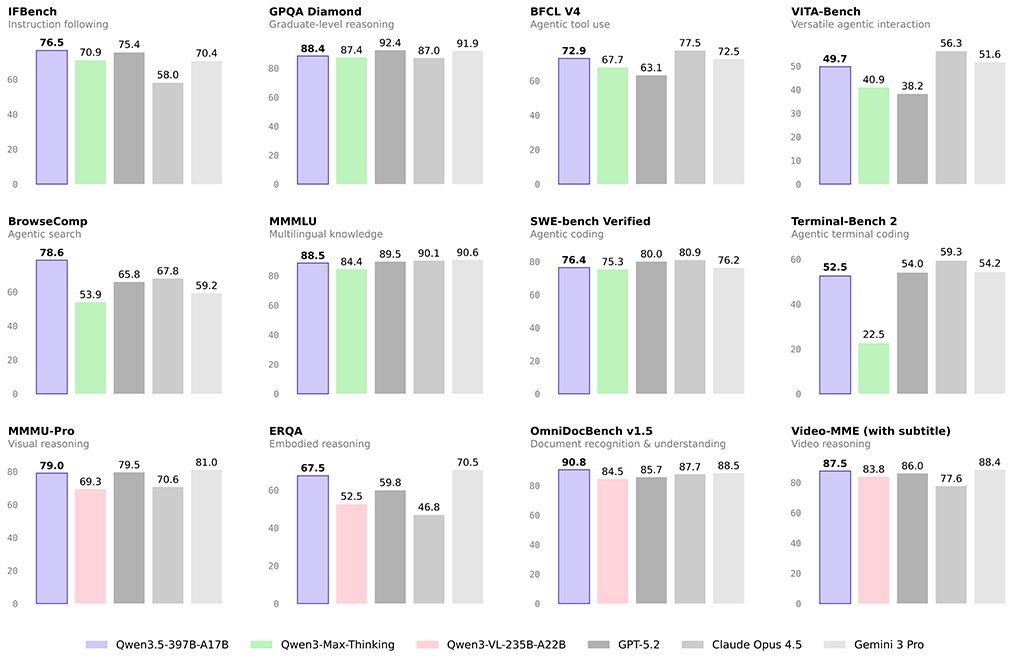

Alibaba hævder, at Qwen 3.5 slår:

- GPT-5.2

- Claude Opus 4.5

- Gemini 3 Pro

Uafhængige testere på X er begyndt at validere:

"Qwen 3.5-397B dropped today... and the benchmarks are insane. Trading blows with Claude Opus 4.5 and GPT-5.2 across the board." — @antonpme

Men det mest afgørende er ikke benchmark-testene, men agent-kapaciteten:

"The agentic capabilities are the real story here. Qwen 3.5 can interact with GUIs, not just understand them. That's the unlock for workflows that touch existing software." — @thebuildrweekly

Agent-æraen

Qwen 3.5's positionering er klar: designet til agent-æraen.

- Kan analysere 2 timers video

- Kan selvstændigt udføre opgaver på tværs af applikationer

- Kan forstå GUI og interagere med den

"Qwen 3.5 can independently take actions across apps." — @thebuildrweekly

Dette betyder, at det ikke er en "chatbot", men en "opgaveudfører".

Konkurrencelandskab

Nogen på X opsummerede denne uges AI-udgivelser:

"This might be the single biggest week in AI history: DeepSeek V4, Gemini 3.1 Pro, GPT-5.3, Qwen 3.5, Claude Sonnet 5." — @HeyAbhishek

Rytmen for kinesiske modelproducenter er klar:

- DeepSeek V4

- Qwen 3.5

- GLM 5

- MiniMax 2.5

Der kommer nye modeller hver uge, og hver gang hævder de at slå GPT. Dette er ikke markedsføring, det er en eskalering af omkostningskrigen.

Omkostningsstruktur

Qwen 3.5's token-pris er kun 1/18 af Gemini 3 Pro.

"Qwen 3.5 with performance comparable to Gemini 3, and a token price of only 1/18 of the latter." — @dyz_ob

Når ydeevnen er tæt på, og omkostningerne kun er 5%, hvor er så den lukkede kildemodels voldgrav?

Bundlinje

Qwen 3.5 er ikke "Kinas GPT". Det er en forstyrrer af omkostningsstrukturen:

- 397B parametre, men kun 17B aktiveret

- Åben vægt, kan implementeres lokalt

- Agent-kapacitet, ikke kun dialog

- Omkostninger er kun 5% af konkurrenterne

Der er en interessant forudsigelse på X:

"Qwen 3.5 Q4 版本只需要 225G,很有实用价值" — @janxin

225GB videohukommelse, kan køre på en enkelt maskine. Dette betyder, at små og mellemstore udviklere for første gang kan få adgang til en model, der er tæt på GPT-5 niveau.

Det virkelige spørgsmål er ikke, om Qwen 3.5 kan slå GPT-5.3, men: hvordan tjener AI-virksomheder penge, når omkostningerne ved topmodeller falder til næsten nul?