Qwen 3.5 Veröffentlicht: Open-Weight-Modell mit 397B Parametern, 60% Kostenreduktion

Alibaba hat gerade Qwen 3.5-397B-A17B veröffentlicht. Dies ist das erste Open-Weight-Modell der Qwen 3.5-Serie.

Kerndaten

- Gesamtparameter: 397B

- Aktive Parameter: 17B per Pass (Sparse MoE)

- Durchsatz: 8.6x-19x höher als Qwen 3-Max

- Kosten: 60% niedriger als Qwen 3

- Sprachunterstützung: 201 Sprachen (erweitert von 119)

Dies ist keine einfache Parameterstapelung. Dies ist eine Neudefinition von Effizienz.

Architektonische Innovation

Qwen 3.5 verwendet eine Hybridarchitektur:

- Gated Delta Networks + Sparse MoE

- Hybride lineare Aufmerksamkeit: Die meisten Schichten verwenden lineare Aufmerksamkeit, jede 4. Schicht verwendet volle Aufmerksamkeit

- Native Multimodalität: Nicht nachträglich hinzugefügt, sondern von Grund auf trainiert

Auf X gibt es eine technische Analyse:

"Qwen3.5-397B-A17B: Hybrid linear attention + sparse MoE with large-scale RL environment scaling." — @Alibaba_Qwen

Die Bedeutung dieser Architektur liegt darin: Mit 17B aktiven Parametern eine Leistung zu erzielen, die sich einem 400B-Modell annähert. Die Inferenzkosten sinken erheblich.

Leistungsbehauptungen

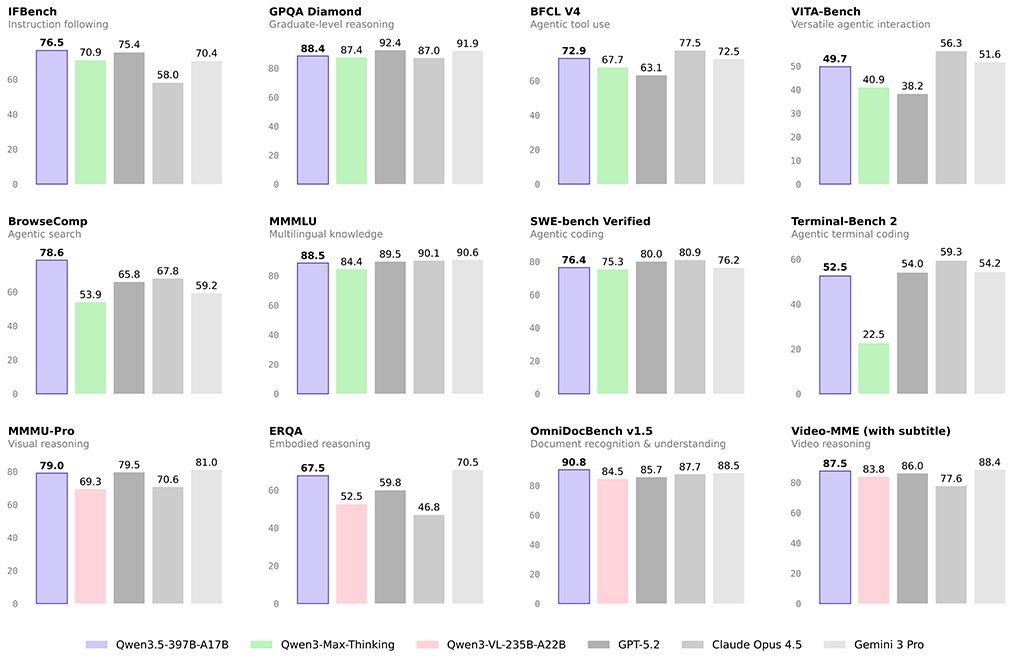

Alibaba behauptet, dass Qwen 3.5 Folgendes übertrifft:

- GPT-5.2

- Claude Opus 4.5

- Gemini 3 Pro

Unabhängige Tester auf X beginnen mit der Validierung:

"Qwen 3.5-397B dropped today... and the benchmarks are insane. Trading blows with Claude Opus 4.5 and GPT-5.2 across the board." — @antonpme

Aber das Wichtigste sind nicht die Benchmarks, sondern die Agentenfähigkeiten:

"The agentic capabilities are the real story here. Qwen 3.5 can interact with GUIs, not just understand them. That's the unlock for workflows that touch existing software." — @thebuildrweekly

Agenten-Ära

Die Positionierung von Qwen 3.5 ist klar: Entwickelt für die Agenten-Ära.

- Kann 2 Stunden Video analysieren

- Kann unabhängig anwendungsübergreifende Aufgaben ausführen

- Kann GUIs verstehen und mit ihnen interagieren

"Qwen 3.5 can independently take actions across apps." — @thebuildrweekly

Das bedeutet, dass es kein "Chatbot", sondern ein "Aufgabenausführer" ist.

Wettbewerbslandschaft

Jemand auf X hat die KI-Veröffentlichungen dieser Woche zusammengefasst:

"This might be the single biggest week in AI history: DeepSeek V4, Gemini 3.1 Pro, GPT-5.3, Qwen 3.5, Claude Sonnet 5." — @HeyAbhishek

Der Rhythmus der chinesischen Modellhersteller ist klar:

- DeepSeek V4

- Qwen 3.5

- GLM 5

- MiniMax 2.5

Jede Woche gibt es ein neues Modell, und jedes Mal wird behauptet, GPT zu schlagen. Das ist kein Marketing, das ist eine Eskalation des Kostenkriegs.

Kostenstruktur

Der Token-Preis von Qwen 3.5 beträgt nur 1/18 des Preises von Gemini 3 Pro.

"Qwen 3.5 with performance comparable to Gemini 3, and a token price of only 1/18 of the latter." — @dyz_ob

Wenn die Leistung ähnlich ist und die Kosten nur 5% betragen, wo liegt dann der Burggraben von Closed-Source-Modellen?

Fazit

Qwen 3.5 ist kein "chinesisches GPT". Es ist ein Disruptor der Kostenstruktur:

- 397B Parameter, aber nur 17B aktiviert

- Open Weight, lokal bereitstellbar

- Agentenfähigkeiten, nicht nur Dialog

- Kosten nur 5% der Konkurrenz

Auf X gibt es eine interessante Vorhersage:

"Qwen 3.5 Q4 版本只需要 225G,很有实用价值" — @janxin

225 GB Grafikspeicher, kann auf einem einzelnen Rechner laufen. Das bedeutet, dass kleine und mittlere Entwickler zum ersten Mal Zugang zu einem Modell erhalten, das sich GPT-5 nähert.

Die eigentliche Frage ist nicht, ob Qwen 3.5 GPT-5.3 schlagen kann, sondern: Wie verdienen KI-Unternehmen Geld, wenn die Kosten für Top-Modelle auf nahezu Null sinken?