Qwen 3.5 Lanzado: Modelo de Peso Abierto de 397B Parámetros, Costo Reducido en un 60%

Alibaba acaba de lanzar Qwen 3.5-397B-A17B. Este es el primer modelo de peso abierto de la serie Qwen 3.5.

Datos Clave

- Parámetros Totales: 397B

- Parámetros Activos: 17B por pasada (MoE disperso)

- Rendimiento: 8.6x-19x más alto que Qwen 3-Max

- Costo: 60% más bajo que Qwen 3

- Soporte de Idiomas: 201 (expandido desde 119)

Esto no es simplemente apilar parámetros. Es una redefinición de la eficiencia.

Innovación en la Arquitectura

Qwen 3.5 utiliza una arquitectura híbrida:

- Gated Delta Networks + MoE disperso

- Atención Lineal Híbrida: La mayoría de las capas utilizan atención lineal, cada 4 capas utilizan atención completa

- Multimodal Nativo: No se agrega posteriormente, sino que se entrena desde cero

Hay análisis técnicos en X:

"Qwen3.5-397B-A17B: Hybrid linear attention + sparse MoE with large-scale RL environment scaling." — @Alibaba_Qwen

El significado de esta arquitectura es: lograr un rendimiento cercano a un modelo de 400B con 17B de parámetros activos. El costo de inferencia se reduce significativamente.

Afirmaciones de Rendimiento

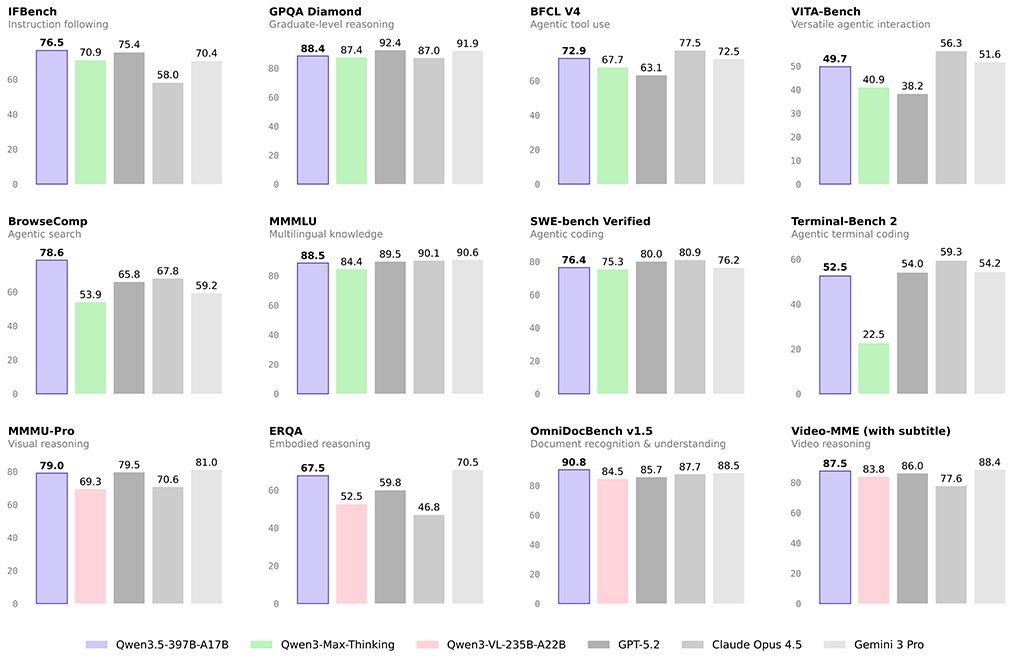

Alibaba afirma que Qwen 3.5 supera a:

- GPT-5.2

- Claude Opus 4.5

- Gemini 3 Pro

Los evaluadores independientes en X están comenzando a verificar:

"Qwen 3.5-397B dropped today... and the benchmarks are insane. Trading blows with Claude Opus 4.5 and GPT-5.2 across the board." — @antonpme

Pero lo más importante no son las pruebas de referencia, sino la capacidad de agente:

"The agentic capabilities are the real story here. Qwen 3.5 can interact with GUIs, not just understand them. That's the unlock for workflows that touch existing software." — @thebuildrweekly

Era del Agente

El posicionamiento de Qwen 3.5 es claro: diseñado para la era del agente.

- Puede analizar videos de 2 horas

- Puede ejecutar de forma independiente tareas entre aplicaciones

- Puede comprender la GUI e interactuar con ella

"Qwen 3.5 can independently take actions across apps." — @thebuildrweekly

Esto significa que no es un "chatbot", sino un "ejecutor de tareas".

Panorama Competitivo

Alguien en X resumió los lanzamientos de IA de esta semana:

"This might be the single biggest week in AI history: DeepSeek V4, Gemini 3.1 Pro, GPT-5.3, Qwen 3.5, Claude Sonnet 5." — @HeyAbhishek

El ritmo de los fabricantes de modelos chinos es claro:

- DeepSeek V4

- Qwen 3.5

- GLM 5

- MiniMax 2.5

Hay un nuevo modelo cada semana, y cada uno afirma superar a GPT. Esto no es marketing, es una escalada en la guerra de costos.

Estructura de Costos

El precio del token de Qwen 3.5 es solo 1/18 del de Gemini 3 Pro.

"Qwen 3.5 with performance comparable to Gemini 3, and a token price of only 1/18 of the latter." — @dyz_ob

Cuando el rendimiento es similar y el costo es solo el 5%, ¿dónde está el foso de los modelos de código cerrado?

Conclusión

Qwen 3.5 no es el "GPT de China". Es un disruptor de la estructura de costos:

- 397B parámetros, pero solo activa 17B

- Peso abierto, se puede implementar localmente

- Capacidad de agente, no solo diálogo

- El costo es solo el 5% de sus competidores

Hay una predicción interesante en X:

"Qwen 3.5 Q4 版本只需要 225G,很有实用价值" — @janxin

225GB de memoria de video, se puede ejecutar en una sola máquina. Esto significa que los desarrolladores de pequeñas y medianas empresas pueden acceder por primera vez a un modelo cercano al nivel de GPT-5.

La verdadera pregunta no es si Qwen 3.5 puede superar a GPT-5.3, sino: cuando el costo de los modelos de primer nivel se reduce a casi cero, ¿cómo ganan dinero las empresas de IA?