Lancement de Qwen 3.5 : Modèle à poids ouverts de 397B paramètres, coût réduit de 60 %

Alibaba vient de lancer Qwen 3.5-397B-A17B. Il s'agit du premier modèle à poids ouverts de la série Qwen 3.5.

Données clés

- Nombre total de paramètres : 397B

- Paramètres actifs : 17B par passe (MoE clairsemé)

- Débit : 8,6x-19x supérieur à Qwen 3-Max

- Coût : 60 % inférieur à Qwen 3

- Prise en charge des langues : 201 (extension de 119)

Ce n'est pas un simple empilement de paramètres. C'est une redéfinition de l'efficacité.

Innovation architecturale

Qwen 3.5 utilise une architecture hybride :

- Gated Delta Networks + MoE clairsemé

- Attention linéaire hybride : la plupart des couches utilisent l'attention linéaire, l'attention complète est utilisée tous les 4 couches

- Multimodalité native : pas ajoutée ultérieurement, mais entraînée à partir de zéro

Il y a une analyse technique sur X :

"Qwen3.5-397B-A17B: Hybrid linear attention + sparse MoE with large-scale RL environment scaling." — @Alibaba_Qwen

La signification de cette architecture est la suivante : atteindre des performances proches d'un modèle de 400B avec 17B de paramètres actifs. Le coût d'inférence est considérablement réduit.

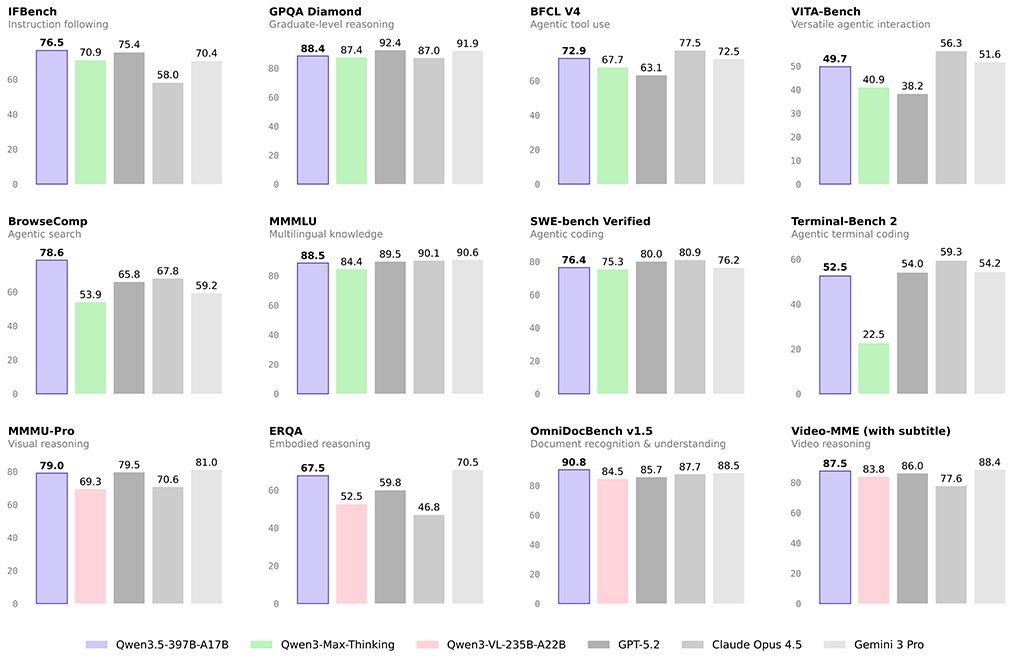

Allégations de performance

Alibaba affirme que Qwen 3.5 a battu :

- GPT-5.2

- Claude Opus 4.5

- Gemini 3 Pro

Des testeurs indépendants sur X commencent à vérifier :

"Qwen 3.5-397B dropped today... and the benchmarks are insane. Trading blows with Claude Opus 4.5 and GPT-5.2 across the board." — @antonpme

Mais le plus important n'est pas les benchmarks, mais les capacités d'agent :

"The agentic capabilities are the real story here. Qwen 3.5 can interact with GUIs, not just understand them. That's the unlock for workflows that touch existing software." — @thebuildrweekly

L'ère des agents

Le positionnement de Qwen 3.5 est clair : conçu pour l'ère des agents.

- Peut analyser 2 heures de vidéo

- Peut exécuter indépendamment des tâches inter-applications

- Peut comprendre les GUI et interagir avec elles

"Qwen 3.5 can independently take actions across apps." — @thebuildrweekly

Cela signifie que ce n'est pas un « chatbot », mais un « exécuteur de tâches ».

Paysage concurrentiel

Quelqu'un sur X a résumé les lancements d'IA de cette semaine :

"This might be the single biggest week in AI history: DeepSeek V4, Gemini 3.1 Pro, GPT-5.3, Qwen 3.5, Claude Sonnet 5." — @HeyAbhishek

Le rythme des fabricants de modèles chinois est clair :

- DeepSeek V4

- Qwen 3.5

- GLM 5

- MiniMax 2.5

Il y a un nouveau modèle chaque semaine, et chacun prétend battre GPT. Ce n'est pas du marketing, c'est une escalade de la guerre des coûts.

Structure des coûts

Le prix par token de Qwen 3.5 n'est que de 1/18 de celui de Gemini 3 Pro.

"Qwen 3.5 with performance comparable to Gemini 3, and a token price of only 1/18 of the latter." — @dyz_ob

Lorsque les performances sont proches et que le coût n'est que de 5 %, où est le rempart des modèles à source fermée ?

Conclusion

Qwen 3.5 n'est pas le « GPT chinois ». C'est un perturbateur de la structure des coûts :

- 397B paramètres, mais seulement 17B activés

- Poids ouverts, déployable localement

- Capacités d'agent, pas seulement de la conversation

- Coût de seulement 5 % de celui des concurrents

Il y a une prédiction intéressante sur X :

"Qwen 3.5 Q4 版本只需要 225G,很有实用价值" — @janxin

225 Go de mémoire GPU, peut être exécuté sur une seule machine. Cela signifie que les petits et moyens développeurs peuvent accéder pour la première fois à un modèle proche de GPT-5.

La vraie question n'est pas de savoir si Qwen 3.5 peut battre GPT-5.3, mais : comment les entreprises d'IA gagnent-elles de l'argent lorsque le coût des meilleurs modèles est proche de zéro ?