Rilasciato Qwen 3.5: Modello open-weight con 397B parametri, costo ridotto del 60%

Alibaba ha appena rilasciato Qwen 3.5-397B-A17B. Questo è il primo modello open-weight della serie Qwen 3.5.

Dati chiave

- Parametri totali: 397B

- Parametri attivi: 17B per pass (MoE sparse)

- Throughput: 8.6x-19x superiore a Qwen 3-Max

- Costo: 60% inferiore a Qwen 3

- Supporto linguistico: 201 lingue (esteso da 119)

Non si tratta di una semplice sovrapposizione di parametri. È una ridefinizione dell'efficienza.

Innovazione architetturale

Qwen 3.5 utilizza un'architettura ibrida:

- Gated Delta Networks + MoE sparse

- Attenzione lineare ibrida: la maggior parte dei layer utilizza l'attenzione lineare, ogni 4 layer utilizza l'attenzione completa

- Multimodale nativo: non aggiunto in seguito, ma addestrato da zero

Su X ci sono analisi tecniche:

"Qwen3.5-397B-A17B: Hybrid linear attention + sparse MoE with large-scale RL environment scaling." — @Alibaba_Qwen

Il significato di questa architettura è: ottenere prestazioni simili a un modello da 400B con 17B di parametri attivi. Il costo di inferenza è notevolmente ridotto.

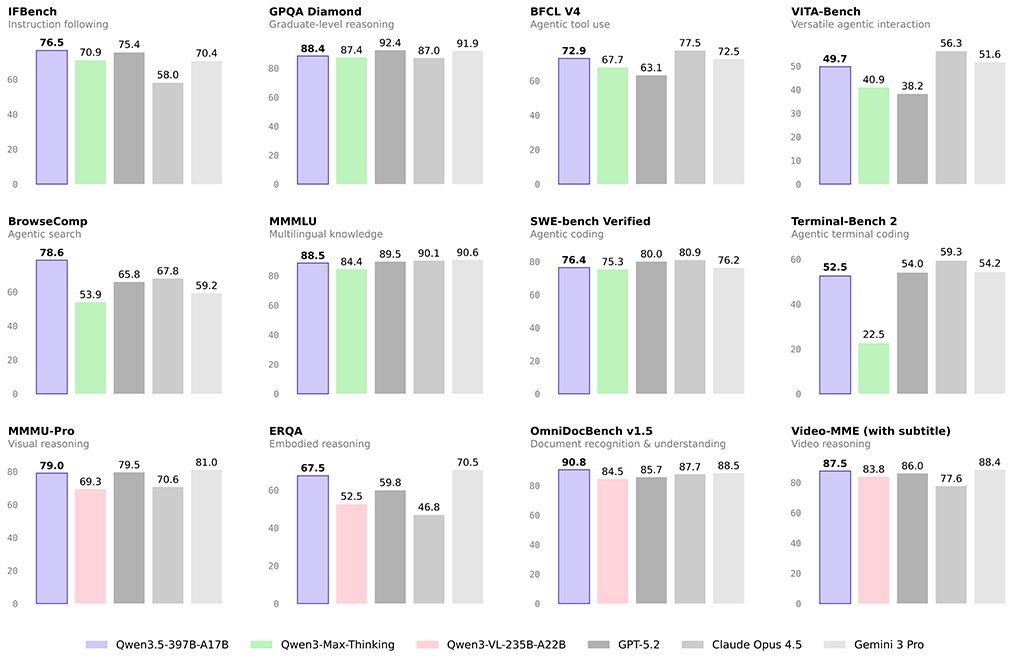

Affermazioni sulle prestazioni

Alibaba afferma che Qwen 3.5 ha superato:

- GPT-5.2

- Claude Opus 4.5

- Gemini 3 Pro

Tester indipendenti su X hanno iniziato a verificare:

"Qwen 3.5-397B dropped today... and the benchmarks are insane. Trading blows with Claude Opus 4.5 and GPT-5.2 across the board." — @antonpme

Ma la cosa più importante non sono i benchmark, ma le capacità di agent:

"The agentic capabilities are the real story here. Qwen 3.5 can interact with GUIs, not just understand them. That's the unlock for workflows that touch existing software." — @thebuildrweekly

L'era degli agent

Il posizionamento di Qwen 3.5 è chiaro: progettato per l'era degli agent.

- Può analizzare video di 2 ore

- Può eseguire autonomamente attività tra applicazioni

- Può comprendere le GUI e interagire con esse

"Qwen 3.5 can independently take actions across apps." — @thebuildrweekly

Ciò significa che non è un "chatbot", ma un "esecutore di compiti".

Panorama competitivo

Qualcuno su X ha riassunto le release AI di questa settimana:

"This might be the single biggest week in AI history: DeepSeek V4, Gemini 3.1 Pro, GPT-5.3, Qwen 3.5, Claude Sonnet 5." — @HeyAbhishek

Il ritmo dei produttori di modelli cinesi è chiaro:

- DeepSeek V4

- Qwen 3.5

- GLM 5

- MiniMax 2.5

Ogni settimana c'è un nuovo modello, e ogni volta si afferma di superare GPT. Non si tratta di marketing, ma di un'escalation della guerra dei costi.

Struttura dei costi

Il prezzo per token di Qwen 3.5 è solo 1/18 di quello di Gemini 3 Pro.

"Qwen 3.5 with performance comparable to Gemini 3, and a token price of only 1/18 of the latter." — @dyz_ob

Quando le prestazioni sono simili e il costo è solo il 5%, dove si trova il fossato dei modelli closed-source?

Conclusione

Qwen 3.5 non è il "GPT cinese". È un disgregatore della struttura dei costi:

- 397B parametri, ma ne attiva solo 17B

- Open-weight, implementabile localmente

- Capacità di agent, non solo conversazione

- Costo solo il 5% dei concorrenti

Su X c'è una previsione interessante:

"Qwen 3.5 Q4 版本只需要 225G,很有实用价值" — @janxin

225GB di memoria video, eseguibile su una singola macchina. Ciò significa che gli sviluppatori di piccole e medie dimensioni possono accedere per la prima volta a un modello di livello GPT-5.

Il vero problema non è se Qwen 3.5 possa battere GPT-5.3, ma: quando il costo dei modelli di punta scende quasi a zero, come fanno le aziende di AI a guadagnare?