Qwen 3.5 Lansert: Åpen Vektmodell med 397B Parametre, Kostnad Redusert med 60%

Alibaba har nettopp lansert Qwen 3.5-397B-A17B. Dette er den første åpne vektmodellen i Qwen 3.5-serien.

Kjerndata

- Totalt antall parametre: 397B

- Aktive parametre: 17B per passering (spars MoE)

- Gjennomstrømning: 8.6x-19x forbedring sammenlignet med Qwen 3-Max

- Kostnad: 60% reduksjon sammenlignet med Qwen 3

- Språkstøtte: 201 språk (utvidet fra 119)

Dette er ikke bare en stabling av parametre. Dette er en redefinisjon av effektivitet.

Arkitektonisk Innovasjon

Qwen 3.5 bruker en hybridarkitektur:

- Gated Delta Networks + spars MoE

- Hybrid Lineær Oppmerksomhet: De fleste lag bruker lineær oppmerksomhet, full oppmerksomhet brukes hvert 4. lag

- Nativ Multimodalitet: Ikke lagt til i etterkant, men trent fra bunnen av

Det finnes teknisk analyse på X:

"Qwen3.5-397B-A17B: Hybrid linear attention + sparse MoE with large-scale RL environment scaling." — @Alibaba_Qwen

Betydningen av denne arkitekturen er: å oppnå ytelse som ligner en 400B-modell med 17B aktive parametre. Kostnadene for inferens reduseres betydelig.

Ytelsespåstander

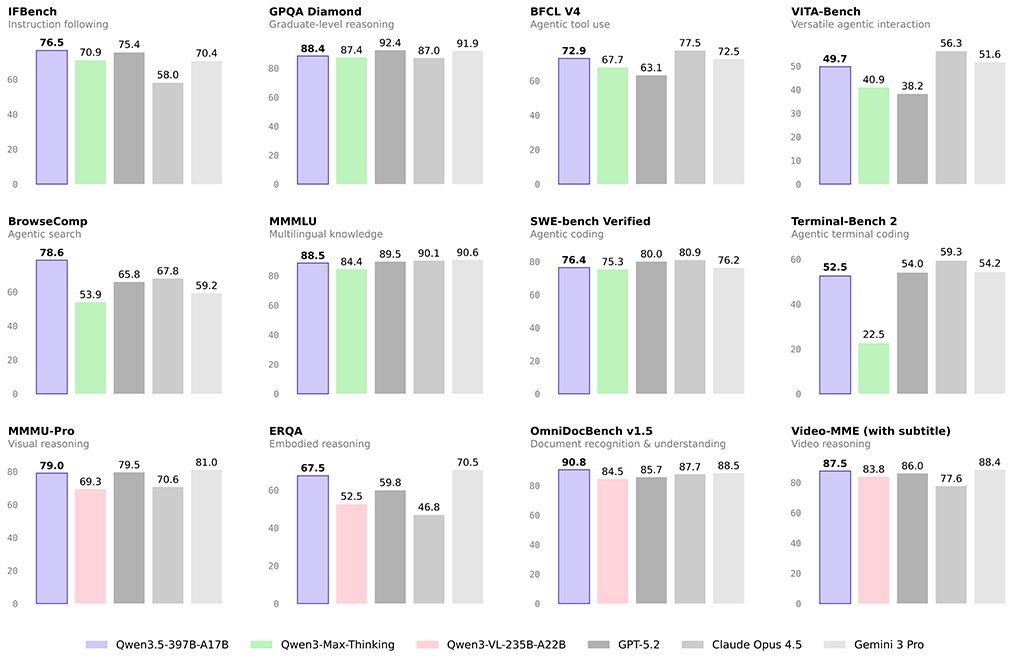

Alibaba hevder at Qwen 3.5 slår:

- GPT-5.2

- Claude Opus 4.5

- Gemini 3 Pro

Uavhengige testere på X har begynt å verifisere:

"Qwen 3.5-397B dropped today... and the benchmarks are insane. Trading blows with Claude Opus 4.5 and GPT-5.2 across the board." — @antonpme

Men det viktigste er ikke benchmarkene, men agentegenskapene:

"The agentic capabilities are the real story here. Qwen 3.5 can interact with GUIs, not just understand them. That's the unlock for workflows that touch existing software." — @thebuildrweekly

Agent-æraen

Qwen 3.5 er tydelig posisjonert: designet for agent-æraen.

- Kan analysere 2 timer med video

- Kan selvstendig utføre oppgaver på tvers av applikasjoner

- Kan forstå GUI og samhandle med den

"Qwen 3.5 can independently take actions across apps." — @thebuildrweekly

Dette betyr at det ikke er en «chatbot», men en «oppgaveutfører».

Konkurranselandskap

Noen oppsummerte ukens AI-lanseringer på X:

"This might be the single biggest week in AI history: DeepSeek V4, Gemini 3.1 Pro, GPT-5.3, Qwen 3.5, Claude Sonnet 5." — @HeyAbhishek

Rytmen til kinesiske modellprodusenter er tydelig:

- DeepSeek V4

- Qwen 3.5

- GLM 5

- MiniMax 2.5

Det kommer nye modeller hver uke, og hver gang hevdes det at de slår GPT. Dette er ikke markedsføring, dette er en opptrapping av kostnadskrigen.

Kostnadsstruktur

Tokenprisen for Qwen 3.5 er bare 1/18 av Gemini 3 Pro.

"Qwen 3.5 with performance comparable to Gemini 3, and a token price of only 1/18 of the latter." — @dyz_ob

Når ytelsen er lik og kostnaden bare er 5 %, hvor er vollgraven til lukkede kildemodeller?

Konklusjon

Qwen 3.5 er ikke en «kinesisk GPT». Det er en forstyrrer av kostnadsstrukturen:

- 397B parametre, men bare 17B aktiveres

- Åpne vekter, kan distribueres lokalt

- Agentegenskaper, ikke bare dialog

- Kostnadene er bare 5 % av konkurrentene

Det er en interessant spådom på X:

"Qwen 3.5 Q4 版本只需要 225G,很有实用价值" — @janxin

225 GB skjermminne, kan kjøres på en enkelt maskin. Dette betyr at små og mellomstore utviklere for første gang kan få tilgang til en modell som er nær GPT-5-nivå.

Det virkelige spørsmålet er ikke om Qwen 3.5 kan slå GPT-5.3, men: hvordan tjener AI-selskaper penger når kostnadene for toppmodeller reduseres til nesten null?