Qwen 3.5 Uitgebracht: Open-Gewichtmodel met 397B Parameters, Kosten 60% Lager

Alibaba heeft zojuist Qwen 3.5-397B-A17B uitgebracht. Dit is het eerste open-gewichtmodel van de Qwen 3.5-serie.

Kerngegevens

- Totaal aantal parameters: 397B

- Actieve parameters: 17B per pass (sparse MoE)

- Doorvoer: 8.6x-19x hoger dan Qwen 3-Max

- Kosten: 60% lager dan Qwen 3

- Taalondersteuning: 201 talen (uitgebreid van 119)

Dit is niet zomaar een stapeling van parameters. Dit is een herdefinitie van efficiëntie.

Architectuurinnovatie

Qwen 3.5 gebruikt een hybride architectuur:

- Gated Delta Networks + sparse MoE

- Hybride lineaire aandacht: De meeste lagen gebruiken lineaire aandacht, elke 4 lagen gebruiken volledige aandacht

- Native multi-modaal: Niet achteraf toegevoegd, maar vanaf het begin getraind

Er is een technische analyse op X:

"Qwen3.5-397B-A17B: Hybrid linear attention + sparse MoE with large-scale RL environment scaling." — @Alibaba_Qwen

De betekenis van deze architectuur is: met 17B actieve parameters de prestaties van een model van bijna 400B bereiken. De inferentiekosten dalen aanzienlijk.

Prestatieclaims

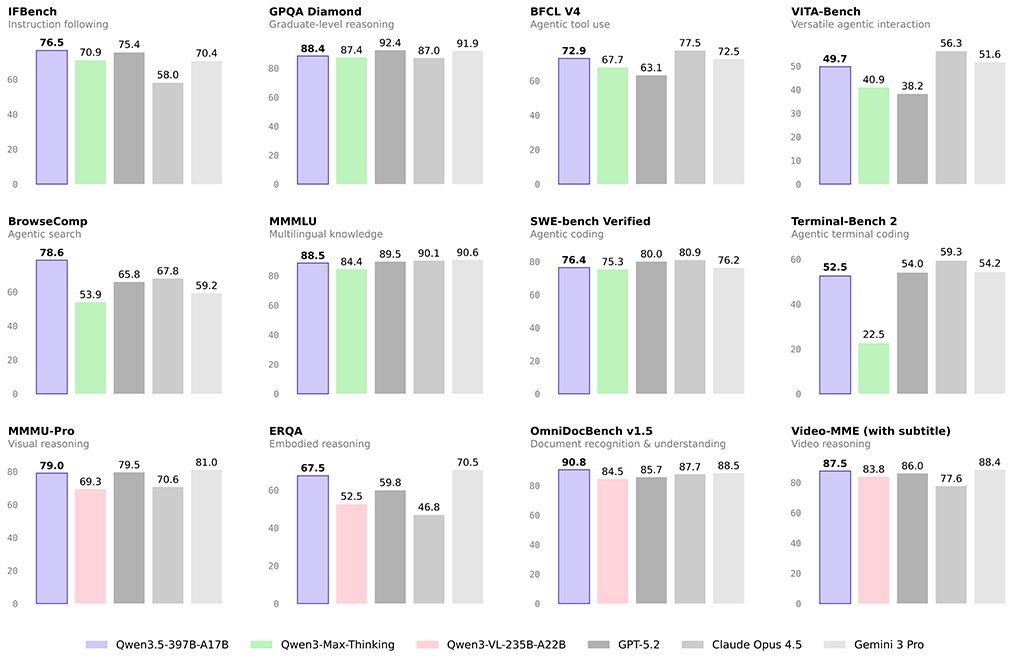

Alibaba beweert dat Qwen 3.5 verslaat:

- GPT-5.2

- Claude Opus 4.5

- Gemini 3 Pro

Onafhankelijke testers op X beginnen te valideren:

"Qwen 3.5-397B dropped today... and the benchmarks are insane. Trading blows with Claude Opus 4.5 and GPT-5.2 across the board." — @antonpme

Maar het belangrijkste is niet de benchmark, maar de agent-capaciteit:

"The agentic capabilities are the real story here. Qwen 3.5 can interact with GUIs, not just understand them. That's the unlock for workflows that touch existing software." — @thebuildrweekly

Agent-tijdperk

De positionering van Qwen 3.5 is duidelijk: ontworpen voor het agent-tijdperk.

- Kan 2 uur video analyseren

- Kan zelfstandig taken uitvoeren in verschillende applicaties

- Kan GUI's begrijpen en ermee interageren

"Qwen 3.5 can independently take actions across apps." — @thebuildrweekly

Dit betekent dat het geen 'chatbot' is, maar een 'taakuitvoerder'.

Concurrentie

Iemand op X vatte de AI-releases van deze week samen:

"This might be the single biggest week in AI history: DeepSeek V4, Gemini 3.1 Pro, GPT-5.3, Qwen 3.5, Claude Sonnet 5." — @HeyAbhishek

Het ritme van Chinese modelleveranciers is duidelijk:

- DeepSeek V4

- Qwen 3.5

- GLM 5

- MiniMax 2.5

Elke week is er een nieuw model, en elke keer wordt beweerd dat het GPT verslaat. Dit is geen marketing, dit is een escalatie van de kostenstrijd.

Kostenstructuur

De tokenprijs van Qwen 3.5 is slechts 1/18 van die van Gemini 3 Pro.

"Qwen 3.5 with performance comparable to Gemini 3, and a token price of only 1/18 of the latter." — @dyz_ob

Wanneer de prestaties vergelijkbaar zijn en de kosten slechts 5% bedragen, waar is dan de gracht van het closed-source model?

Conclusie

Qwen 3.5 is geen 'Chinese GPT'. Het is een ontwrichting van de kostenstructuur:

- 397B parameters, maar slechts 17B geactiveerd

- Open gewicht, lokaal te implementeren

- Agent-capaciteit, niet alleen dialoog

- Kosten slechts 5% van de concurrentie

Er is een interessante voorspelling op X:

"Qwen 3.5 Q4 版本只需要 225G,很有实用价值" — @janxin

225GB videogeheugen, kan op een enkele machine draaien. Dit betekent dat kleine en middelgrote ontwikkelaars voor het eerst toegang hebben tot een model dat in de buurt komt van GPT-5 niveau.

De echte vraag is niet of Qwen 3.5 GPT-5.3 kan verslaan, maar: hoe verdienen AI-bedrijven geld als de kosten van topmodellen tot bijna nul dalen?