Qwen 3.5 Släppt: Öppen Viktmodell med 397B Parametrar, 60% Lägre Kostnad

Alibaba har precis släppt Qwen 3.5-397B-A17B. Detta är den första öppna viktmodellen i Qwen 3.5-serien.

Kärndata

- Totala parametrar: 397B

- Aktiva parametrar: 17B per pass (gles MoE)

- Genomströmning: 8.6x-19x högre än Qwen 3-Max

- Kostnad: 60% lägre än Qwen 3

- Språkstöd: 201 språk (utökat från 119 språk)

Detta är inte bara en enkel stapling av parametrar. Det är en omdefiniering av effektivitet.

Arkitektonisk Innovation

Qwen 3.5 använder en hybridarkitektur:

- Gated Delta Networks + Gles MoE

- Hybrid Linjär Uppmärksamhet: De flesta lager använder linjär uppmärksamhet, full uppmärksamhet används var fjärde lager

- Nativ Multimodalitet: Inte tillagt i efterhand, utan tränat från grunden

Det finns tekniska analyser på X:

"Qwen3.5-397B-A17B: Hybrid linear attention + sparse MoE with large-scale RL environment scaling." — @Alibaba_Qwen

Betydelsen av denna arkitektur är: att uppnå prestanda nära en 400B-modell med 17B aktiva parametrar. Slutledningskostnaden minskar kraftigt.

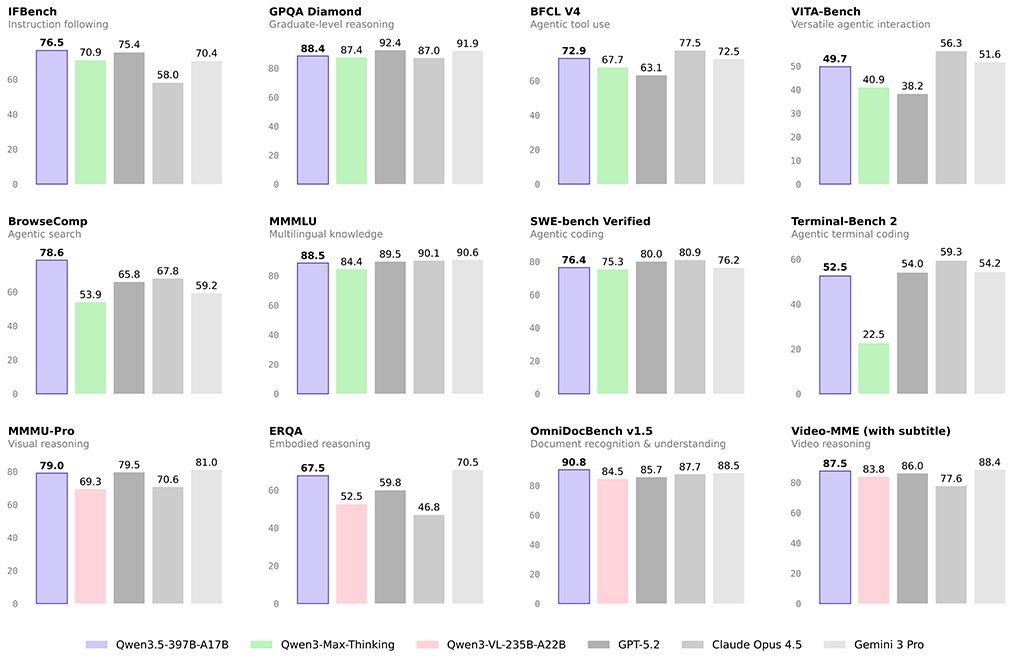

Prestandapåståenden

Alibaba hävdar att Qwen 3.5 slår:

- GPT-5.2

- Claude Opus 4.5

- Gemini 3 Pro

Oberoende testare på X har börjat verifiera:

"Qwen 3.5-397B dropped today... and the benchmarks are insane. Trading blows with Claude Opus 4.5 and GPT-5.2 across the board." — @antonpme

Men det viktigaste är inte riktmärkena, utan agentförmågan:

"The agentic capabilities are the real story here. Qwen 3.5 can interact with GUIs, not just understand them. That's the unlock for workflows that touch existing software." — @thebuildrweekly

Agent-eran

Qwen 3.5:s positionering är tydlig: designad för agent-eran.

- Kan analysera 2 timmars video

- Kan självständigt utföra uppgifter över flera applikationer

- Kan förstå GUI och interagera med den

"Qwen 3.5 can independently take actions across apps." — @thebuildrweekly

Detta innebär att det inte är en "chattbot", utan en "uppgiftsutförare".

Konkurrenssituation

Någon på X sammanfattade veckans AI-lanseringar:

"This might be the single biggest week in AI history: DeepSeek V4, Gemini 3.1 Pro, GPT-5.3, Qwen 3.5, Claude Sonnet 5." — @HeyAbhishek

Rytmen för kinesiska modellföretag är tydlig:

- DeepSeek V4

- Qwen 3.5

- GLM 5

- MiniMax 2.5

Det kommer nya modeller varje vecka, och varje gång hävdas det att de slår GPT. Detta är inte marknadsföring, det är en upptrappning av kostnadskriget.

Kostnadsstruktur

Tokenpriset för Qwen 3.5 är bara 1/18 av Gemini 3 Pro.

"Qwen 3.5 with performance comparable to Gemini 3, and a token price of only 1/18 of the latter." — @dyz_ob

När prestandan är likvärdig och kostnaden bara är 5%, var är vallgraven för slutna källkodsmodeller?

Slutsats

Qwen 3.5 är inte "Kinas GPT". Det är en omstörtare av kostnadsstrukturen:

- 397B parametrar, men aktiverar bara 17B

- Öppna vikter, kan distribueras lokalt

- Agentförmåga, inte bara konversation

- Kostar bara 5% av konkurrenterna

Det finns en intressant förutsägelse på X:

"Qwen 3.5 Q4 版本只需要 225G,很有实用价值" — @janxin

225GB grafikminne, kan köras på en enda maskin. Detta innebär att små och medelstora utvecklare för första gången kan komma i kontakt med en modell som närmar sig GPT-5-nivå.

Den verkliga frågan är inte om Qwen 3.5 kan slå GPT-5.3, utan: hur tjänar AI-företag pengar när kostnaden för toppmodeller sjunker till nära noll?