Qwen 3.5 เปิดตัว: โมเดล Open Weight ขนาด 397B พารามิเตอร์ ลดต้นทุน 60%

Alibaba เพิ่งเปิดตัว Qwen 3.5-397B-A17B นี่คือโมเดล open weight ตัวแรกของซีรีส์ Qwen 3.5

ข้อมูลหลัก

- พารามิเตอร์ทั้งหมด: 397B

- พารามิเตอร์ที่ใช้งาน: 17B per pass (Sparse MoE)

- Throughput: สูงกว่า Qwen 3-Max 8.6x-19x

- ต้นทุน: ลดลง 60% เมื่อเทียบกับ Qwen 3

- การรองรับภาษา: 201 ภาษา (ขยายจาก 119 ภาษา)

นี่ไม่ใช่แค่การเพิ่มพารามิเตอร์ นี่คือการนิยามใหม่ของประสิทธิภาพ

นวัตกรรมสถาปัตยกรรม

Qwen 3.5 ใช้สถาปัตยกรรมแบบผสม:

- Gated Delta Networks + Sparse MoE

- Hybrid Linear Attention: เลเยอร์ส่วนใหญ่ใช้ Linear Attention, ทุกๆ 4 เลเยอร์ใช้ Full Attention

- Native Multimodal: ไม่ได้เพิ่มในภายหลัง แต่ฝึกฝนตั้งแต่เริ่มต้น

มีการวิเคราะห์ทางเทคนิคบน X:

"Qwen3.5-397B-A17B: Hybrid linear attention + sparse MoE with large-scale RL environment scaling." — @Alibaba_Qwen

ความสำคัญของสถาปัตยกรรมนี้คือ: ใช้พารามิเตอร์ที่ใช้งาน 17B เพื่อให้ได้ประสิทธิภาพใกล้เคียงกับโมเดล 400B ต้นทุนการอนุมานลดลงอย่างมาก

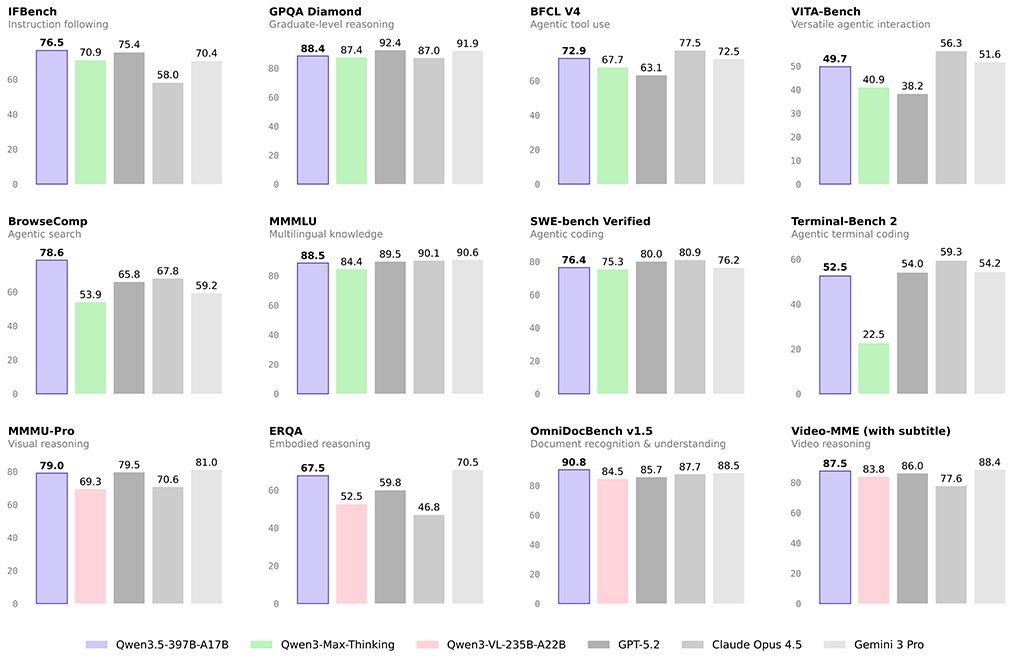

การอ้างสิทธิ์ด้านประสิทธิภาพ

Alibaba อ้างว่า Qwen 3.5 เอาชนะ:

- GPT-5.2

- Claude Opus 4.5

- Gemini 3 Pro

ผู้ทดสอบอิสระบน X เริ่มตรวจสอบ:

"Qwen 3.5-397B dropped today... and the benchmarks are insane. Trading blows with Claude Opus 4.5 and GPT-5.2 across the board." — @antonpme

แต่สิ่งที่สำคัญที่สุดไม่ใช่การทดสอบมาตรฐาน แต่เป็นความสามารถของ Agent:

"The agentic capabilities are the real story here. Qwen 3.5 can interact with GUIs, not just understand them. That's the unlock for workflows that touch existing software." — @thebuildrweekly

ยุคของ Agent

ตำแหน่งของ Qwen 3.5 ชัดเจน: ออกแบบมาสำหรับยุคของ Agent

- สามารถวิเคราะห์วิดีโอ 2 ชั่วโมง

- สามารถดำเนินการข้ามแอปพลิเคชันได้อย่างอิสระ

- สามารถเข้าใจ GUI และโต้ตอบกับมันได้

"Qwen 3.5 can independently take actions across apps." — @thebuildrweekly

ซึ่งหมายความว่ามันไม่ใช่ "แชทบอท" แต่เป็น "ตัวดำเนินการงาน"

ภูมิทัศน์การแข่งขัน

มีคนสรุปการเปิดตัว AI ในสัปดาห์นี้บน X:

"This might be the single biggest week in AI history: DeepSeek V4, Gemini 3.1 Pro, GPT-5.3, Qwen 3.5, Claude Sonnet 5." — @HeyAbhishek

จังหวะของผู้ผลิตโมเดลจีนมีความชัดเจน:

- DeepSeek V4

- Qwen 3.5

- GLM 5

- MiniMax 2.5

มีโมเดลใหม่ออกมาทุกสัปดาห์ และทุกครั้งก็อ้างว่าเอาชนะ GPT ได้ นี่ไม่ใช่การตลาด แต่นี่คือการยกระดับสงครามต้นทุน

โครงสร้างต้นทุน

ราคา Token ของ Qwen 3.5 เพียง 1/18 ของ Gemini 3 Pro

"Qwen 3.5 with performance comparable to Gemini 3, and a token price of only 1/18 of the latter." — @dyz_ob

เมื่อประสิทธิภาพใกล้เคียงกัน และต้นทุนเพียง 5% อะไรคือปราการของโมเดล Closed Source?

บรรทัดล่าง

Qwen 3.5 ไม่ใช่ "GPT ของจีน" มันคือผู้พลิกโฉมโครงสร้างต้นทุน:

- 397B พารามิเตอร์ แต่เปิดใช้งานเพียง 17B

- Open Weight สามารถปรับใช้ในเครื่องได้

- ความสามารถของ Agent ไม่ใช่แค่การสนทนา

- ต้นทุนเพียง 5% ของคู่แข่ง

มีการคาดการณ์ที่น่าสนใจบน X:

"Qwen 3.5 Q4 版本只需要 225G,很有实用价值" — @janxin

หน่วยความจำ 225GB สามารถรันบนเครื่องเดียวได้ ซึ่งหมายความว่านักพัฒนาขนาดกลางและขนาดย่อมสามารถเข้าถึงโมเดลระดับ GPT-5 ได้เป็นครั้งแรก

คำถามที่แท้จริงไม่ใช่ว่า Qwen 3.5 สามารถเอาชนะ GPT-5.3 ได้หรือไม่ แต่คือ: เมื่อต้นทุนของโมเดลชั้นนำลดลงใกล้ศูนย์ บริษัท AI จะทำเงินได้อย่างไร?