Inilabas ang Qwen 3.5: Bukas na Timbang na Modelo na may 397B na Parameter, 60% na Pagbaba sa Gastos

Inilabas kamakailan ng Alibaba ang Qwen 3.5-397B-A17B. Ito ang unang bukas na timbang na modelo sa serye ng Qwen 3.5.

Pangunahing Datos

- Kabuuang Parameter: 397B

- Aktibong Parameter: 17B per pass (sparse MoE)

- Throughput: 8.6x-19x na pagtaas kumpara sa Qwen 3-Max

- Gastos: 60% na pagbaba kumpara sa Qwen 3

- Suporta sa Wika: 201 (pinalawak mula sa 119)

Hindi ito simpleng pagtatambak ng parameter. Ito ay muling pagpapakahulugan ng kahusayan.

Inobasyon sa Arkitektura

Gumagamit ang Qwen 3.5 ng hybrid na arkitektura:

- Gated Delta Networks + Sparse MoE

- Hybrid Linear Attention: Karamihan sa mga layer ay gumagamit ng linear attention, bawat 4 na layer ay gumagamit ng full attention

- Native Multimodal: Hindi idinagdag sa huli, kundi sinanay mula sa simula

May teknikal na pagsusuri sa X:

"Qwen3.5-397B-A17B: Hybrid linear attention + sparse MoE with large-scale RL environment scaling." — @Alibaba_Qwen

Ang kahalagahan ng arkitekturang ito ay: gamitin ang 17B na aktibong parameter upang makamit ang pagganap na malapit sa 400B na modelo. Malaki ang ibinaba sa gastos sa pag-infer.

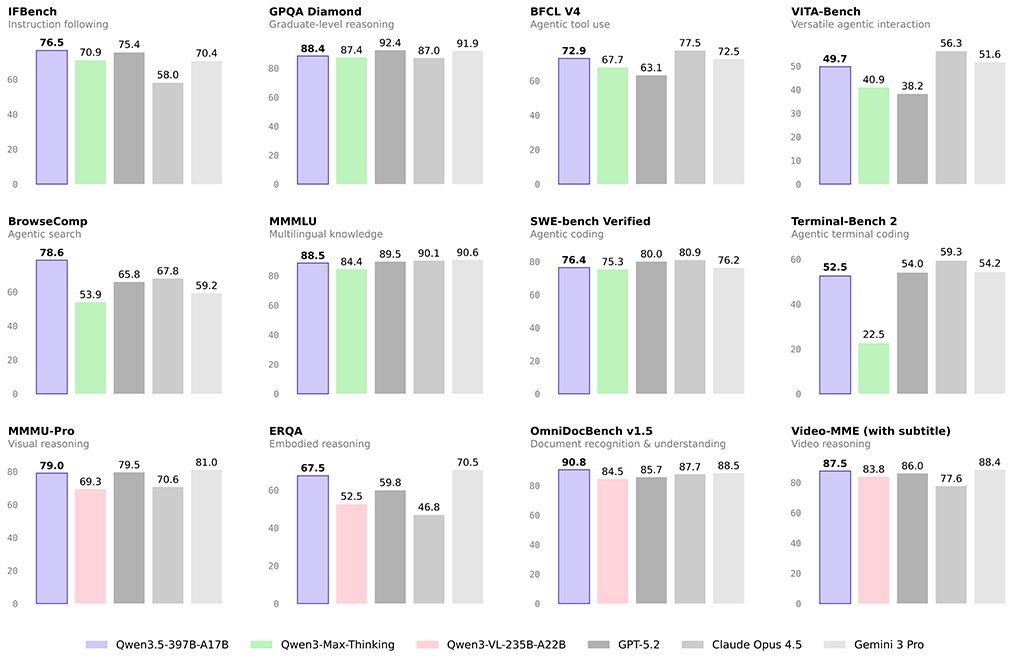

Pag-angkin sa Pagganap

Inaangkin ng Alibaba na tinalo ng Qwen 3.5 ang:

- GPT-5.2

- Claude Opus 4.5

- Gemini 3 Pro

Nagsimula nang magberipika ang mga independiyenteng tester sa X:

"Qwen 3.5-397B dropped today... and the benchmarks are insane. Trading blows with Claude Opus 4.5 and GPT-5.2 across the board." — @antonpme

Ngunit ang pinakamahalaga ay hindi ang benchmark test, kundi ang kakayahan ng ahente:

"The agentic capabilities are the real story here. Qwen 3.5 can interact with GUIs, not just understand them. That's the unlock for workflows that touch existing software." — @thebuildrweekly

Panahon ng Ahente

Malinaw ang posisyon ng Qwen 3.5: idinisenyo para sa panahon ng ahente.

- Kayang suriin ang 2 oras na video

- Kayang magsagawa ng mga gawain sa iba't ibang aplikasyon nang mag-isa

- Kayang unawain ang GUI at makipag-ugnayan dito

"Qwen 3.5 can independently take actions across apps." — @thebuildrweekly

Ibig sabihin, hindi ito "chatbot", kundi "tagapagpatupad ng gawain".

Kompetisyon

May nagbuod sa mga paglabas ng AI ngayong linggo sa X:

"This might be the single biggest week in AI history: DeepSeek V4, Gemini 3.1 Pro, GPT-5.3, Qwen 3.5, Claude Sonnet 5." — @HeyAbhishek

Malinaw ang ritmo ng mga tagagawa ng modelo sa Tsina:

- DeepSeek V4

- Qwen 3.5

- GLM 5

- MiniMax 2.5

May bagong modelo bawat linggo, at bawat isa ay inaangking tatalo sa GPT. Hindi ito marketing, ito ay pagtaas ng digmaan sa gastos.

Istruktura ng Gastos

Ang presyo ng token ng Qwen 3.5 ay 1/18 lamang ng Gemini 3 Pro.

"Qwen 3.5 with performance comparable to Gemini 3, and a token price of only 1/18 of the latter." — @dyz_ob

Kapag malapit ang pagganap at 5% lamang ang gastos, nasaan ang moat ng closed-source na modelo?

Konklusyon

Ang Qwen 3.5 ay hindi "GPT ng Tsina". Ito ay tagagulo sa istruktura ng gastos:

- 397B na parameter, ngunit 17B lamang ang aktibo

- Bukas na timbang, maaaring i-deploy nang lokal

- Kakayahan ng ahente, hindi lamang pag-uusap

- 5% lamang ng gastos ng mga kakumpitensya

May isang kawili-wiling hula sa X:

"Qwen 3.5 Q4 版本只需要 225G,很有实用价值" — @janxin

225GB na VRAM, maaaring patakbuhin sa isang makina. Ibig sabihin, sa unang pagkakataon, maaaring ma-access ng maliliit at katamtamang laki ng mga developer ang isang modelo na malapit sa antas ng GPT-5.

Ang tunay na problema ay hindi kung matatalo ng Qwen 3.5 ang GPT-5.3, kundi: paano kikita ang mga kumpanya ng AI kapag bumaba ang gastos ng mga nangungunang modelo sa halos zero?