Qwen 3.5 Ra Mắt: Mô Hình Trọng Số Mở 397B Tham Số, Chi Phí Giảm 60%

Alibaba vừa mới phát hành Qwen 3.5-397B-A17B. Đây là mô hình trọng số mở đầu tiên của dòng Qwen 3.5.

Dữ liệu cốt lõi

- Tổng số tham số: 397B

- Tham số kích hoạt: 17B per pass (MoE thưa thớt)

- Thông lượng: Tăng 8.6x-19x so với Qwen 3-Max

- Chi phí: Giảm 60% so với Qwen 3

- Hỗ trợ ngôn ngữ: 201 ngôn ngữ (mở rộng từ 119 ngôn ngữ)

Đây không chỉ đơn giản là việc xếp chồng các tham số. Đây là định nghĩa lại hiệu quả.

Đổi mới kiến trúc

Qwen 3.5 sử dụng kiến trúc hỗn hợp:

- Gated Delta Networks + MoE thưa thớt

- Chú ý tuyến tính hỗn hợp: Hầu hết các lớp sử dụng chú ý tuyến tính, mỗi 4 lớp sử dụng chú ý đầy đủ

- Đa phương thức gốc: Không phải thêm vào sau, mà là huấn luyện từ đầu

Trên X có phân tích kỹ thuật:

"Qwen3.5-397B-A17B: Hybrid linear attention + sparse MoE with large-scale RL environment scaling." — @Alibaba_Qwen

Ý nghĩa của kiến trúc này là: Sử dụng 17B tham số kích hoạt để đạt được hiệu suất gần với mô hình 400B. Chi phí suy luận giảm đáng kể.

Tuyên bố hiệu suất

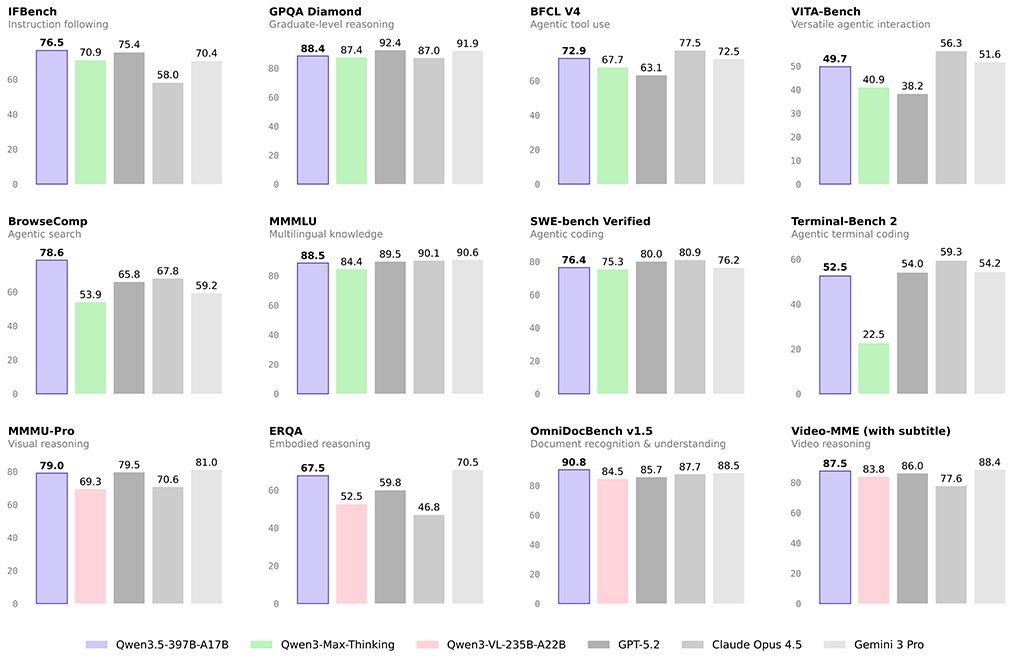

Alibaba tuyên bố Qwen 3.5 đánh bại:

- GPT-5.2

- Claude Opus 4.5

- Gemini 3 Pro

Những người thử nghiệm độc lập trên X bắt đầu xác minh:

"Qwen 3.5-397B dropped today... and the benchmarks are insane. Trading blows with Claude Opus 4.5 and GPT-5.2 across the board." — @antonpme

Nhưng điều quan trọng nhất không phải là điểm chuẩn, mà là khả năng đại diện:

"The agentic capabilities are the real story here. Qwen 3.5 can interact with GUIs, not just understand them. That's the unlock for workflows that touch existing software." — @thebuildrweekly

Kỷ nguyên đại diện

Định vị của Qwen 3.5 rất rõ ràng: Được thiết kế cho kỷ nguyên đại diện.

- Có thể phân tích video 2 giờ

- Có thể độc lập thực hiện các tác vụ trên các ứng dụng

- Có thể hiểu GUI và tương tác với nó

"Qwen 3.5 can independently take actions across apps." — @thebuildrweekly

Điều này có nghĩa là nó không phải là "chatbot", mà là "trình thực thi tác vụ".

Bối cảnh cạnh tranh

Trên X có người tóm tắt các bản phát hành AI trong tuần này:

"This might be the single biggest week in AI history: DeepSeek V4, Gemini 3.1 Pro, GPT-5.3, Qwen 3.5, Claude Sonnet 5." — @HeyAbhishek

Tốc độ của các nhà sản xuất mô hình Trung Quốc rất rõ ràng:

- DeepSeek V4

- Qwen 3.5

- GLM 5

- MiniMax 2.5

Mỗi tuần đều có mô hình mới, mỗi lần đều tuyên bố đánh bại GPT. Đây không phải là marketing, đây là sự leo thang của cuộc chiến chi phí.

Cấu trúc chi phí

Giá token của Qwen 3.5 chỉ bằng 1/18 so với Gemini 3 Pro.

"Qwen 3.5 with performance comparable to Gemini 3, and a token price of only 1/18 of the latter." — @dyz_ob

Khi hiệu suất gần bằng nhau, chi phí chỉ bằng 5%, hào bảo vệ của mô hình nguồn đóng ở đâu?

Điểm mấu chốt

Qwen 3.5 không phải là "GPT của Trung Quốc". Nó là kẻ phá vỡ cấu trúc chi phí:

- 397B tham số, nhưng chỉ kích hoạt 17B

- Trọng số mở, có thể triển khai cục bộ

- Khả năng đại diện, không chỉ là đối thoại

- Chi phí chỉ bằng 5% so với đối thủ cạnh tranh

Trên X có một dự đoán thú vị:

"Qwen 3.5 Q4 版本只需要 225G,很有实用价值" — @janxin

225GB VRAM, có thể chạy trên một máy. Điều này có nghĩa là các nhà phát triển vừa và nhỏ lần đầu tiên có thể tiếp cận mô hình gần cấp GPT-5.

Câu hỏi thực sự không phải là Qwen 3.5 có thể đánh bại GPT-5.3 hay không, mà là: Khi chi phí của các mô hình hàng đầu giảm xuống gần bằng không, các công ty AI kiếm tiền bằng cách nào?