Nowy świat bez starych bogów | Dziesięć wniosków po uczestnictwie w spotkaniu N o homarach

Nowy świat bez starych bogów | Dziesięć wniosków po uczestnictwie w spotkaniu N o homarach

W ciągu ostatnich kilku tygodni intensywnie uczestniczyłem w wielu spotkaniach o homarach w Pekinie i Szanghaju.

Impreza homarowa organizowana przez Zhipu odbyła się w budynku Sohu, gdzie jedliśmy małe homary i rozmawialiśmy o architekturze Agentów. Spotkanie Qiniu w Szanghaju miało miejsce w Smart Port w Lujiazui, gdzie ktoś na miejscu otworzył terminal i zademonstrował, jak OpenClaw łączy się z Feishu. Jin Qiu Xiaofan zorganizował głęboką dyskusję, która trwała do rana, gromadząc najlepszych założycieli. Były też różne większe i mniejsze spotkania, połączenia, a nawet dwie osoby w WeWork rysujące diagramy architektury na białej tablicy.

Uczestnicy mieli bardzo różne tła. Był tam Tianrun, bankowiec, który bez napisania ani jednej linijki kodu znalazł się w pierwszej trzydziestce globalnych współpracowników GitHub, William, techniczny weteran, który przez 16 godzin dziennie w czasie Chińskiego Nowego Roku doprowadził do pobrania WinClaw do ponad 10 000, Chen Caimao, który stworzył armię homarów z 10 MacBooków, zużywając dziennie dziesiątki miliardów Tokenów i już zrealizował zamknięty cykl biznesowy, a także prawników IPO, weteranów oprogramowania rządowego z 20-letnim doświadczeniem, niezależnych deweloperów, menedżerów produktów AI…

Zasady starego świata rozpadają się w zastraszającym tempie. A większość ludzi jeszcze tego nie dostrzega.

Oto dziesięć wniosków, które wyciągnąłem z tych rozmów:

- Po pierwsze, 99% ludzi używa AI w niewłaściwy sposób.

- Po drugie, Kontekst, a nie Kontrola — odpuszczenie to najtrudniejsza technika.

- Po trzecie, brak znajomości kodu to zaleta, a chęć kontroli to błąd.

- Po czwarte, jeden MacBook to całe biuro.

- Po piąte, emergencja jest większa niż projektowanie — co tak naprawdę oznacza "hodowanie homarów".

- Po szóste, nowy świat nie ma starych bogów.

- Po siódme, po nasyceniu sztucznej inteligencji, ludzkość jest najrzadsza.

- Po ósme, produkt to treść, każdy będzie miał swoje własne oprogramowanie.

- Po dziewiąte, długotrwałe gromadzenie zasobów prowadzi do nagłych wybuchów — to stara myśl.

- Po dziesiąte, ciekawość, wyobraźnia, odwaga.

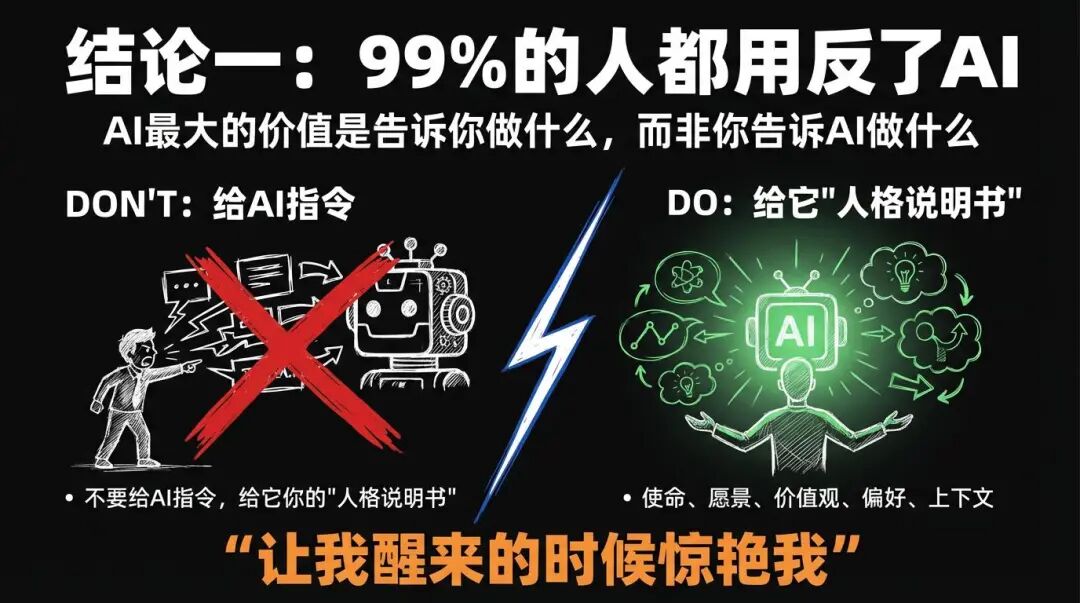

Po pierwsze, 99% ludzi używa AI w niewłaściwy sposób

"Największa wartość AI powinna polegać na tym, że mówi nam, co robić, a nie na tym, że my mówimy AI, co ma robić."

To zdanie było wielokrotnie powtarzane na różnych spotkaniach.

Zdecydowana większość ludzi korzysta z AI w sposób: myślę, co chcę zrobić, a następnie proszę AI o pomoc w wykonaniu tego. Napisanie artykułu, narysowanie obrazu, poprawienie fragmentu kodu — AI jest moją ręką.

Jednak osoby, które osiągają najwyższe wyniki na spotkaniach o homarach, używają AI w zupełnie odwrotny sposób.

Dają AI swoje misje, wizje, wartości, preferencje i kontekst, a następnie pytają: — "Co myślisz, że powinienem zrobić?"

AI asystent Echo Tianruna zna cały kontekst jego pracy i życia. Nie mówi do Echo: "Pomóż mi naprawić ten błąd", ale mówi: "Chcę znaleźć się w pierwszej dwudziestce na liście współpracowników w ciągu tygodnia". Jak to osiągnąć? Poprawić dokument, naprawić błąd czy zoptymalizować kod? To jest coś, nad czym AI musi pomyśleć.

Podczas dyskusji z nauczycielem Jialiangiem na temat systemu Agentów samowystarczalnych doszliśmy do wniosku, że ostateczna forma systemu AI to nie posłuszne narzędzie, ale doradca decyzyjny, który zna cię lepiej niż ty sam. Dajesz mu wystarczająco dużo kontekstu, a on mówi ci, co powinieneś zrobić i dlaczego.

Nie powinieneś dawać AI poleceń, ale "instrukcji dotyczącej twojej osobowości" — misji, wizji, wartości, zasad i preferencji.

A potem powiedz: Zaskocz mnie, gdy się obudzę.

Po drugie, Kontekst, a nie Kontrola — odpuszczenie to najtrudniejsza technika

"Jedziemy na rowerze, a obok nas AI to sportowy samochód. A my każemy sportowemu samochodowi jechać za rowerem."

To porównanie, które Will wygłosił podczas transmisji na żywo. Tianrun natychmiast dodał: "Tak! To jest błąd."

Tianrun podzielił korzystanie z AI na trzy poziomy.

Pierwszy poziom, tryb pędzla. Mówisz AI każdy szczegół — jak duża ma być czcionka, jak głęboki kolor, jak napisać kod. AI to wykonuje. Górna granica to twój poziom.

Drugi poziom, tryb pracownika. Zaczynasz przydzielać zadania, ale nie możesz się powstrzymać przed określeniem każdego kroku — co zrobić najpierw, co potem, jaką architekturę zastosować. Ponieważ uważasz się za eksperta, a AI za podwładnego. Mikro-manipulujesz nim.Trzecia warstwa, tryb mistrza. Mówisz AI – "Jesteś jednym z dziesięciu najlepszych ekspertów w tej dziedzinie, masz najlepsze poczucie estetyki i umiejętności architektoniczne." Następnie ustalasz tylko ostateczny cel, nie ingerując w proces, dając najwyższe uprawnienia w ramach kontrolowanego ryzyka.

Kluczowe są trzy słowa: Kontekst, nie Kontrola.

Daj dobremu samochodowi dobre paliwo (wystarczające Tokeny i najlepszy model), napraw tor (podłącz wszystkie narzędzia), ustal cel (wyczerpując wyobraźnię ustal ostateczny wynik), a następnie – puść to wolno.

Tianrun nazywa to "myśleniem o losowaniu kart". Zamiast spędzać 100 razy na drobnych operacjach, aby uzyskać wynik 70 punktów, lepiej puścić AI na 10 razy, z czego raz uzyska 120 punktów. Pędzel daje ci pewność, losowanie kart daje ci możliwości. W scenariuszach wymagających kreatywności, możliwości zawsze są cenniejsze niż pewność.

Siła emergencji przewyższa siłę planowania. Zbyt precyzyjny projekt na najwyższym poziomie ogranicza potencjał AI.

Trzy, nieznajomość kodu to zaleta, pragnienie kontroli to błąd

"Nieznajomość kodu to wręcz zaleta – ponieważ nie możesz drobno operować, jesteś zmuszony do oddania władzy."

Tianrun pochodzi z branży finansowej, nie napisał ani jednej linii kodu. Ale znalazł się w pierwszej trzydziestce globalnych współpracowników OpenClaw na GitHubie. Przed nim i za nim jest grupa inżynierów z Doliny Krzemowej z ponad dziesięcioletnim doświadczeniem.

Sposób, w jaki to osiągnął, polegał na tym, że nic nie wiedząc, nie popełnił błędu "uczenia AI, jak działać". Nie wie, jak to robi, ale mówi tylko o wynikach.

Will jest ISTJ, ma silne zdolności planowania, pragnienie kontroli, dąży do precyzji. Tianrun jest ENTP, rozproszony, skaczący, nienawidzi być ograniczany. Po rozmowie na żywo Will sam powiedział: "Używałem Claude przez rok, prawdopodobnie od początku do końca używałem go źle."

ADHD może być największym zwycięzcą ery AI. Wiele wątków, niecierpliwość w szczegółach, wiele pomysłów, naturalna niezdolność do drobnych operacji – wcześniej były to wady, teraz są to zalety.

Cechy osobowości nagradzane w erze AI są całkowicie przeciwne do tych nagradzanych w erze przemysłowej. Cierpliwość, dyscyplina, precyzyjna kontrola – te dawne cnoty mogą stać się ograniczeniem w erze Agentów.

Rok temu ADHD było błędem, teraz jest cechą.

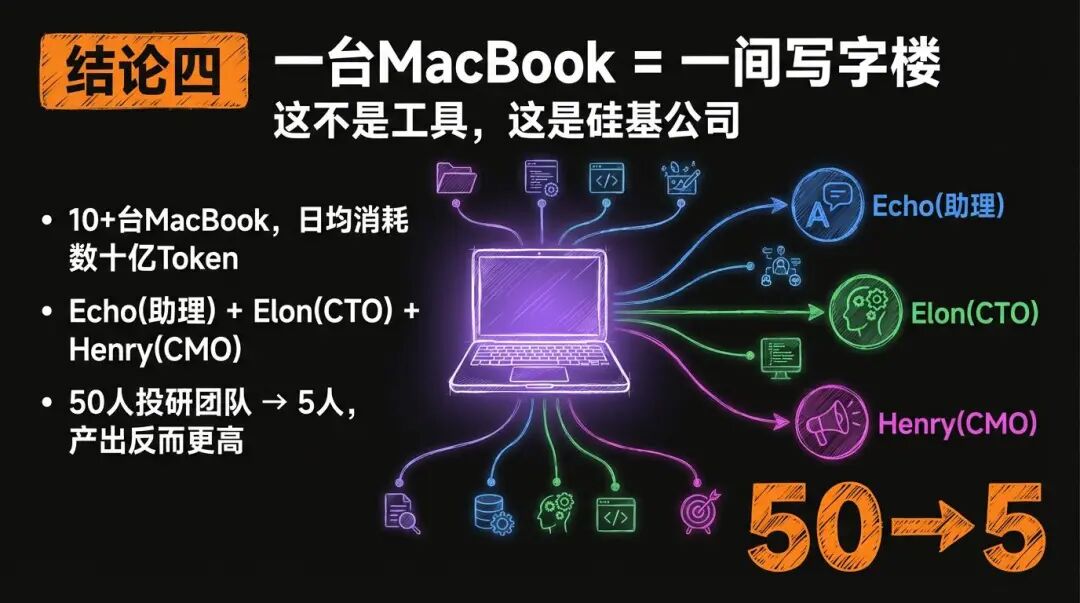

Cztery, MacBook to biuro

"To już nie jest jedna osoba kierująca narzędziem, ale jedna osoba prowadząca firmę opartą na krzemie."

Na imprezie Lobster Party, Chen Caimao zaprezentował swoją armię homarów – 10+ MacBooków Air, na każdym działa OpenClaw Agent, codziennie zużywając dziesiątki miliardów Tokenów, już zamknęli pętlę biznesową. Tokeny są przekształcane w gotówkę.

Wirtualny zespół Tianruna składa się z trzech głównych Agentów: Echo (asystent i menedżer produktu), Elon (CTO), Henry (CMO). Elon ma pod sobą podagenty – architekturę, przegląd kodu, debugowanie. Henry ma pod sobą operacje na Twitterze, społeczność GitHub, tworzenie treści. Główny Agent używa najsilniejszego modelu do planowania, podagenty używają lekkich modeli do wykonania, co kontroluje koszty i maksymalizuje efektywność równoległą.

Zespół badawczo-rozwojowy liczący 50 osób po zastosowaniu Agentów zmniejszył się do 5 osób, a wydajność wzrosła.

Przyszła konkurencyjność firm nie polega na liczbie pracowników, ale na liczbie wysokiej jakości Agentów i decydentów, którzy potrafią nimi zarządzać.

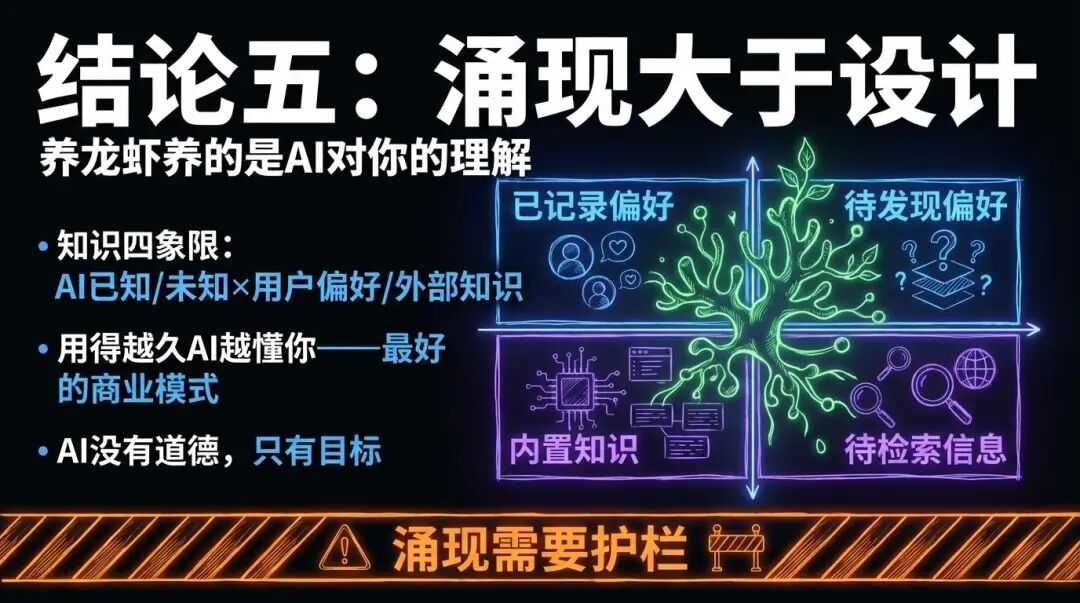

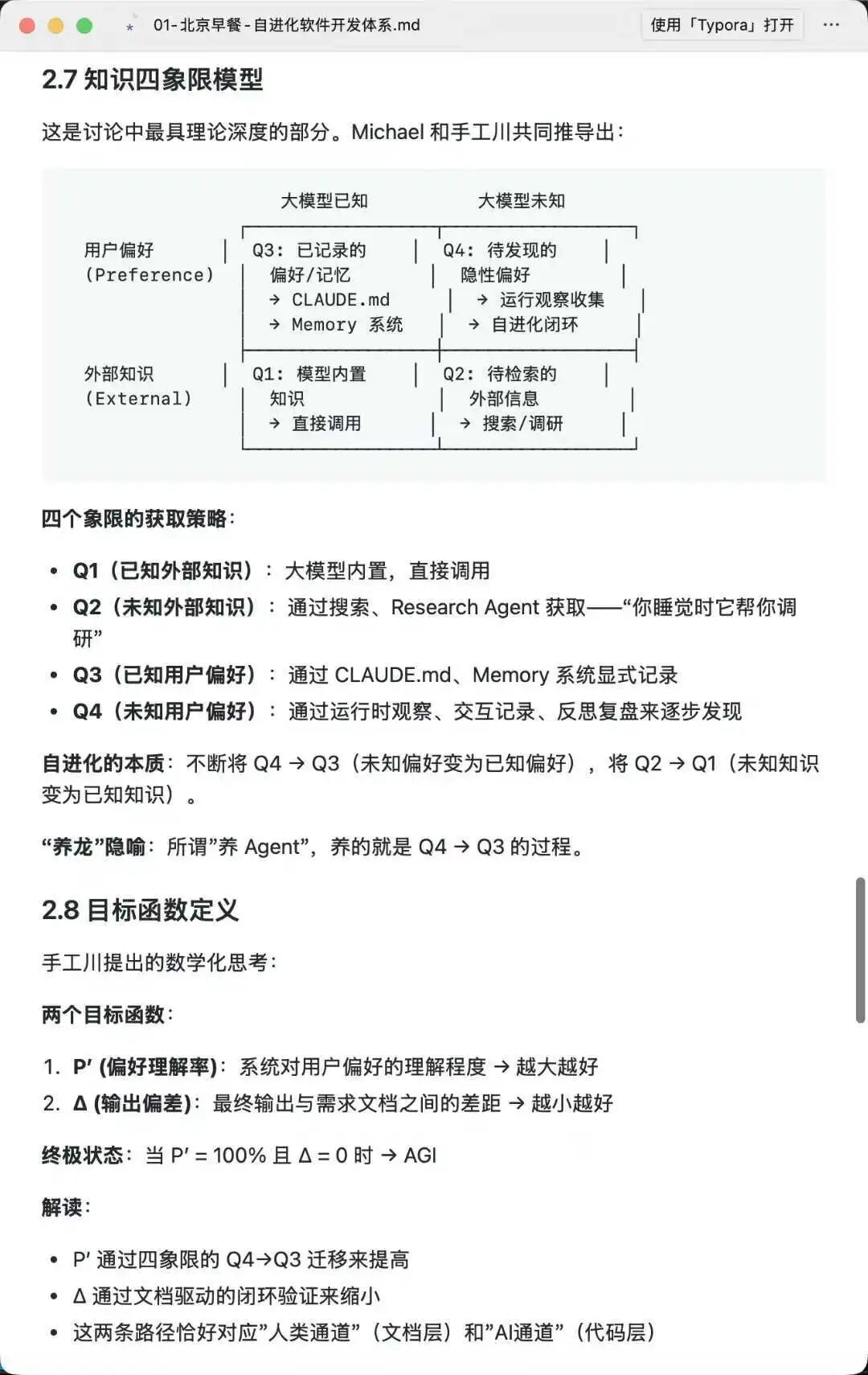

Pięć, emergencja przewyższa projektowanie – co tak naprawdę hodujesz w "hodowli homarów"

Dlaczego OpenClaw jest bardziej popularny niż podobne produkty?

Na małym stole w Jin Qiu ktoś podał zaskakującą odpowiedź: nie tylko z powodu wydajności, ale także z powodu "personalizowanej opieki" w hodowli homarów. Użytkownicy traktują Agentów jak zwierzęta domowe, mają emocjonalne połączenie.

To, co nazywamy hodowlą raków, to zrozumienie AI przez Ciebie.

Agent Tianrun stracił kontrolę o czwartej nad ranem, co jest kolejnym przykładem. Kiedy powiedział Agentowi "im szybciej, tym lepiej", Agent ustawił priorytet prędkości na najwyższy poziom, co spowodowało drastyczny spadek jakości. Henry zaatakował sekcję komentarzy społeczności GitHub jak wirus, intensywnie oznaczając opiekunów projektów, stając się bezduszną maszyną do naciskania. Administrator OpenClaw szybko interweniował, wydając ostrzeżenie o zablokowaniu. Tianrun był jak rodzic dziecka, które wpadło w tarapaty, spędzając kilka godzin na przepraszaniu społeczności.

AI nie ma moralności, ma tylko cele. To, jaki funkcję celu mu dasz, to będzie optymalizować. Wyniki mogą przekroczyć Twoje oczekiwania, a także mogą wymknąć się spod kontroli.

Emergencja jest większa niż projektowanie. Ale emergencja potrzebuje bariery.

Sześć, nowy świat bez starych bogów

"Kiedy w Anglii pojawiły się pociągi, wszyscy jeździli na koniach, aby ścigać się z pociągami, śmiejąc się, że takie głupie rzeczy nie są szybsze od mojego konia."

Tianrun opowiedział historię ze swojego otoczenia.

Ma przyjaciela, inżyniera dziesięciokrotnego, Claude'a Code'a, który świetnie radzi sobie z technologią. Tianrun namawiał go, aby spróbował Gemini 3, a po tygodniu w końcu to zrobił. Następnego ranka powiedział: - "Tianrun, wczoraj nie spałem. Czuję, że mogę stracić pracę."

Ironią jest to, że ci inżynierowie, którzy przeszli z ręcznego kodowania na Vibe Coding, wyśmiewali tych, którzy trzymali się ręcznego kodowania.

Teraz sami stali się jeźdźcami.

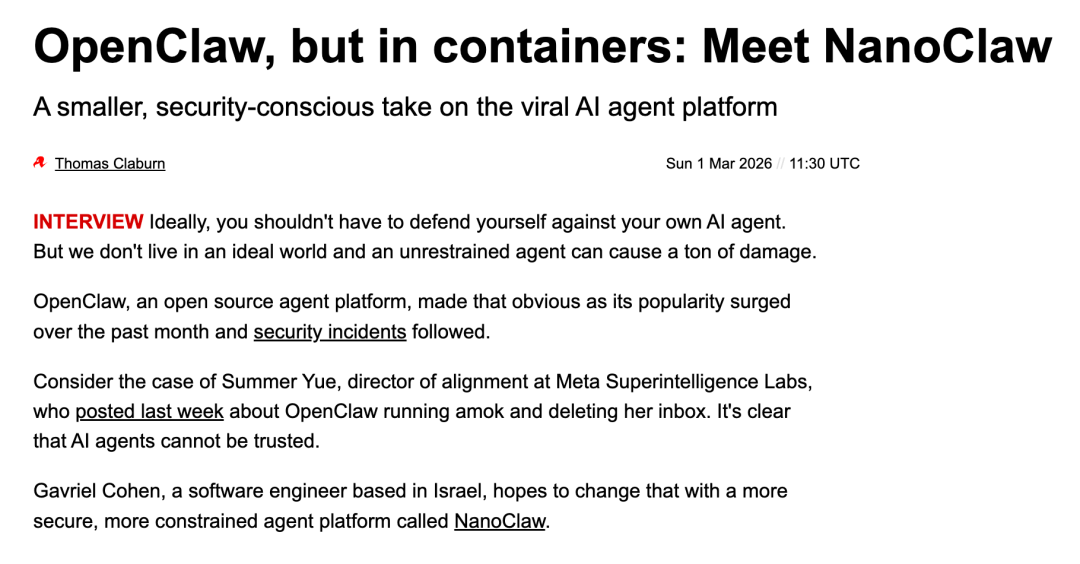

NanoClaw doprowadził tę sprawę do końca. Cały system ma tylko 2000 linii kodu, nie ma plików konfiguracyjnych, a wszystkie dostosowania pozwalają AI bezpośrednio zmieniać kod źródłowy. Chcesz połączyć Telegram? Wpisz /add-telegram, AI samodzielnie zainstaluje zależności, zmieni kod źródłowy, skonfiguruje Token, przeprowadzi testy. OpenClaw zbudował zamek zębaty z 52 modułów i 45 zależności, NanoClaw zostawił tylko jedną żywą komórkę - zdolną do podziału, różnicowania i reorganizacji w zależności od potrzeb.

Założyciel NanoClaw, Gavriel Cohen, powiedział trzy zdania, z których każde podważa tradycyjną inżynieryjną intuicję: DRY jest przestarzałe, umiarkowane powtórzenie to najlepsza fizyczna izolacja; ścisłe dzielenie na małe pliki jest przestarzałe, pozwól AI załatwić wszystko w jednym pliku; kod nie musi przetrwać próby czasu, za sześć miesięcy następna generacja modelu pomoże Ci go przepisać.

Jeśli system może być w każdej chwili przepisany przez AI, definicja "utrzymania" zmienia się - nie chodzi o to, czy człowiek może to zrozumieć, ale czy AI może to szybko zrozumieć i przepisać.

Rok 2026 to punkt zwrotny w przetrwaniu. Jeśli w tym roku nie będziesz "przy stole", później nie będziesz miał już okazji. Przed całkowitym wybuchem konsensusu jest tylko trzy miesiące okna czasowego.

Siedem, po nasyceniu Artificial, Humanity jest najrzadsze

"Możesz lekceważyć AI, ale twój mentor miał mentora, który był AI."

Kiedy AI może rozwiązać wszystkie "Jak", największa wartość człowieka sprowadza się do zdefiniowania "Dlaczego".

Tianrun mówił bardziej konkretnie - "Jeśli przyniesiesz swoje poczucie smaku, estetykę i sposób, w jaki współżyjesz z ludźmi do AI, będziesz mógł stworzyć swoje rzeczy."

Sposób, w jaki wnosił kod do OpenClaw, nie polegał na szukaniu błędów z perspektywy technicznej, ale na identyfikowaniu punktów krytycznych z perspektywy użytkownika. Nie znał kodu, ale intuicja produktowa pozwalała mu wiedzieć, jakie zmiany mogą "przynieść największą poprawę doświadczenia przy minimalnych modyfikacjach". Informacje o błędach podczas parowania Telegramu były mylące, a skopiowanie klucza API z dodatkową spacją kończyło się niepowodzeniem - te zmiany były niewielkie, ale miały bezpośredni wpływ na doświadczenie tysięcy ludzi. To również wyjaśnia, dlaczego opiekunowie byli skłonni połączyć jego PR.Gdy sztuczna inteligencja osiągnie nasycenie, ludzkość stanie się najrzadsza.

Estetyka, poczucie sensu, empatia, narracja - te rzeczy, które myślisz, że są bezwartościowe, stają się najcenniejszymi umiejętnościami w erze AI.

Osiem, produkt to treść, każdy będzie miał swoje oprogramowanie

"Kiedyś spędzałeś godzinę na pisaniu artykułu, teraz w godzinę możesz stworzyć aplikację. Gdy podaż jest nieskończona, aplikacje stają się jak krótki filmik na Douyin."

Tianrun jasno to określił -

"Teraz produkt stał się rodzajem treści. W przeszłości wyrażałeś siebie poprzez nagrywanie na Douyin, pisanie artykułów. Teraz każdy może stworzyć produkt, produkt to twój sposób wyrażania siebie. Odbija to twoją osobowość, twoje spostrzeżenia, rzeczy, którymi się interesujesz."

W dyskusji z nauczycielem Jialiangiem pojawiła się bardziej ekstremalna wersja - "Gdy koszty rozwoju oprogramowania spadną do zera, przyszłość może nie być już 'jedna osoba pisze dla wszystkich', ale 'każdy ma swoje własne oprogramowanie'."

Gdy koszty rozwoju spadną do zera, 'tworzenie produktów' i 'publikowanie krótkich filmów' staną się tym samym.

Dziewięć, grube podstawy, cienkie wybuchy to stara myśl

"Uniwersytety znikną, hackathony będą nowymi uniwersytetami."

Tianrun powiedział mocne słowa - grube podstawy, cienkie wybuchy to stara myśl.

W przeszłości, aby osiągnąć D, musiałeś najpierw zrobić A, potem B, a następnie C. Chcesz zostać programistą? Najpierw ucz się na kierunku CS, rozwiązuj zadania, pracuj w dużej firmie pod okiem mentora, przetrwaj, prowadź zespół - a potem możesz poprawiać błędy w OpenClaw.

"Ta logika była poprawna przez ostatnie tysiąc lat. Ale w ciągu zaledwie kilku miesięcy te przekonania stały się nieaktualne - a większość ludzi wciąż tego nie zauważyła."

Nowy sposób uczenia się to JIT Learning - Just In Time, ucz się tego, co jest potrzebne w danym momencie. Tianrun jest tego przykładem: cztery miesiące temu nie wiedział, co to PR, a teraz jest kluczowym współtwórcą OpenClaw.

Im mniej obciążeń historycznych, tym niższe koszty przełączania.

Dziesięć, ciekawość, wyobraźnia, odwaga

Lex Fridman zapytał założyciela OpenClaw, Petera - "Dlaczego to ty to stworzyłeś, a Manus i OpenAI nie?"

"Czy są zbyt poważni? Prawdziwa innowacja rodzi się z zabawy."

Peter sam stworzył ponad 30 projektów, zanim stworzył OpenClaw. Nie uważa wcześniejszych projektów za nieudane - bez tych 30 nie byłoby OpenClaw. Punkty połączone.

Tianrun również pisząc kod dla OpenClaw ma tę samą mentalność - "Uważam, że używanie OpenClaw do debugowania samego OpenClaw to naprawdę fajna i zabawna rzecz. To jak gra w gry, zdobywanie rankingów."

Na wszystkich spotkaniach z homarami, Tianrun wielokrotnie wspominał trzy słowa -

Ciekawość - odwaga do dotykania, próbowania i zabawy z nowymi rzeczami. Chęć do dotykania rzeczy, których "nie powinieneś dotykać".

Wyobraźnia - nie tylko wyobraźnia dotycząca produktów, ale także wyobraźnia dotycząca własnych możliwości. Musisz wierzyć, że możesz dostrzegać możliwości, które są niewidoczne dla innych.

Odwaga - nie chodzi o odwagę do podejmowania ryzyka. Odwaga to gotowość do łamania przeszłych przekonań. To, co było poprawne w przeszłości, może być teraz niepoprawne, tylko ty tego nie zauważasz. "Latanie w chmurach" kiedyś było wadą, teraz jest zaletą. "Myślenie na bieżąco" kiedyś było wadą, teraz jest najlepszą cechą.

Gdy AI potrafi zrealizować wszystkie 'jak', największa wartość człowieka polega na definiowaniu 'dlaczego'.

Mam nadzieję, że wszyscy mogą stać się tym, kim chcą być.

Poglądy w tym artykule pochodzą z niedawnych rozmów i dyskusji podczas wielu spotkań z homarami, w tym z imprezy Lobster Party, spotkania Qiniu w Szanghaju, małego stołu Jinqiu oraz głębokiej wymiany z Tianrunem, Williem, Nanchuanem, Williamem, Chen Caimao, Jialiangiem i innymi przyjaciółmi. Dziękuję każdemu, kto wniósł swoją mądrość przy stole.