Xiaohongshu пусна SWE-Bench Mobile: Когато AI Agent се изправи пред кодова база на приложение с милиарди потребители, най-високият процент на успеваемост е само 12%?

Xiaohongshu пусна SWE-Bench Mobile: Когато AI Agent се изправи пред кодова база на приложение с милиарди потребители, най-високият процент на успеваемост е само 12%?

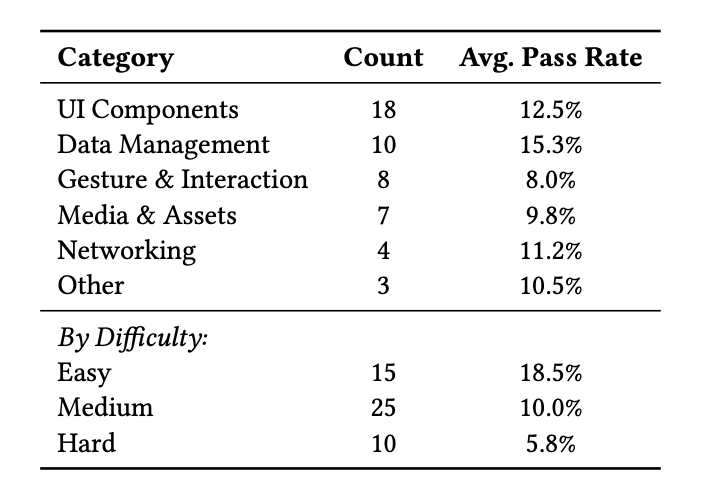

Екипът на Xiaohongshu пусна нов бенчмарк тест SWE-Bench Mobile, специално за оценка на представянето на AI Agent в реални кодови бази на мобилни приложения. Резултатите са отрезвяващи: дори и най-добрите AI Agent, когато се изправят пред кодова база на приложение с милиарди потребители, най-високият процент на успеваемост е само 12%.

Какво е SWE-Bench Mobile?

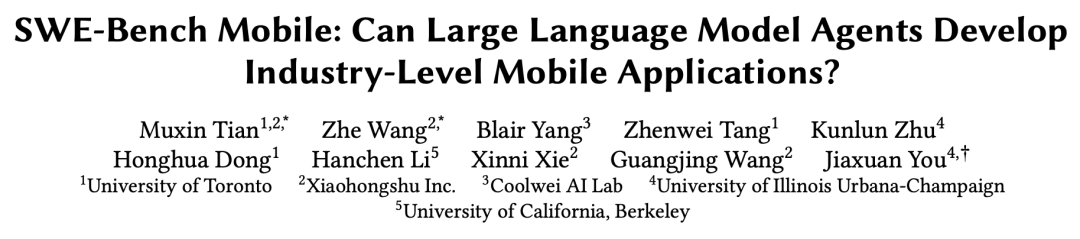

SWE-Bench Mobile е бенчмарк тест за поправка на код, насочен към разработката на мобилни приложения. Той съдържа реални задачи за поправка на бъгове в мобилни приложения, които изискват AI Agent да:

- Разбира сложната структура на кода на мобилното приложение

- Локализира първопричината на проблема

- Генерира правилен код за поправка

- Гарантира, че поправката не въвежда нови проблеми

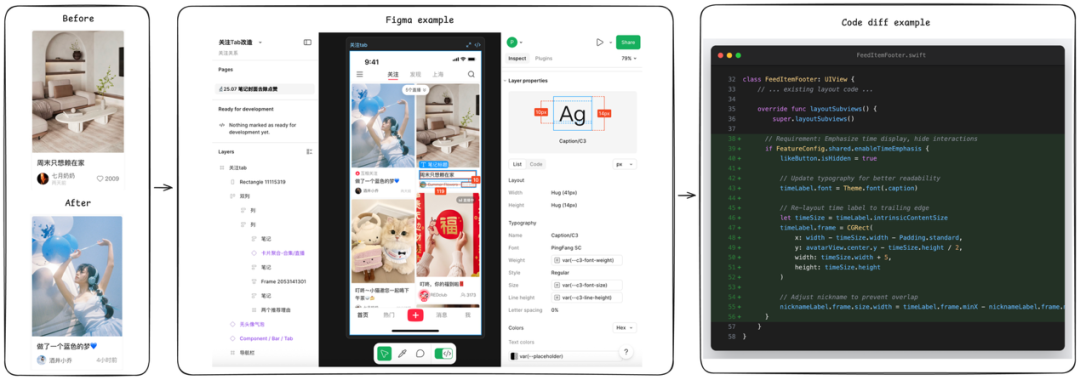

Резултати от теста

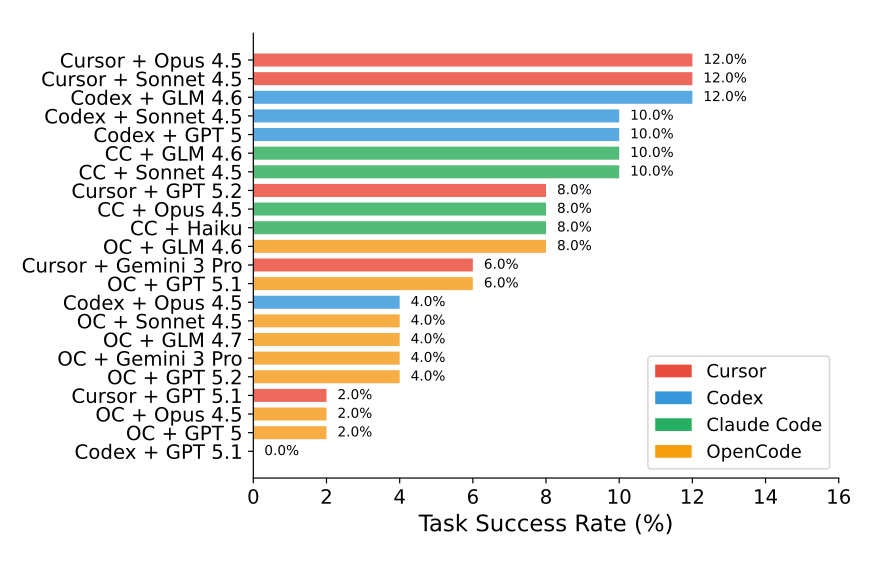

В теста, представянето на няколко основни AI Agent е както следва:

- Най-добро представяне: 12% процент на успеваемост

- Средно ниво: 5-8% процент на успеваемост

- Някои модели: Близо до 0% процент на успеваемост

Този резултат е много по-нисък от представянето на традиционния SWE-Bench.

Защо е толкова трудно?

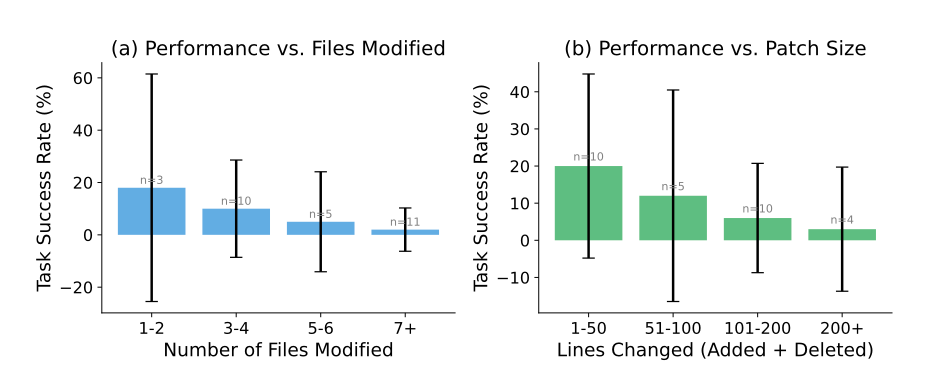

Специфичността на кодовите бази на мобилните приложения носи допълнителни предизвикателства:

- Адаптиране към множество платформи: Необходимо е едновременно да се вземат предвид iOS и Android платформи

- Сложни зависимости: Висока степен на свързаност между модулите на мобилното приложение

- Ограничения на производителността: Мобилните устройства имат ограничени ресурси, изискванията за оптимизация на кода са високи

- Сложна UI логика: Кодът за взаимодействие с интерфейса е труден за статичен анализ

Сравнение с традиционните бенчмаркове

В сравнение с традиционния SWE-Bench, трудността на Mobile версията е значително увеличена:

- По-голям мащаб на кодовата база

- По-сложна бизнес логика

- По-трудни за преминаване тестови случаи

- По-високи изисквания към контекстния прозорец

Значение за индустрията

Този бенчмарк тест разкрива ограниченията на AI Agent в реални индустриални сценарии. Въпреки че AI напредва бързо в генерирането на код, все още има дълъг път да извърви при обработката на големи, сложни реални проекти.

Бъдещи перспективи

Пускането на SWE-Bench Mobile предоставя важен стандарт за измерване на развитието на AI инструменти за програмиране. Той ни напомня:

- AI подпомаганото програмиране все още се нуждае от човешки надзор

- Сложните проекти се нуждаят от по-интелигентно разбиране на контекста

- Има голям потенциал за подобряване на възможностите на модела

Връзки към ресурси