Xiaohongshu udgiver SWE-Bench Mobile: Når AI-agenter står over for kodebaser med hundrede millioner bruger-apps, er den højeste beståelsesprocent kun 12%?

Xiaohongshu udgiver SWE-Bench Mobile: Når AI-agenter står over for kodebaser med hundrede millioner bruger-apps, er den højeste beståelsesprocent kun 12%?

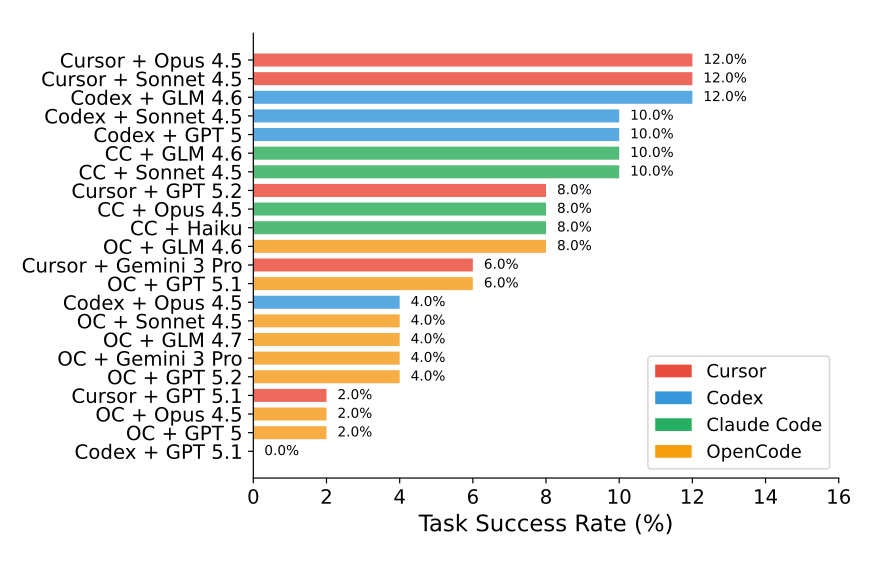

Xiaohongshu-teamet har udgivet en ny benchmark-test, SWE-Bench Mobile, der er specielt designet til at evaluere AI-agenters ydeevne på virkelige mobile applikationskodebaser. Resultaterne er tankevækkende: Selv de bedste AI-agenter har kun en beståelsesprocent på 12%, når de står over for kodebasen for en app med hundrede millioner brugere.

Hvad er SWE-Bench Mobile?

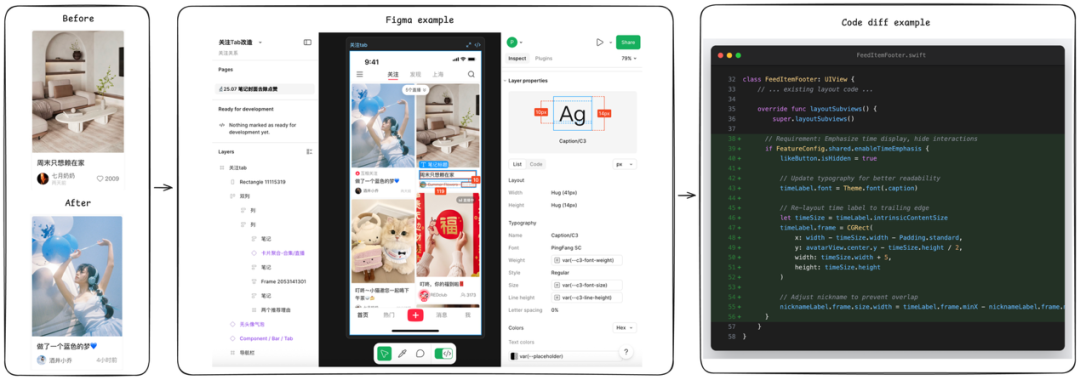

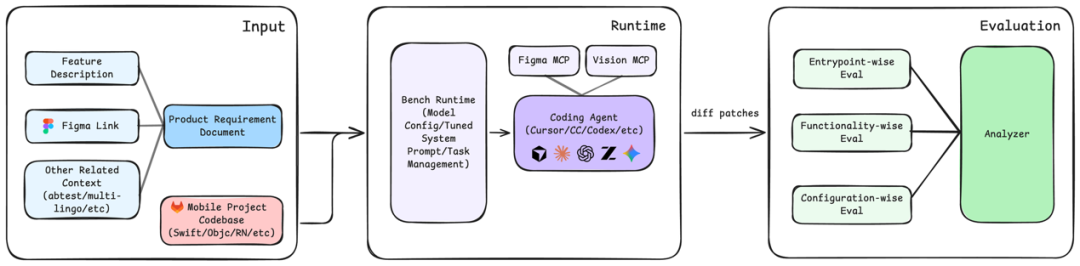

SWE-Bench Mobile er en benchmark-test for kodefejlrettelser til udvikling af mobile applikationer. Den indeholder virkelige fejlrettelsesopgaver for mobile applikationer, der kræver, at AI-agenter er i stand til at:

- Forstå komplekse kodestrukturer for mobile applikationer

- Lokalisere roden til problemer

- Generere den korrekte rettelseskode

- Sikre, at rettelsen ikke introducerer nye problemer

Testresultater

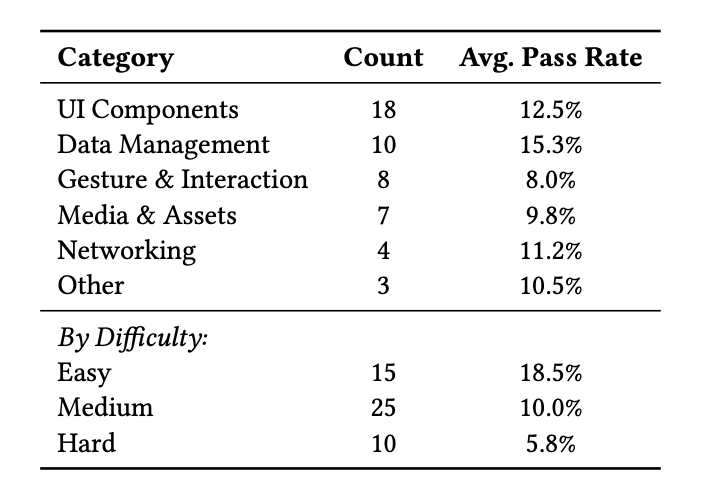

I testen var ydeevnen for flere almindelige AI-agenter som følger:

- Bedste ydeevne: 12% beståelsesprocent

- Gennemsnitligt niveau: 5-8% beståelsesprocent

- Nogle modeller: Næsten 0% beståelsesprocent

Dette resultat er langt lavere end ydeevnen på den traditionelle SWE-Bench.

Hvorfor er det så svært?

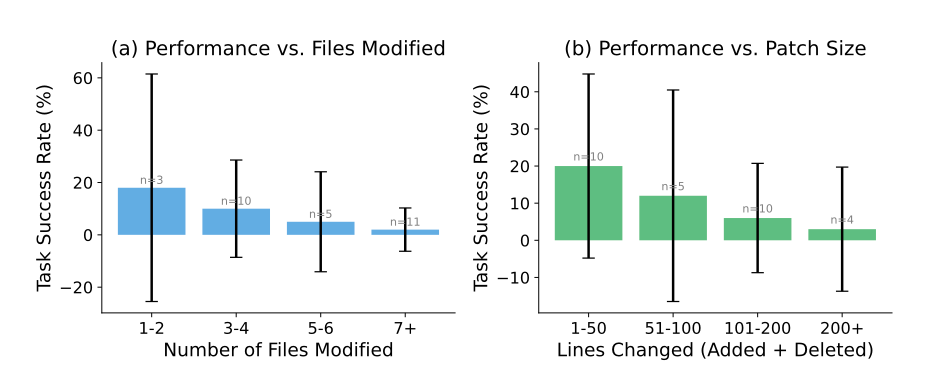

De særlige forhold ved kodebasen for mobile applikationer giver yderligere udfordringer:

- Multi-platform tilpasning: Skal samtidig tage hensyn til iOS- og Android-platforme

- Komplekse afhængigheder: Høj kobling mellem moduler i mobile applikationer

- Ydelsesbegrænsninger: Begrænsede ressourcer på mobile enheder, høje krav til kodeoptimering

- Kompleks UI-logik: Grænsefladeinteraktionskode er vanskelig at analysere statisk

Sammenligning med traditionelle benchmarks

Sammenlignet med den traditionelle SWE-Bench er sværhedsgraden af Mobile-versionen markant forøget:

- Større kodebase

- Mere kompleks forretningslogik

- Testcases er sværere at bestå

- Højere krav til kontekstvindue

Branchemæssig betydning

Denne benchmark-test afslører begrænsningerne ved AI-agenter i virkelige industrielle scenarier. Selvom AI gør hurtige fremskridt inden for kodegenerering, er der stadig lang vej igen, når det kommer til at håndtere store, komplekse virkelige projekter.

Fremtidsperspektiver

Udgivelsen af SWE-Bench Mobile giver en vigtig målestok for udviklingen af AI-programmeringsværktøjer. Det minder os om, at:

- AI-assisteret programmering stadig kræver menneskelig overvågning

- Komplekse projekter kræver mere intelligent kontekstforståelse

- Modelkapaciteten har stadig et stort forbedringspotentiale

Ressourcelinks