Xiaohongshu veröffentlicht SWE-Bench Mobile: Nur 12% Erfolgsquote für KI-Agenten bei Codebasis einer App mit hunderten Millionen Nutzern?

Xiaohongshu veröffentlicht SWE-Bench Mobile: Nur 12% Erfolgsquote für KI-Agenten bei Codebasis einer App mit hunderten Millionen Nutzern?

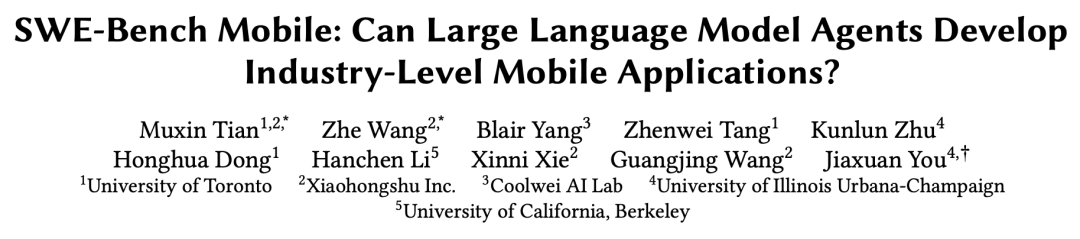

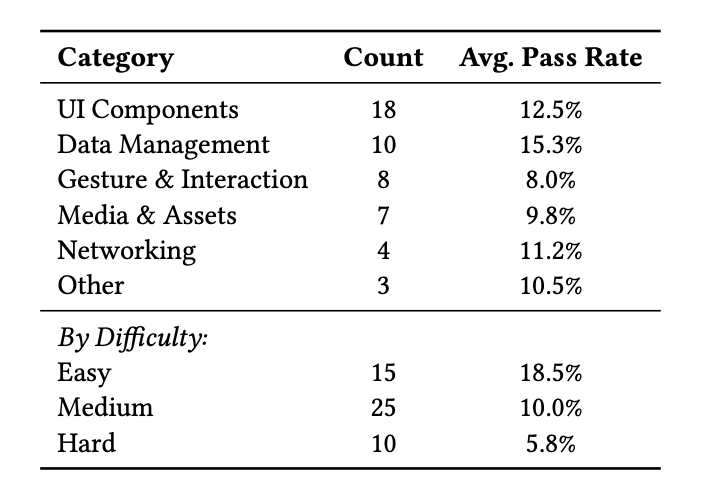

Das Xiaohongshu-Team hat einen neuen Benchmark namens SWE-Bench Mobile veröffentlicht, der speziell zur Bewertung der Leistung von KI-Agenten auf realen mobilen Anwendungscodebasen dient. Die Ergebnisse sind ernüchternd: Selbst die besten KI-Agenten erreichen bei der Codebasis einer App mit hunderten Millionen Nutzern eine Erfolgsquote von nur 12%.

Was ist SWE-Bench Mobile?

SWE-Bench Mobile ist ein Benchmark für die Code-Reparatur in der Entwicklung mobiler Anwendungen. Er enthält reale Bugfix-Aufgaben für mobile Anwendungen, die von KI-Agenten Folgendes verlangen:

- Verstehen komplexer Code-Strukturen mobiler Anwendungen

- Lokalisieren der Ursachen von Problemen

- Generieren des korrekten Reparaturcodes

- Sicherstellen, dass die Reparatur keine neuen Probleme verursacht

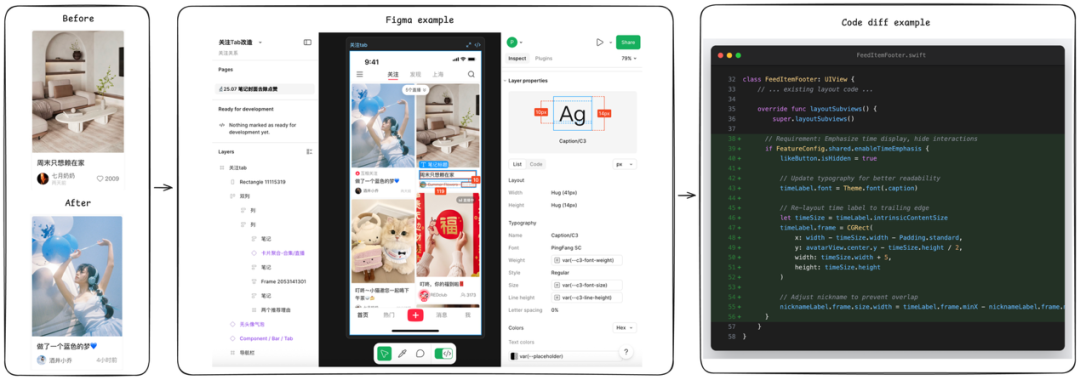

Testergebnisse

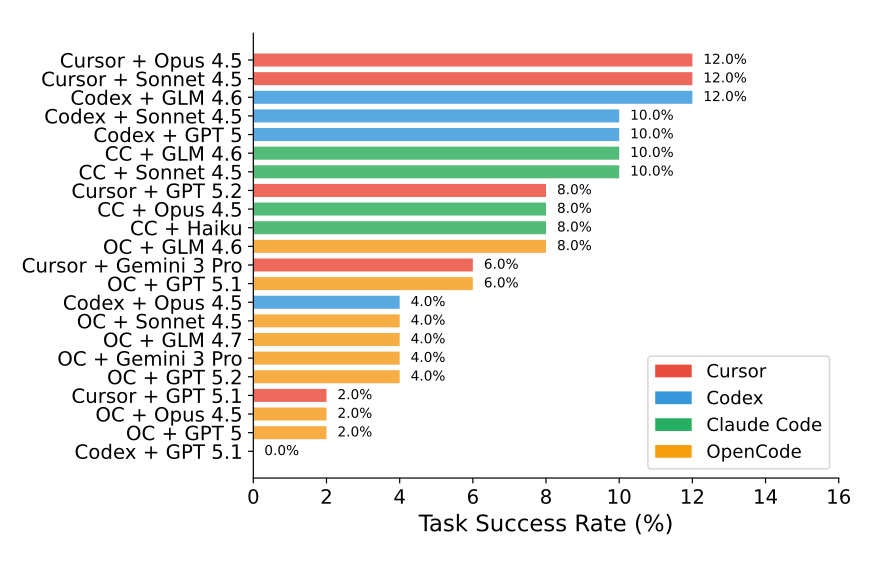

Im Test zeigten mehrere Mainstream-KI-Agenten die folgende Leistung:

- Beste Leistung: 12% Erfolgsquote

- Durchschnittliches Niveau: 5-8% Erfolgsquote

- Einige Modelle: Nahezu 0% Erfolgsquote

Dieses Ergebnis liegt weit unter der Leistung auf dem traditionellen SWE-Bench.

Warum ist es so schwer?

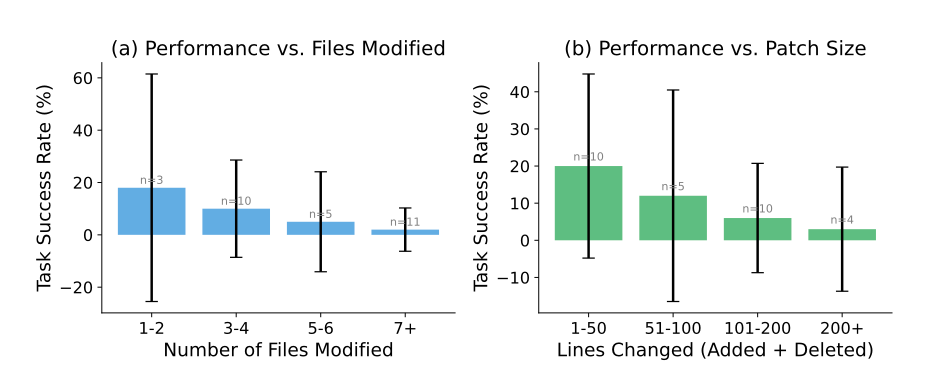

Die Besonderheit der Codebasis mobiler Anwendungen bringt zusätzliche Herausforderungen mit sich:

- Multi-Plattform-Anpassung: iOS- und Android-Plattformen müssen gleichzeitig berücksichtigt werden

- Komplexe Abhängigkeiten: Die Module mobiler Anwendungen sind stark miteinander gekoppelt

- Leistungsbeschränkungen: Mobile Geräte haben begrenzte Ressourcen, daher sind hohe Anforderungen an die Code-Optimierung erforderlich

- Komplexe UI-Logik: Interaktionscode der Benutzeroberfläche ist schwer statisch zu analysieren

Vergleich mit traditionellen Benchmarks

Im Vergleich zum traditionellen SWE-Bench ist die Mobile-Version deutlich schwieriger:

- Größerer Umfang der Codebasis

- Komplexere Geschäftslogik

- Schwieriger zu bestehende Testfälle

- Höhere Anforderungen an das Kontextfenster

Branchenbedeutung

Dieser Benchmark zeigt die Grenzen von KI-Agenten in realen industriellen Szenarien auf. Obwohl die KI bei der Codegenerierung rasante Fortschritte macht, hat sie bei der Bearbeitung großer, komplexer realer Projekte noch einen langen Weg vor sich.

Zukunftsausblick

Die Veröffentlichung von SWE-Bench Mobile bietet einen wichtigen Maßstab für die Entwicklung von KI-Programmierwerkzeugen. Es erinnert uns daran:

- KI-gestützte Programmierung erfordert weiterhin menschliche Aufsicht

- Komplexe Projekte erfordern ein intelligenteres Kontextverständnis

- Die Modellfähigkeiten haben noch viel Verbesserungspotenzial

Ressourcenlinks