小红书 lanza SWE-Bench Mobile: Cuando un Agente de IA se enfrenta a una base de código de App con cientos de millones de usuarios, ¿la tasa de aprobación máxima es solo del 12%?

小红书 lanza SWE-Bench Mobile: Cuando un Agente de IA se enfrenta a una base de código de App con cientos de millones de usuarios, ¿la tasa de aprobación máxima es solo del 12%?

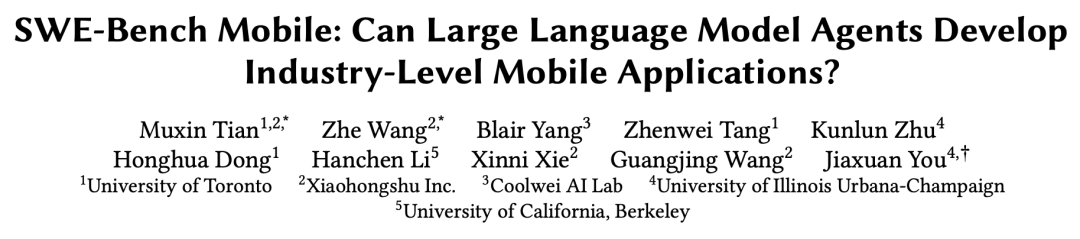

El equipo de 小红书 ha lanzado un nuevo benchmark, SWE-Bench Mobile, diseñado específicamente para evaluar el rendimiento de los Agentes de IA en bases de código de aplicaciones móviles reales. Los resultados son reveladores: incluso los mejores Agentes de IA, al enfrentarse a la base de código de una App con cientos de millones de usuarios, tienen una tasa de aprobación máxima de solo el 12%.

¿Qué es SWE-Bench Mobile?

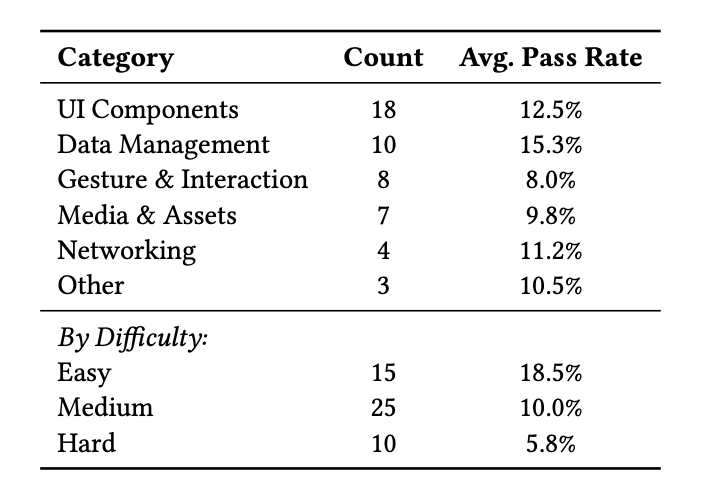

SWE-Bench Mobile es un benchmark para la reparación de código en el desarrollo de aplicaciones móviles. Contiene tareas reales de reparación de bugs en aplicaciones móviles, que requieren que el Agente de IA sea capaz de:

- Entender la estructura compleja del código de la aplicación móvil

- Localizar la raíz del problema

- Generar el código de reparación correcto

- Asegurar que la reparación no introduzca nuevos problemas

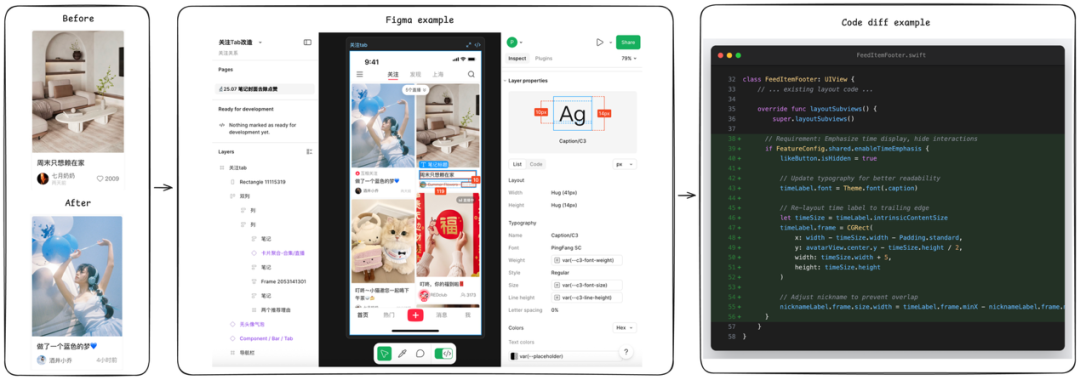

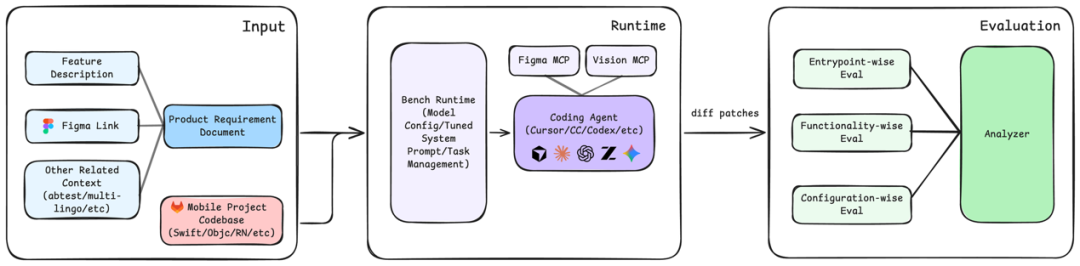

Resultados de las pruebas

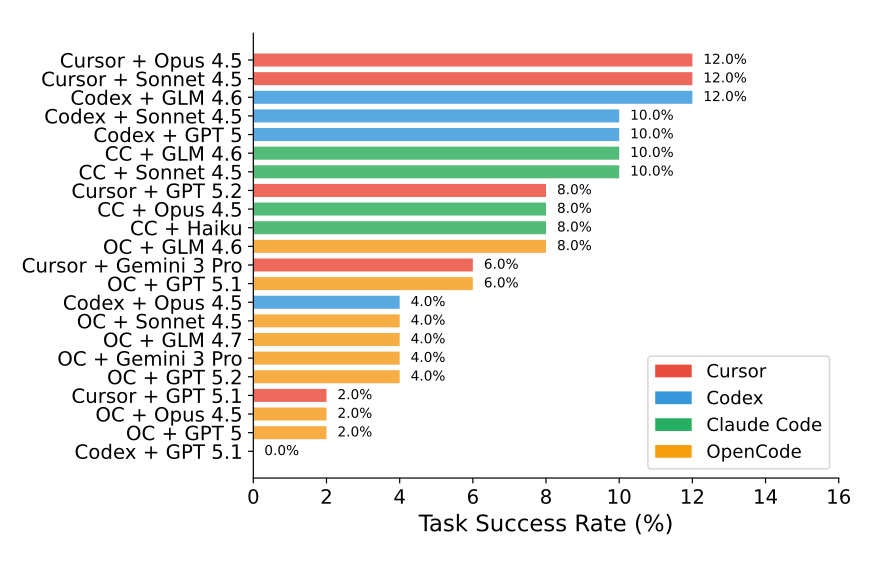

En las pruebas, el rendimiento de varios Agentes de IA principales fue el siguiente:

- Mejor rendimiento: 12% de tasa de aprobación

- Nivel promedio: 5-8% de tasa de aprobación

- Algunos modelos: Cerca del 0% de tasa de aprobación

Este resultado es mucho menor que el rendimiento en el SWE-Bench tradicional.

¿Por qué es tan difícil?

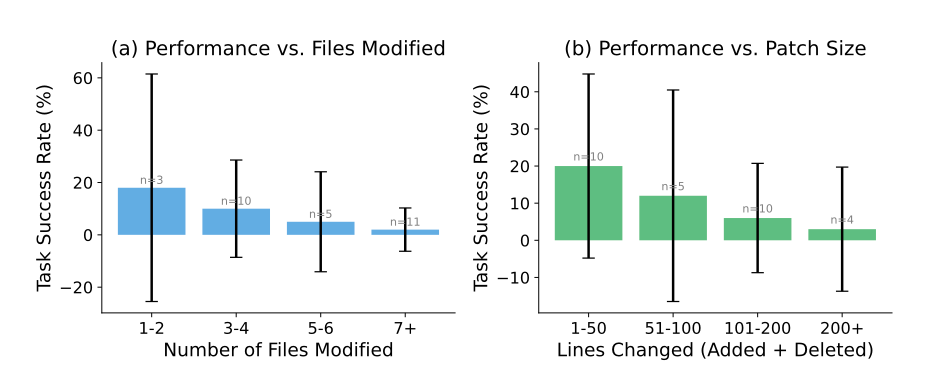

La particularidad de las bases de código de aplicaciones móviles presenta desafíos adicionales:

- Adaptación multi-plataforma: Necesidad de considerar simultáneamente las plataformas iOS y Android

- Relaciones de dependencia complejas: Alto grado de acoplamiento entre los módulos de la aplicación móvil

- Restricciones de rendimiento: Recursos limitados en dispositivos móviles, altos requisitos de optimización del código

- Lógica de UI compleja: El código de interacción de la interfaz es difícil de analizar estáticamente

Comparación con benchmarks tradicionales

En comparación con el SWE-Bench tradicional, la dificultad de la versión Mobile aumenta significativamente:

- Mayor escala de la base de código

- Lógica de negocio más compleja

- Casos de prueba más difíciles de aprobar

- Mayores requisitos de ventana de contexto

Significado para la industria

Este benchmark revela las limitaciones de los Agentes de IA en escenarios industriales reales. Aunque la IA ha progresado rápidamente en la generación de código, todavía queda un largo camino por recorrer para manejar proyectos reales grandes y complejos.

Perspectivas futuras

El lanzamiento de SWE-Bench Mobile proporciona un estándar de medición importante para el desarrollo de herramientas de programación con IA. Nos recuerda que:

- La programación asistida por IA todavía necesita supervisión humana

- Los proyectos complejos necesitan una comprensión del contexto más inteligente

- La capacidad del modelo tiene mucho margen de mejora

Enlaces de recursos