Xiaohongshu publie SWE-Bench Mobile : Lorsque l'IA Agent est confronté à une base de code d'application avec des centaines de millions d'utilisateurs, le taux de réussite maximal n'est que de 12 % ?

Xiaohongshu publie SWE-Bench Mobile : Lorsque l'IA Agent est confronté à une base de code d'application avec des centaines de millions d'utilisateurs, le taux de réussite maximal n'est que de 12 % ?

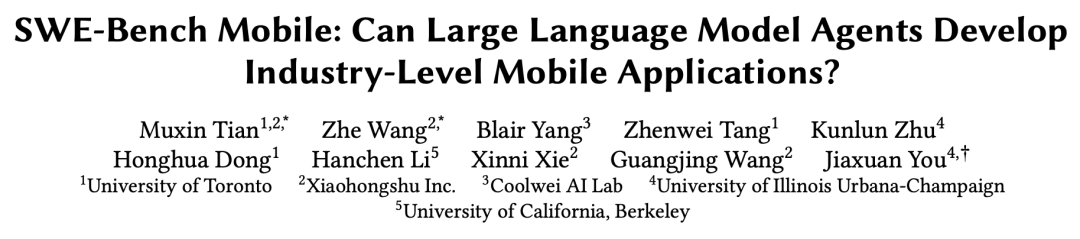

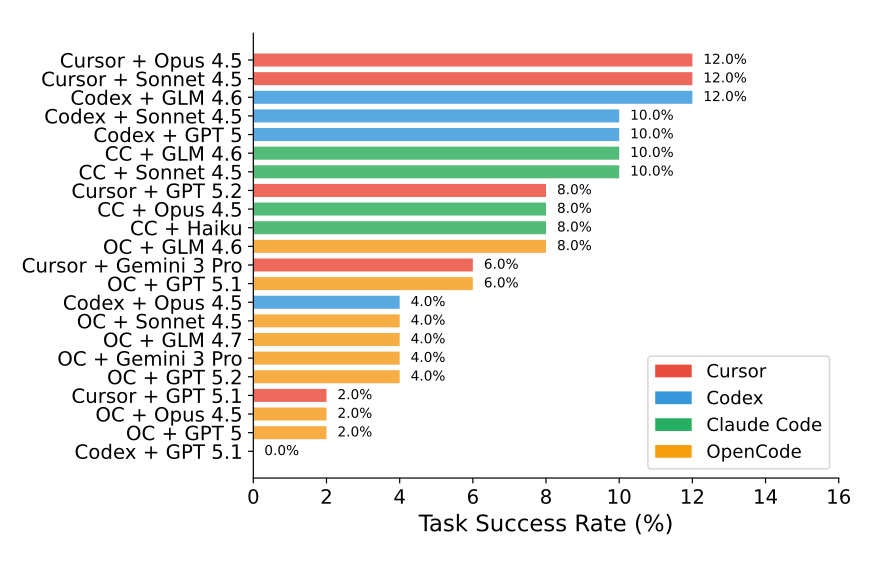

L'équipe de Xiaohongshu a publié un nouveau test de référence, SWE-Bench Mobile, spécialement conçu pour évaluer les performances de l'IA Agent sur des bases de code d'applications mobiles réelles. Les résultats sont révélateurs : même les meilleurs IA Agents n'atteignent qu'un taux de réussite maximal de 12 % lorsqu'ils sont confrontés à la base de code d'une application utilisée par des centaines de millions d'utilisateurs.

Qu'est-ce que SWE-Bench Mobile ?

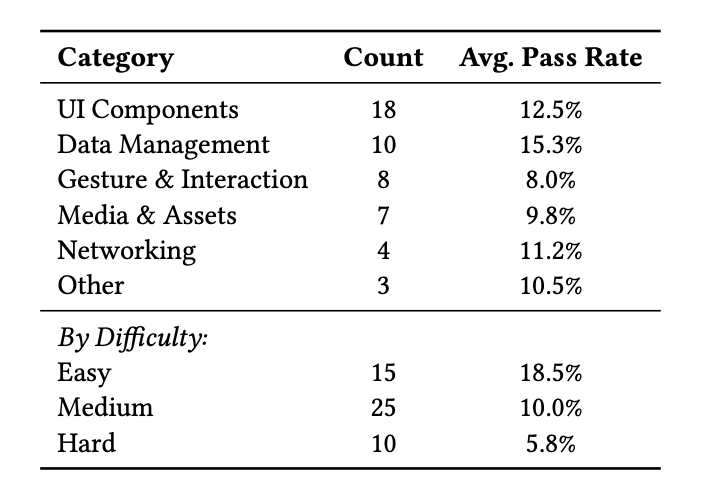

SWE-Bench Mobile est un test de référence pour la correction de code ciblant le développement d'applications mobiles. Il comprend des tâches de correction de bugs d'applications mobiles réelles, exigeant que l'IA Agent soit capable de :

- Comprendre la structure complexe du code d'une application mobile

- Localiser la cause profonde des problèmes

- Générer le code de correction correct

- S'assurer que la correction n'introduit pas de nouveaux problèmes

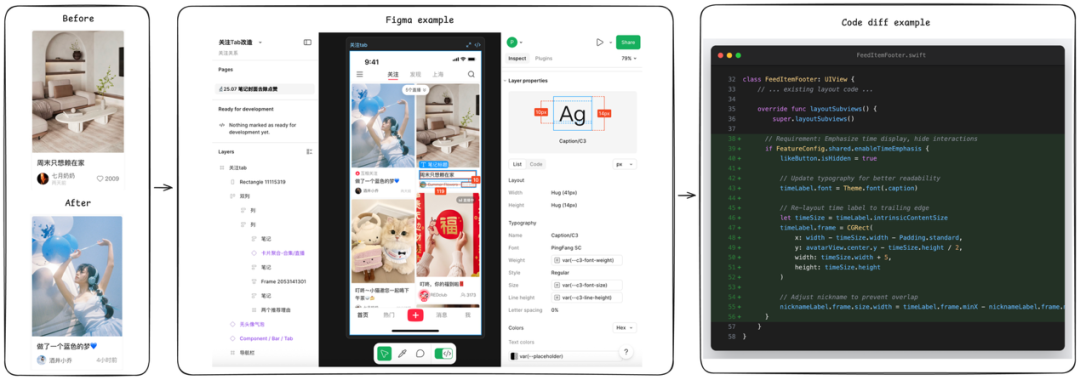

Résultats des tests

Lors des tests, les performances de plusieurs IA Agents courants étaient les suivantes :

- Meilleure performance : taux de réussite de 12 %

- Niveau moyen : taux de réussite de 5 à 8 %

- Certains modèles : taux de réussite proche de 0 %

Ce résultat est bien inférieur aux performances obtenues sur le SWE-Bench traditionnel.

Pourquoi est-ce si difficile ?

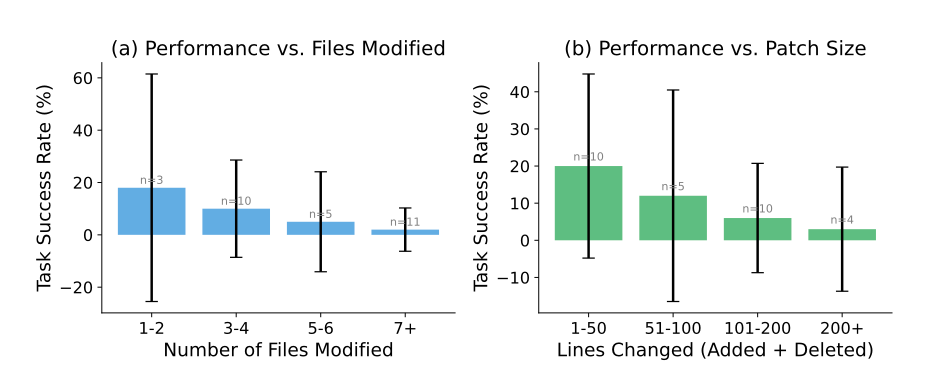

La spécificité des bases de code d'applications mobiles pose des défis supplémentaires :

- Adaptation multiplateforme : Nécessité de prendre en compte simultanément les plateformes iOS et Android

- Relations de dépendance complexes : Le couplage entre les modules d'une application mobile est élevé

- Contraintes de performance : Les ressources des appareils mobiles sont limitées, les exigences d'optimisation du code sont élevées

- Logique d'interface utilisateur complexe : Le code d'interaction de l'interface est difficile à analyser statiquement

Comparaison avec les tests de référence traditionnels

Par rapport au SWE-Bench traditionnel, la difficulté de la version Mobile est considérablement accrue :

- La taille de la base de code est plus importante

- La logique métier est plus complexe

- Les cas de test sont plus difficiles à réussir

- Les exigences de la fenêtre de contexte sont plus élevées

Signification pour l'industrie

Ce test de référence révèle les limites de l'IA Agent dans des scénarios industriels réels. Bien que l'IA progresse rapidement dans la génération de code, il reste encore un long chemin à parcourir pour traiter des projets réels vastes et complexes.

Perspectives d'avenir

La publication de SWE-Bench Mobile fournit une norme de mesure importante pour le développement d'outils de programmation d'IA. Il nous rappelle que :

- La programmation assistée par l'IA nécessite toujours une supervision humaine

- Les projets complexes nécessitent une compréhension du contexte plus intelligente

- La capacité du modèle a encore beaucoup de place pour l'amélioration

Liens de ressources

- Article : https://arxiv.org/abs/xxxxx

- GitHub : https://github.com/xiaohongshu/swe-bench-mobile