XIAOHONGSHU lancia SWE-Bench Mobile: quando un AI Agent si confronta con un codebase di un'app con centinaia di milioni di utenti, il tasso di successo massimo è solo del 12%?

XIAOHONGSHU lancia SWE-Bench Mobile: quando un AI Agent si confronta con un codebase di un'app con centinaia di milioni di utenti, il tasso di successo massimo è solo del 12%?

Il team di XIAOHONGSHU ha rilasciato un nuovo benchmark, SWE-Bench Mobile, specificamente progettato per valutare le prestazioni degli AI Agent su codebase di applicazioni mobile reali. I risultati sono preoccupanti: anche i migliori AI Agent, di fronte al codebase di un'app con centinaia di milioni di utenti, raggiungono un tasso di successo massimo di solo il 12%.

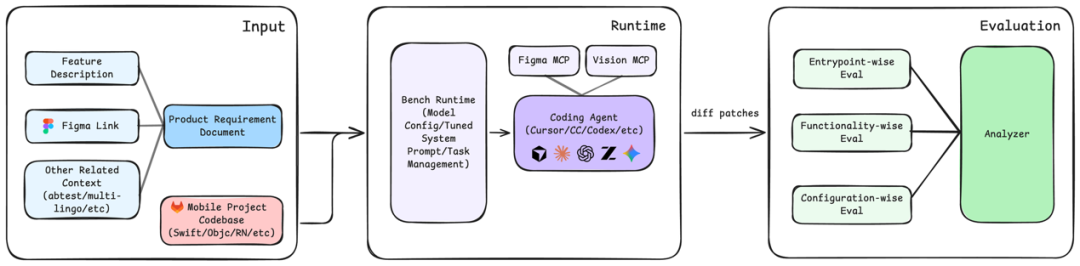

Cos'è SWE-Bench Mobile?

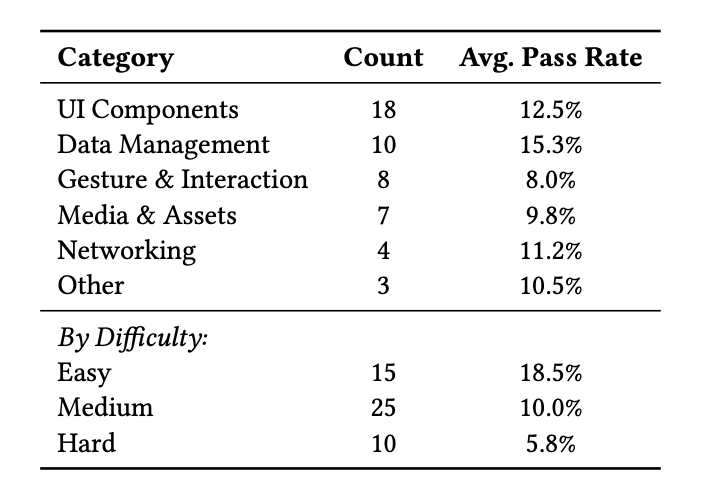

SWE-Bench Mobile è un benchmark per la correzione di codice specifico per lo sviluppo di applicazioni mobile. Include task di correzione di bug reali in applicazioni mobile, che richiedono all'AI Agent di:

- Comprendere la complessa struttura del codice di un'applicazione mobile

- Localizzare la causa principale del problema

- Generare il codice di correzione corretto

- Assicurarsi che la correzione non introduca nuovi problemi

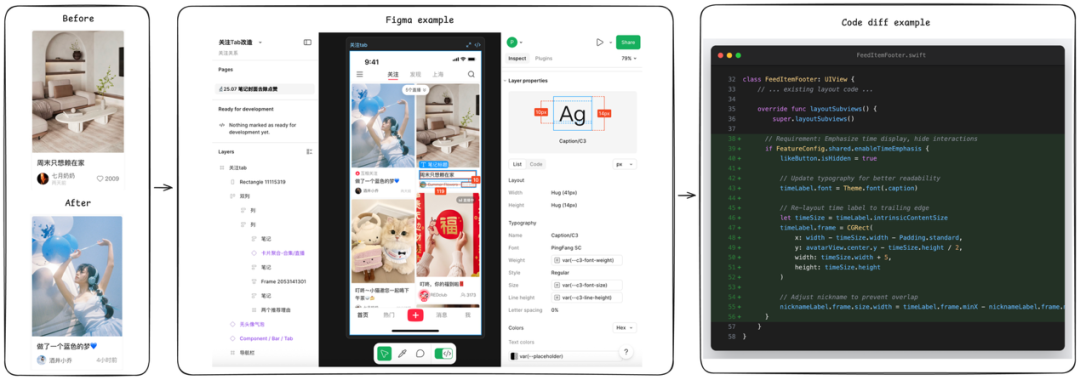

Risultati dei test

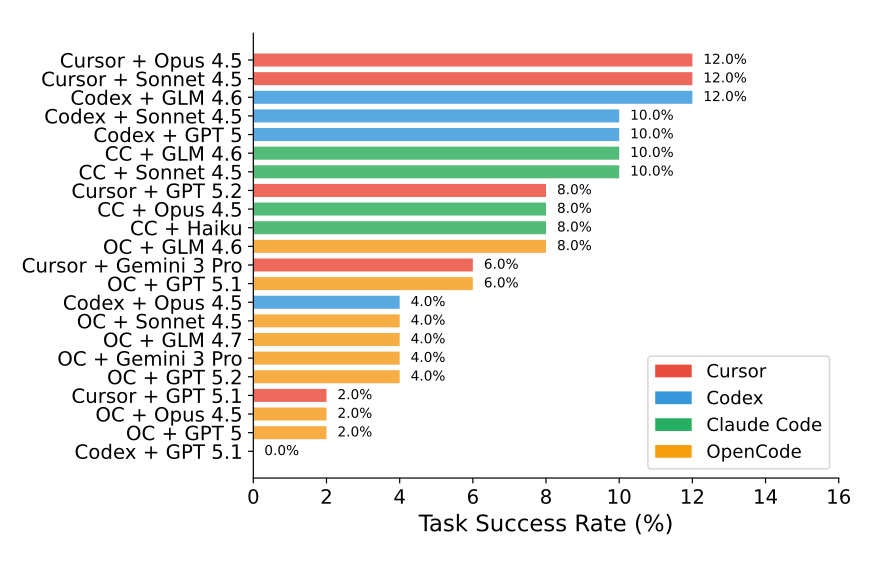

Nei test, le prestazioni di diversi AI Agent principali sono state le seguenti:

- Migliore performance: 12% di tasso di successo

- Livello medio: 5-8% di tasso di successo

- Alcuni modelli: tasso di successo vicino allo 0%

Questo risultato è significativamente inferiore alle prestazioni sul tradizionale SWE-Bench.

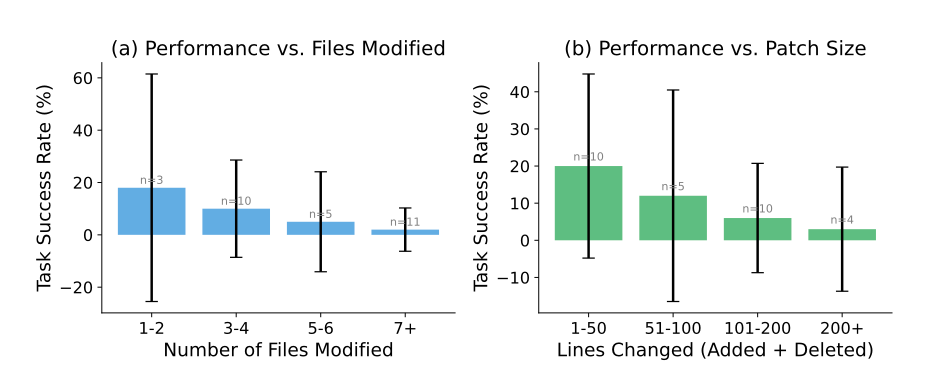

Perché è così difficile?

Le specificità del codebase di un'applicazione mobile comportano ulteriori sfide:

- Adattamento multi-piattaforma: è necessario considerare contemporaneamente le piattaforme iOS e Android

- Relazioni di dipendenza complesse: l'accoppiamento tra i moduli delle applicazioni mobile è elevato

- Vincoli di performance: le risorse dei dispositivi mobile sono limitate, i requisiti di ottimizzazione del codice sono elevati

- Logica dell'interfaccia utente complessa: il codice di interazione dell'interfaccia è difficile da analizzare staticamente

Confronto con i benchmark tradizionali

Rispetto al tradizionale SWE-Bench, la difficoltà della versione Mobile è significativamente aumentata:

- La dimensione del codebase è maggiore

- La logica di business è più complessa

- I casi di test sono più difficili da superare

- I requisiti della finestra di contesto sono più elevati

Significato per il settore

Questo benchmark rivela i limiti degli AI Agent in scenari industriali reali. Sebbene l'IA stia facendo rapidi progressi nella generazione di codice, c'è ancora molta strada da fare quando si tratta di gestire progetti reali di grandi dimensioni e complessi.

Prospettive future

Il rilascio di SWE-Bench Mobile fornisce un importante standard di misurazione per lo sviluppo di strumenti di programmazione AI. Ci ricorda che:

- La programmazione assistita dall'IA richiede ancora la supervisione umana

- I progetti complessi richiedono una comprensione del contesto più intelligente

- La capacità del modello ha ancora un grande margine di miglioramento

Link alle risorse