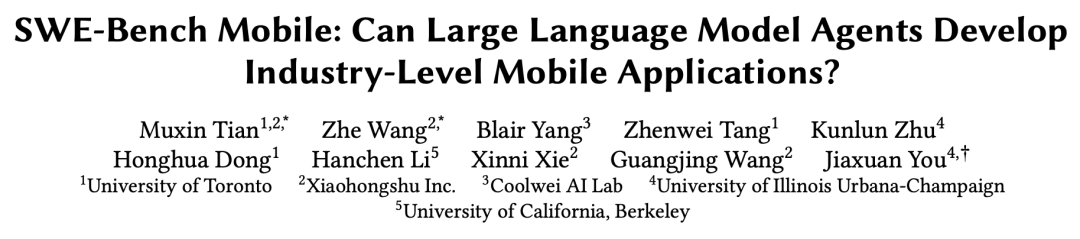

小紅書(Xiaohongshu)がSWE-Bench Mobileを発表:AIエージェントが数億人のユーザー向けアプリのコードベースに直面したとき、最高の成功率はわずか12%?

小紅書(Xiaohongshu)がSWE-Bench Mobileを発表:AIエージェントが数億人のユーザー向けアプリのコードベースに直面したとき、最高の成功率はわずか12%?

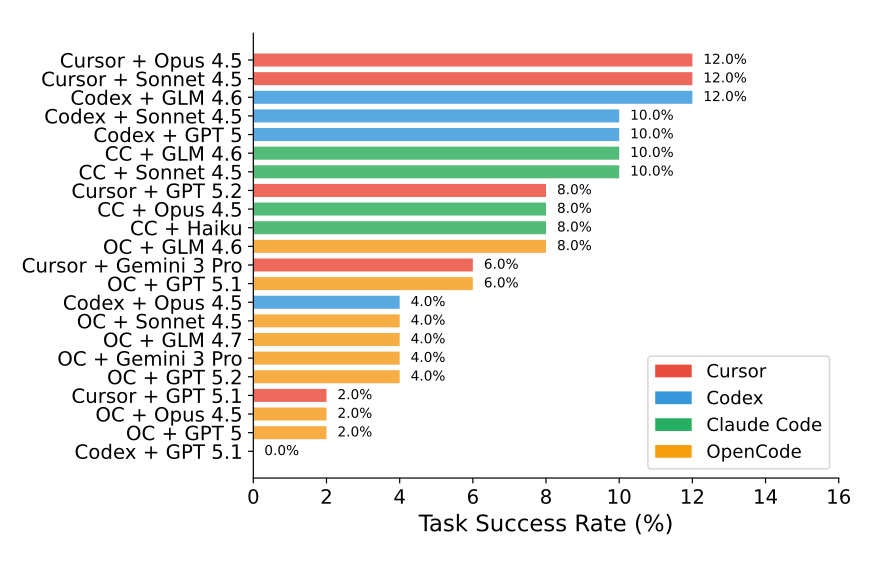

小紅書(Xiaohongshu)チームは、実際のモバイルアプリのコードベースにおけるAIエージェントのパフォーマンスを評価するために特別に設計された新しいベンチマーク、SWE-Bench Mobileを発表しました。その結果は考えさせられるものでした。最高のAIエージェントでさえ、数億人のユーザー向けアプリのコードベースに直面したとき、最高の成功率はわずか12%でした。

SWE-Bench Mobileとは?

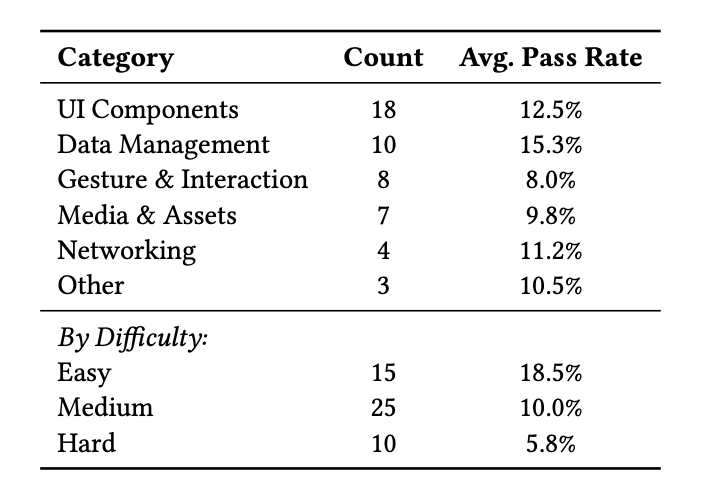

SWE-Bench Mobileは、モバイルアプリ開発向けのコード修正ベンチマークです。これには、実際のモバイルアプリのバグ修正タスクが含まれており、AIエージェントは次のことが求められます。

- 複雑なモバイルアプリのコード構造を理解する

- 問題の根本原因を特定する

- 正しい修正コードを生成する

- 修正によって新しい問題が発生しないようにする

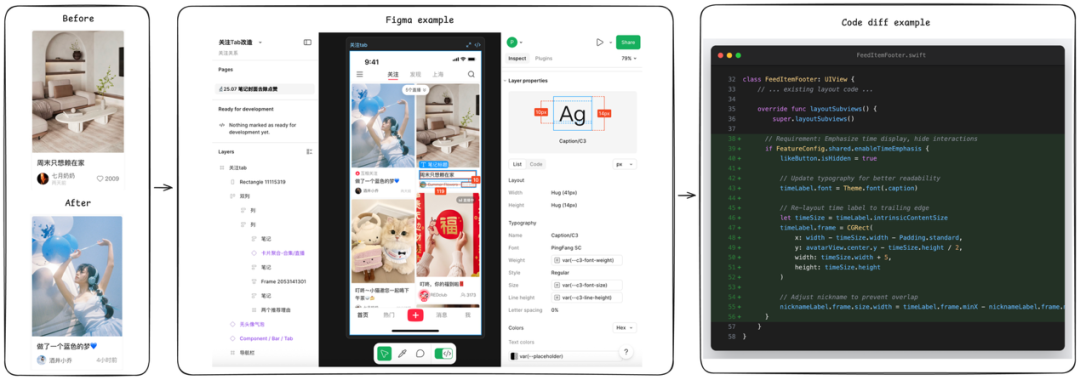

テスト結果

テストでは、複数の主要なAIエージェントのパフォーマンスは次のとおりでした。

- 最高のパフォーマンス:12%の成功率

- 平均レベル:5〜8%の成功率

- 一部のモデル:0%に近い成功率

この結果は、従来のSWE-Benchでのパフォーマンスをはるかに下回っています。

なぜこんなに難しいのか?

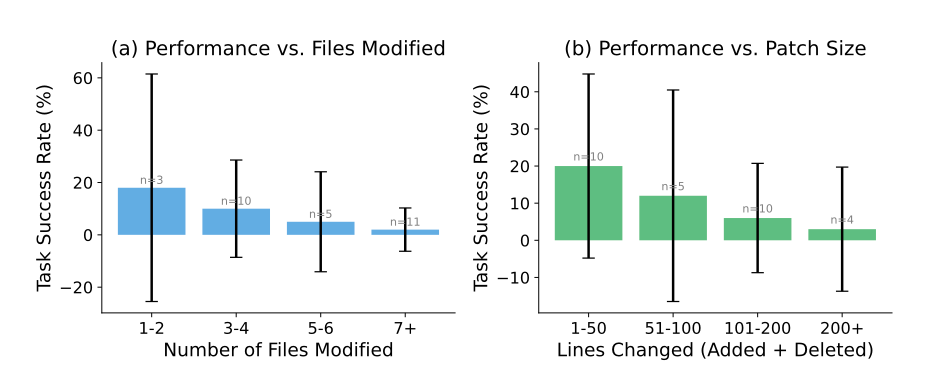

モバイルアプリのコードベースの特殊性により、追加の課題が生じます。

- マルチプラットフォーム対応:iOSとAndroidプラットフォームの両方を考慮する必要がある

- 複雑な依存関係:モバイルアプリのモジュール間の結合度が高い

- パフォーマンス制約:モバイルデバイスのリソースは限られており、コードの最適化が強く求められる

- UIロジックの複雑さ:インターフェースインタラクションコードは静的解析が難しい

従来のベンチマークとの比較

従来のSWE-Benchと比較して、Mobileバージョンの難易度は大幅に向上しています。

- コードベースの規模が大きい

- ビジネスロジックがより複雑

- テストケースの合格がより困難

- コンテキストウィンドウの要件が高い

業界の意義

このベンチマークテストは、実際の産業シナリオにおけるAIエージェントの限界を明らかにしています。AIはコード生成の面で急速に進歩していますが、大規模で複雑な実際のプロジェクトを処理する際には、まだ長い道のりがあります。

今後の展望

SWE-Bench Mobileの発表は、AIプログラミングツールの開発にとって重要な評価基準となります。これは私たちに次のことを思い出させます。

- AI支援プログラミングには、依然として人間の監督が必要である

- 複雑なプロジェクトには、よりインテリジェントなコンテキスト理解が必要である

- モデルの能力には、まだ大きな改善の余地がある

リソースリンク