샤오홍슈, SWE-Bench Mobile 발표: AI Agent가 억 단위 사용자 앱 코드베이스에 직면했을 때, 최고 통과율은 12%에 불과?

샤오홍슈, SWE-Bench Mobile 발표: AI Agent가 억 단위 사용자 앱 코드베이스에 직면했을 때, 최고 통과율은 12%에 불과?

샤오홍슈 팀이 새로운 벤치마크 테스트인 SWE-Bench Mobile을 발표했습니다. 이는 AI Agent가 실제 모바일 앱 코드베이스에서 얼마나 잘 수행하는지 평가하기 위한 것입니다. 결과는 시사하는 바가 큽니다. 최고의 AI Agent조차도 억 단위 사용자를 가진 앱의 코드베이스에 직면했을 때, 최고 통과율이 12%에 불과합니다.

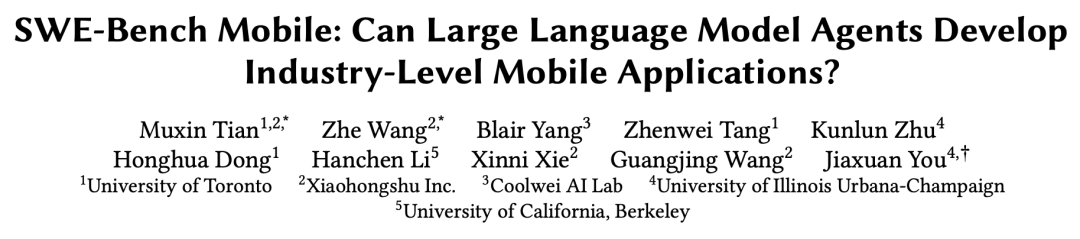

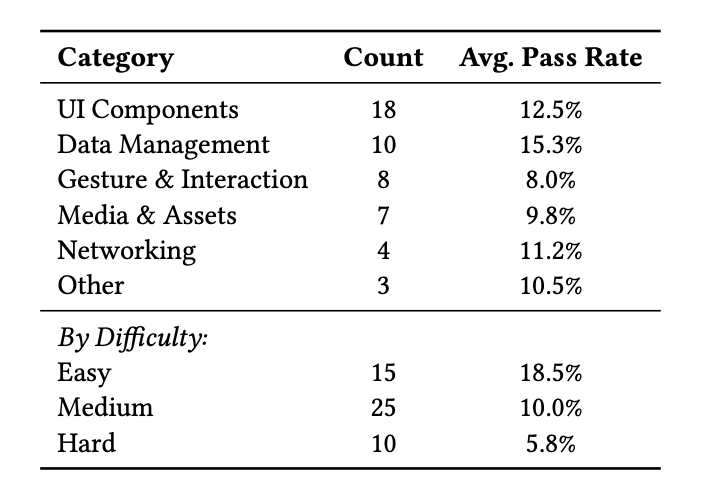

SWE-Bench Mobile이란 무엇인가?

SWE-Bench Mobile은 모바일 앱 개발을 위한 코드 수정 벤치마크 테스트입니다. 여기에는 실제 모바일 앱 버그 수정 작업이 포함되어 있으며, AI Agent는 다음을 수행할 수 있어야 합니다.

- 복잡한 모바일 앱 코드 구조 이해

- 문제의 근원 파악

- 올바른 수정 코드 생성

- 수정으로 인해 새로운 문제가 발생하지 않도록 보장

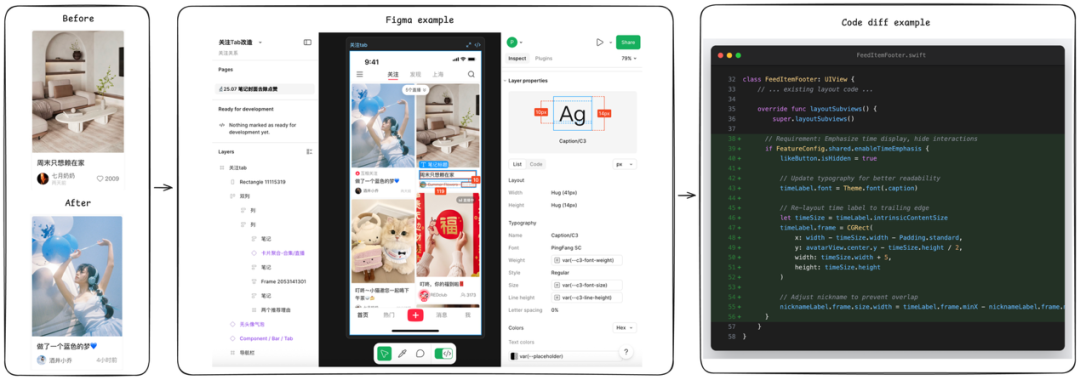

테스트 결과

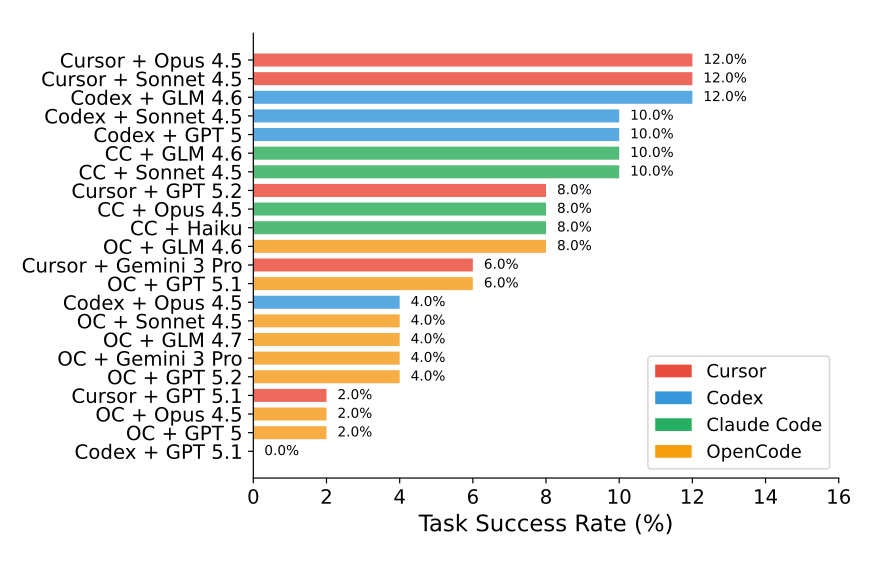

테스트에서 여러 주요 AI Agent의 성능은 다음과 같습니다.

- 최고 성능: 12% 통과율

- 평균 수준: 5-8% 통과율

- 일부 모델: 0%에 가까운 통과율

이 결과는 기존 SWE-Bench에서의 성능보다 훨씬 낮습니다.

왜 이렇게 어려울까요?

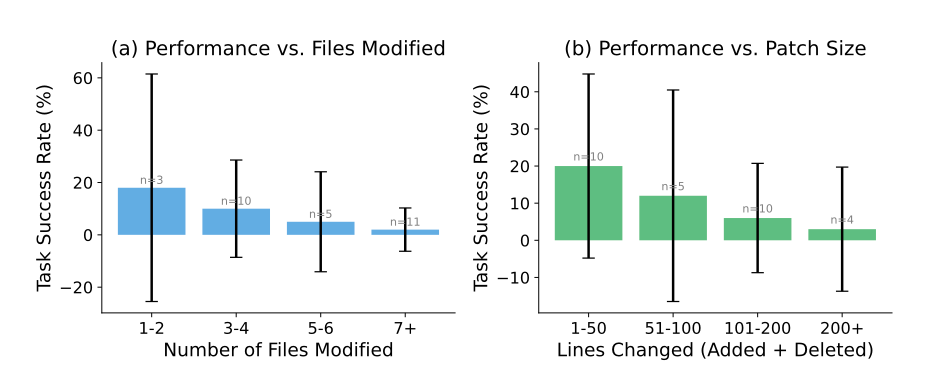

모바일 앱 코드베이스의 특수성으로 인해 추가적인 어려움이 발생합니다.

- 다중 플랫폼 지원: iOS 및 Android 플랫폼을 동시에 고려해야 합니다.

- 복잡한 의존 관계: 모바일 앱의 모듈 간 결합도가 높습니다.

- 성능 제약: 모바일 장치의 리소스가 제한적이므로 코드 최적화 요구 사항이 높습니다.

- 복잡한 UI 로직: 인터페이스 상호 작용 코드를 정적으로 분석하기 어렵습니다.

기존 벤치마크와의 비교

기존 SWE-Bench에 비해 Mobile 버전의 난이도가 크게 향상되었습니다.

- 코드베이스 규모가 더 큽니다.

- 비즈니스 로직이 더 복잡합니다.

- 테스트 케이스를 통과하기가 더 어렵습니다.

- 컨텍스트 창 요구 사항이 더 높습니다.

산업적 의미

이 벤치마크 테스트는 실제 산업 환경에서 AI Agent의 한계를 보여줍니다. AI가 코드 생성 측면에서 빠르게 발전하고 있지만, 대규모의 복잡한 실제 프로젝트를 처리할 때는 여전히 갈 길이 멉니다.

미래 전망

SWE-Bench Mobile의 발표는 AI 프로그래밍 도구 개발에 중요한 측정 기준을 제공합니다. 이는 다음을 상기시켜 줍니다.

- AI 지원 프로그래밍에는 여전히 인간의 감독이 필요합니다.

- 복잡한 프로젝트에는 더 지능적인 컨텍스트 이해가 필요합니다.

- 모델 능력에는 여전히 큰 개선의 여지가 있습니다.

리소스 링크