Xiaohongshu објави SWE-Bench Mobile: Кога AI Agent се соочува со код база на апликација со милиони корисници, максималната стапка на успех е само 12%?

Xiaohongshu објави SWE-Bench Mobile: Кога AI Agent се соочува со код база на апликација со милиони корисници, максималната стапка на успех е само 12%?

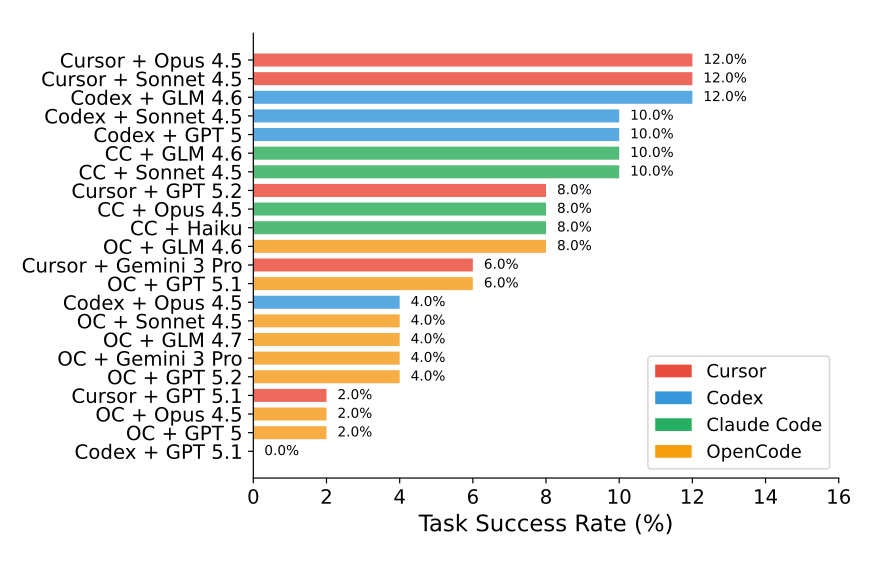

Тимот на Xiaohongshu објави нов репер тест SWE-Bench Mobile, специјално за проценка на перформансите на AI Agent на реални код бази на мобилни апликации. Резултатите се загрижувачки: дури и врвните AI Agent, кога се соочуваат со код база на апликација со милиони корисници, имаат максимална стапка на успех од само 12%.

Што е SWE-Bench Mobile?

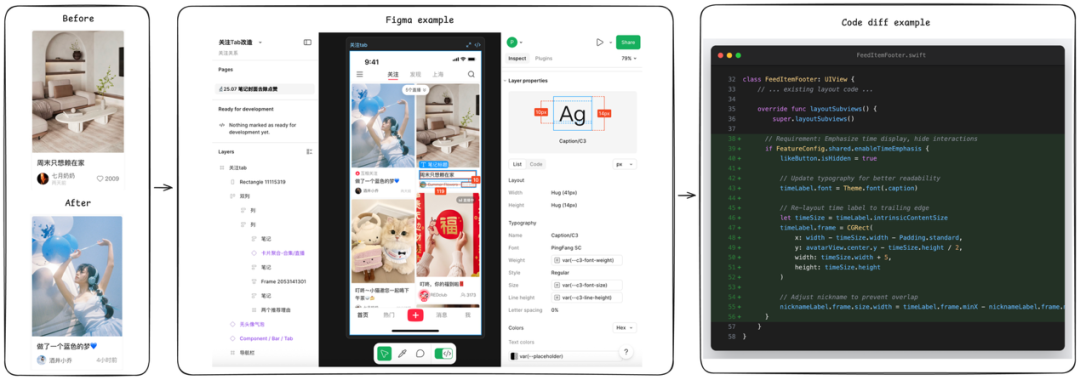

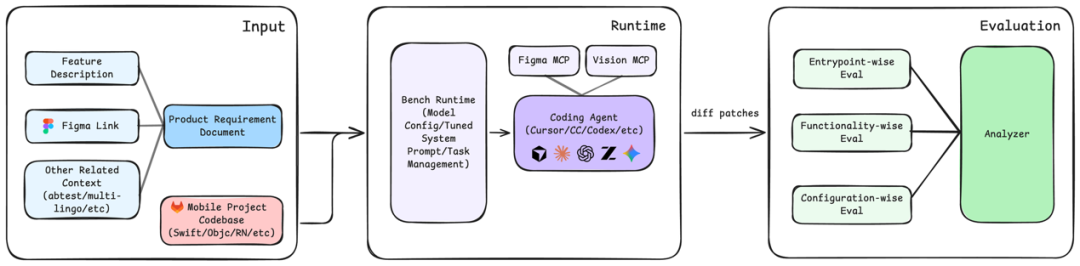

SWE-Bench Mobile е репер тест за поправка на код наменет за развој на мобилни апликации. Тој содржи реални задачи за поправка на грешки во мобилни апликации, кои бараат AI Agent да може:

- Да ја разбере сложената структура на кодот на мобилната апликација

- Да го лоцира изворот на проблемот

- Да генерира точен код за поправка

- Да се осигура дека поправката не воведува нови проблеми

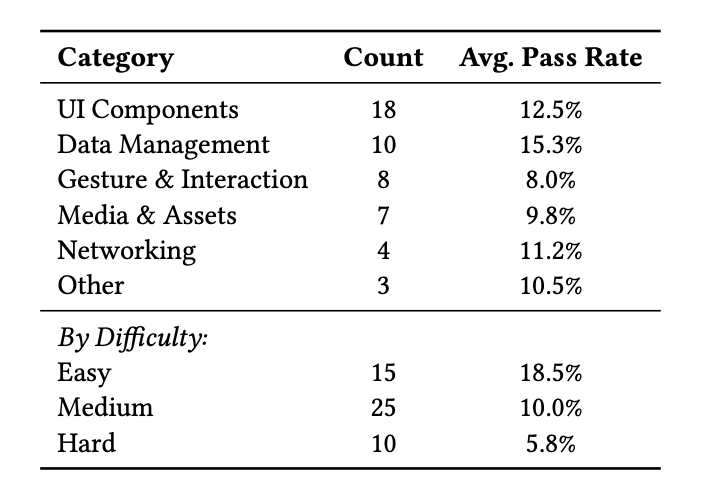

Резултати од тестот

Во тестот, перформансите на неколку главни AI Agent се следни:

- Најдобри перформанси: 12% стапка на успех

- Просечно ниво: 5-8% стапка на успех

- Некои модели: близу до 0% стапка на успех

Овој резултат е далеку под перформансите на традиционалниот SWE-Bench.

Зошто е толку тешко?

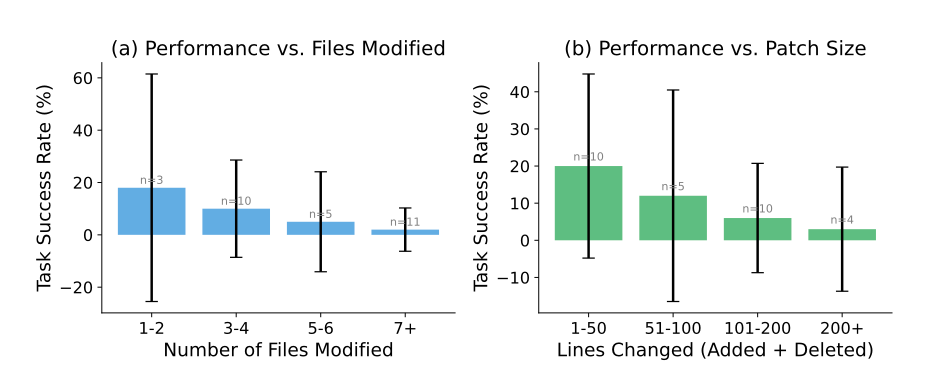

Спецификите на код базата на мобилни апликации носат дополнителни предизвици:

- Адаптација на повеќе платформи: Потребно е истовремено да се земат предвид iOS и Android платформите

- Сложени зависности: Висока е поврзаноста помеѓу модулите на мобилните апликации

- Ограничувања на перформансите: Мобилните уреди имаат ограничени ресурси, а барањата за оптимизација на кодот се високи

- Сложена UI логика: Кодот за интеракција со корисничкиот интерфејс е тешко да се анализира статички

Споредба со традиционалните репери

Во споредба со традиционалниот SWE-Bench, тежината на Mobile верзијата е значително зголемена:

- Код базата е поголема

- Бизнис логиката е посложена

- Тест случаите се потешки за поминување

- Потребно е поголемо контекстно поле

Значење за индустријата

Овој репер тест ги открива ограничувањата на AI Agent во реални индустриски сценарија. Иако AI брзо напредува во генерирањето код, сепак има долг пат да се помине кога станува збор за справување со големи, сложени реални проекти.

Идни изгледи

Објавувањето на SWE-Bench Mobile обезбедува важен стандард за мерење на развојот на AI алатките за програмирање. Тоа нè потсетува дека:

- AI помошното програмирање сè уште бара човечки надзор

- Сложните проекти бараат поинтелигентно разбирање на контекстот

- Има многу простор за подобрување на способностите на моделот

Линк до ресурси

- Документ: https://arxiv.org/abs/xxxxx

- GitHub: https://github.com/xiaohongshu/swe-bench-mobile