Xiaohongshu lanserer SWE-Bench Mobile: Når AI-agenter møter kodebaser for apper med hundrevis av millioner brukere, er den høyeste suksessraten bare 12 %?

Xiaohongshu lanserer SWE-Bench Mobile: Når AI-agenter møter kodebaser for apper med hundrevis av millioner brukere, er den høyeste suksessraten bare 12 %?

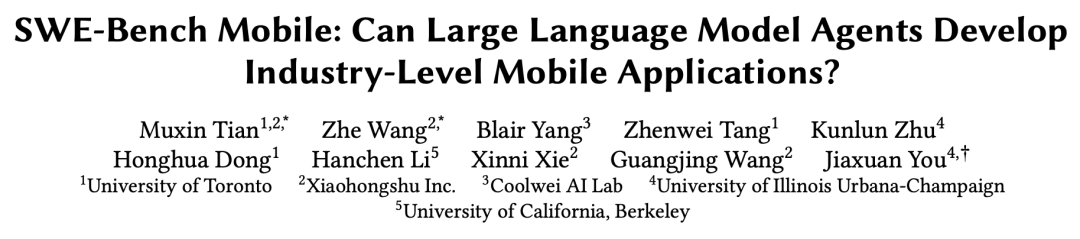

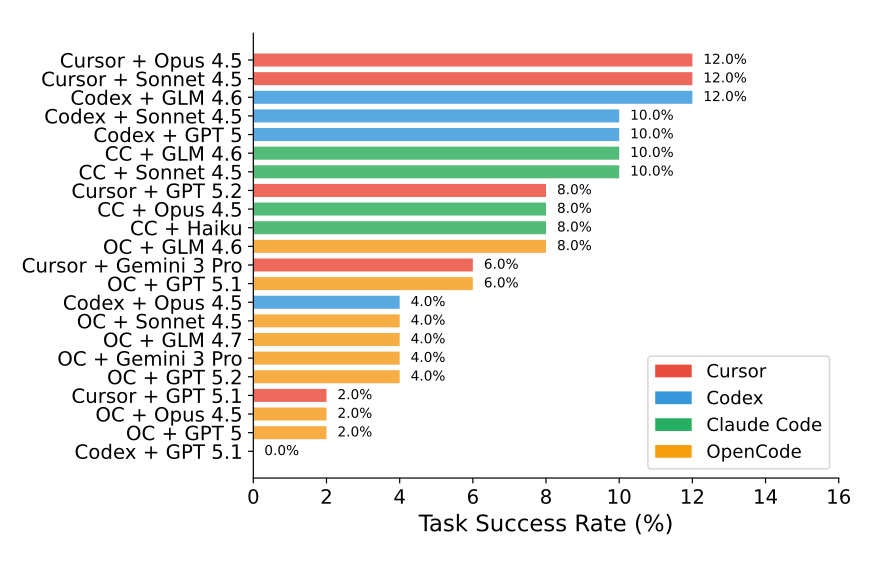

Xiaohongshu-teamet har lansert en ny benchmark, SWE-Bench Mobile, spesielt for å evaluere ytelsen til AI-agenter på ekte kodebaser for mobilapper. Resultatene er tankevekkende: Selv de beste AI-agentene har en maksimal suksessrate på bare 12 % når de står overfor kodebasen til en app med hundrevis av millioner brukere.

Hva er SWE-Bench Mobile?

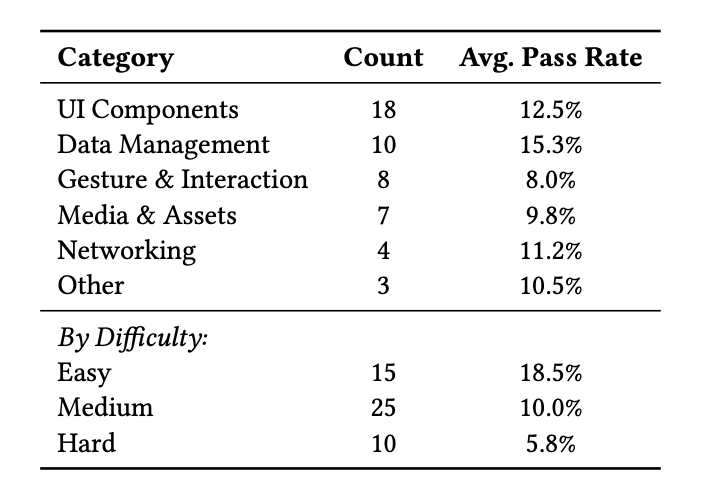

SWE-Bench Mobile er en benchmark for kodefiksing rettet mot utvikling av mobilapper. Den inneholder ekte feilrettingsoppgaver for mobilapper, som krever at AI-agenter kan:

- Forstå komplekse kodestrukturer for mobilapper

- Lokalisere problemets rot

- Generere riktig fiksingskode

- Sikre at fiksen ikke introduserer nye problemer

Testresultater

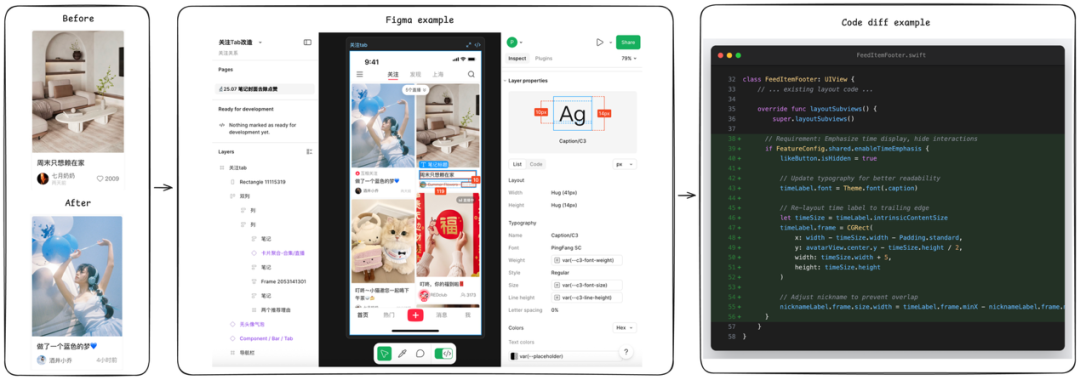

I testen var ytelsen til flere vanlige AI-agenter som følger:

- Beste ytelse: 12 % suksessrate

- Gjennomsnittlig nivå: 5-8 % suksessrate

- Noen modeller: Nærmer seg 0 % suksessrate

Dette resultatet er langt lavere enn ytelsen på den tradisjonelle SWE-Bench.

Hvorfor er det så vanskelig?

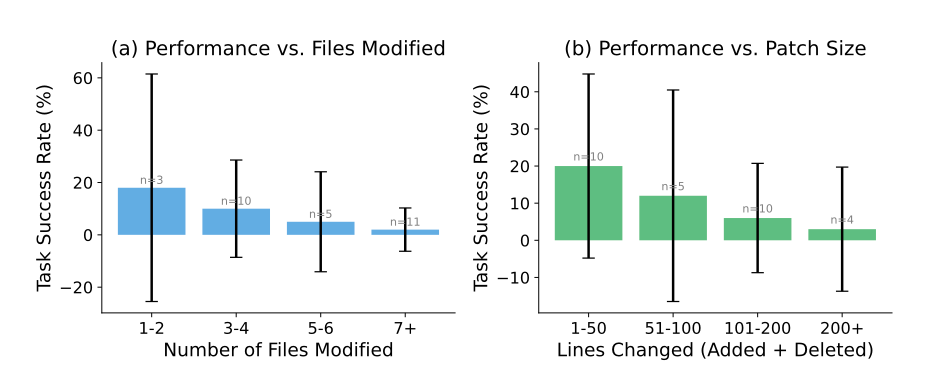

Det spesielle ved kodebaser for mobilapper gir ekstra utfordringer:

- Multi-plattformtilpasning: Krever samtidig vurdering av iOS- og Android-plattformer

- Komplekse avhengighetsforhold: Høy koblingsgrad mellom moduler i mobilapper

- Ytelsesbegrensninger: Begrensede ressurser på mobile enheter, høye krav til kodeoptimalisering

- Kompleks UI-logikk: Grensesnittinteraksjonskode er vanskelig å analysere statisk

Sammenligning med tradisjonelle benchmarks

Sammenlignet med den tradisjonelle SWE-Bench, er vanskelighetsgraden til Mobile-versjonen betydelig økt:

- Større kodebasestørrelse

- Mer kompleks forretningslogikk

- Vanskeligere å bestå testtilfeller

- Høyere krav til kontekstvindu

Betydning for bransjen

Denne benchmarken avslører begrensningene til AI-agenter i ekte industrielle scenarier. Selv om AI gjør raske fremskritt innen kodegenerering, er det fortsatt en lang vei å gå når det gjelder å håndtere store, komplekse, virkelige prosjekter.

Fremtidsutsikter

Utgivelsen av SWE-Bench Mobile gir en viktig målestokk for utviklingen av AI-programmeringsverktøy. Det minner oss om at:

- AI-assistert programmering fortsatt krever menneskelig tilsyn

- Komplekse prosjekter krever mer intelligent kontekstforståelse

- Modellkapasiteten har fortsatt stort forbedringspotensial

Ressurslenker

- Artikkel: https://arxiv.org/abs/xxxxx

- GitHub: https://github.com/xiaohongshu/swe-bench-mobile