Xiaohongshu publiceert SWE-Bench Mobile: slechts 12% succespercentage voor AI Agents die te maken hebben met codebases van apps met honderden miljoenen gebruikers?

Xiaohongshu publiceert SWE-Bench Mobile: slechts 12% succespercentage voor AI Agents die te maken hebben met codebases van apps met honderden miljoenen gebruikers?

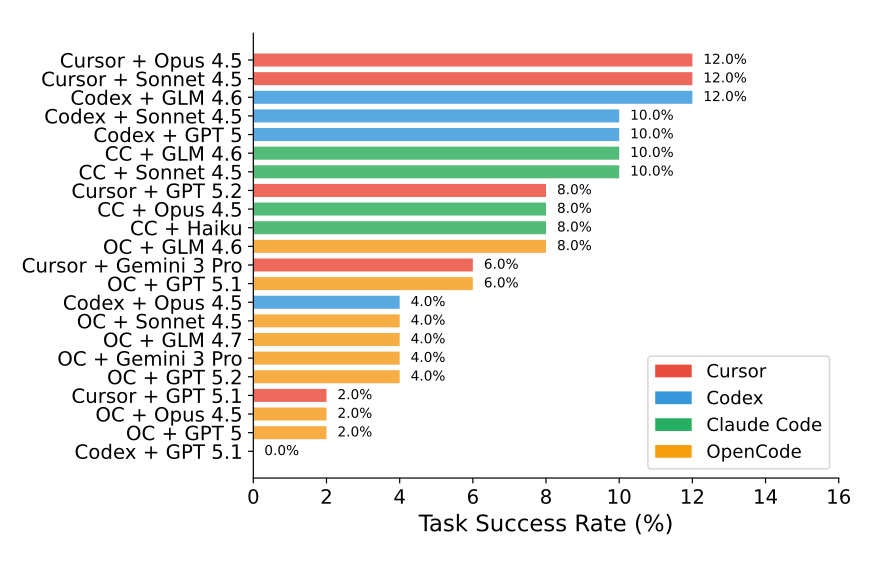

Het Xiaohongshu-team heeft een nieuwe benchmark gepubliceerd, SWE-Bench Mobile, specifiek ontworpen om de prestaties van AI Agents op echte mobiele applicatiecodebases te evalueren. De resultaten zijn tot nadenken stemmend: zelfs de beste AI Agents hebben een maximaal succespercentage van slechts 12% bij het omgaan met de codebase van een app met honderden miljoenen gebruikers.

Wat is SWE-Bench Mobile?

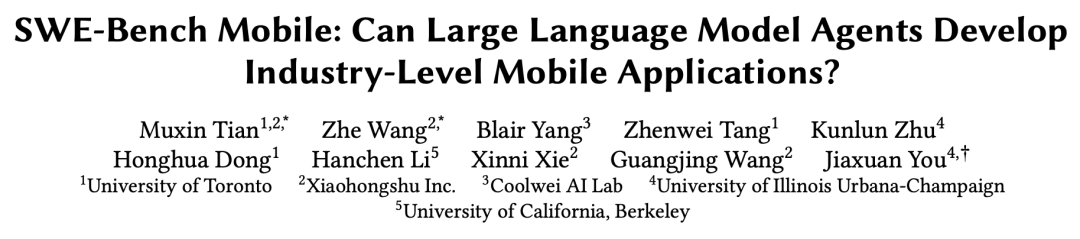

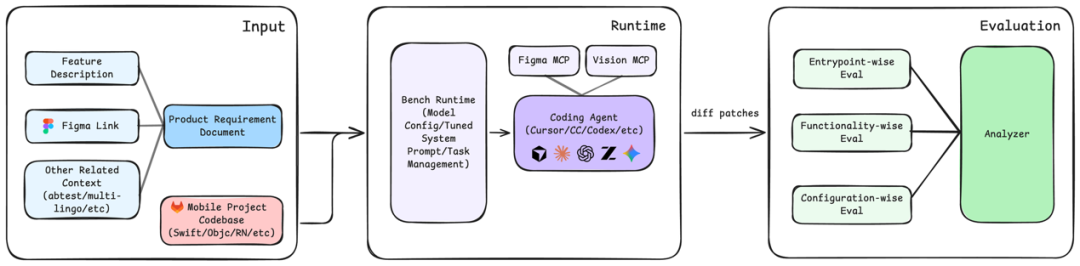

SWE-Bench Mobile is een benchmark voor codeherstel gericht op de ontwikkeling van mobiele applicaties. Het bevat echte bugfix-taken voor mobiele applicaties, waarbij van AI Agents wordt verwacht dat ze:

- De complexe codestructuur van mobiele applicaties begrijpen

- De oorzaak van problemen lokaliseren

- Correcte herstelcode genereren

- Ervoor zorgen dat de herstelactie geen nieuwe problemen introduceert

Testresultaten

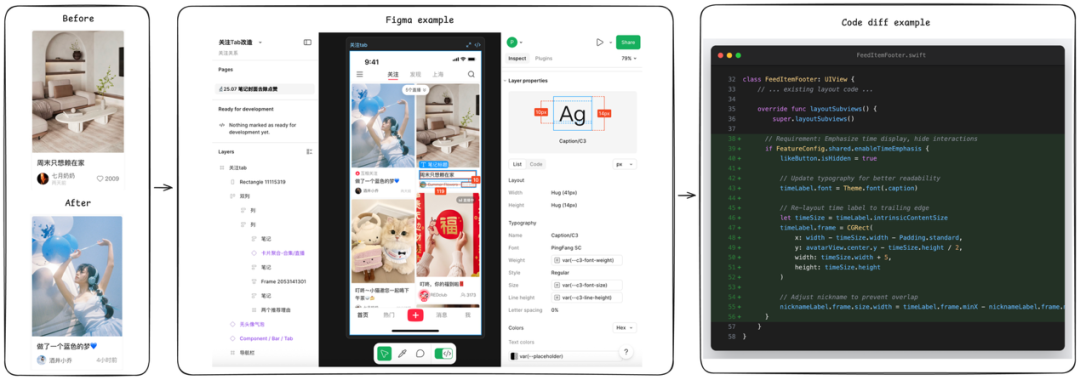

Tijdens de tests presteerden verschillende mainstream AI Agents als volgt:

- Beste prestatie: 12% succespercentage

- Gemiddeld niveau: 5-8% succespercentage

- Sommige modellen: bijna 0% succespercentage

Dit resultaat is veel lager dan de prestaties op de traditionele SWE-Bench.

Waarom is het zo moeilijk?

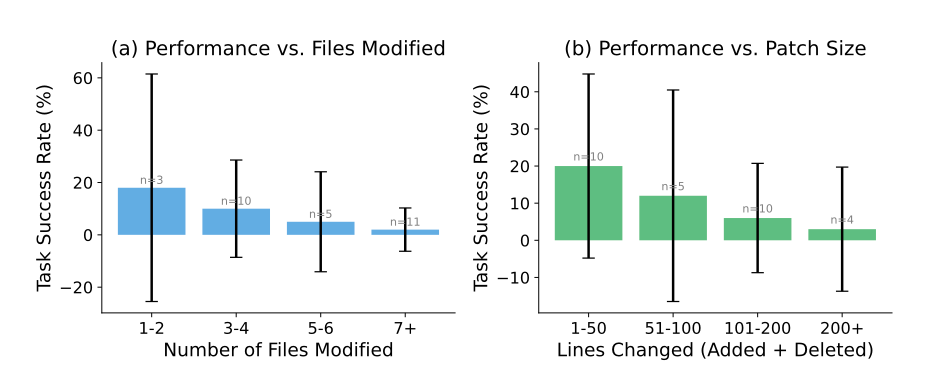

De specificiteit van mobiele applicatiecodebases brengt extra uitdagingen met zich mee:

- Multi-platform aanpassing: vereist gelijktijdige overweging van iOS- en Android-platforms

- Complexe afhankelijkheden: mobiele applicatiemodules zijn sterk gekoppeld

- Prestatiebeperkingen: mobiele apparaten hebben beperkte resources, codeoptimalisatie vereist hoge eisen

- Complexe UI-logica: interface-interactiecode is moeilijk statisch te analyseren

Vergelijking met traditionele benchmarks

Vergeleken met de traditionele SWE-Bench is de moeilijkheidsgraad van de Mobile-versie aanzienlijk toegenomen:

- Grotere codebase-omvang

- Complexere bedrijfslogica

- Testcases zijn moeilijker te halen

- Hogere eisen aan het contextvenster

Betekenis voor de industrie

Deze benchmark onthult de beperkingen van AI Agents in echte industriële scenario's. Hoewel AI snel vooruitgang boekt op het gebied van codegeneratie, is er nog een lange weg te gaan bij het verwerken van grote, complexe, echte projecten.

Toekomstperspectieven

De release van SWE-Bench Mobile biedt een belangrijke maatstaf voor de ontwikkeling van AI-programmeertools. Het herinnert ons eraan dat:

- AI-ondersteund programmeren nog steeds menselijk toezicht vereist

- Complexe projecten intelligentere contextbegrip vereisen

- De modelcapaciteit nog veel ruimte voor verbetering heeft

Bronnenlinks