Pequena Flor Vermelha (Xiaohongshu) lança SWE-Bench Mobile: Quando um Agente de IA enfrenta uma base de código de App com centenas de milhões de usuários, a taxa de aprovação máxima é de apenas 12%?

Pequena Flor Vermelha (Xiaohongshu) lança SWE-Bench Mobile: Quando um Agente de IA enfrenta uma base de código de App com centenas de milhões de usuários, a taxa de aprovação máxima é de apenas 12%?

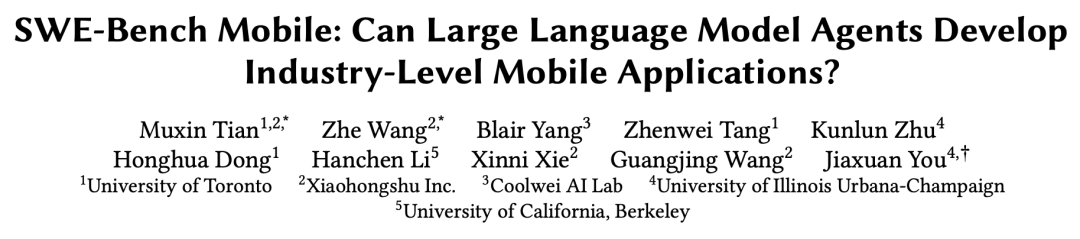

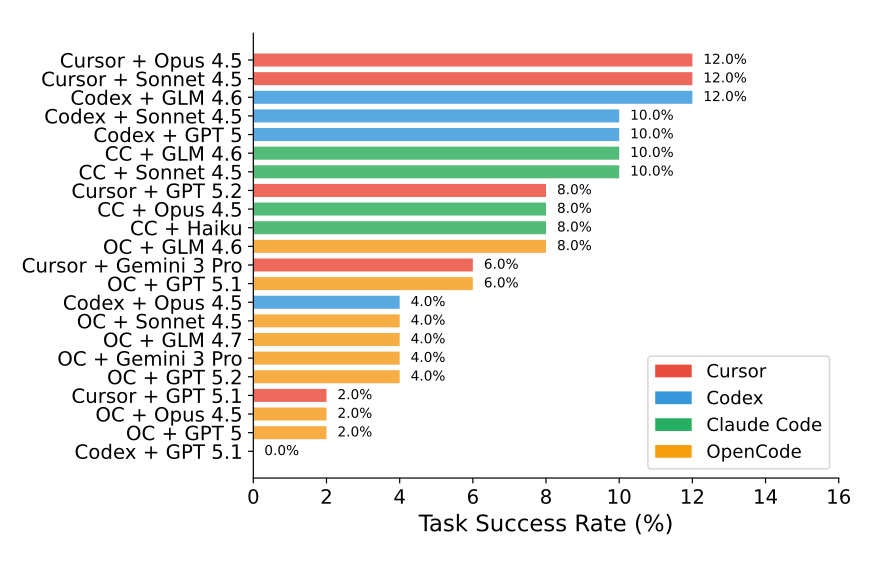

A equipe da Pequena Flor Vermelha (Xiaohongshu) lançou um novo benchmark, SWE-Bench Mobile, especificamente para avaliar o desempenho de Agentes de IA em bases de código de aplicativos móveis reais. Os resultados são instigantes: mesmo os melhores Agentes de IA, ao enfrentar a base de código de um App com centenas de milhões de usuários, têm uma taxa de aprovação máxima de apenas 12%.

O que é SWE-Bench Mobile?

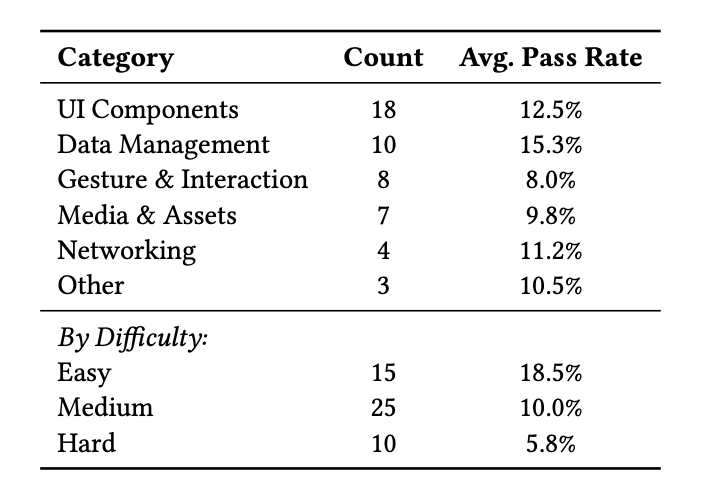

SWE-Bench Mobile é um benchmark para correção de código voltado para o desenvolvimento de aplicativos móveis. Ele contém tarefas reais de correção de bugs em aplicativos móveis, exigindo que o Agente de IA seja capaz de:

- Entender a estrutura complexa do código do aplicativo móvel

- Localizar a raiz do problema

- Gerar o código de correção correto

- Garantir que a correção não introduza novos problemas

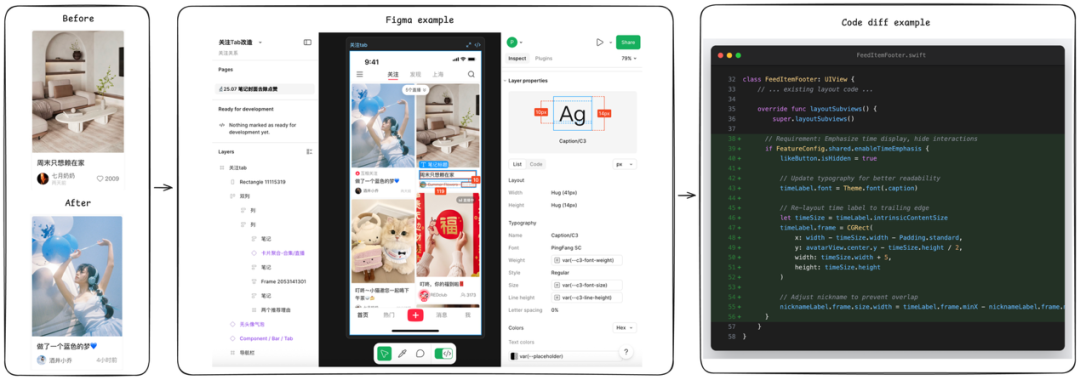

Resultados dos Testes

Nos testes, o desempenho de vários Agentes de IA convencionais foi o seguinte:

- Melhor desempenho: 12% de taxa de aprovação

- Nível médio: 5-8% de taxa de aprovação

- Alguns modelos: Próximo de 0% de taxa de aprovação

Este resultado é muito inferior ao desempenho no SWE-Bench tradicional.

Por que é tão difícil?

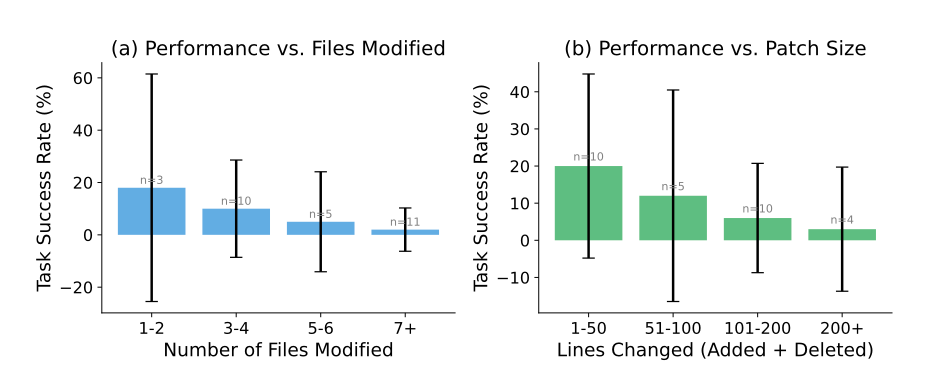

A especificidade das bases de código de aplicativos móveis traz desafios adicionais:

- Adaptação multi-plataforma: Necessidade de considerar simultaneamente as plataformas iOS e Android

- Relações de dependência complexas: Alto grau de acoplamento entre os módulos do aplicativo móvel

- Restrições de desempenho: Recursos limitados do dispositivo móvel, altas exigências de otimização de código

- Lógica de UI complexa: Código de interação da interface difícil de analisar estaticamente

Comparação com Benchmarks Tradicionais

Comparado com o SWE-Bench tradicional, a dificuldade da versão Mobile é significativamente maior:

- Escala da base de código maior

- Lógica de negócios mais complexa

- Casos de teste mais difíceis de passar

- Requisitos de janela de contexto mais altos

Significado para a Indústria

Este benchmark revela as limitações dos Agentes de IA em cenários industriais reais. Embora a IA tenha feito progressos rápidos na geração de código, ainda há um longo caminho a percorrer ao lidar com projetos reais grandes e complexos.

Perspectivas Futuras

O lançamento do SWE-Bench Mobile fornece um importante padrão de medição para o desenvolvimento de ferramentas de programação de IA. Ele nos lembra que:

- A programação assistida por IA ainda requer supervisão humana

- Projetos complexos precisam de uma compreensão de contexto mais inteligente

- A capacidade do modelo ainda tem muito espaço para melhorias

Links de Recursos