Xiaohongshu lansează SWE-Bench Mobile: Când AI Agent se confruntă cu o bază de cod a unei aplicații cu sute de milioane de utilizatori, rata maximă de succes este de doar 12%?

Xiaohongshu lansează SWE-Bench Mobile: Când AI Agent se confruntă cu o bază de cod a unei aplicații cu sute de milioane de utilizatori, rata maximă de succes este de doar 12%?

Echipa Xiaohongshu a lansat un nou test de referință, SWE-Bench Mobile, special conceput pentru a evalua performanța AI Agent pe baze de cod reale ale aplicațiilor mobile. Rezultatele sunt îngrijorătoare: chiar și cel mai bun AI Agent, atunci când se confruntă cu baza de cod a unei aplicații cu sute de milioane de utilizatori, are o rată maximă de succes de doar 12%.

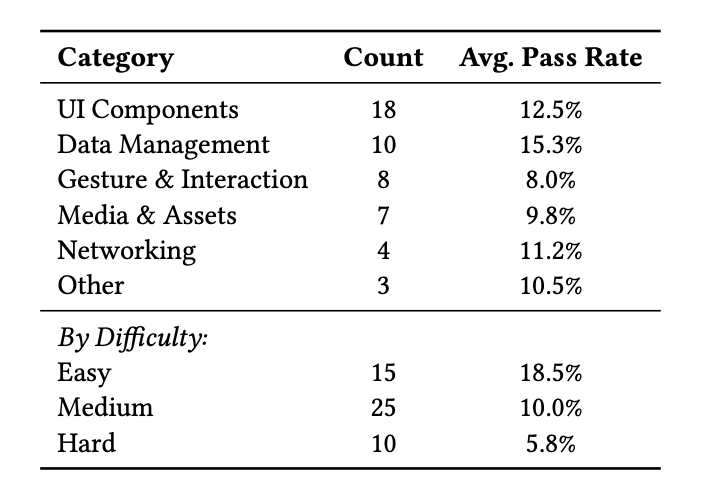

Ce este SWE-Bench Mobile?

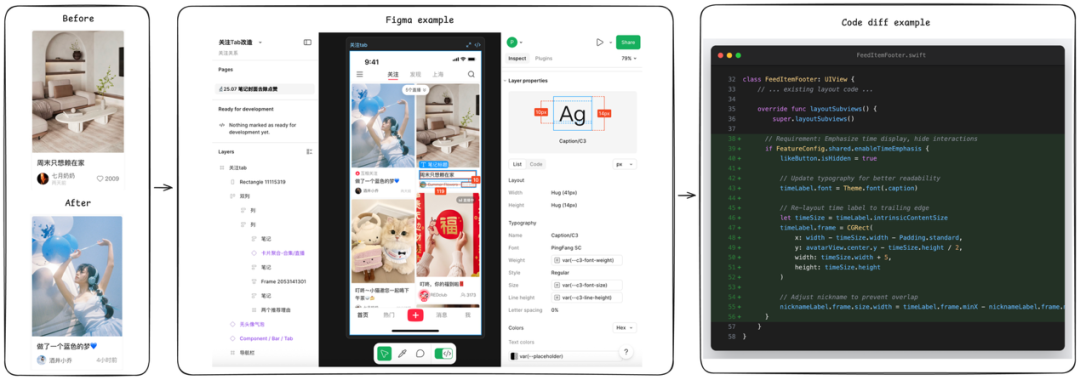

SWE-Bench Mobile este un test de referință pentru corectarea codului, destinat dezvoltării de aplicații mobile. Acesta conține sarcini reale de corectare a erorilor din aplicațiile mobile, cerând AI Agent să:

- Înțeleagă structura complexă a codului aplicațiilor mobile

- Localizeze cauza principală a problemelor

- Genereze cod de corectare corect

- Se asigure că corectarea nu introduce probleme noi

Rezultatele testelor

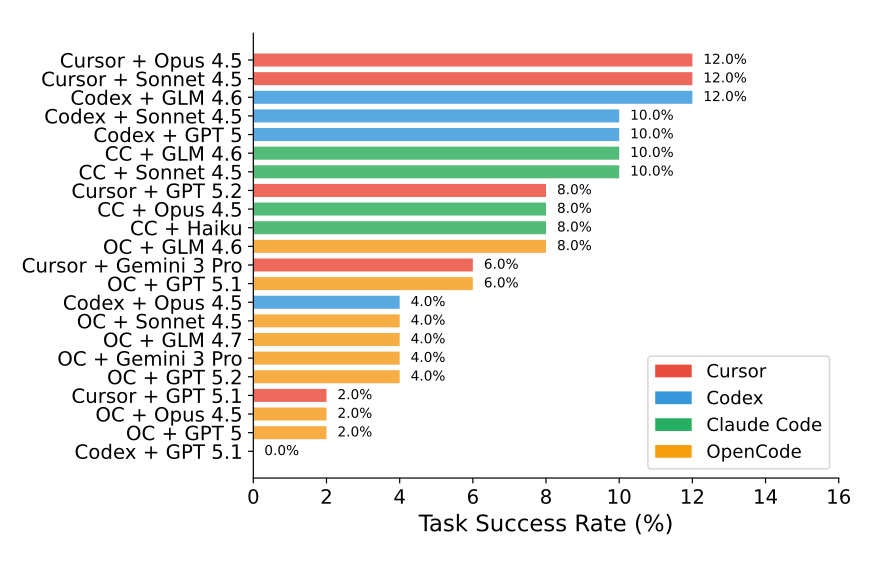

În timpul testării, performanța mai multor AI Agent principali a fost următoarea:

- Cea mai bună performanță: rată de succes de 12%

- Nivel mediu: rată de succes de 5-8%

- Unele modele: rată de succes aproape de 0%

Acest rezultat este mult mai mic decât performanța pe SWE-Bench tradițional.

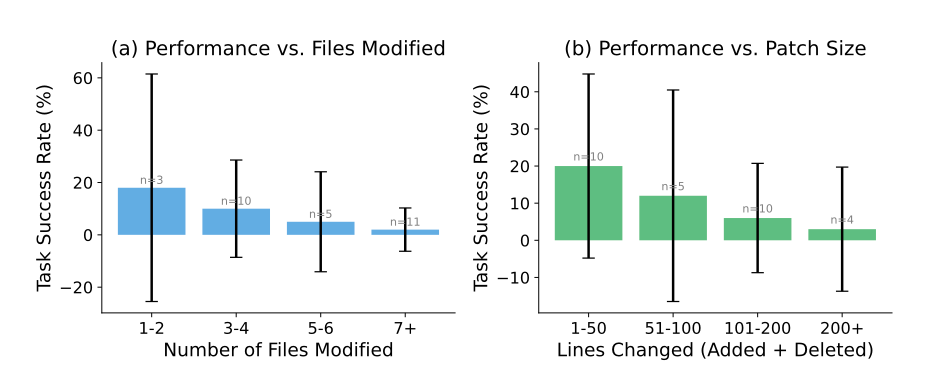

De ce este atât de dificil?

Specificul bazelor de cod ale aplicațiilor mobile aduce provocări suplimentare:

- Adaptare multi-platformă: trebuie luate în considerare simultan platformele iOS și Android

- Relații de dependență complexe: cuplarea între modulele aplicațiilor mobile este ridicată

- Constrângeri de performanță: resursele dispozitivelor mobile sunt limitate, cerințele de optimizare a codului sunt ridicate

- Logica UI complexă: codul de interacțiune a interfeței este dificil de analizat static

Comparație cu testele de referință tradiționale

În comparație cu SWE-Bench tradițional, dificultatea versiunii Mobile este semnificativ mai mare:

- Dimensiunea bazei de cod este mai mare

- Logica de afaceri este mai complexă

- Cazurile de testare sunt mai greu de trecut

- Cerințele pentru fereastra de context sunt mai mari

Semnificația pentru industrie

Acest test de referință dezvăluie limitările AI Agent în scenarii industriale reale. Deși AI a făcut progrese rapide în generarea de cod, mai are un drum lung de parcurs în gestionarea proiectelor reale mari și complexe.

Perspective de viitor

Lansarea SWE-Bench Mobile oferă un standard important de măsurare pentru dezvoltarea instrumentelor de programare AI. Ne reamintește că:

- Programarea asistată de AI necesită încă supraveghere umană

- Proiectele complexe necesită o înțelegere mai inteligentă a contextului

- Capacitatea modelului are un potențial mare de îmbunătățire

Link-uri către resurse