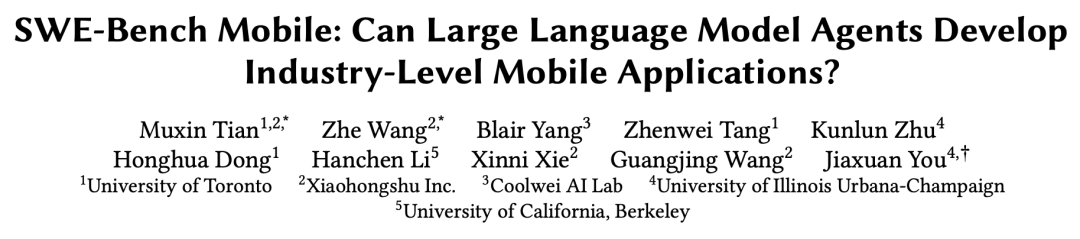

Xiaohongshu выпустила SWE-Bench Mobile: когда AI Agent сталкивается с кодовой базой приложения с сотнями миллионов пользователей, максимальный процент успешных решений составляет всего 12%?

Xiaohongshu выпустила SWE-Bench Mobile: когда AI Agent сталкивается с кодовой базой приложения с сотнями миллионов пользователей, максимальный процент успешных решений составляет всего 12%?

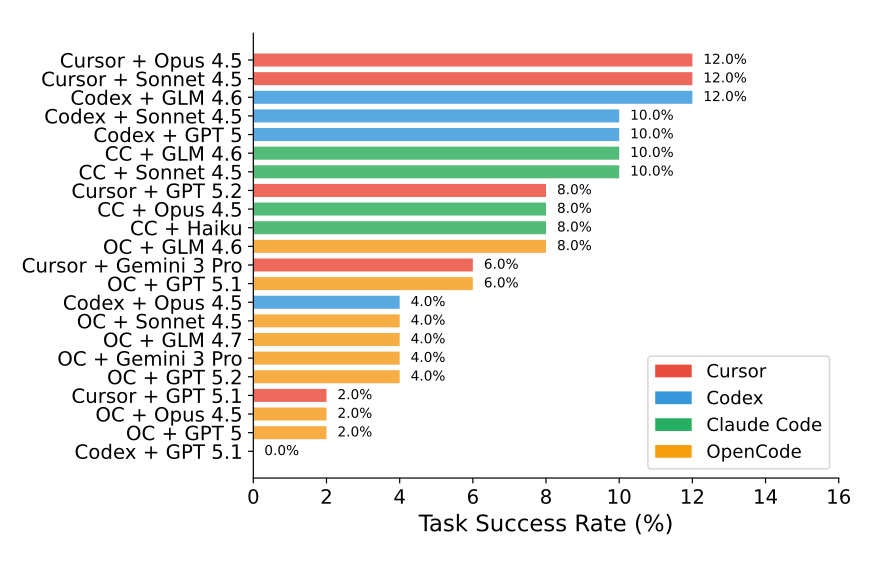

Команда Xiaohongshu выпустила новый бенчмарк SWE-Bench Mobile, специально разработанный для оценки производительности AI Agent на реальных кодовых базах мобильных приложений. Результаты заставляют задуматься: даже лучшие AI Agent, сталкиваясь с кодовой базой приложения с сотнями миллионов пользователей, показывают максимальный процент успешных решений всего 12%.

Что такое SWE-Bench Mobile?

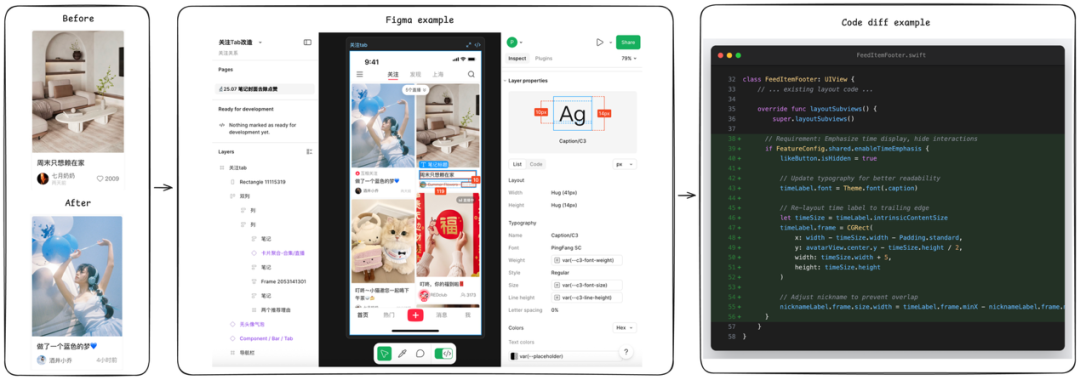

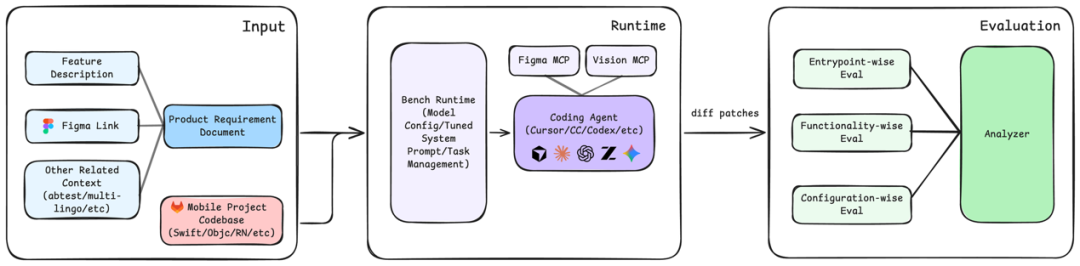

SWE-Bench Mobile — это бенчмарк для исправления кода, предназначенный для разработки мобильных приложений. Он включает в себя реальные задачи по исправлению ошибок в мобильных приложениях, требующие от AI Agent:

- Понимания сложной структуры кода мобильного приложения

- Локализации первопричины проблемы

- Генерации правильного кода исправления

- Обеспечения того, чтобы исправление не приводило к новым проблемам

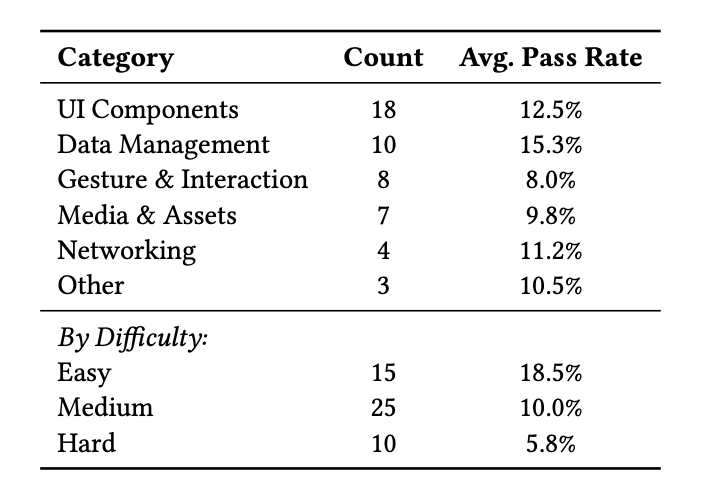

Результаты тестирования

В ходе тестирования несколько основных AI Agent показали следующие результаты:

- Лучший результат: 12% успешных решений

- Средний уровень: 5-8% успешных решений

- Некоторые модели: около 0% успешных решений

Этот результат значительно ниже, чем производительность на традиционном SWE-Bench.

Почему это так сложно?

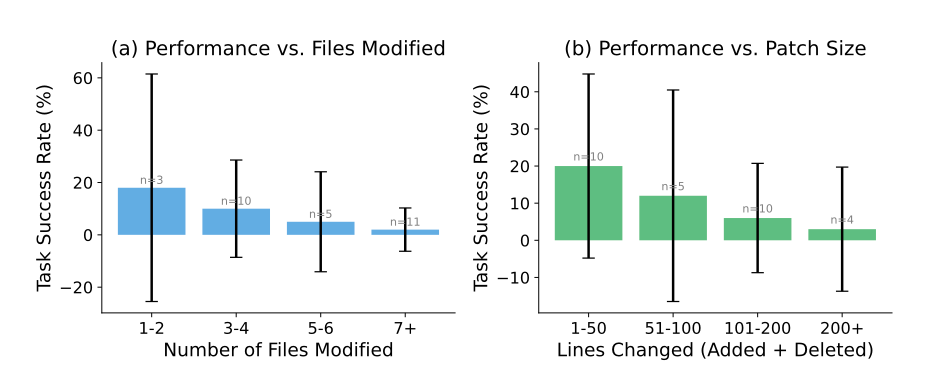

Специфика кодовой базы мобильных приложений создает дополнительные проблемы:

- Адаптация к нескольким платформам: необходимо учитывать платформы iOS и Android одновременно

- Сложные зависимости: высокая степень связанности между модулями мобильного приложения

- Ограничения производительности: мобильные устройства имеют ограниченные ресурсы, высокие требования к оптимизации кода

- Сложная UI-логика: код взаимодействия с интерфейсом сложно анализировать статически

Сравнение с традиционными бенчмарками

По сравнению с традиционным SWE-Bench, сложность Mobile-версии значительно возросла:

- Больший размер кодовой базы

- Более сложная бизнес-логика

- Сложнее пройти тестовые примеры

- Более высокие требования к контекстному окну

Значение для отрасли

Этот бенчмарк показывает ограничения AI Agent в реальных промышленных сценариях. Хотя AI быстро прогрессирует в генерации кода, ему еще предстоит пройти долгий путь в обработке крупных и сложных реальных проектов.

Перспективы на будущее

Выпуск SWE-Bench Mobile предоставляет важный критерий для развития инструментов AI-программирования. Он напоминает нам:

- AI-помощь в программировании по-прежнему требует контроля со стороны человека

- Сложные проекты требуют более интеллектуального понимания контекста

- Возможности модели имеют большой потенциал для улучшения

Ссылки на ресурсы