Inilabas ng Xiaohongshu ang SWE-Bench Mobile: Kapag Humarap ang AI Agent sa Codebase ng App na May Bilyong User, 12% Lang Ba ang Pinakamataas na Rate ng Pagpasa?

Inilabas ng Xiaohongshu ang SWE-Bench Mobile: Kapag Humarap ang AI Agent sa Codebase ng App na May Bilyong User, 12% Lang Ba ang Pinakamataas na Rate ng Pagpasa?

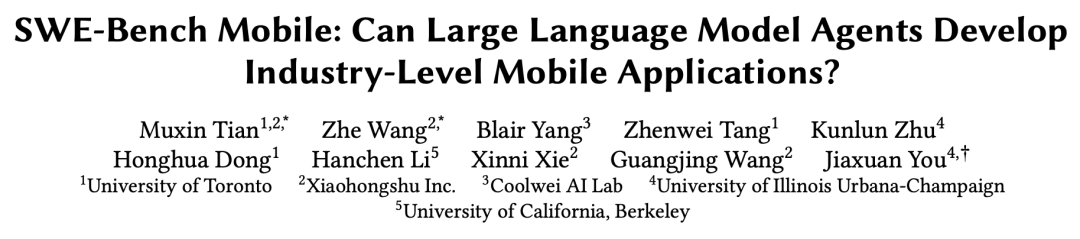

Naglabas ang team ng Xiaohongshu ng bagong benchmark na SWE-Bench Mobile, na espesyal na idinisenyo para suriin ang performance ng AI Agent sa tunay na mobile application codebase. Nakakapag-isip ang resulta: kahit na ang mga nangungunang AI Agent, kapag humarap sa codebase ng App na may bilyong user, 12% lang ang pinakamataas na rate ng pagpasa.

Ano ang SWE-Bench Mobile?

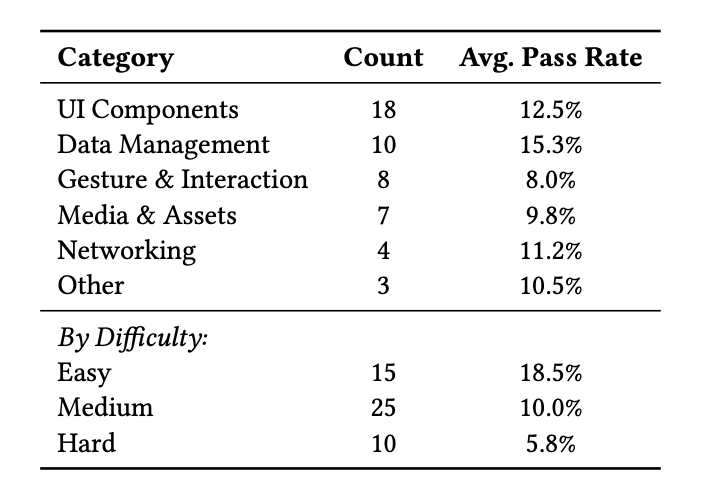

Ang SWE-Bench Mobile ay isang benchmark para sa pag-aayos ng code na nakatuon sa pagbuo ng mobile application. Naglalaman ito ng mga tunay na gawain sa pag-aayos ng Bug sa mobile application, na nangangailangan ng AI Agent na:

- Unawain ang kumplikadong istraktura ng code ng mobile application

- Tukuyin ang pinagmulan ng problema

- Bumuo ng tamang code ng pag-aayos

- Tiyakin na ang pag-aayos ay hindi magpapakilala ng mga bagong problema

Mga resulta ng pagsubok

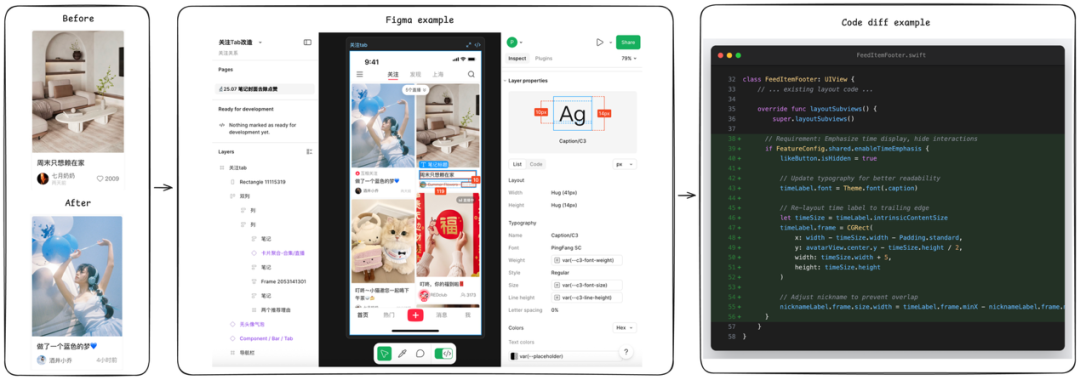

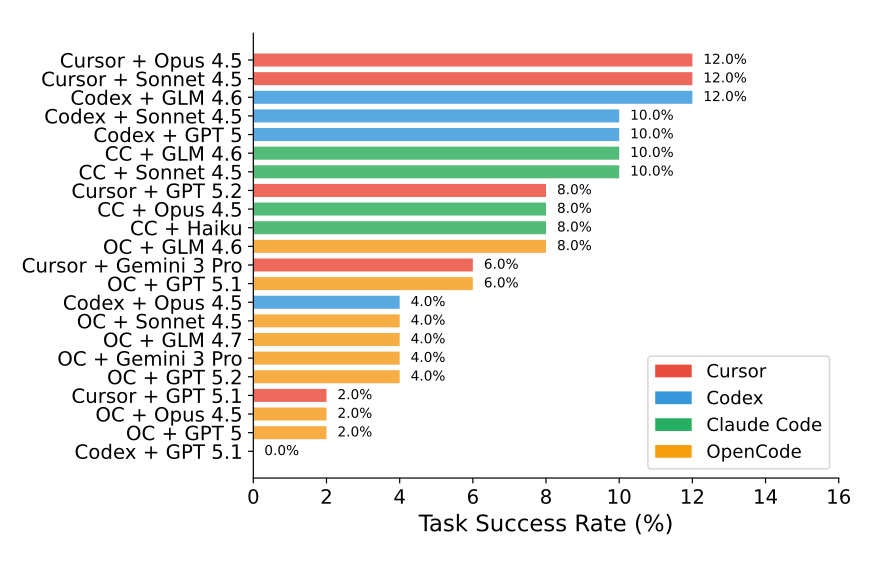

Sa pagsubok, ang performance ng maraming pangunahing AI Agent ay ang mga sumusunod:

- Pinakamahusay na performance: 12% na rate ng pagpasa

- Average na antas: 5-8% na rate ng pagpasa

- Ilang modelo: Halos 0% na rate ng pagpasa

Ang resultang ito ay mas mababa kaysa sa performance sa tradisyonal na SWE-Bench.

Bakit napakahirap?

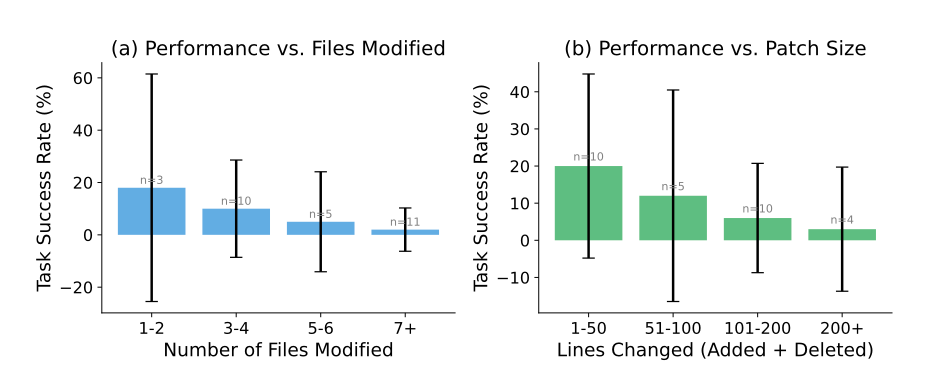

Ang mga espesyal na katangian ng mobile application codebase ay nagdudulot ng karagdagang mga hamon:

- Multi-end adaptation: Kailangang isaalang-alang ang mga platform ng iOS at Android nang sabay

- Kumplikadong mga dependency: Mataas ang coupling sa pagitan ng mga module ng mobile application

- Mga paghihigpit sa performance: Limitado ang mga mapagkukunan ng mobile device, at mataas ang mga kinakailangan sa pag-optimize ng code

- Kumplikadong UI logic: Mahirap i-static analyze ang code ng interaction ng interface

Paghahambing sa tradisyonal na benchmark

Kung ikukumpara sa tradisyonal na SWE-Bench, ang kahirapan ng Mobile na bersyon ay makabuluhang tumaas:

- Mas malaki ang sukat ng codebase

- Mas kumplikado ang logic ng negosyo

- Mas mahirap ipasa ang mga test case

- Mas mataas ang mga kinakailangan sa context window

Kahalagahan ng industriya

Ibinunyag ng benchmark na ito ang mga limitasyon ng AI Agent sa mga tunay na pang-industriya na sitwasyon. Bagama't mabilis ang pag-unlad ng AI sa pagbuo ng code, mayroon pa ring mahabang daan na tatahakin sa paghawak ng malalaki at kumplikadong tunay na proyekto.

Mga inaasahan sa hinaharap

Ang paglabas ng SWE-Bench Mobile ay nagbibigay ng mahalagang pamantayan para sa pag-unlad ng mga tool sa pagprograma ng AI. Ipinapaalala nito sa atin na:

- Kailangan pa rin ng pangangasiwa ng tao ang AI-assisted programming

- Ang mga kumplikadong proyekto ay nangangailangan ng mas matalinong pag-unawa sa konteksto

- Malaki pa ang puwang para sa pagpapabuti ng kakayahan ng modelo

Mga link ng mapagkukunan