Xiaohongshu випустила SWE-Bench Mobile: чи досягає найвищий показник успішності лише 12%, коли AI Agent стикається з кодовою базою програми з сотнями мільйонів користувачів?

Xiaohongshu випустила SWE-Bench Mobile: чи досягає найвищий показник успішності лише 12%, коли AI Agent стикається з кодовою базою програми з сотнями мільйонів користувачів?

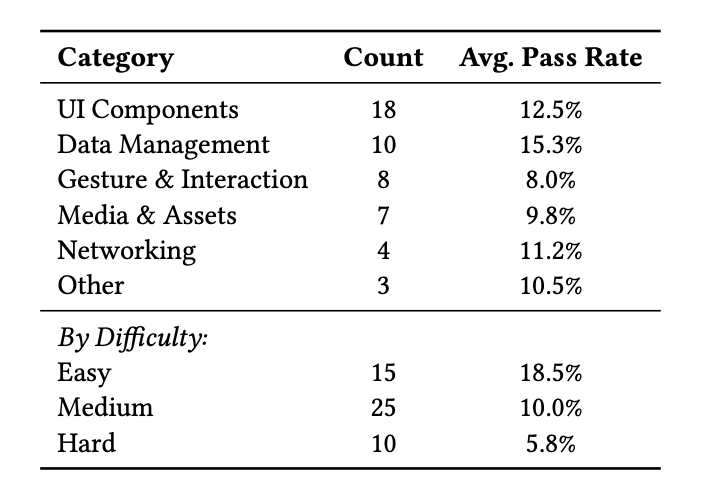

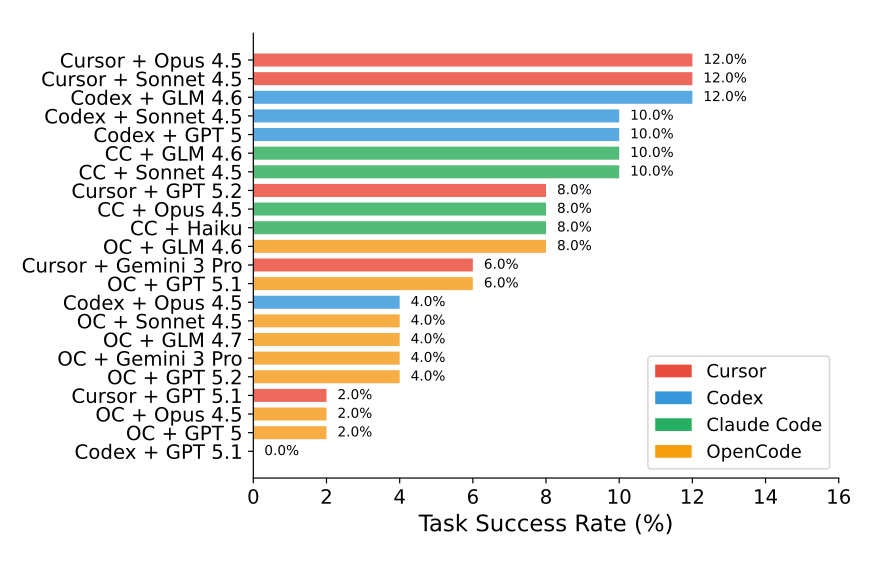

Команда Xiaohongshu випустила новий еталонний тест SWE-Bench Mobile, спеціально розроблений для оцінки продуктивності AI Agent у реальних кодових базах мобільних додатків. Результати змушують задуматися: навіть найкращі AI Agent, стикаючись із кодовою базою програми з сотнями мільйонів користувачів, мають максимальний показник успішності лише 12%.

Що таке SWE-Bench Mobile?

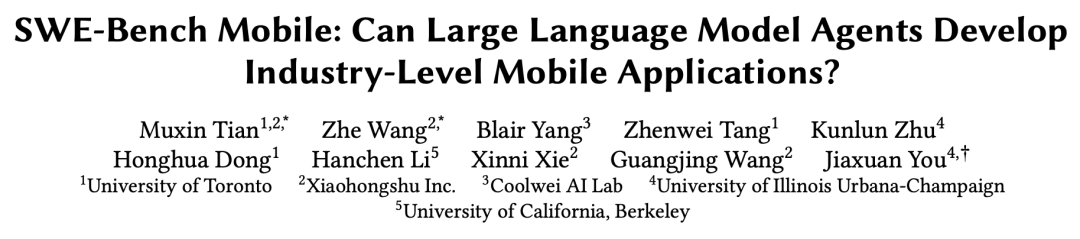

SWE-Bench Mobile — це еталонний тест для виправлення коду, орієнтований на розробку мобільних додатків. Він містить реальні завдання з виправлення помилок у мобільних додатках, які вимагають від AI Agent:

- Розуміння складних структур коду мобільних додатків

- Визначення першопричин проблеми

- Створення правильного коду виправлення

- Забезпечення того, щоб виправлення не створювало нових проблем

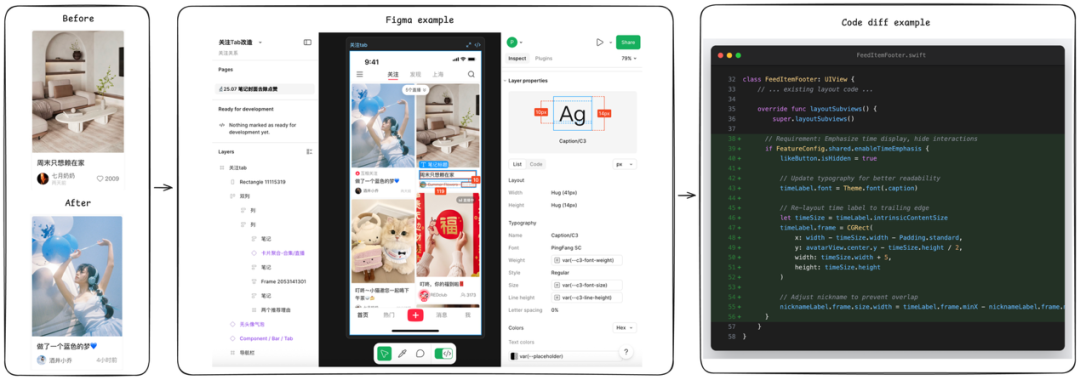

Результати тестування

У тестуванні продуктивність кількох основних AI Agent була такою:

- Найкраща продуктивність: 12% успішності

- Середній рівень: 5-8% успішності

- Деякі моделі: близькі до 0% успішності

Цей результат значно нижчий, ніж продуктивність на традиційному SWE-Bench.

Чому це так складно?

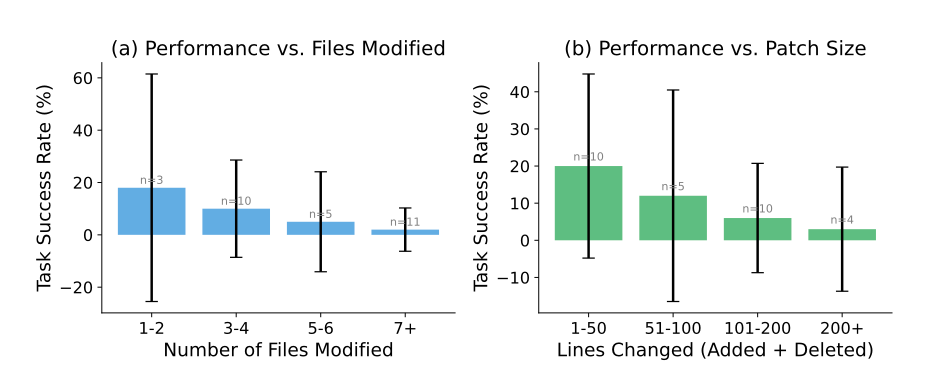

Специфіка кодових баз мобільних додатків створює додаткові виклики:

- Адаптація до кількох платформ: необхідно одночасно враховувати платформи iOS та Android

- Складні залежності: високий ступінь зв'язку між модулями мобільних додатків

- Обмеження продуктивності: мобільні пристрої мають обмежені ресурси, високі вимоги до оптимізації коду

- Складна логіка UI: код взаємодії з інтерфейсом важко аналізувати статично

Порівняння з традиційними еталонами

Порівняно з традиційним SWE-Bench, складність Mobile версії значно зросла:

- Більший розмір кодової бази

- Складніша бізнес-логіка

- Важче пройти тестові випадки

- Вищі вимоги до контекстного вікна

Галузеве значення

Цей еталонний тест показує обмеження AI Agent у реальних промислових сценаріях. Хоча AI швидко прогресує в генерації коду, йому ще належить пройти довгий шлях у обробці великих, складних реальних проєктів.

Майбутні перспективи

Випуск SWE-Bench Mobile надає важливий стандарт для розвитку інструментів AI-програмування. Він нагадує нам:

- AI-допомога в програмуванні все ще потребує нагляду людини

- Складні проєкти потребують більш інтелектуального розуміння контексту

- Можливості моделі мають значний потенціал для покращення

Посилання на ресурси