智谱GLM-5 esta vez de código abierto, incluso los programadores senior están en peligro...

De verdad, la IA de 2026 está mucho más loca que la de 2025.

Últimamente, yo, que paso 16 horas al día metido en la IA, apenas puedo seguir el ritmo de su evolución. Siento que cada vez que abro los ojos, el mundo ha cambiado.

Y es que ayer por la noche, Zhipu lanzó otra gran bomba, ¡directamente abrió el código de su modelo insignia más potente actual: GLM-5!

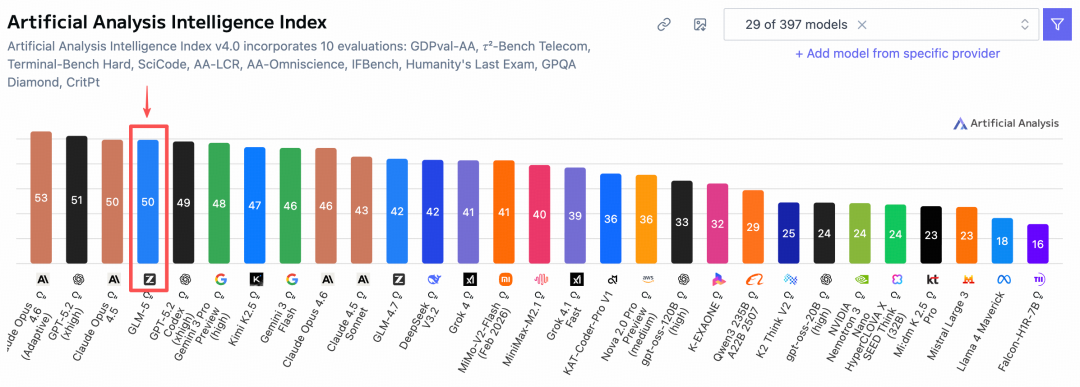

En la lista autorizada mundial de Artificial Analysis, ¡GLM-5 superó a Gemini y alcanzó el cuarto lugar a nivel mundial y el primero de código abierto!

Tal como predije, recuerdo que cuando se lanzó GLM-4.7, hice una predicción con mis hermanos en el artículo: Adivino a ciegas que GLM-4.8 o GLM-5 se lanzarán antes del Festival de Primavera, no esperaba que realmente llegara, jaja 😄

Y esta vez, el número de versión finalmente no es como las actualizaciones anteriores de 4.5, 4.6, 4.7, que eran como exprimir pasta de dientes, esta vez llegó directamente a 5.0.

Esto demuestra que no se trata de pequeñas correcciones, sino de un gran salto en la capacidad de la base.

Primero, les presentaré qué ha actualizado GLM-5 esta vez:

En pocas palabras, los modelos anteriores generalmente se centraban en Vibe Coding, lo que se conoce como generación de una sola frase, para ver quién genera efectos especiales de página web más geniales, para ver quién puede crear un juego genial con una sola frase.

Pero GLM-5 esta vez no compite contigo en esto (¡por fin!), eleva la capacidad del modelo grande de escribir código a poder construir sistemas.

¿Qué significa esto? Su enfoque ya no es escribir páginas front-end bonitas, sino que evoluciona hacia un arquitecto de sistemas que puede hacer el trabajo sucio, el trabajo duro y las tareas largas.

Se enfatiza Agentic Engineering, es decir, la capacidad de ingeniería de agentes inteligentes.

Revisé los datos oficiales, la escala de parámetros pasó de 355B a 744B (activación 40), los datos de preentrenamiento pasaron de 23T a 28.5T.

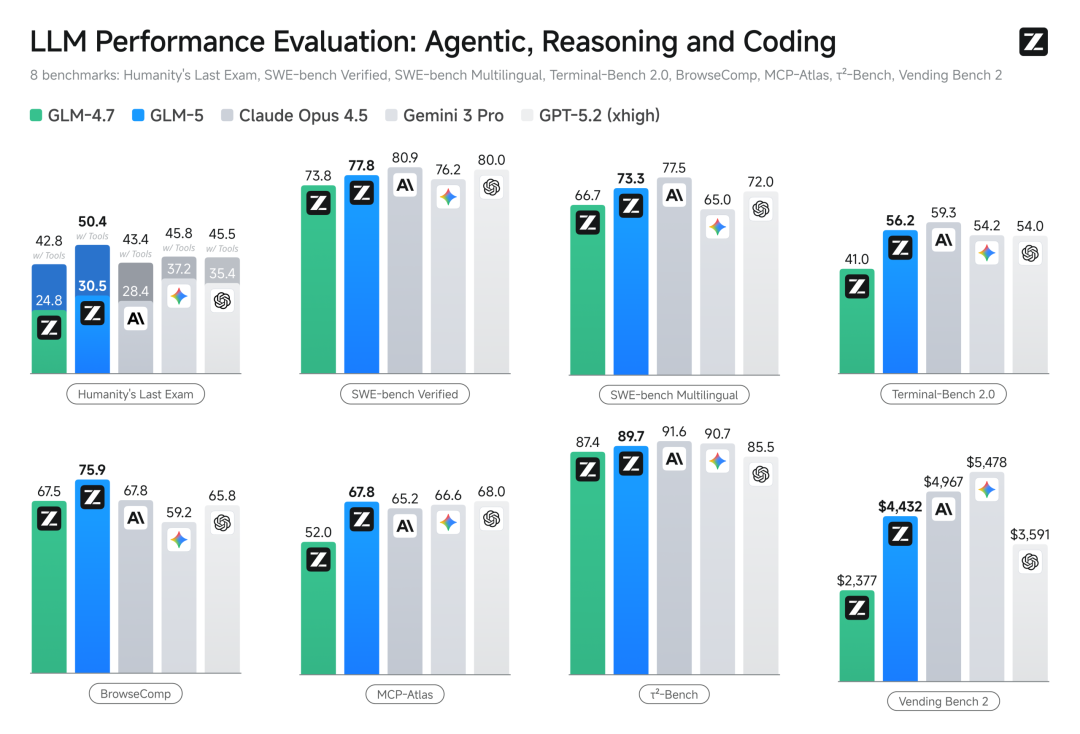

En la prueba de referencia de programación reconocida SWE-bench-Verified, obtuvo una puntuación de 77.8, superando directamente a Gemini 3 Pro, y se puede decir que está a la par con Claude Opus 4.5, el modelo de código cerrado más potente reconocido actualmente.

Actualmente se puede usar gratis en z.ai:

Dirección de código abierto:

GitHub: https://github.com/zai-org/GLM-5

Hugging Face: https://huggingface.co/zai-org/GLM-5

ModelScope: https://modelscope.cn/models/ZhipuAI/GLM-5

De hecho, hace unos días, un modelo misterioso llamado Pony apareció repentinamente en X.

En ese momento, muchos amigos estaban adivinando, ¿qué tipo de deidad es este Pony? Había muchas opiniones.

De hecho, el modelo con el nombre en código Pony es GLM-5, en cuanto a por qué se llama Pony, probablemente porque el año del caballo está a punto de llegar 🤔.

También conecté Pony a Claude Code desde OpenRouter la primera vez para probarlo, para ser honesto, es realmente muy potente (también tiene mucha popularidad en X).

¡Solo tomó 7 minutos generar una estación de transferencia de API de una sola vez!

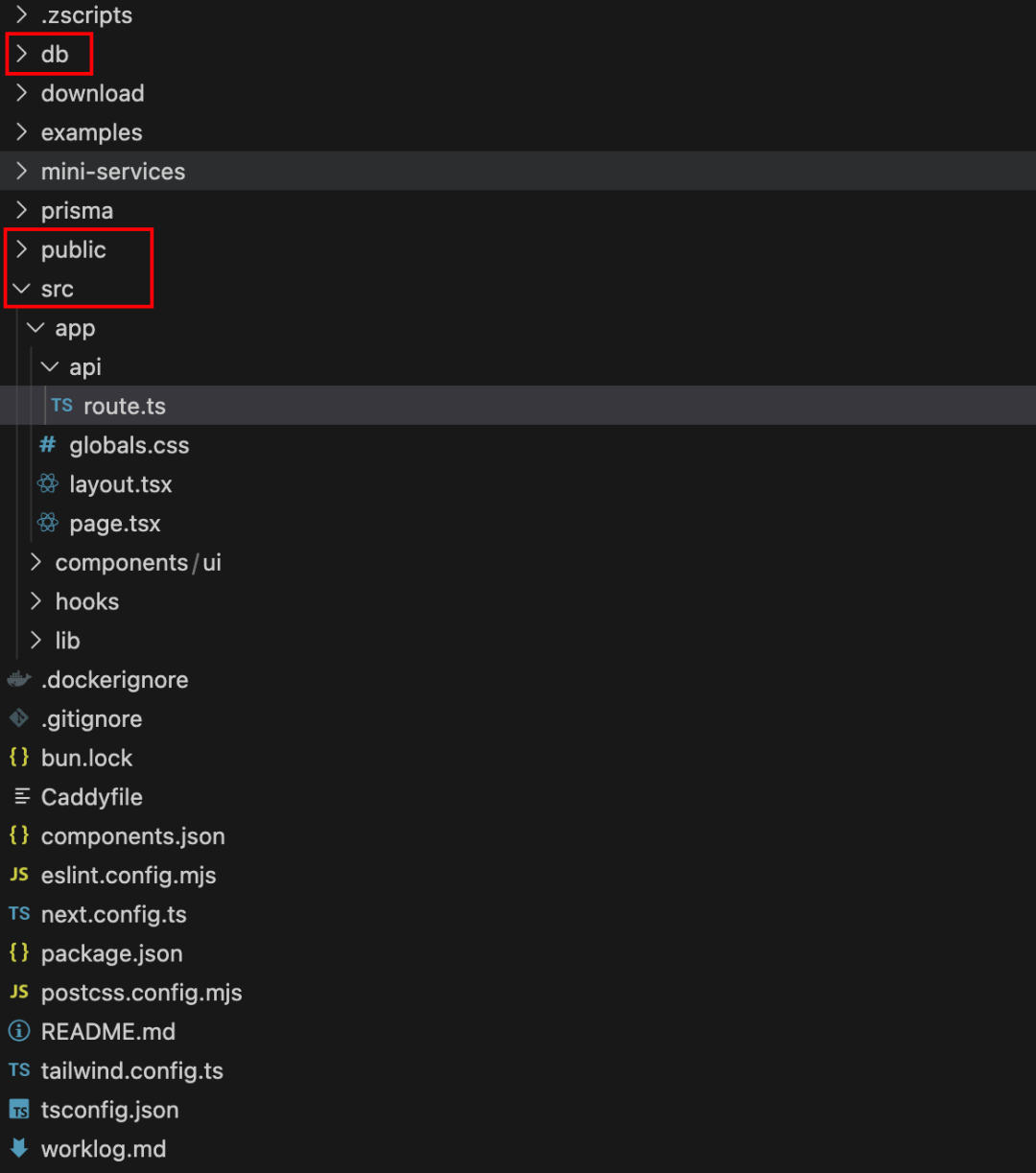

Aunque todavía es una demostración de MVP, las funciones de la página ya están completas e incluyen lógica de back-end y base de datos, los datos son dinámicos, es pequeño pero completo.

Después de una experiencia profunda, descubrí que GLM-5, al hacer planes, tiene un sabor muy parecido a Claude Opus.

Después de una experiencia profunda, descubrí que GLM-5, al hacer planes, tiene un sabor muy parecido a Claude Opus.

Los amigos que están familiarizados con Claude Opus saben que, antes de hacer el trabajo, puede usarlo para enumerar un plan muy detallado y lógicamente riguroso.

GLM-5 ahora también tiene esta capacidad.

Por ejemplo, tengo algo que siempre he querido hacer, pero que no he hecho por pereza.

Tengo un montón de cuentas de membresía de Gemini, ChatGPT, Kimi, Zhipu, etc.

Por lo general, cuando escribo artículos o busco información, a menudo quiero escuchar las opiniones de múltiples IA sobre algunos problemas y compararlas de manera integral.那我就得打开多个浏览器窗口,复制切换不同窗口粘贴发送多次,然后轮流切换窗口查看结果。

虽然也不是多大的事儿,但次数多了真的很烦。

我就在想,能不能做一个浏览器插件,能统一在一个窗口里面,同时向这四个AI的网页端发送同一个问题,然后在插件里面统一收到回复?

但是这玩意儿还挺麻烦的,因为每个AI网站的结构都不一样,还有各种保护机制,需要去分析它们的DOM结构。

于是,我就把这个复杂的任务交给了GLM-5。

开启Claude Code的Plan Mode先让它做个计划

然后它还会跟我互动,询问我的意见:

最终得到的计划非常详细,真的太长了,有633行。。

然后就按照计划开始吭哧吭哧执行了,没想到第一步初始化项目就跑了50多分钟..

在这个过程中,它自动调用了Playwright MCP工具,自己打开浏览器,去访问那几个AI的网站。

它就像一个真的程序员一样,去键检查元素,去分析输入框在哪里,发送按钮的Class是什么,怎么获取返回的文本流...整个过程全自动,我一行代码都没写。

PS:忘记录屏了,因为我同时还在其他窗口跑另一个任务

等待是值得的,我想要的一次提问、全网AI同时回答的插件,就这么热气腾腾地出炉了。

等待是值得的,我想要的一次提问、全网AI同时回答的插件,就这么热气腾腾地出炉了。

这完全就是我需要的东西~

另外,我之前不是做了一个数字人营销视频一键生成平台嘛。

后来为了追求更好的体验,我重构了一下前端,这一重构不要紧,整个项目可以说是乱成了一锅粥:前后端接口对不上,后端的一些老旧逻辑在新前端面前跑不通,Bug非常多,搞起来很麻烦。

这次,我在Claude Code开启plan mode,然后直接把主流程找bug,改bug的任务甩给了GLM-5

先出来一份详细的计划:

确认计划无误后,我就让它吭呲吭呲开始执行了(过程中用到了浏览器mcp来控制)。

它的执行速度并不快。

但并不是模型慢,很多时候,我看那个Token的消耗速度,肉眼可见地一秒钟就窜到上千了。

但是因为任务太复杂,它需要不断地自我反思、调用工具、运行测试。

也有一些时间是消耗在依赖下载,或者命令执行上。

这个修复任务,也整整执行了40多分钟。

可能有的朋友会说,40分钟?我都写完了。

emmm,但这40分钟里,我就开着录屏,刷视频,甚至去遛了狗。

而它是在全神贯注帮我干活,而且是干那种最让人头秃的找Bug和重构的活。

别看它执行得慢,但是最终得到的效果是非常显著的。

我一运行,好家伙,问题基本都搞定了。

请看VCR:

这里面也有一些效果是我后续自己测的时候发现小Bug,然后让它修复并优化的。

但是在修Bug和优化功能这块,我是真的放心交给它。

以前用别的AI改Bug,经常是担心bug越改越多,项目越改越乱,典型的拆了东墙补西墙..

之前为了规避这个问题,得用各种工程化的手段去约束AI。

比如每次修改 强调范围,或者把这些写到规则里面,或者每次只改一个bug,每次改完,还得测一下别的功能...反正很麻烦。

但是用GLM-5修改Bug,体验完全变了。

我从来就是只需要描述现状,把报错日志丢给它,告诉它我期望的效果是什么。

它几乎都能一次修复成功,而且完全不会影响别的功能。

甚至,我在一次对话中,直接把整个流程中发现的四个不同的Bug,一股脑全扔给它,它也能条理清晰的一个个修好。

这种稳健的感觉,真的太舒服了。

我现在可以放心交给GLM-5帮我完成任何复杂的开发任务,基本不会出错。

即便偶尔有问题,大不了在Claude Code里面执行一下回滚命令,倒回去重来就好了。

整个项目用GLM-5优化了一圈之后,所有流程基本都搞定了。También me estoy preparando para abrir este proyecto al código abierto muy pronto (todavía necesito extraer la parte de la API de varios modelos y convertirla en configuración).

«Finalmente»

Después de experimentar GLM-5, mi mayor sentimiento es: La IA china realmente se ha puesto de pie.

Hace unos días, se lanzó Seedance 2.0 de ByteDance, lo que demuestra que los modelos chinos nacionales han alcanzado el primer nivel mundial en el campo de la generación de video, superando directamente a Sora2 y Veo3.1.

Y esta vez, el lanzamiento de GLM-5 de Zhipu ha entregado una respuesta inesperada en otra pista hardcore, AI Coding.

Solíamos decir que los modelos nacionales tenían una brecha con GPT, Claude Opus y Gemini en el razonamiento lógico y la escritura de código.

Pero hoy, GLM-5 nos dice con un rendimiento sólido: esta brecha se está cerrando.

GLM-5 no es solo un juguete que se puede usar para hacer demostraciones, es una herramienta de productividad que realmente puede ayudarlo a hacer el trabajo, ayudarlo a construir sistemas, ayudarlo a resolver tareas largas y problemas complejos.

Lo más importante es que es de código abierto.

Esto significa que cada desarrollador, cada empresa, puede tener un arquitecto de IA de primer nivel a un costo menor.

Y actualmente, el Plan de Codificación de GLM se ha agotado, el funcionario emitió un anuncio diciendo que se está expandiendo urgentemente, y el punto clave es que esta vez está conectado a un clúster de diez mil tarjetas de chips nacionales.

Sin embargo, debido al aumento de la inversión en potencia informática, el precio ha aumentado un poco, afortunadamente obtuve el paquete Max antes.

Aquí también podemos ver que, desde los chips hasta los modelos, desde la potencia informática subyacente hasta las aplicaciones de nivel superior, estamos construyendo un conjunto de pila de tecnología de IA de primer nivel mundial que es completamente nuestra.

2026 está destinado a ser un año de explosión de aplicaciones de IA, y también un año más loco.

Si también quieres experimentar la sensación de tener un arquitecto de IA de primer nivel, date prisa y prueba GLM-5.El requisito es que consigas el paquete Max, jaja.