智谱GLM-5:n avoimen lähdekoodin julkaisu uhkaa jopa kokeneita ohjelmoijia...

Todellakin, tekoäly on vuonna 2026 paljon hullumpi kuin vuonna 2025.

Viime aikoina minun, joka vietän 16 tuntia päivässä tekoälyn parissa, on ollut vaikea pysyä tekoälyn evoluution vauhdissa. Tuntuu, että joka aamu maailma on muuttunut.

Tämän lisäksi Zhipu julkaisi eilen myöhään illalla suuren uutisen ja julkaisi suoraan avoimen lähdekoodin heidän tällä hetkellä vahvimmasta lippulaivamallistaan: GLM-5.

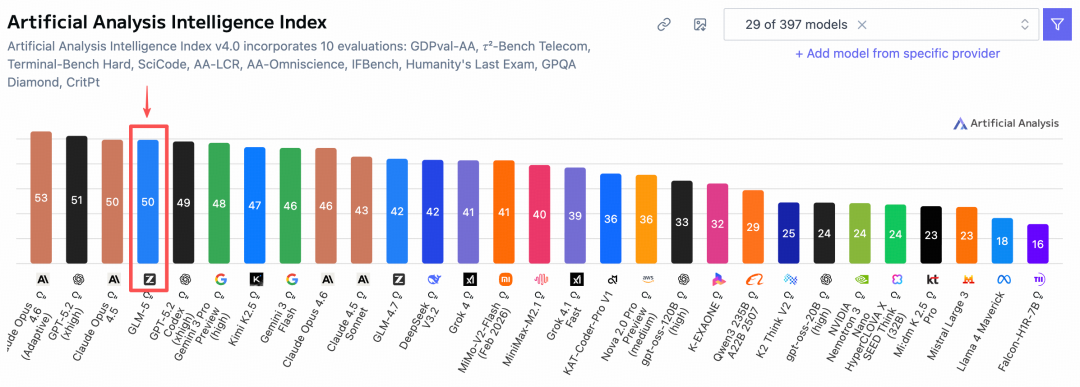

Maailmanlaajuisesti arvostetulla Artificial Analysis -listalla GLM-5 ylitti Geminin ja sijoittui maailmanlaajuisesti neljänneksi ja avoimen lähdekoodin mallien ykköseksi!

Se on juuri niin kuin odotin. Muistan, että kun GLM-4.7 julkaistiin viimeksi, ennustin artikkelissani veljilleni: arvaan sokkona, että GLM-4.8 tai GLM-5 julkaistaan juuri ennen kevätjuhlaa. En uskonut, että se todella toteutuisi, haha 😄

Ja tällä kertaa versionumero ei vihdoin ole niin kuin aiemmin, 4.5, 4.6, 4.7, eli vähittäinen päivitys, vaan tällä kertaa se on suoraan 5.0.

Tämä osoittaa, että kyseessä ei ole mikään pieni korjaus, vaan suuri harppaus pohjalla olevassa kyvyssä.

Esittelen ensin kaikille, mitä GLM-5 on päivittänyt:

Yksinkertaisesti sanottuna aiemmat mallit ovat yleensä kilpailleet Vibe Codingissa, eli niin sanotussa yhden lauseen generoinnissa, jossa katsotaan, kuka pystyy luomaan tyylikkäämpiä verkkotehosteita ja kuka pystyy luomaan tyylikkään pelin yhdellä lauseella.

Mutta GLM-5 ei kilpaile tästä kanssasi tällä kertaa (vihdoin!), vaan se on nostanut suuren kielimallin kyvyn koodin kirjoittamisesta järjestelmien rakentamiseen.

Mitä tämä tarkoittaa? Sen painopiste ei ole enää kauniiden käyttöliittymäsivujen kirjoittamisessa, vaan se on kehittynyt järjestelmäarkkitehdiksi, joka pystyy tekemään likaisia, raskaita ja pitkiä tehtäviä.

Se korostaa Agentic Engineeringiä, eli älykkään agentin suunnitteluosaamista.

Katsoin virallisia tietoja, parametrien määrä on kasvanut 355 miljardista 744 miljardiin (aktivointi 40) ja esikoulutustiedot 23 terasta 28,5 teraan.

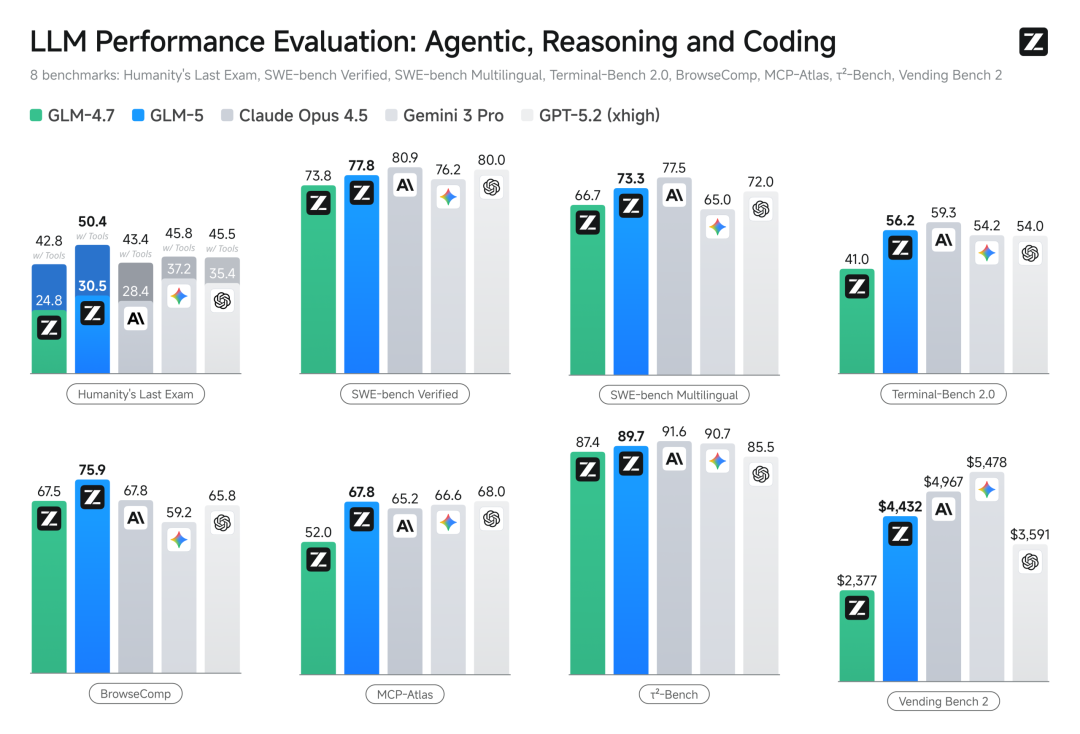

SWE-bench-Verified -ohjelmointitestissä se sai 77,8 pistettä ja jätti Geminin 3 Pron suoraan taakseen, ja se on lähes samaa tasoa kuin tällä hetkellä tunnustettu vahvin suljetun lähdekoodin malli Claude Opus 4.5.

Tällä hetkellä sitä voi käyttää ilmaiseksi z.ai:ssa:

Avoimen lähdekoodin osoite:

GitHub: https://github.com/zai-org/GLM-5

Hugging Face: https://huggingface.co/zai-org/GLM-5

ModelScope: https://modelscope.cn/models/ZhipuAI/GLM-5

Itse asiassa muutama päivä sitten X:ssä ilmestyi yhtäkkiä salaperäinen malli nimeltä Pony.

Tuolloin monet ystävät arvasivat, mikä ihme tämä Pony oikein on? Mielipiteitä oli monia.

Itse asiassa koodinimi Pony on GLM-5. Miksi sitä kutsutaan Ponyksi? Ehkä siksi, että hevosen vuosi on tulossa 🤔.

Liitin myös Ponyn ensimmäisenä OpenRouterista Claude Codeen ja kokeilin sitä. Rehellisesti sanottuna se on todella vahva (ja erittäin suosittu X:ssä).

Se loi API-välityspalvelimen kertaluonteisesti vain 7 minuutissa!

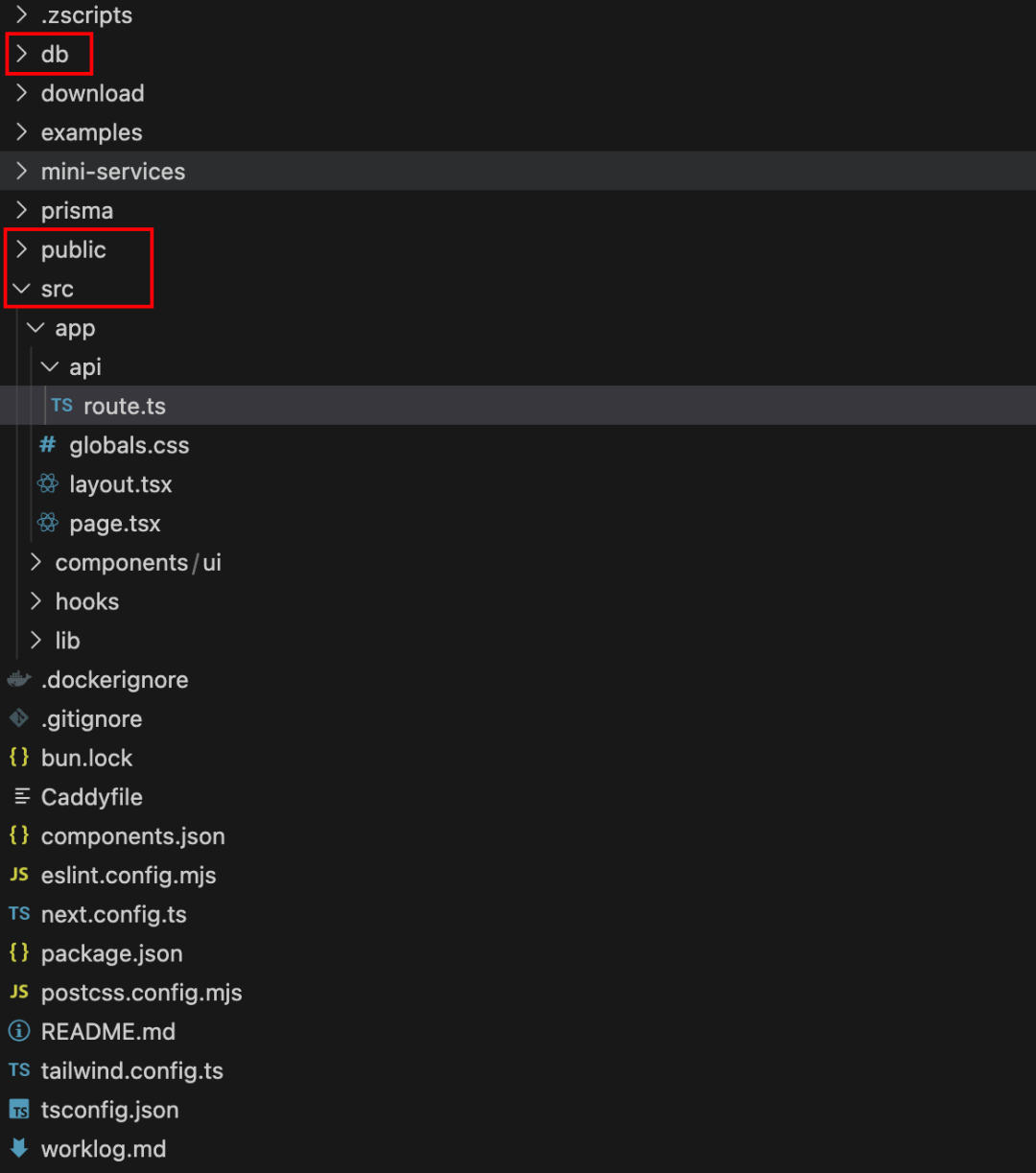

Vaikka se on vielä MVP-demo, sivun toiminnot ovat jo hyvin täydelliset ja sisältävät myös taustalogiikan ja tietokannan. Tiedot ovat dynaamisia, pieni mutta täydellinen.

Syvällisen kokemuksen jälkeen huomasin, että GLM-5:n suunnitelmien laatimisessa on sama maku kuin Claude Opuksessa.

Syvällisen kokemuksen jälkeen huomasin, että GLM-5:n suunnitelmien laatimisessa on sama maku kuin Claude Opuksessa.

Claude Opuksen tuntevat tietävät, että ennen töiden aloittamista se antaa sinulle erittäin yksityiskohtaisen ja loogisen suunnitelman.

GLM-5:llä on nyt myös tämä kyky.

Esimerkiksi minulla on asia, jonka olen aina halunnut tehdä, mutta en ole saanut aikaiseksi laiskuuden vuoksi.

Minulla on käsilläni Gemini-, ChatGPT-, Kimi-, Zhipu- ja monia muita jäsentilejä.

Kirjoittaessani artikkeleita tai etsiessäni tietoa haluan usein kuulla useiden tekoälyjen mielipiteitä ja verrata niitä kattavasti.Silloin minun täytyisi avata useita selainikkunoita, kopioida ja vaihtaa eri ikkunoiden välillä, liittää ja lähettää useita kertoja, ja sitten vuorotellen vaihtaa ikkunoita tarkistaakseni tulokset.

Se ei ole mikään iso juttu, mutta se on todella ärsyttävää, kun sitä tekee monta kertaa.

Ajattelin, voisinko tehdä selainlaajennuksen, joka voisi yhtenäisesti lähettää saman kysymyksen näiden neljän tekoälyn verkkosivuille yhdessä ikkunassa ja sitten vastaanottaa vastaukset yhtenäisesti laajennuksessa?

Mutta tämä on melko hankalaa, koska jokaisen tekoälysivuston rakenne on erilainen, ja on olemassa erilaisia suojamekanismeja, jotka vaativat niiden DOM-rakenteiden analysointia.

Joten annoin tämän monimutkaisen tehtävän GLM-5:lle.

Käynnistin Claude Coden Plan Moden, jotta se tekisi ensin suunnitelman

Sitten se myös vuorovaikuttaa kanssani ja kysyy mielipiteitäni:

Lopullinen suunnitelma on erittäin yksityiskohtainen, todella pitkä, 633 riviä..

Sitten se alkoi toteuttaa suunnitelmaa, ja yllätyksekseni ensimmäisen vaiheen projektin alustaminen kesti yli 50 minuuttia..

Tämän prosessin aikana se automaattisesti käytti Playwright MCP -työkalua, avasi itse selaimen ja vieraili noiden tekoälysivustojen sivuilla.

Se on kuin oikea ohjelmoija, joka tarkistaa elementtejä, analysoi missä syöttökenttä on, mikä on lähetyspainikkeen luokka, miten palautettava tekstivirta saadaan... koko prosessi on täysin automaattinen, en kirjoittanut riviäkään koodia.

PS: Unohdin nauhoittaa näytön, koska suoritin samanaikaisesti toista tehtävää muissa ikkunoissa

Odottaminen oli sen arvoista, haluamani laajennus, joka mahdollistaa kysymyksen esittämisen kerran ja vastausten saamisen kaikilta tekoälyiltä samanaikaisesti, syntyi juuri niin.

Odottaminen oli sen arvoista, haluamani laajennus, joka mahdollistaa kysymyksen esittämisen kerran ja vastausten saamisen kaikilta tekoälyiltä samanaikaisesti, syntyi juuri niin.

Tämä on täsmälleen mitä tarvitsin~

Lisäksi, enkö tehnyt aiemmin digitaalisen ihmisen markkinointivideon yhden painikkeen luontialustaa?

Myöhemmin, paremman käyttökokemuksen saavuttamiseksi, uudelleenrakenin käyttöliittymän, ja tämä uudelleenrakentaminen sai koko projektin sekaisin: käyttöliittymän ja taustajärjestelmän rajapinnat eivät täsmänneet, taustajärjestelmän vanhat logiikat eivät toimineet uuden käyttöliittymän kanssa, bugeja oli paljon ja niiden korjaaminen oli hankalaa.

Tällä kertaa käynnistin Claude Codessa plan moden ja annoin suoraan GLM-5:lle pääprosessin bugien etsimisen ja korjaamisen tehtävän.

Ensin laadittiin yksityiskohtainen suunnitelma:

Varmistettuani, että suunnitelma oli oikea, annoin sen alkaa toteuttaa sitä (prosessissa käytettiin selain-MCP:tä ohjaamaan).

Sen toteutusnopeus ei ole nopea.

Mutta se ei johdu mallin hitaudesta, usein näen, että Tokenin kulutusnopeus nousee silminnähtävästi tuhansiin sekunnissa.

Mutta koska tehtävä on liian monimutkainen, sen on jatkuvasti pohdittava itseään, käytettävä työkaluja ja suoritettava testejä.

Osa ajasta kuluu riippuvuuksien lataamiseen tai komentojen suorittamiseen.

Tämä korjaustehtävä kesti myös yli 40 minuuttia.

Jotkut ystävät saattavat sanoa, 40 minuuttia? Olisin jo kirjoittanut sen valmiiksi.

Emm, mutta näiden 40 minuutin aikana pidin nauhoituksen päällä, katsoin videoita ja jopa kävin ulkoiluttamassa koiraa.

Ja se auttoi minua keskittyneesti, ja teki sellaista työtä, joka on kaikkein turhauttavinta, eli bugien etsimistä ja uudelleenrakentamista.

Älä anna sen hitaan suorituskyvyn hämätä, lopullinen vaikutus on erittäin merkittävä.

Kun suoritin sen, kaikki ongelmat olivat periaatteessa ratkaistu.

Katso VCR:

Tässä on myös joitain vaikutuksia, jotka löysin myöhemmin testatessani pieniä bugeja ja pyysin sitä korjaamaan ja optimoimaan.

Mutta bugien korjaamisen ja toimintojen optimoinnin osalta voin todella luottaa siihen.

Aiemmin, kun käytin muita tekoälyjä bugien korjaamiseen, olin usein huolissani siitä, että bugeja tulisi enemmän ja enemmän, ja projekti menisi yhä sekaisemmaksi, tyypillisesti korjattaisiin toinen seinä rikkomalla toinen..

Aiemmin, jotta tämä ongelma vältettäisiin, oli käytettävä erilaisia insinööritieteellisiä keinoja tekoälyn rajoittamiseen.

Esimerkiksi korostamalla aina muutosten laajuutta, tai kirjoittamalla ne sääntöihin, tai muuttamalla vain yhtä bugia kerrallaan, ja jokaisen muutoksen jälkeen oli testattava muita toimintoja... joka tapauksessa se oli erittäin hankalaa.

Mutta GLM-5:n käyttäminen bugien korjaamiseen muutti kokemuksen täysin.

Minun tarvitsee vain kuvailla nykytilaa, heittää sille virhelokit ja kertoa sille, mitä vaikutusta odotan.

Se pystyy melkein aina korjaamaan sen onnistuneesti kerralla, eikä se vaikuta muihin toimintoihin.

Jopa kerran, yhdessä keskustelussa, heitin sille suoraan kaikki neljä eri bugia, jotka löysin koko prosessin aikana, ja se pystyi korjaamaan ne kaikki selkeästi yksi kerrallaan.

Tämä vakaa tunne on todella mukava.

Voin nyt luottaa GLM-5:een auttamaan minua suorittamaan kaikki monimutkaiset kehitystehtävät, eikä se periaatteessa tee virheitä.

Jopa joskus on ongelmia, voin yksinkertaisesti suorittaa Claude Codessa palautuskomennon ja palata takaisin aloittamaan alusta.

Kun koko projekti oli optimoitu GLM-5:llä, kaikki prosessit olivat periaatteessa valmiit.Aion myös pian avata tämän projektin lähdekoodin (eri mallien API-osuudet on vielä erotettava ja muutettava konfiguraatioksi).

"Lopuksi"

GLM-5:n kokeilun jälkeen suurin tunteeni on: Kotimainen tekoäly on todella noussut jaloilleen.

Muutama päivä sitten ByteDancen Seedance 2.0 julkaistiin, mikä todisti, että kiinalaiset kotimaiset mallit ovat saavuttaneet maailman ykköstason videoiden generoinnin alalla, ohittaen suoraan Sora2:n ja Veo3.1:n.

Ja tällä kertaa Zhipu GLM-5:n julkaisu on toisella kovemmalla AI Coding -radalla, ja se on antanut odotukset ylittävän vastauksen.

Olemme aiemmin aina sanoneet, että kotimaisilla malleilla on eroja GPT:hen, Claude Opusiin ja Geminiin verrattuna loogisessa päättelyssä ja koodin kirjoittamisessa.

Mutta tänään GLM-5 kertoo meille konkreettisilla tuloksilla: tämä ero on tasoittumassa.

GLM-5 ei ole myöskään vain lelu, jota voidaan käyttää demona, vaan se on tuottavuustyökalu, joka todella auttaa sinua tekemään töitä, rakentamaan järjestelmiä, ratkaisemaan pitkiä tehtäviä ja monimutkaisia ongelmia.

Tärkeintä on, että se on avoimen lähdekoodin.

Tämä tarkoittaa, että jokaisella kehittäjällä, jokaisella yrityksellä voi olla huippuluokan tekoälyarkkitehti alhaisemmilla kustannuksilla.

Ja tällä hetkellä GLM:n Coding Plan on myyty loppuun, ja viranomaiset ovat julkaisseet ilmoituksen, että he laajentavat kapasiteettia kiireellisesti, ja mikä tärkeintä, tällä kertaa on liitetty kotimaisten sirujen tuhansien korttien klusteri.

Laskentatehon lisääntyneen panostuksen vuoksi hinnat ovat kuitenkin nousseet jonkin verran, onneksi sain aiemmin hankittua Max-paketin

Tästä voidaan myös nähdä, että siruista malleihin, pohjatason laskentatehosta ylemmän tason sovelluksiin, olemme rakentamassa täysin omaa, maailmanluokan tekoälyteknologiapinoa.

Vuosi 2026 on määrätty olemaan tekoälysovellusten räjähdysmäinen vuosi ja myös hullumpi vuosi.

Jos haluat myös kokea tämän huippuluokan tekoälyarkkitehdin tunteen, mene ja kokeile GLM-5:tä.Edellytyksenä on, että onnistut nappaamaan Max-paketin, haha.