**Vraiment, l'IA de 2026 est bien plus folle que celle de 2025.**

Récemment, moi qui passe 16 heures par jour plongé dans l'IA, j'ai du mal à suivre le rythme de son évolution. J'ai l'impression que le monde change chaque fois que j'ouvre les yeux.

Et voilà, hier soir, Zhipu a encore frappé fort en **ouvrant** son modèle phare le **plus puissant** à ce jour : **GLM-5**.

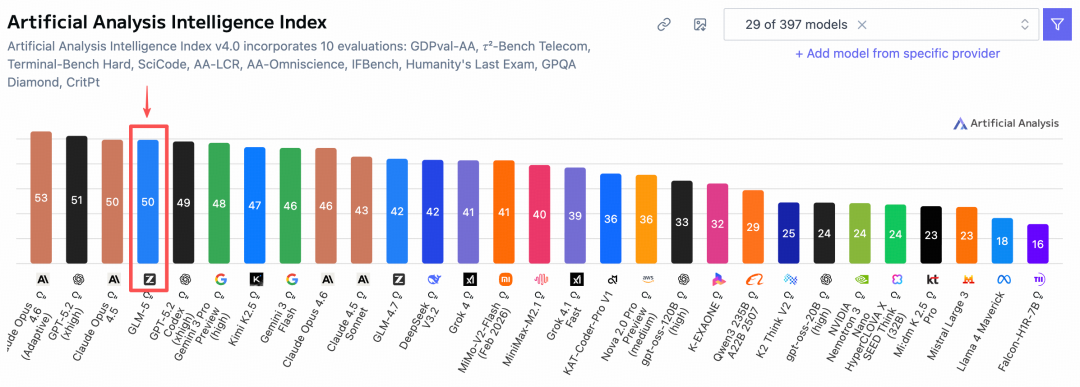

Dans le classement mondial faisant autorité d'Artificial Analysis, **GLM-5 a dépassé Gemini pour se hisser à la quatrième place mondiale et à la première place en open source !**

Comme je l'avais prévu, je me souviens que lors de la dernière publication de GLM-4.7, j'avais fait une prédiction à mes frères dans l'article : je devine que GLM-4.8 ou GLM-5 sera publié juste avant la Fête du Printemps, et c'est arrivé, haha 😄

De plus, cette fois, le numéro de version n'est enfin plus une mise à jour au compte-gouttes comme les précédentes 4.5, 4.6 et 4.7, mais est directement passé à 5.0.

Cela montre qu'il ne s'agit pas d'une petite retouche, mais d'un grand bond en avant dans les capacités de la base.

**Permettez-moi de vous présenter ce qui a été mis à jour dans GLM-5 :**

En termes simples, les modèles précédents étaient généralement axés sur le Vibe Coding, c'est-à-dire la génération de phrases, pour voir qui pouvait générer les effets spéciaux de page Web les plus cool, et qui pouvait créer un jeu cool en une seule phrase.

Mais GLM-5 ne se concentre plus sur cela (enfin !), il élève la capacité du grand modèle de l'écriture de code à la construction de systèmes.

Qu'est-ce que cela signifie ? Son objectif n'est plus d'écrire de belles pages frontales, mais d'évoluer vers un architecte système capable de faire le sale boulot, le travail acharné et les tâches de longue haleine.

L'accent est mis sur l'Agentic Engineering, c'est-à-dire la capacité d'ingénierie des agents intelligents.

J'ai regardé les données officielles, la taille des paramètres est passée de **355B à 744B (activation 40)**, et les données de pré-entraînement sont passées de **23T à 28.5T**.

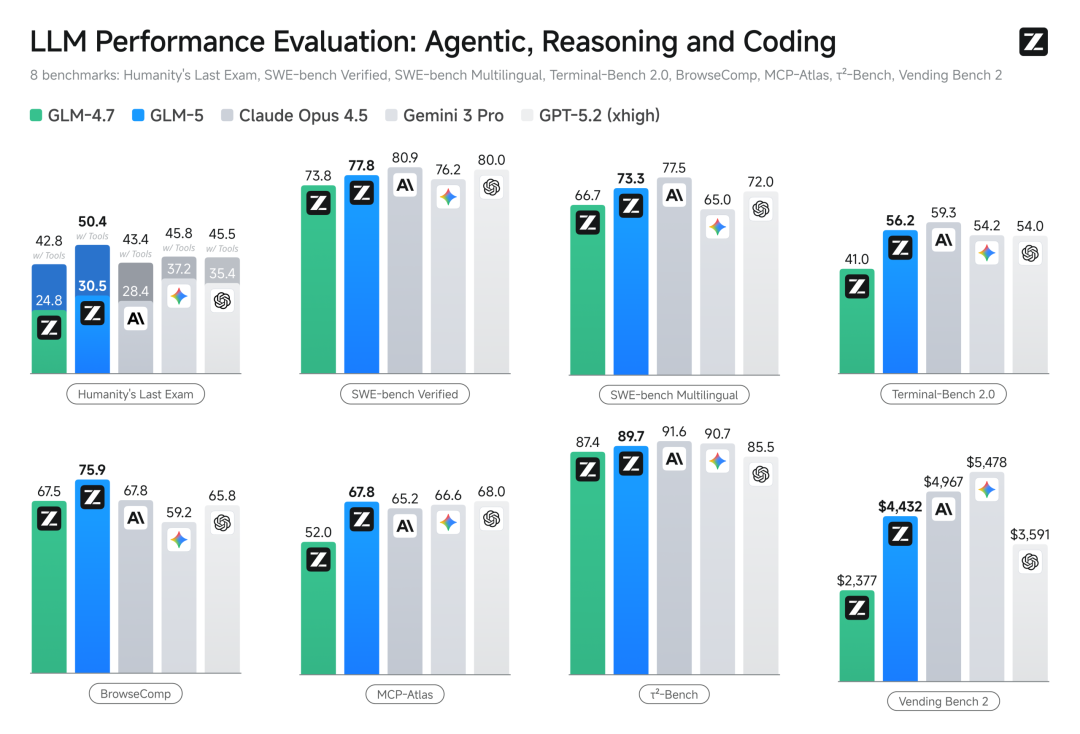

Dans le test de référence de programmation reconnu SWE-bench-Verified, il a obtenu un score de 77,8, laissant directement Gemini 3 Pro derrière lui, et **peut être considéré comme comparable au modèle fermé le plus puissant actuellement reconnu, Claude Opus 4.5.**

**Il est actuellement disponible gratuitement sur z.ai :**

**Adresse open source :**

GitHub : https://github.com/zai-org/GLM-5

Hugging Face : https://huggingface.co/zai-org/GLM-5

ModelScope : https://modelscope.cn/models/ZhipuAI/GLM-5

En fait, il y a quelques jours, **un modèle mystérieux appelé Pony est soudainement apparu sur X.**

À l'époque, de nombreux amis se demandaient quel était ce Pony ? Il y avait beaucoup de spéculations.

En fait, le modèle nommé Pony est GLM-5, quant à savoir pourquoi il s'appelle Pony, c'est probablement parce que l'année du cheval approche 🤔.

J'ai également connecté Pony à Claude Code depuis OpenRouter dès que possible pour l'essayer, et pour être honnête, c'est vraiment très puissant (et très populaire sur X).

**Il n'a fallu que 7 minutes pour générer une station de transfert d'API en une seule fois !**

Bien qu'il s'agisse encore d'une démo MVP, les fonctions de la page sont déjà très complètes, et comprennent la logique backend, ainsi que la base de données, les données sont dynamiques, c'est petit mais complet.

Après une expérience approfondie, j'ai découvert que le goût de GLM-5 lors de l'élaboration de plans est très similaire à celui de Claude Opus.

Les amis qui connaissent Claude Opus savent qu'avant de se mettre au travail, vous pouvez l'utiliser pour vous dresser un plan très détaillé et logiquement rigoureux.

GLM-5 a maintenant cette capacité.

Par exemple, il y a une chose que j'ai toujours voulu faire, mais que je n'ai jamais faite par paresse.

J'ai un tas de comptes premium Gemini, ChatGPT, Kimi, Zhipu, etc.

Habituellement, lorsque j'écris des articles ou que je recherche des informations, j'aime souvent écouter les opinions de plusieurs IA sur certaines questions et les comparer de manière exhaustive.

那我就得打开多个浏览器窗口,复制切换不同窗口粘贴发送多次,然后轮流切换窗口查看结果。

虽然也不是多大的事儿,但次数多了真的很烦。

我就在想,**能不能做一个浏览器插件,能统一在一个窗口里面,同时向这四个AI的网页端发送同一个问题,然后在插件里面统一收到回复?**

但是这玩意儿还挺麻烦的,因为每个AI网站的结构都不一样,还有各种保护机制,需要去分析它们的DOM结构。

于是,我就把这个复杂的任务交给了GLM-5。

开启Claude Code的Plan Mode先让它做个计划

然后它还会跟我互动,询问我的意见:

最终得到的计划非常详细,真的太长了,有633行。。

然后就按照计划开始吭哧吭哧执行了,没想到第一步初始化项目就跑了50多分钟..

在这个过程中,它自动调用了Playwright MCP工具,自己打开浏览器,去访问那几个AI的网站。

它就像一个真的程序员一样,去键检查元素,去分析输入框在哪里,发送按钮的Class是什么,怎么获取返回的文本流...整个过程全自动,我一行代码都没写。

PS:忘记录屏了,因为我同时还在其他窗口跑另一个任务

等待是值得的,我想要的一次提问、全网AI同时回答的插件,就这么热气腾腾地出炉了。

这完全就是我需要的东西~

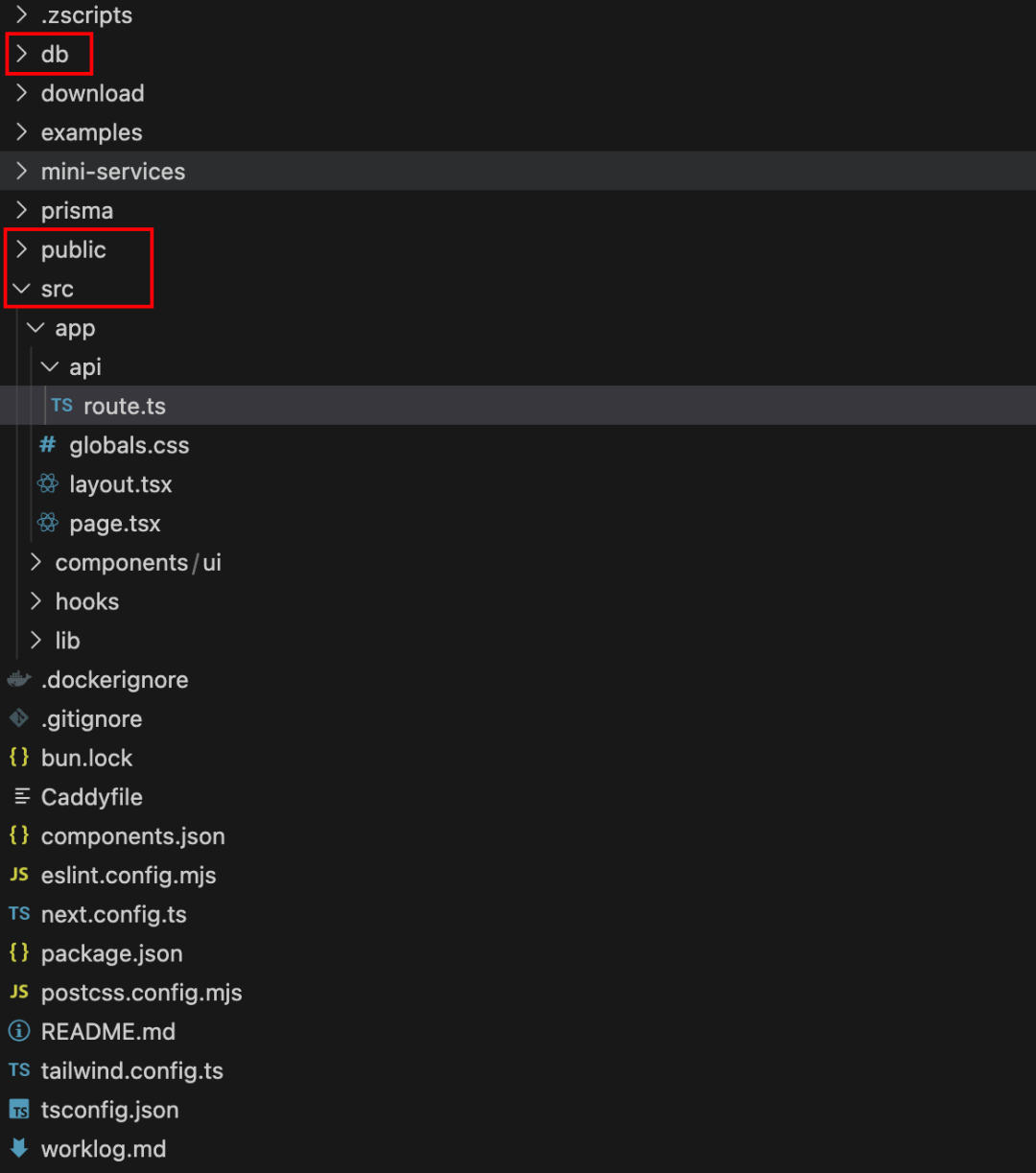

另外,**我之前不是做了一个数字人营销视频一键生成平台嘛。**

后来为了追求更好的体验,我重构了一下前端,这一重构不要紧,整个项目可以说是乱成了一锅粥:前后端接口对不上,后端的一些老旧逻辑在新前端面前跑不通,Bug非常多,搞起来很麻烦。

这次,我在Claude Code开启plan mode,然后直接把主流程找bug,改bug的任务甩给了GLM-5

先出来一份详细的计划:

确认计划无误后,我就让它吭呲吭呲开始执行了(过程中用到了浏览器mcp来控制)。

它的执行速度并不快。

但并不是模型慢,很多时候,我看那个Token的消耗速度,肉眼可见地一秒钟就窜到上千了。

但是因为任务太复杂,它需要不断地自我反思、调用工具、运行测试。

也有一些时间是消耗在依赖下载,或者命令执行上。

这个修复任务,也整整执行了40多分钟。

可能有的朋友会说,40分钟?我都写完了。

emmm,但这40分钟里,我就开着录屏,刷视频,甚至去遛了狗。

而它是在全神贯注帮我干活,而且是干那种最让人头秃的找Bug和重构的活。

别看它执行得慢,但是最终得到的效果是非常显著的。

我一运行,好家伙,问题基本都搞定了。

请看VCR:

这里面也有一些效果是我后续自己测的时候发现小Bug,然后让它修复并优化的。

但是在修Bug和优化功能这块,我是真的放心交给它。

以前用别的AI改Bug,经常是担心bug越改越多,项目越改越乱,典型的拆了东墙补西墙..

之前为了规避这个问题,得用各种工程化的手段去约束AI。

比如每次修改 强调范围,或者把这些写到规则里面,或者每次只改一个bug,每次改完,还得测一下别的功能...反正很麻烦。

但是用GLM-5修改Bug,体验完全变了。

我从来就是只需要描述现状,把报错日志丢给它,告诉它我期望的效果是什么。

它几乎都能一次修复成功,而且完全不会影响别的功能。

甚至,我在一次对话中,直接把整个流程中发现的四个不同的Bug,一股脑全扔给它,它也能条理清晰的一个个修好。

这种稳健的感觉,真的太舒服了。

我现在可以放心交给GLM-5帮我完成任何复杂的开发任务,基本不会出错。

即便偶尔有问题,大不了在Claude Code里面执行一下回滚命令,倒回去重来就好了。

整个项目用GLM-5优化了一圈之后,所有流程基本都搞定了。

**Je prévois également de rendre ce projet open source très prochainement (il faut encore extraire la partie des diverses API de modèles et la transformer en configuration).**

**« Enfin »**

Après avoir testé GLM-5, mon plus grand sentiment est le suivant : **l’IA chinoise s’est vraiment relevée.**

Il y a quelques jours, la sortie de Seedance 2.0 de ByteDance a prouvé que les modèles chinois nationaux avaient atteint le premier niveau mondial dans le domaine de la génération vidéo, dépassant directement Sora2 et Veo3.1.

Et cette fois, la sortie de GLM-5 de Zhipu a rendu une copie inattendue sur une autre piste hardcore, l’IA Coding.

Auparavant, nous disions toujours que les modèles nationaux avaient encore un écart avec GPT, Claude Opus et Gemini en termes de raisonnement logique et d’écriture de code.

Mais aujourd’hui, GLM-5 nous dit avec des performances concrètes : cet écart est en train d’être comblé.

GLM-5 n’est pas non plus un jouet qui ne peut servir qu’à faire des démos, c’est un outil de productivité qui peut vraiment vous aider à travailler, à construire des systèmes, à résoudre des tâches longues et des problèmes complexes.

**Le plus important, c’est qu’il est open source.**

Cela signifie que chaque développeur, chaque entreprise, peut avoir un architecte IA de premier plan à moindre coût.

De plus, le plan de codage de GLM est déjà en rupture de stock. Les responsables ont publié un avis indiquant qu’ils augmentaient d’urgence leur capacité, et l’accent est mis sur le fait que cette fois, ils se connectent à un cluster de dizaines de milliers de cartes de puces nationales.

Cependant, en raison de l’augmentation des investissements dans la puissance de calcul, le prix a quelque peu augmenté, heureusement que j’avais déjà le forfait Max.

On peut également voir ici que, des puces aux modèles, de la puissance de calcul sous-jacente aux applications de niveau supérieur, nous construisons une pile technologique d’IA de classe mondiale qui nous est entièrement propre.

2026 est vouée à être une année d’explosion des applications d’IA, et aussi une année plus folle.

Si vous voulez aussi ressentir ce sentiment d’avoir un architecte IA de premier plan, dépêchez-vous d’essayer GLM-5.La condition préalable est que vous devez obtenir le forfait Max, haha.