**सच में, 2026 का AI 25 से बहुत ज्यादा पागल है।**

आजकल मैं जो दिन में 16 घंटे AI में डूबा रहता हूँ, वो भी AI के विकास की गति से थोड़ा पीछे रह गया हूँ। ऐसा लगता है जैसे हर सुबह आँख खुलते ही दुनिया बदल जाती है।

कल देर रात,智谱 ने एक और बड़ा धमाका किया, सीधे तौर पर अपने वर्तमान **सबसे शक्तिशाली** फ्लैगशिप मॉडल: **GLM-5** को **ओपन सोर्स** कर दिया।

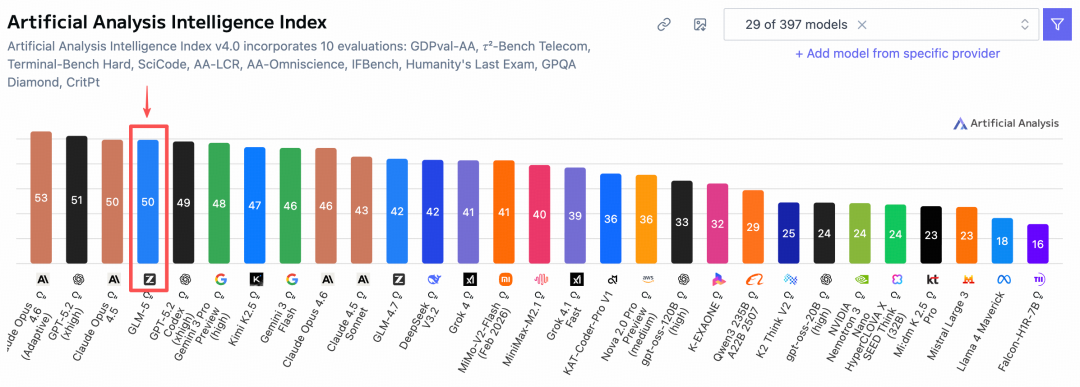

वैश्विक स्तर पर आधिकारिक आर्टिफिशियल एनालिसिस रैंकिंग में, **GLM-5 ने Gemini को पछाड़कर वैश्विक स्तर पर चौथा और ओपन सोर्स में पहला स्थान हासिल किया!**

जैसा कि मैंने अनुमान लगाया था, पिछली बार जब GLM-4.7 जारी किया गया था, तो मैंने लेख में भाइयों के साथ भविष्यवाणी की थी: मेरा अनुमान है कि GLM-4.8 या GLM-5 वसंत महोत्सव की पूर्व संध्या पर जारी किया जाएगा, मुझे उम्मीद नहीं थी कि यह सच हो जाएगा, हाहा 😄

और इस बार संस्करण संख्या अंततः पहले की तरह 4.5, 4.6, 4.7 जैसी छोटी-छोटी अपडेट नहीं है, इस बार सीधे 5.0 तक पहुंच गई है।

इसका मतलब है कि यह कोई छोटा-मोटा सुधार नहीं है, बल्कि आधार क्षमता में एक बड़ी छलांग है।

**सबसे पहले, मैं आपको बताता हूँ कि इस बार GLM-5 में क्या अपडेट किया गया है:**

सीधे शब्दों में कहें तो, पहले के मॉडल में, हर कोई आमतौर पर Vibe Coding में लगा हुआ था, जिसे एक वाक्य पीढ़ी कहा जाता है, यह देखने के लिए कि कौन अधिक शानदार वेब पेज प्रभाव उत्पन्न करता है, यह देखने के लिए कि कौन एक वाक्य में एक शानदार गेम बना सकता है।

लेकिन GLM-5 इस बार आपके साथ इसमें शामिल नहीं होगा (आखिरकार!), इसने बड़े मॉडल की क्षमता को कोड लिखने से बढ़ाकर सिस्टम बनाने में सक्षम कर दिया है।

इसका क्या मतलब है? इसका ध्यान अब सुंदर फ्रंट-एंड पेज लिखने पर नहीं है, बल्कि एक सिस्टम आर्किटेक्ट के रूप में विकसित हो गया है जो गंदे काम, थकाऊ काम और लंबे कार्य कर सकता है।

Agentic Engineering, यानी इंटेलिजेंट बॉडी इंजीनियरिंग क्षमता पर जोर दिया गया है।

मैंने आधिकारिक डेटा देखा, पैरामीटर का आकार **355B से बढ़कर 744B (40 सक्रिय)** हो गया, और प्री-ट्रेनिंग डेटा **23T से बढ़कर 28.5T** हो गया।

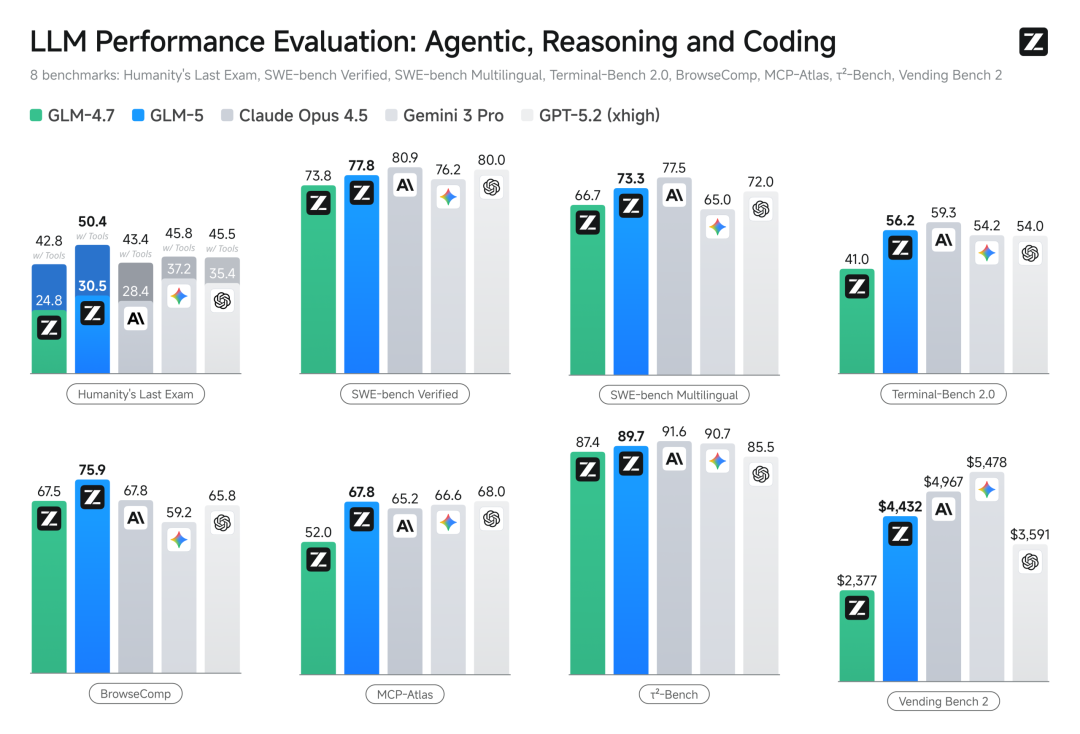

SWE-bench-Verified में, एक मान्यता प्राप्त प्रोग्रामिंग बेंचमार्क परीक्षण, स्कोर 77.8 है, जो सीधे Gemini 3 Pro को पीछे छोड़ देता है, **और वर्तमान में मान्यता प्राप्त सबसे मजबूत क्लोज्ड-सोर्स मॉडल Claude Opus 4.5 के लगभग बराबर कहा जा सकता है।**

**वर्तमान में इसे z.ai पर मुफ्त में इस्तेमाल किया जा सकता है:**

**ओपन सोर्स एड्रेस:**

GitHub:https://github.com/zai-org/GLM-5

Hugging Face:https://huggingface.co/zai-org/GLM-5

ModelScope:https://modelscope.cn/models/ZhipuAI/GLM-5

वास्तव में, कुछ दिन पहले, **X पर अचानक Pony नामक एक रहस्यमय मॉडल सामने आया।**

उस समय कई दोस्त अनुमान लगा रहे थे कि यह Pony किस रास्ते का देवता है? कई तरह की बातें थीं

वास्तव में, Pony कोडनेम वाला मॉडल GLM-5 है, जहाँ तक Pony नाम की बात है, शायद इसलिए कि घोड़े का वर्ष आने वाला है 🤔।

मैंने उस समय OpenRouter से Pony को Claude Code में एक्सेस किया और इसे आज़माया, सच कहूँ तो, यह वास्तव में बहुत मजबूत है (X पर भी बहुत लोकप्रिय है)।

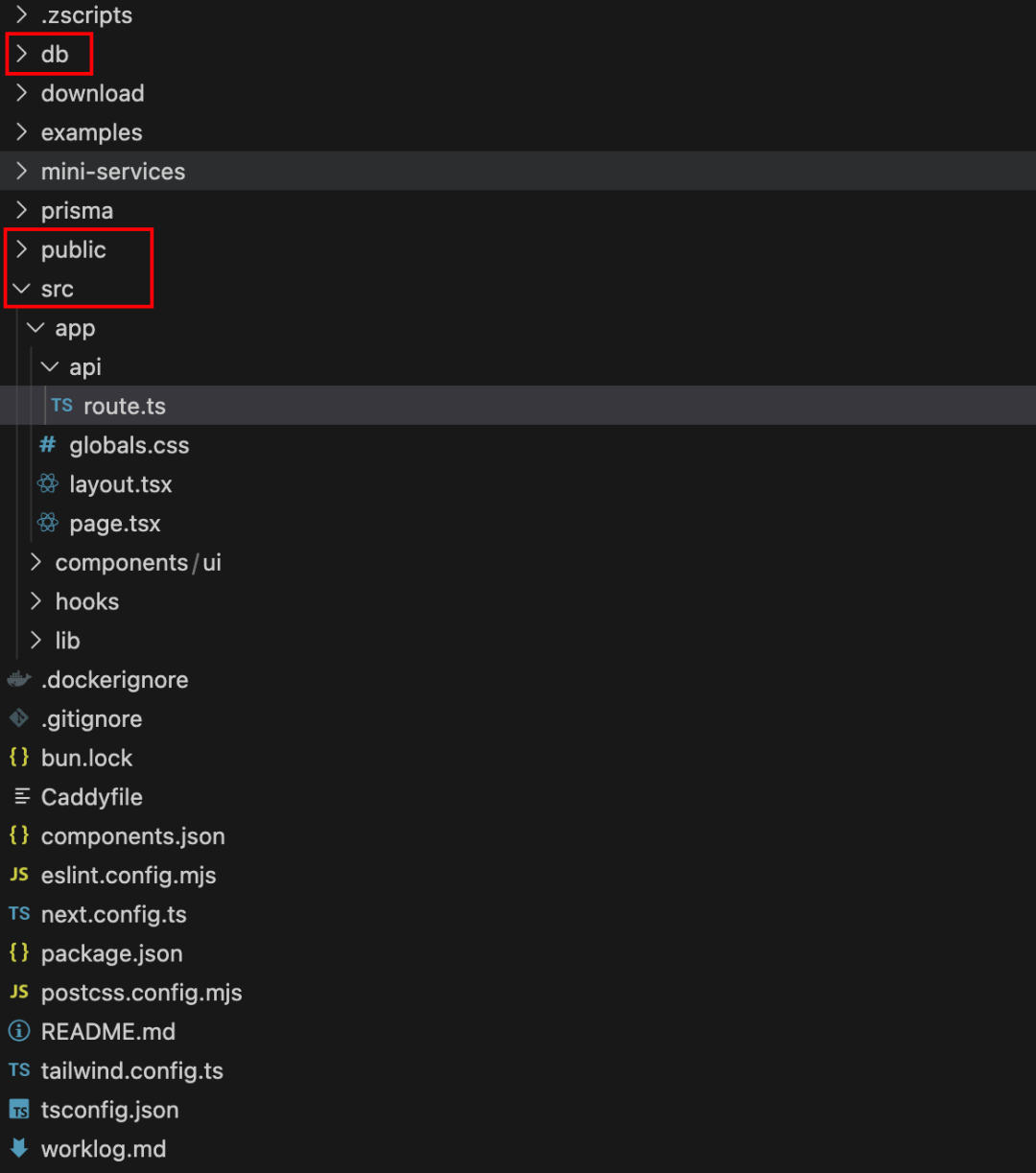

**केवल 7 मिनट में, इसने एक बार में एक API मध्यवर्ती स्टेशन उत्पन्न किया!**

हालांकि यह अभी भी MVP डेमो है, लेकिन पेज फ़ंक्शन बहुत पूर्ण हैं, और इसमें बैक-एंड लॉजिक और डेटाबेस शामिल है, डेटा गतिशील है, गौरैया छोटी है लेकिन सभी पांच आंतरिक अंग मौजूद हैं।

गहन अनुभव के बाद, मैंने पाया कि GLM-5 की योजना बनाते समय, वह स्वाद Claude Opus के समान है।

Claude Opus से परिचित दोस्त जानते हैं कि काम करने से पहले, आप इसका उपयोग एक बहुत विस्तृत और तार्किक रूप से ठोस योजना बनाने के लिए कर सकते हैं।

GLM-5 में अब यह क्षमता है।

उदाहरण के लिए, मेरे पास हमेशा कुछ ऐसा होता है जो मैं करना चाहता था, लेकिन आलस्य के कारण कभी नहीं किया।

मेरे पास Gemini, ChatGPT, Kimi,智谱 आदि जैसे ढेर सारे सदस्यता खाते हैं।

सामान्य तौर पर, लेख लिखते समय या जानकारी की जाँच करते समय, मैं अक्सर कई AI की राय सुनना चाहता हूँ और उनकी तुलना करना चाहता हूँ।{"title":"","content":"तो मुझे कई ब्राउज़र विंडो खोलनी होंगी, अलग-अलग विंडो से कॉपी करके कई बार पेस्ट करके भेजना होगा, और फिर बारी-बारी से विंडो बदलकर परिणाम देखना होगा।\n\nहालांकि यह कोई बड़ी बात नहीं है, लेकिन बार-बार करने से बहुत परेशानी होती है।\n\nमैं सोच रहा था, **क्या कोई ब्राउज़र प्लगइन बनाया जा सकता है जो एक ही विंडो में इन चारों AI के वेबपेज पर एक ही सवाल भेज सके, और फिर प्लगइन में ही सभी जवाब मिल जाएं?**\n\nलेकिन यह काम थोड़ा मुश्किल है, क्योंकि हर AI वेबसाइट की संरचना अलग-अलग होती है, और कई सुरक्षा तंत्र भी होते हैं, इसलिए उनके DOM संरचना का विश्लेषण करना होगा।\n\nइसलिए, मैंने इस जटिल कार्य को GLM-5 को सौंप दिया।\n\nClaude Code के Plan Mode को शुरू करके पहले उससे एक योजना बनवाएं\n\nफिर वह मुझसे बातचीत भी करेगा, मेरी राय पूछेगा:\n\nअंत में जो योजना मिली वह बहुत विस्तृत थी, वास्तव में बहुत लंबी थी, 633 पंक्तियाँ थीं।\n\nफिर योजना के अनुसार काम करना शुरू कर दिया, सोचा नहीं था कि पहला कदम प्रोजेक्ट को इनिशियलाइज़ करने में ही 50 मिनट से ज़्यादा लग जाएंगे...\n\nइस प्रक्रिया में, उसने स्वचालित रूप से Playwright MCP टूल को कॉल किया, खुद ब्राउज़र खोला, और उन AI वेबसाइटों पर गया।\n\nवह एक असली प्रोग्रामर की तरह, तत्वों की जाँच करने, यह विश्लेषण करने गया कि इनपुट बॉक्स कहाँ है, भेजने वाले बटन का क्लास क्या है, वापस आने वाले टेक्स्ट स्ट्रीम को कैसे प्राप्त करें... पूरी प्रक्रिया स्वचालित थी, मैंने एक भी लाइन कोड नहीं लिखा।\n\nPS: रिकॉर्डिंग करना भूल गया, क्योंकि मैं उसी समय दूसरे विंडो में एक और कार्य कर रहा था\n\nइंतज़ार करना सार्थक था, मेरी इच्छा के अनुसार एक बार सवाल पूछने पर, पूरे नेटवर्क के AI ने एक साथ जवाब दिया, ऐसा प्लगइन बनकर तैयार हो गया।\n\nयह बिल्कुल वही है जो मुझे चाहिए था~\n\nइसके अलावा, **मैंने पहले एक डिजिटल मानव मार्केटिंग वीडियो एक-क्लिक जनरेशन प्लेटफॉर्म बनाया था।**\n\nबाद में बेहतर अनुभव के लिए, मैंने फ्रंटएंड को फिर से बनाया, और इस पुनर्निर्माण के बाद, पूरा प्रोजेक्ट गड़बड़ हो गया: फ्रंटएंड और बैकएंड इंटरफेस मेल नहीं खा रहे थे, बैकएंड के कुछ पुराने लॉजिक नए फ्रंटएंड के सामने काम नहीं कर रहे थे, बहुत सारे बग थे, और इसे ठीक करना बहुत मुश्किल था।\n\nइस बार, मैंने Claude Code में plan mode शुरू किया, और सीधे मुख्य प्रक्रिया में बग ढूंढने और बग ठीक करने का काम GLM-5 को सौंप दिया\n\nपहले एक विस्तृत योजना सामने आई:\n\nयोजना की पुष्टि करने के बाद, मैंने उसे काम करना शुरू करने दिया (प्रक्रिया में ब्राउज़र को नियंत्रित करने के लिए ब्राउज़र mcp का उपयोग किया गया)।\n\nइसकी निष्पादन गति तेज़ नहीं है।\n\nलेकिन मॉडल धीमा नहीं है, कई बार, मैंने देखा कि टोकन की खपत की गति, आँखों से दिखाई देने वाली गति से एक सेकंड में हज़ारों तक पहुँच जाती है।\n\nलेकिन क्योंकि कार्य बहुत जटिल है, इसलिए इसे लगातार आत्म-चिंतन करने, उपकरणों को कॉल करने और परीक्षण चलाने की आवश्यकता होती है।\n\nकुछ समय निर्भरता डाउनलोड करने या कमांड निष्पादित करने में भी खर्च होता है।\n\nइस मरम्मत कार्य को पूरा करने में भी 40 मिनट से ज़्यादा लग गए।\n\nशायद कुछ दोस्त कहेंगे, 40 मिनट? मैंने तो यह सब लिख लिया होता।\n\nemmm, लेकिन इन 40 मिनटों में, मैंने रिकॉर्डिंग चालू रखी, वीडियो देखे, और यहाँ तक कि कुत्ते को भी घुमाने ले गया।\n\nऔर वह पूरी तरह से ध्यान केंद्रित करके मेरे लिए काम कर रहा था, और वह भी उस तरह का काम जो सबसे ज़्यादा सिरदर्द देने वाला होता है, जैसे बग ढूंढना और पुनर्निर्माण करना।\n\nयह मत देखिए कि यह धीरे-धीरे काम करता है, लेकिन अंत में जो प्रभाव मिलता है वह बहुत महत्वपूर्ण होता है।\n\nमैंने जैसे ही इसे चलाया, वाह, समस्याएँ लगभग पूरी तरह से ठीक हो गईं।\n\nकृपया VCR देखें:\n\nइसमें कुछ प्रभाव ऐसे भी हैं जो मैंने बाद में खुद परीक्षण करते समय छोटे बग पाए, और फिर उन्हें ठीक करने और अनुकूलित करने के लिए कहा।\n\nलेकिन बग ठीक करने और फ़ंक्शन को अनुकूलित करने के मामले में, मैं वास्तव में इसे सौंपने में निश्चिंत हूँ।\n\nपहले दूसरे AI से बग ठीक करवाते समय, अक्सर यह डर रहता था कि बग और बढ़ जाएंगे, प्रोजेक्ट और गड़बड़ हो जाएगा, एक दीवार को तोड़कर दूसरी दीवार को ठीक करने जैसा...\n\nपहले इस समस्या से बचने के लिए, AI को नियंत्रित करने के लिए विभिन्न इंजीनियरिंग तरीकों का उपयोग करना पड़ता था।\n\nउदाहरण के लिए, हर बार संशोधन की सीमा पर ज़ोर देना, या इसे नियमों में लिखना, या हर बार केवल एक बग को ठीक करना, और हर बार ठीक करने के बाद, दूसरे फ़ंक्शन का परीक्षण करना... वैसे यह बहुत मुश्किल था।\n\nलेकिन GLM-5 से बग ठीक करवाने का अनुभव पूरी तरह से बदल गया है।\n\nमुझे हमेशा केवल स्थिति का वर्णन करने, त्रुटि लॉग उसे देने और उसे यह बताने की ज़रूरत होती है कि मैं क्या प्रभाव चाहता हूँ।\n\nवह लगभग हर बार इसे सफलतापूर्वक ठीक कर देता है, और यह दूसरे फ़ंक्शन को बिल्कुल भी प्रभावित नहीं करता है।\n\nयहाँ तक कि, एक बार बातचीत में, मैंने पूरी प्रक्रिया में पाए गए चार अलग-अलग बग को एक साथ उसे दे दिया, और वह उन्हें भी स्पष्ट रूप से एक-एक करके ठीक कर सका।\n\nयह स्थिरता का एहसास वास्तव में बहुत सुखद है।\n\nअब मैं GLM-5 को कोई भी जटिल विकास कार्य सौंपने में निश्चिंत हूँ, इसमें मूल रूप से कोई गलती नहीं होगी।\n\nअगर कभी कोई समस्या होती भी है, तो Claude Code में रोलबैक कमांड चलाकर, वापस जाकर फिर से शुरू किया जा सकता है।\n\nGLM-5 से पूरे प्रोजेक्ट को अनुकूलित करने के बाद, सभी प्रक्रियाएँ मूल रूप से ठीक हो गईं।"}**मैं भी जल्द ही इस प्रोजेक्ट को ओपन सोर्स करने की तैयारी कर रहा हूँ (मुझे अभी भी विभिन्न मॉडल API वाले हिस्से को निकालकर कॉन्फ़िगरेशन में बदलना होगा)।**

**«अंतिम»**

GLM-5 का अनुभव करने के बाद, मेरी सबसे बड़ी भावना यह है कि: **स्वदेशी AI वास्तव में खड़ा हो गया है।**

कुछ दिन पहले, बाइटडांस का सीडेंस 2.0 जारी किया गया था, जिसने साबित कर दिया कि वीडियो निर्माण के क्षेत्र में चीनी स्वदेशी मॉडल पहले ही विश्व स्तर पर पहले स्थान पर पहुँच चुके हैं, सीधे सोरा2 और वीओ3.1 को पछाड़ते हुए।

और इस बार ZhiPu GLM-5 का जारी होना, एक अन्य हार्डकोर ट्रैक AI कोडिंग पर, अपेक्षा से अधिक उत्तर देता है।

हम पहले हमेशा कहते थे कि तर्क, तर्क और कोडिंग में स्वदेशी मॉडल में GPT, Claude Opus और Gemini से अभी भी अंतर है।

लेकिन आज, GLM-5 हमें ठोस प्रदर्शन के साथ बताता है: यह अंतर मिटाया जा रहा है।

GLM-5 केवल एक डेमो बनाने के लिए इस्तेमाल किया जाने वाला खिलौना नहीं है, यह एक उत्पादकता उपकरण है जो वास्तव में आपकी मदद कर सकता है, सिस्टम बनाने में आपकी मदद कर सकता है, और लंबी और जटिल समस्याओं को हल करने में आपकी मदद कर सकता है।

**सबसे महत्वपूर्ण बात यह है कि यह ओपन सोर्स है।**

इसका मतलब है कि प्रत्येक डेवलपर, प्रत्येक उद्यम, कम लागत पर एक शीर्ष AI आर्किटेक्ट रख सकता है।

और वर्तमान में GLM की कोडिंग योजना पहले ही बिक चुकी है, आधिकारिक तौर पर घोषणा की गई है कि वे तत्काल विस्तार कर रहे हैं, और मुख्य बात यह है कि इस बार स्वदेशी चिप्स के दस हजार कार्ड क्लस्टर तक पहुंच है।

हालांकि, कंप्यूटिंग शक्ति में वृद्धि के कारण, कीमतें कुछ बढ़ गई हैं, शुक्र है कि मैंने पहले मैक्स पैकेज प्राप्त कर लिया था।

यहां यह भी देखा जा सकता है कि चिप्स से लेकर मॉडल तक, अंतर्निहित कंप्यूटिंग शक्ति से लेकर ऊपरी परत के अनुप्रयोगों तक, हम पूरी तरह से अपनी खुद की, विश्व स्तरीय AI तकनीक स्टैक का निर्माण कर रहे हैं।

2026, AI अनुप्रयोगों के विस्फोट का एक वर्ष होने के लिए नियत है, और एक और पागल वर्ष भी।

यदि आप भी एक शीर्ष AI आर्किटेक्ट होने की इस भावना का अनुभव करना चाहते हैं, तो GLM-5 को आज़माएं।

शर्त यह है कि आपको मैक्स पैकेज हथियाना होगा, हा हा।

Health

Health Health

Health