A ZhiPu GLM-5 nyílt forráskódú kiadása még a tapasztalt programozókat is veszélyezteti...

Tényleg, a 2026-os AI sokkal őrültebb, mint a 2025-ös.

Mostanában, aki napi 16 órát tölt az AI-ban, alig tudja követni az AI evolúciójának sebességét. Úgy érzem, minden reggel, amikor felébredek, a világ megváltozott.

És most, tegnap késő este, a ZhiPu egy nagy dobással rukkolt elő, és közvetlenül nyílt forráskódúvá tette a jelenleg legerősebb zászlóshajó modelljét: a GLM-5-öt.

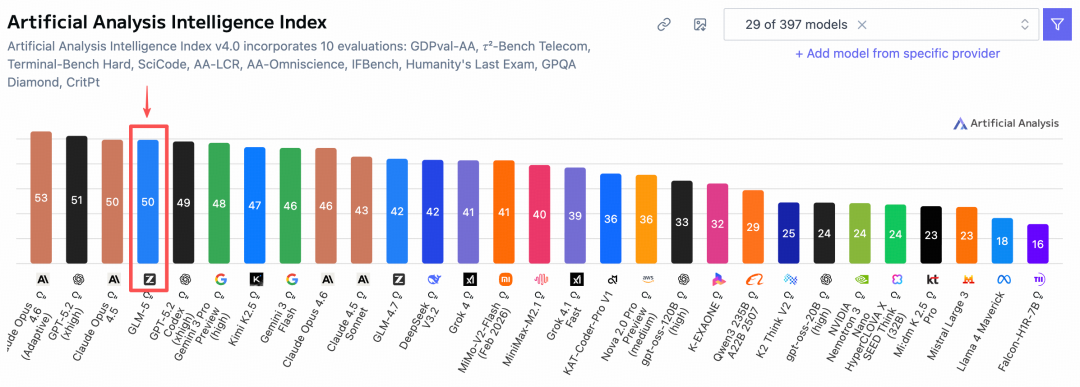

A globális tekintélyes Artificial Analysis rangsorban a GLM-5 megelőzte a Gemini-t, és a globális negyedik, a nyílt forráskódú első helyet szerezte meg!

Ahogy sejtettem, emlékszem, amikor legutóbb a GLM-4.7-et adták ki, a cikkemben megjósoltam a testvéreknek: vakon tippelek, hogy a GLM-4.8 vagy a GLM-5 a tavaszi fesztivál előtt jelenik meg, nem gondoltam, hogy tényleg megérkezik, haha 😄

És ezúttal a verziószám végre nem olyan, mint a korábbi 4.5, 4.6, 4.7, ami foghúzásszerű frissítés, ezúttal közvetlenül 5.0-ra ugrott.

Ez azt jelenti, hogy nem valami apró javítás, hanem az alapvető képességek nagy ugrása.

Először is bemutatom mindenkinek, hogy a GLM-5 pontosan mit frissített:

Egyszerűen fogalmazva, a korábbi modellek általában a Vibe Coding-ban versenyeztek, ami az úgynevezett egy mondatos generálás, hogy ki tud látványosabb weboldal-effektusokat generálni, ki tud egy mondattal menő játékot összerakni.

De a GLM-5 ezúttal nem ebben versenyez veled (végre!), a nagyméretű modell képességeit a kódírásról a rendszerépítésre emelte.

Mit jelent ez? A hangsúly már nem a szép frontend oldalak írásán van, hanem egy olyan rendszerarchitektúrává fejlődött, amely képes piszkos munkát, nehéz munkát végezni és hosszú feladatokat ellátni.

A hangsúly az Agentic Engineering-en, azaz az intelligens testmérnöki képességeken van.

Megnéztem a hivatalos adatokat, a paraméterek mérete 355B-ről 744B-re (aktiválás 40) nőtt, az előképzési adatok pedig 23T-ról 28.5T-ra.

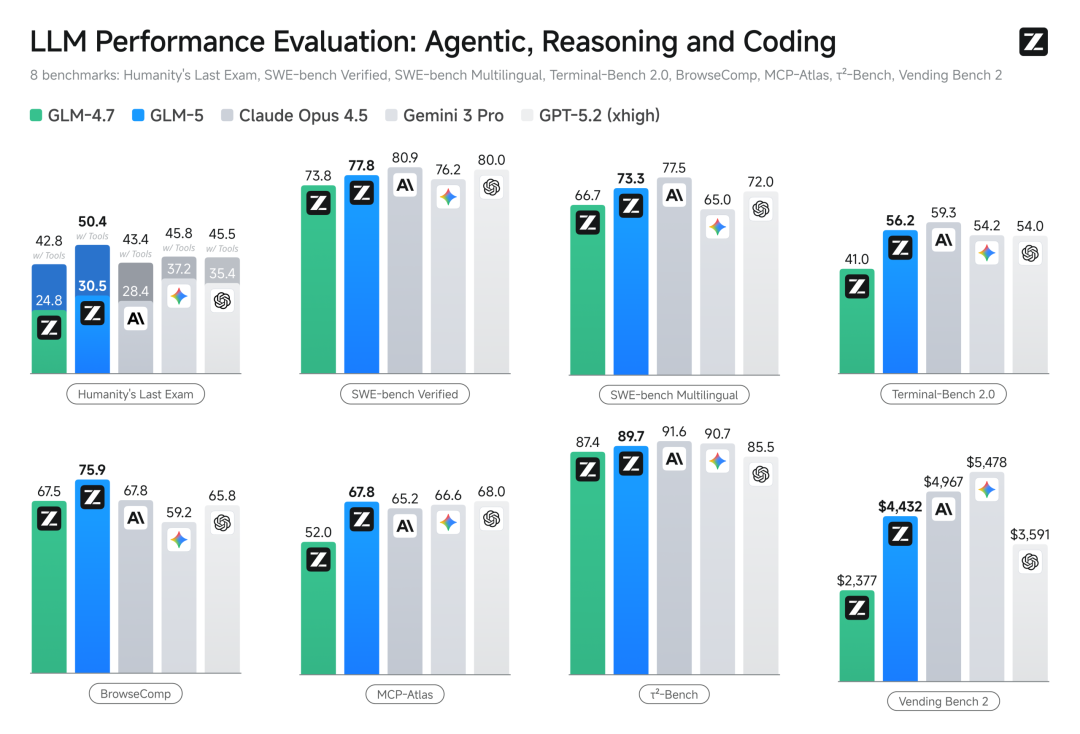

A SWE-bench-Verified elismert programozási benchmark tesztben 77.8 pontot ért el, közvetlenül maga mögé utasította a Gemini 3 Pro-t, és a jelenleg elismert legerősebb zárt forráskódú modellel, a Claude Opus 4.5-tel mondhatni egyenrangú.

Jelenleg a z.ai oldalon ingyenesen használható:

Nyílt forráskódú cím:

GitHub: https://github.com/zai-org/GLM-5

Hugging Face: https://huggingface.co/zai-org/GLM-5

ModelScope: https://modelscope.cn/models/ZhipuAI/GLM-5

Valójában néhány nappal ezelőtt hirtelen felbukkant az X-en egy Pony nevű titokzatos modell.

Sok barátom találgatta akkor, hogy ki ez a Pony? Sokféle vélemény volt.

Valójában a Pony kódnevű modell a GLM-5, amiért Pony-nak hívják, valószínűleg azért, mert közeledik a ló éve 🤔.

Én is azonnal csatlakoztattam a Pony-t az OpenRouter-ről a Claude Code-hoz, hogy kipróbáljam, őszintén szólva, nagyon erős (az X-en is nagyon népszerű).

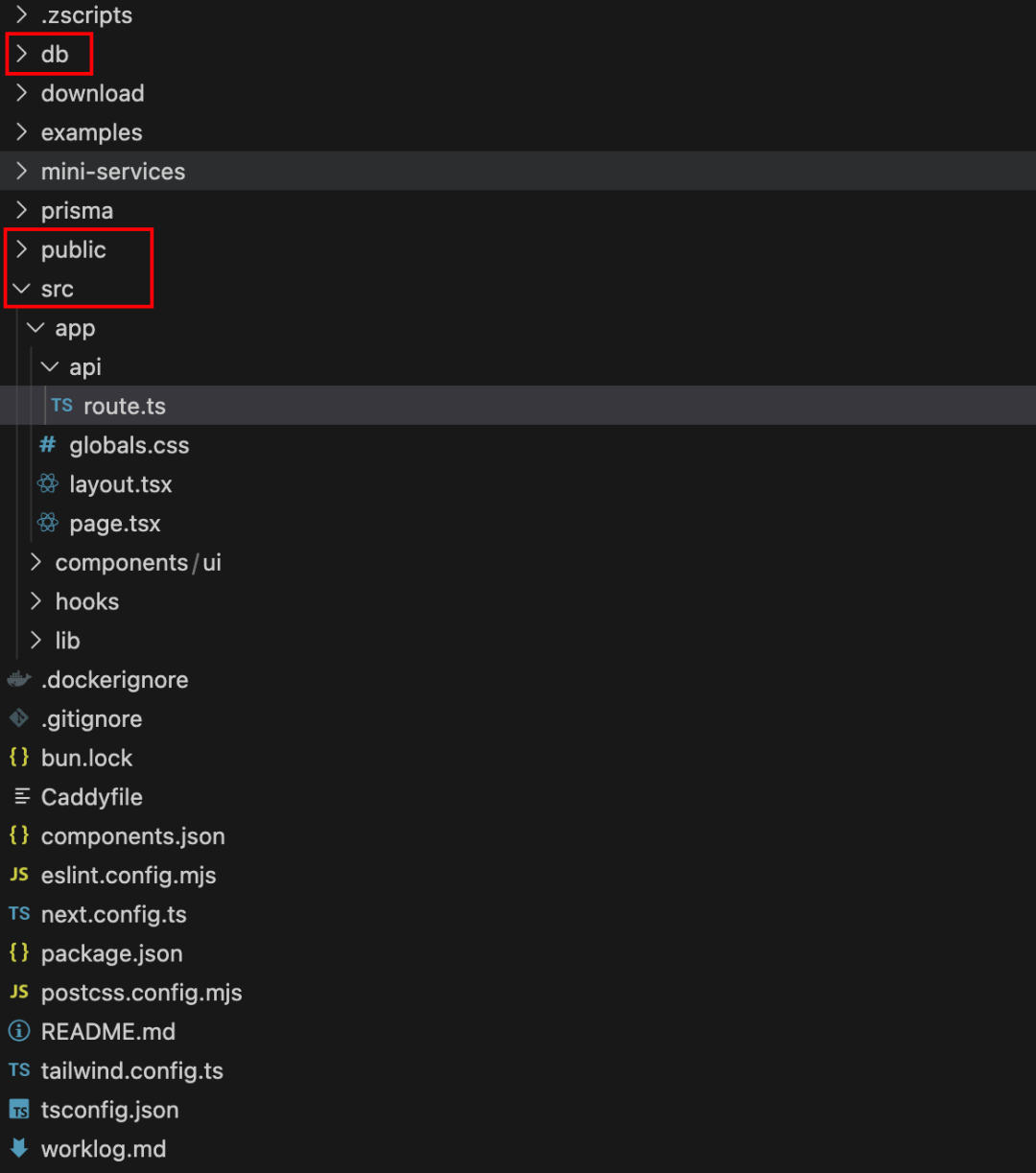

Mindössze 7 perc alatt egyszerre generált egy API központot!

Bár még csak MVP Demo, de az oldal funkciói már nagyon teljesek, és tartalmazza a backend logikát, valamint az adatbázist is, az adatok dinamikusak, kicsi, de minden benne van.

A mélyreható tapasztalatok után azt tapasztaltam, hogy a GLM-5 a tervek kidolgozásakor olyan ízű, mint a Claude Opus.

A mélyreható tapasztalatok után azt tapasztaltam, hogy a GLM-5 a tervek kidolgozásakor olyan ízű, mint a Claude Opus.

Aki ismeri a Claude Opus-t, az tudja, hogy a munka megkezdése előtt egy nagyon részletes, logikailag szigorú tervet készít.

A GLM-5-nek most már ez a képessége is megvan.

Például van egy dolog, amit mindig is meg akartam csinálni, de a lustaság miatt soha nem kezdtem bele.

Van egy csomó Gemini, ChatGPT, Kimi, ZhiPu stb. tagsági fiókom.

Amikor cikkeket írok vagy információkat keresek, gyakran szeretném meghallgatni több AI véleményét, és összehasonlítani őket.Bár ez nem egy nagy dolog, de sokszor nagyon idegesítő.

Arra gondoltam, lehetne-e készíteni egy böngészőbővítményt, amely egyetlen ablakban egyesítve, egyszerre küldi el ugyanazt a kérdést ennek a négy AI weboldalnak, majd a bővítményben egyesítve fogadja a válaszokat?

De ez a dolog elég bonyolult, mert minden AI weboldal szerkezete más, és különféle védelmi mechanizmusok is vannak, amelyekhez elemezni kell a DOM szerkezetüket.

Ezért ezt a bonyolult feladatot a GLM-5-re bíztam.

Először a Claude Code Plan Mode-ot bekapcsolva készíttettem vele egy tervet.

Majd interakcióba lép velem, és kikéri a véleményemet:

A végső terv nagyon részletes, tényleg túl hosszú, 633 soros..

Majd a terv szerint elkezdte a munkát, nem gondoltam volna, hogy az első lépés, a projekt inicializálása több mint 50 percig tart..

Ebben a folyamatban automatikusan meghívta a Playwright MCP eszközt, saját maga megnyitotta a böngészőt, és meglátogatta azokat az AI weboldalakat.

Úgy viselkedik, mint egy igazi programozó, ellenőrzi az elemeket, elemzi, hogy hol van a beviteli mező, mi a küldés gomb Class-a, hogyan lehet lekérni a visszaadott szövegfolyamot... az egész folyamat teljesen automatikus, egyetlen sort sem írtam.

PS: Elfelejtettem képernyőfelvételt készíteni, mert egy másik ablakban egy másik feladatot futtattam egyszerre

A várakozás megérte, a bővítmény, amellyel egyszerre kérdezhetek és az összes AI egyszerre válaszol, így, forrón került elő.

A várakozás megérte, a bővítmény, amellyel egyszerre kérdezhetek és az összes AI egyszerre válaszol, így, forrón került elő.

Ez teljesen az, amire szükségem van~

Ezenkívül, nem készítettem korábban egy digitális ember marketing videó egygombos generáló platformot?

Később a jobb élmény érdekében átalakítottam a frontendet, ez az átalakítás nem volt jó, az egész projekt egy nagy káosz lett: a frontend és a backend interfészek nem egyeztek, a backend néhány régi logikája nem működött az új frontend előtt, nagyon sok hiba volt, nagyon nehéz volt megcsinálni.

Ezúttal a Claude Code-ban bekapcsoltam a plan mode-ot, majd közvetlenül a GLM-5-re bíztam a fő folyamat hibakeresési és javítási feladatait.

Először egy részletes tervet készített:

A terv megerősítése után hagytam, hogy elkezdje a munkát (a folyamat során a böngésző mcp-jét használta az irányításhoz).

Nem túl gyorsan hajtja végre.

De nem a modell lassú, sokszor látom, hogy a Token fogyasztási sebessége szemmel láthatóan másodpercenként több ezerre ugrik.

De mivel a feladat túl bonyolult, folyamatosan önreflexióra, eszközök meghívására, tesztek futtatására van szüksége.

Van, amikor az idő a függőségek letöltésére vagy a parancsok végrehajtására megy el.

Ez a javítási feladat is több mint 40 percig tartott.

Lehet, hogy néhányan azt mondják, 40 perc? Én már megírtam volna.

Emm, de ebben a 40 percben bekapcsoltam a képernyőfelvételt, videókat néztem, sőt, még a kutyát is megsétáltattam.

Ő pedig teljes figyelmével segített nekem, ráadásul a legfájdalmasabb hibakeresési és átalakítási munkát végezte.

Ne nézzétek, hogy lassan hajtja végre, de a végső hatás nagyon jelentős.

Amikor futtatom, jó, a problémák alapvetően megoldódtak.

Kérjük, nézzék meg a VCR-t:

Néhány hatás az, amit később, a saját tesztelésem során találtam kisebb hibáknak, majd javíttattam és optimalizáltattam vele.

De a hibajavítás és a funkcióoptimalizálás terén igazán nyugodt vagyok, ha rábízom.

Korábban, amikor más AI-val javítottam a hibákat, mindig attól tartottam, hogy egyre több hiba lesz, és a projekt egyre kaotikusabb lesz, tipikusan a keleti falat bontottam le, hogy a nyugatit foltozzam..

Korábban, hogy elkerüljem ezt a problémát, különféle mérnöki módszerekkel kellett korlátoznom az AI-t.

Például minden módosításkor hangsúlyoztam a hatókört, vagy ezeket a szabályokba írtam, vagy egyszerre csak egy hibát javítottam, és minden javítás után tesztelnem kellett a többi funkciót... szóval nagyon bonyolult volt.

De a GLM-5-tel való hibajavítás teljesen megváltozott.

Soha nem kellett mást tennem, mint leírni a helyzetet, elküldeni neki a hibanaplókat, és elmondani, hogy milyen hatást várok.

Szinte mindig sikerült egyszerre kijavítania, és egyáltalán nem befolyásolta a többi funkciót.

Sőt, egy beszélgetésben közvetlenül az egész folyamatban talált négy különböző hibát dobtam rá, és ő is világosan, egyesével kijavította őket.

Ez a stabil érzés igazán kényelmes.

Most már nyugodtan rábízhatom a GLM-5-re bármilyen bonyolult fejlesztési feladatot, alapvetően nem hibázik.

Még ha néha van is probléma, legfeljebb a Claude Code-ban végrehajtok egy visszaállítási parancsot, és visszamegyek, hogy újra kezdjem.

Miután a GLM-5-tel optimalizáltam az egész projektet, az összes folyamat alapvetően megoldódott. Én is hamarosan tervezem ezt a projektet nyílt forráskódúvá tenni (még ki kell vonnom a különböző modell API-kat, és konfigurációvá kell alakítanom).

„Végül”

A GLM-5 kipróbálása után a legnagyobb érzésem az, hogy: A kínai AI tényleg felállt.

Néhány napja a ByteDance Seedance 2.0 kiadása bebizonyította, hogy a kínai modellek a videógenerálás területén elérték a világelső szintet, közvetlenül felülmúlva a Sora2-t és a Veo3.1-et.

És a Zhipu GLM-5 mostani kiadása egy másik kemény AI Coding versenyen adott egy várakozáson felüli választ.

Korábban mindig azt mondtuk, hogy a kínai modellek logikai következtetésben, kódírásban még le vannak maradva a GPT-hez, a Claude Opushoz és a Geminihez képest.

De ma a GLM-5 valós teljesítményével megmutatja nekünk: ez a különbség eltűnőben van.

A GLM-5 nem csak egy játék, amivel demót lehet csinálni, hanem egy valódi termelékenységi eszköz, ami segít a munkában, rendszerek építésében, hosszú távú feladatok és komplex problémák megoldásában.

A legfontosabb, hogy nyílt forráskódú.

Ez azt jelenti, hogy minden fejlesztő, minden vállalat alacsonyabb költséggel juthat hozzá egy csúcsminőségű AI-architektúrához.

És jelenleg a GLM Coding Plan már elképesztően jól fogy, a hivatalos közlemény szerint sürgősen bővítik a kapacitást, és ami a lényeg, hogy ezúttal kínai chipek ezres klasztereit kapcsolják be.

Viszont a számítási kapacitás növelése miatt az árak emelkedtek, szerencsére korábban szereztem Max csomagot.

Ebből is látszik, hogy a chipektől a modellekig, az alsóbb rétegű számítási kapacitástól a felső rétegű alkalmazásokig egy teljesen saját, világszínvonalú AI technológiai halmazt építünk.

2026 biztosan az AI alkalmazások robbanásszerű éve lesz, és egyben egy még őrültebb év.

Ha te is szeretnéd megtapasztalni, milyen egy csúcsminőségű AI-architektúra, próbáld ki a GLM-5-öt.Feltéve, hogy sikerül lecsapnod a Max csomagra, haha.