智谱GLM-5这次开源,让高级程序员也危险了...

本当に、2026年のAIは25年よりずっとクレイジーだ。

最近、私は1日に16時間もAIに浸っている人間だが、AIの進化のスピードに追いつけない。毎日目を開けると、世界が変わっているように感じる。

なんと、昨夜遅く、智譜がまたしても大きな一手、彼らの現在最強のフラッグシップモデル:GLM-5を直接オープンソース化したのだ。

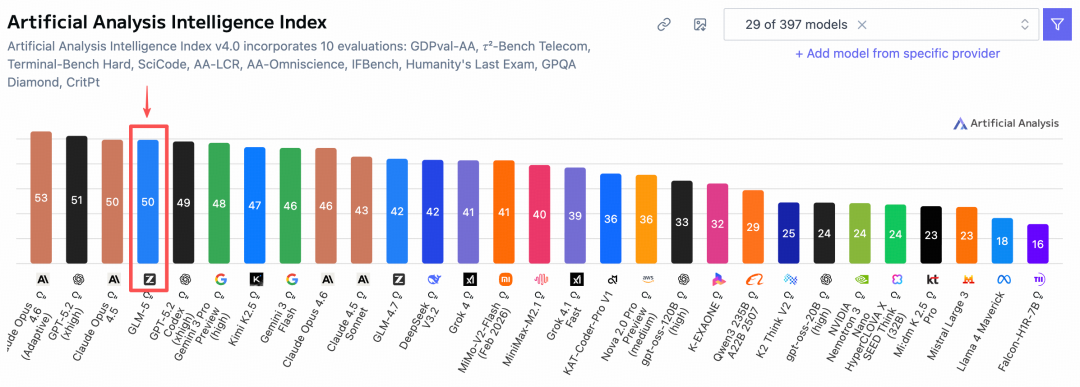

グローバルな権威あるArtificial Analysisランキングで、GLM-5はGeminiを超えて世界第4位、オープンソース第1位を獲得!

やはり私の予想通りだ。前回GLM-4.7が発表されたとき、私は記事で兄弟たちに予測した。「GLM-4.8またはGLM-5は春節前に発表されるだろう」と。まさか本当に来るとは、ハハ😄

しかも今回のバージョン番号は、以前のように4.5、4.6、4.7と歯磨き粉を絞り出すような更新ではなく、今回は直接5.0になった。

これは、小さな修正ではなく、基盤能力の大幅な飛躍であることを意味する。

まず、今回のGLM-5の更新内容を紹介しよう:

簡単に言うと、これまでのモデルは、皆がVibe Coding、いわゆる一言生成に夢中になっていた。誰がよりクールなウェブエフェクトを生成できるか、誰が一言でクールなゲームを作れるか、という競争だ。

しかし、GLM-5は今回はそれには参加しない(ついに!)。大規模モデルの能力をコードを書くことから、システムを構築できるレベルに引き上げたのだ。

どういう意味か?その重心は、美しいフロントエンドページを書くことではなく、汚れ仕事、きつい仕事、長期的なタスクを実行できるシステムアーキテクトに進化したのだ。

強調されているのは、Agentic Engineering、つまりインテリジェントエージェントのエンジニアリング能力だ。

公式データを見たところ、パラメータ規模は355Bから744B(アクティベーション40)に、事前学習データは23Tから28.5Tに増加している。

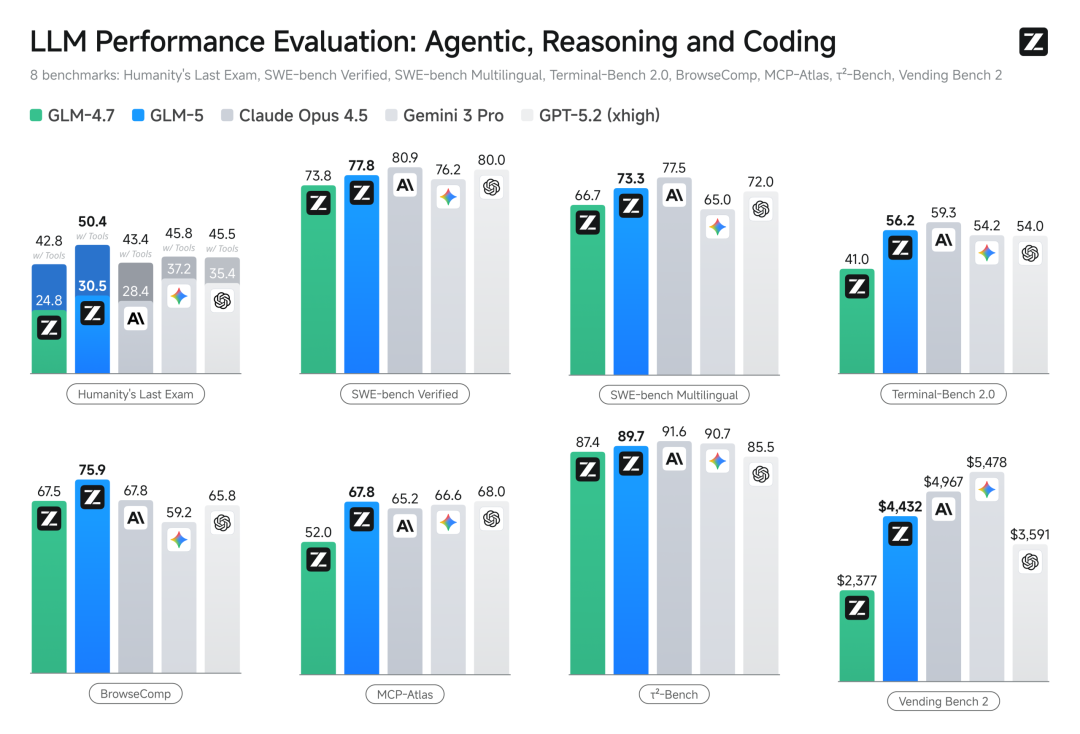

SWE-bench-Verifiedという公認のプログラミングベンチマークテストでは、77.8点を獲得し、Gemini 3 Proを大きく引き離し、現在公認の最強クローズドソースモデルClaude Opus 4.5とほぼ同等と言える。

現在、z.aiで無料で使用できる:

オープンソースアドレス:

GitHub:https://github.com/zai-org/GLM-5

Hugging Face:https://huggingface.co/zai-org/GLM-5

ModelScope:https://modelscope.cn/models/ZhipuAI/GLM-5

実は数日前、XにPonyという謎のモデルが突然現れた。

当時、多くの友人が、このPonyは何者なのか?と憶測していた。

実はコードネームPonyのモデルはGLM-5だ。なぜPonyと呼ぶのかというと、おそらく午年が近いからだろう🤔。

私も当時、OpenRouterからPonyをClaude Codeに接続してすぐに試してみたが、正直言って、本当に強かった(Xでも非常に話題になった)。

わずか7分で、API中継ステーションを一度に生成した!

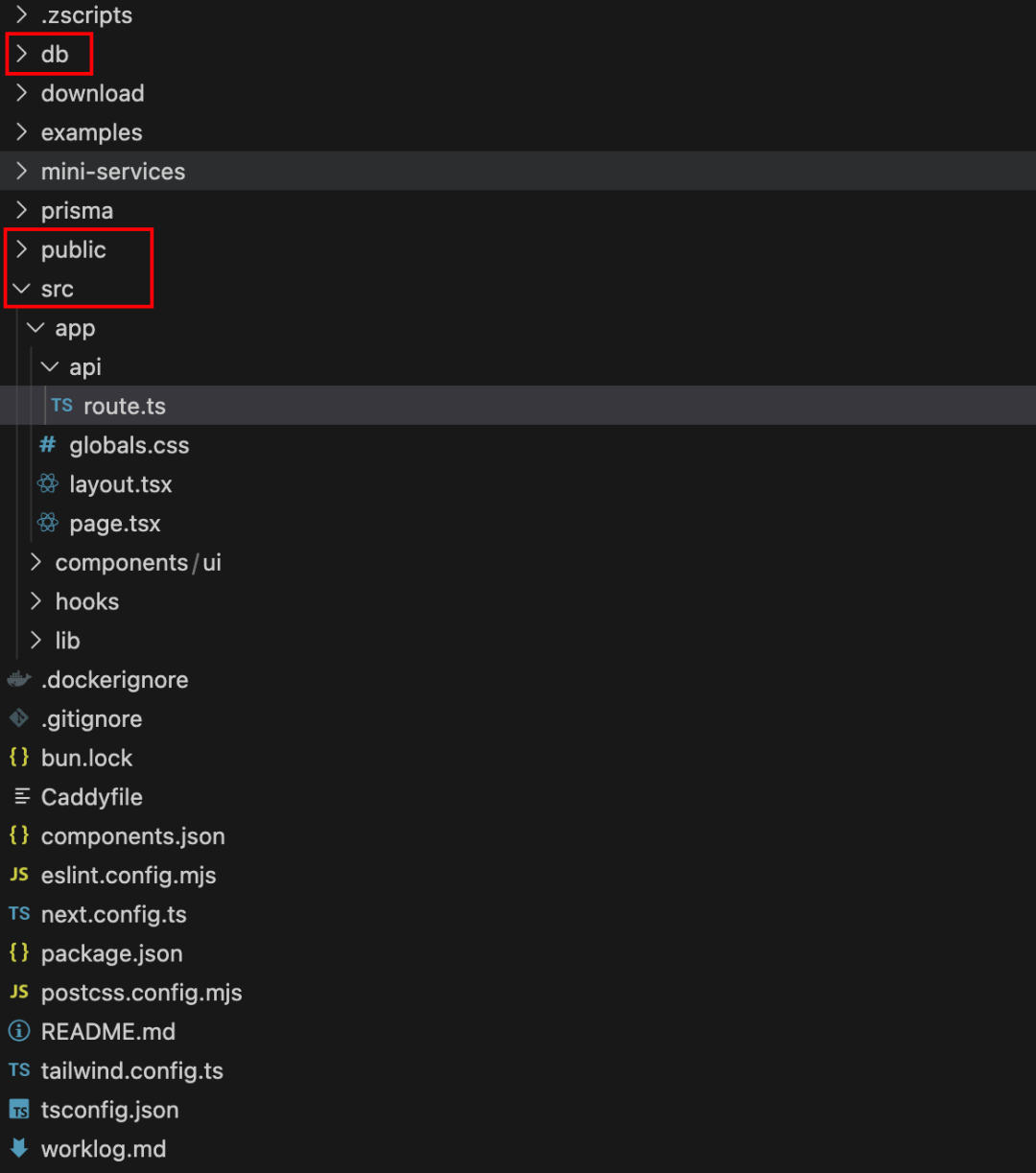

まだMVP Demoだが、ページ機能はすでに充実しており、バックエンドロジックとデータベースが含まれており、データは動的で、小さくても必要なものはすべて揃っている。

深く体験した後、GLM-5が計画を立てる際、その雰囲気がClaude Opusにそっくりだと気づいた。

深く体験した後、GLM-5が計画を立てる際、その雰囲気がClaude Opusにそっくりだと気づいた。

Claude Opusに詳しい友人なら知っていると思うが、作業に取り掛かる前に、非常に詳細で論理的な計画を立ててくれる。

GLM-5も今、その能力を持っている。

例えば、私はずっとやりたいと思っていたが、面倒でなかなか手をつけられなかったことがある。

Gemini、ChatGPT、Kimi、智譜など、たくさんの会員アカウントを持っている。

普段、記事を書いたり、資料を調べたりするとき、いくつかの問題について複数のAIの意見を聞いて、総合的に比較したいと思うことがよくある。 複数のブラウザウィンドウを開き、異なるウィンドウをコピーして切り替え、何度も貼り付けて送信し、順番にウィンドウを切り替えて結果を確認する必要がありました。

大したことではありませんが、何度も繰り返すと本当に面倒です。

そこで、ブラウザプラグインを作成して、1つのウィンドウで、4つのAIのWebページに同じ質問を同時に送信し、プラグイン内でまとめて返信を受け取ることができないかと考えました。

しかし、これはかなり面倒です。なぜなら、各AIサイトの構造が異なり、さまざまな保護メカニズムがあり、それらのDOM構造を分析する必要があるからです。

そこで、この複雑なタスクをGLM-5に任せることにしました。

まず、Claude CodeのPlan Modeを有効にして、計画を立てさせます。

そして、それは私と対話し、私の意見を求めます。

最終的に得られた計画は非常に詳細で、本当に長いです。633行もあります。

そして、計画に従って実行を開始しましたが、最初のステップであるプロジェクトの初期化に50分以上かかりました。

この過程で、Playwright MCPツールを自動的に呼び出し、自分でブラウザを開き、いくつかのAIサイトにアクセスしました。

まるで本物のプログラマーのように、要素をチェックし、入力ボックスがどこにあるか、送信ボタンのClassは何か、返されるテキストストリームをどのように取得するかを分析します...プロセス全体が完全に自動化されており、私は1行もコードを書いていません。

PS:録画を忘れていました。なぜなら、私は同時に別のウィンドウで別のタスクを実行していたからです。

待つ価値がありました。私が望んでいた、一度の質問で、すべてのAIが同時に回答するプラグインが、このように熱気を帯びて完成しました。

待つ価値がありました。私が望んでいた、一度の質問で、すべてのAIが同時に回答するプラグインが、このように熱気を帯びて完成しました。

これはまさに私が求めていたものです~

また、以前にデジタルヒューマンマーケティングビデオのワンキー生成プラットフォームを作成しました。

その後、より良い体験を追求するために、フロントエンドを再構築しましたが、この再構築は大変なことになり、プロジェクト全体が混乱してしまいました。フロントエンドとバックエンドのインターフェースが一致せず、バックエンドの古いロジックが新しいフロントエンドでは動作せず、バグが非常に多く、対処するのが非常に面倒でした。

今回、Claude Codeでplan modeを有効にし、メインフローのバグを見つけて修正するタスクをGLM-5に直接投げました。

まず、詳細な計画を作成します。

計画に誤りがないことを確認した後、実行を開始させました(プロセスではブラウザmcpを使用して制御しました)。

実行速度は速くありません。

しかし、モデルが遅いのではなく、多くの場合、Tokenの消費速度を見ると、目に見えて1秒で数千に跳ね上がります。

しかし、タスクが複雑すぎるため、自己反省、ツールの呼び出し、テストの実行を継続的に行う必要があります。

依存関係のダウンロードやコマンドの実行にも時間がかかります。

この修正タスクにも、40分以上かかりました。

40分?もう書き終わったよ、と言う人もいるかもしれません。

emmm、しかし、この40分間、私は録画をオンにして、ビデオを視聴したり、犬の散歩に行ったりしていました。

そして、それは私を手伝うことに全神経を集中しており、最も頭を悩ませるバグの発見と再構築の作業を行っています。

実行速度は遅いですが、最終的に得られる効果は非常に顕著です。

実行してみると、なんと、問題はほぼすべて解決されています。

VCRをご覧ください。

ここには、私が後で自分でテストしたときに発見した小さなバグを修正および最適化させた効果も含まれています。

しかし、バグの修正と機能の最適化に関しては、本当に安心して任せられます。

以前に他のAIでバグを修正すると、バグが増え続け、プロジェクトが混乱し、典型的な東の壁を壊して西の壁を補うような状況になることを心配していました。

以前は、この問題を回避するために、さまざまなエンジニアリング手法を使用してAIを制約する必要がありました。

たとえば、変更範囲を強調したり、それらをルールに書き込んだり、毎回1つのバグのみを修正したり、修正するたびに他の機能をテストしたりする必要がありました...とにかく面倒でした。

しかし、GLM-5を使用してバグを修正すると、体験が完全に変わりました。

私は常に現状を説明し、エラーログを渡して、期待する効果を伝えるだけで済みます。

ほぼ毎回修正に成功し、他の機能にまったく影響を与えません。

さらに、1回の対話で、プロセス全体で見つかった4つの異なるバグをすべてまとめて投げても、整理して1つずつ修正できます。

この安定感は、本当に快適です。

現在、GLM-5に複雑な開発タスクを安心して任せることができ、基本的にエラーは発生しません。

万が一問題が発生した場合でも、Claude Codeでロールバックコマンドを実行して、元に戻してやり直せば大丈夫です。

プロジェクト全体をGLM-5で最適化した後、すべてのプロセスは基本的に完了しました。私も近いうちにこのプロジェクトをオープンソース化する予定です(各種モデルAPIの部分を抽出して、設定にする必要があります)。

「最後に」

GLM-5を体験して、私が一番感じたのは、国産AIが本当に立ち上がったということです。

先日、ByteDanceのSeedance 2.0が発表され、中国国産モデルが動画生成分野で世界一のレベルに達し、Sora2やVeo3.1を直接超えていることが証明されました。

そして今回の智譜GLM-5の発表は、別のハードコアな分野であるAIコーディングにおいて、予想をはるかに超える成果を上げたと言えるでしょう。

私たちは以前から、国産モデルは論理的推論やコーディングにおいて、GPT、Claude Opus、Geminiにまだ差があると言っていました。

しかし今日、GLM-5は実際のパフォーマンスで、その差が縮まっていることを私たちに示してくれました。

GLM-5は、単なるデモ用の玩具ではありません。それは、実際にあなたの仕事を手伝い、システムを構築し、長時間のタスクや複雑な問題を解決できる生産性ツールです。

最も重要なのは、それがオープンソースであるということです。

これは、すべての開発者、すべての企業が、より低いコストで、トップレベルのAIアーキテクトを持つことができることを意味します。

そして現在、GLMのCoding Planは爆発的に売れており、公式発表によると、緊急に容量を拡張しており、さらに重要なのは、今回接続されているのが国産チップの万枚規模のクラスターであるということです。

ただし、計算能力への投資が増加したため、価格が若干上昇しましたが、幸い私は以前にMaxプランを入手しました。

ここからもわかるように、チップからモデル、基盤となる計算能力から上位のアプリケーションまで、私たちは完全に独自の、世界トップレベルのAI技術スタックを構築しています。

2026年は、AIアプリケーションが爆発的に普及する年であり、さらにクレイジーな年になるでしょう。

もしあなたが、トップレベルのAIアーキテクトを持つ感覚を体験したいなら、ぜひGLM-5を試してみてください。 前提はMaxプランをゲットする必要があること、ハハ。