智谱GLM-5 이번 오픈 소스 공개로 고급 프로그래머도 위험해졌다...

정말로, 2026년의 AI는 25년보다 훨씬 더 미쳐 날뛸 겁니다.

최근 하루 16시간을 AI에 몰두하는 저조차도 AI 진화 속도를 따라잡기 벅찹니다. 매일 눈을 뜨면 세상이 변해 있는 느낌입니다.

어제 심야에 즈푸(智谱)에서 또 한 번 큰일을 냈습니다. 현재 가장 강력한 플래그십 모델인 GLM-5를 직접 오픈 소스로 공개한 것입니다.

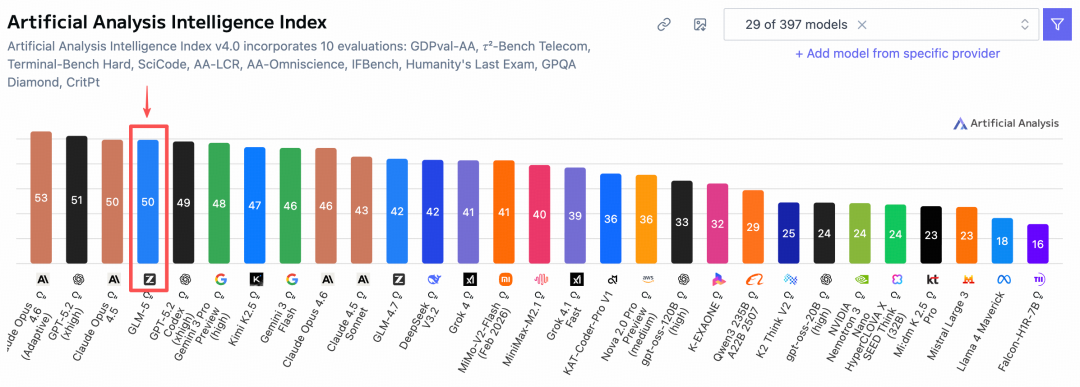

글로벌 권위의 Artificial Analysis 순위에서 GLM-5는 Gemini를 제치고 글로벌 4위, 오픈 소스 1위를 차지했습니다!

역시 제 예상대로군요. 지난번 GLM-4.7 발표 때, 저는 글에서 형제들에게 GLM-4.8 또는 GLM-5가 설날 전에 발표될 것이라고 예측했는데, 정말로 나왔네요. 하하😄

게다가 이번 버전은 이전처럼 4.5, 4.6, 4.7처럼 조금씩 업데이트하는 방식이 아니라, 바로 5.0으로 올라갔습니다.

이는 작은 수정이 아니라, 기반 능력의 큰 도약을 의미합니다.

이번 GLM-5가 도대체 무엇을 업데이트했는지 간단히 소개해 드리겠습니다:

간단히 말해서, 이전 모델들은 대부분 Vibe Coding, 즉 한 문장 생성에 집중했습니다. 누가 더 멋진 웹 효과를 생성하는지, 누가 한 문장으로 멋진 게임을 만들 수 있는지 경쟁했습니다.

하지만 GLM-5는 이번에 그런 경쟁을 하지 않습니다(드디어!). 대규모 모델의 능력을 코드 작성에서 시스템 구축으로 끌어올렸습니다.

무슨 뜻일까요? 더 이상 멋진 프론트엔드 페이지를 작성하는 데 집중하는 것이 아니라, 궂은 일, 힘든 일, 장기적인 작업을 수행할 수 있는 시스템 아키텍처로 진화했습니다.

Agentic Engineering, 즉 지능형 에이전트 엔지니어링 능력을 강조합니다.

공식 데이터를 살펴보니, 파라미터 규모가 **355B에서 744B(활성화 40)**로 증가했고, 사전 훈련 데이터는 23T에서 28.5T로 증가했습니다.

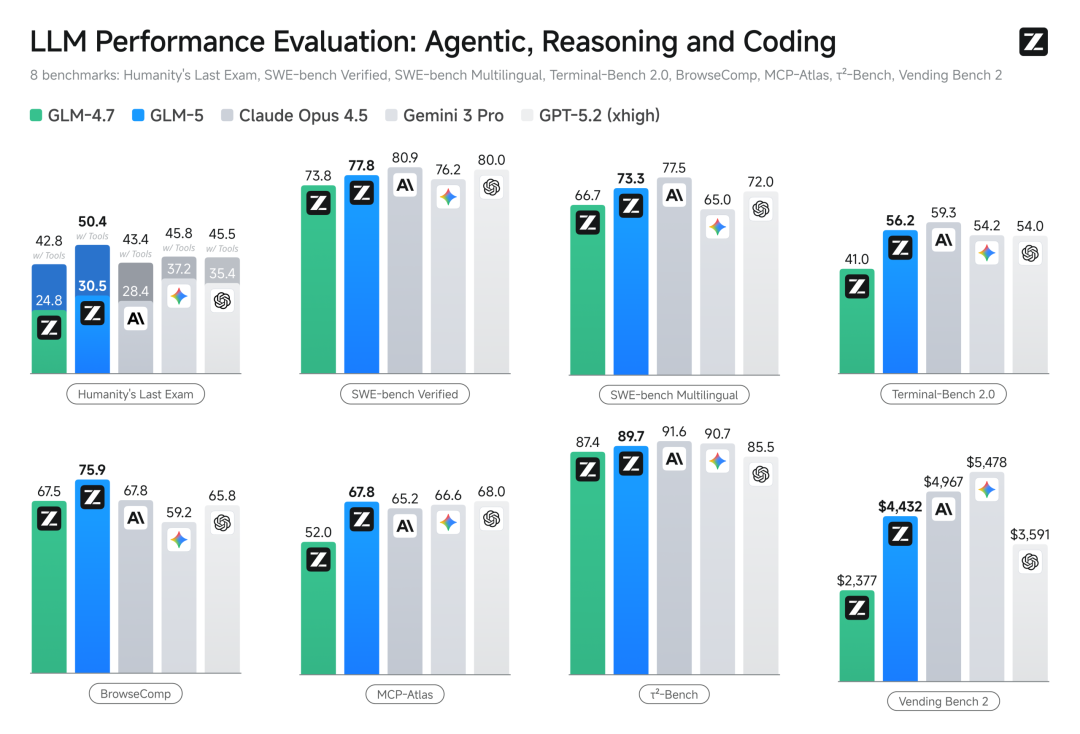

SWE-bench-Verified라는 공인된 프로그래밍 벤치마크 테스트에서 77.8점을 받아 Gemini 3 Pro를 제치고, 현재 공인된 가장 강력한 폐쇄형 모델인 Claude Opus 4.5와 거의 동등한 수준입니다.

현재 z.ai에서 무료로 사용할 수 있습니다:

오픈 소스 주소:

GitHub:https://github.com/zai-org/GLM-5

Hugging Face:https://huggingface.co/zai-org/GLM-5

ModelScope:https://modelscope.cn/models/ZhipuAI/GLM-5

사실 며칠 전, X에 Pony라는 정체불명의 모델이 갑자기 등장했습니다.

당시 많은 친구들이 이 Pony가 도대체 누구냐고 추측했습니다. 의견이 분분했습니다.

사실 코드명 Pony 모델은 GLM-5입니다. 왜 Pony라고 부르는지는 아마도 말띠 해가 다가오기 때문일 겁니다🤔.

저는 당시 OpenRouter에서 Pony를 Claude Code에 연결하여 사용해 봤는데, 솔직히 정말 강력했습니다(X에서도 인기가 매우 높았습니다).

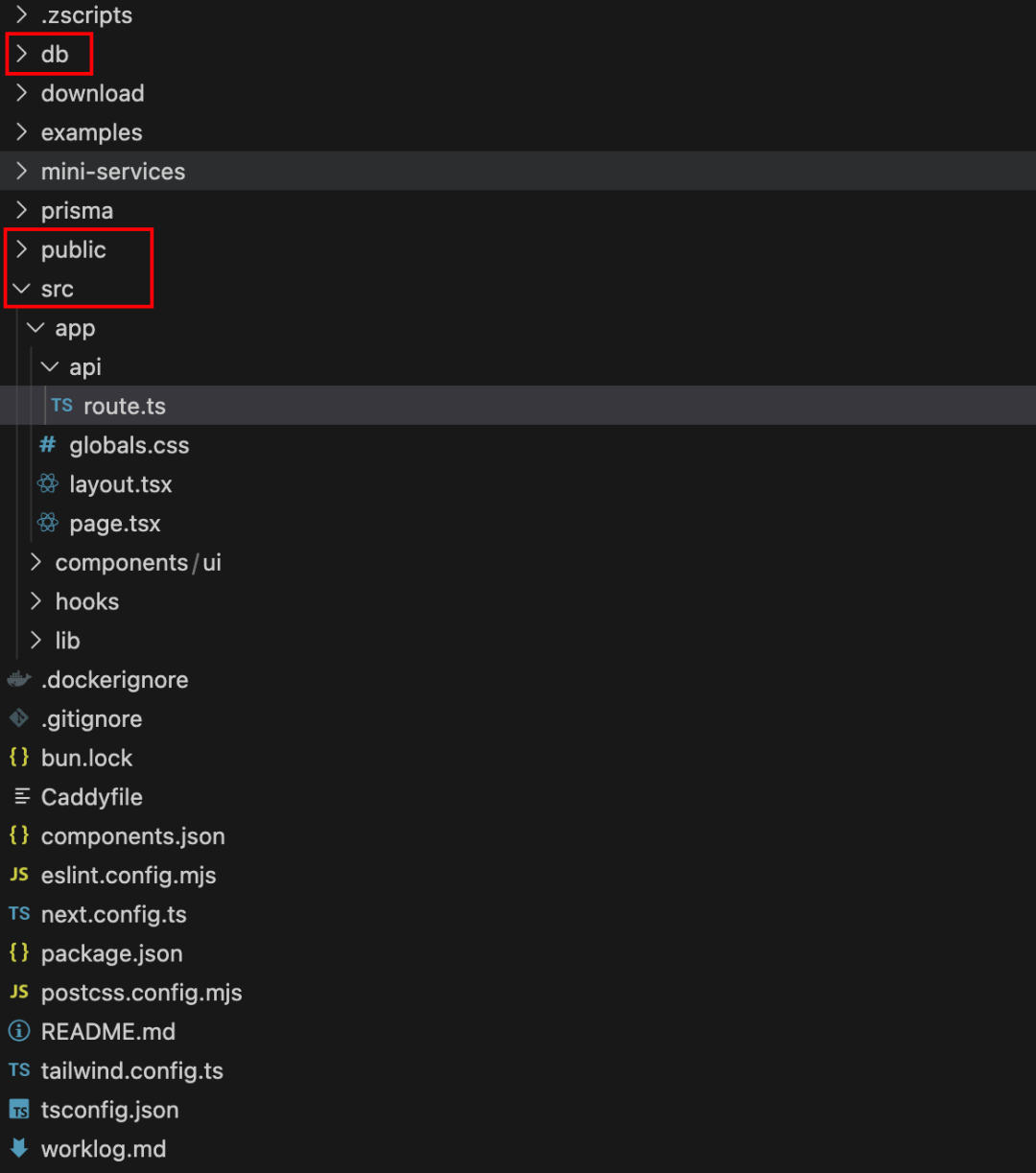

단 7분 만에 API 중계소를 한 번에 생성했습니다!

아직 MVP 데모이지만, 페이지 기능은 이미 완벽하고, 백엔드 로직과 데이터베이스도 포함되어 있으며, 데이터는 동적입니다. 작지만 모든 것을 갖추고 있습니다.

심층적으로 사용해 본 결과, GLM-5가 계획을 세울 때, 그 느낌이 Claude Opus와 너무 흡사했습니다.

심층적으로 사용해 본 결과, GLM-5가 계획을 세울 때, 그 느낌이 Claude Opus와 너무 흡사했습니다.

Claude Opus에 익숙한 분들은 아시겠지만, 작업을 시작하기 전에 매우 상세하고 논리적인 계획을 세워줍니다.

GLM-5도 이제 이 능력을 갖게 되었습니다.

예를 들어, 저는 항상 하고 싶었지만 귀찮아서 미루고 있던 일이 있습니다.

저는 Gemini, ChatGPT, Kimi, 즈푸 등 여러 AI 회원 계정을 가지고 있습니다.

평소 글을 쓰거나 자료를 찾을 때, 어떤 문제에 대해 여러 AI의 의견을 듣고 종합적으로 비교해 보고 싶을 때가 많습니다.그렇다면 여러 브라우저 창을 열고, 다른 창을 복사하여 전환하고, 여러 번 붙여넣어 보내고, 번갈아 창을 전환하며 결과를 확인해야 합니다.

그렇게 큰 일은 아니지만, 횟수가 많아지면 정말 짜증납니다.

그래서 저는 **하나의 브라우저 창에서 이 네 개의 AI 웹 페이지에 동시에 동일한 질문을 보내고, 플러그인 내에서 통합적으로 답변을 받을 수 있는 브라우저 플러그인을 만들 수 없을까?**라는 생각을 했습니다.

하지만 이 작업은 꽤 번거롭습니다. 각 AI 웹사이트의 구조가 다르고, 다양한 보호 메커니즘이 있으며, DOM 구조를 분석해야 하기 때문입니다.

그래서 저는 이 복잡한 작업을 GLM-5에게 맡겼습니다.

Claude Code의 Plan Mode를 켜서 먼저 계획을 세우게 했습니다.

그러면 GLM-5는 저와 상호 작용하며 제 의견을 묻습니다.

최종적으로 얻은 계획은 매우 상세하며, 정말 너무 길어서 633줄이나 됩니다..

그런 다음 계획에 따라 열심히 실행하기 시작했는데, 첫 번째 단계인 프로젝트 초기화에만 50분 이상 걸릴 줄은 몰랐습니다..

이 과정에서 GLM-5는 Playwright MCP 도구를 자동으로 호출하여 브라우저를 열고 해당 AI 웹사이트에 접속합니다.

GLM-5는 마치 실제 프로그래머처럼 요소를 검사하고, 입력 상자가 어디에 있는지, 전송 버튼의 Class가 무엇인지, 반환되는 텍스트 스트림을 어떻게 가져오는지 분석합니다... 이 모든 과정이 완전 자동으로 진행되며, 저는 단 한 줄의 코드도 작성하지 않았습니다.

PS: 다른 창에서 다른 작업을 동시에 실행하고 있어서 녹화를 잊었습니다.

기다릴 가치가 있었습니다. 제가 원했던 한 번의 질문으로 모든 AI가 동시에 답변하는 플러그인이 이렇게 뜨겁게 탄생했습니다.

기다릴 가치가 있었습니다. 제가 원했던 한 번의 질문으로 모든 AI가 동시에 답변하는 플러그인이 이렇게 뜨겁게 탄생했습니다.

이것은 완전히 제가 필요로 했던 것입니다~

또한, 제가 이전에 디지털 휴먼 마케팅 비디오 원클릭 생성 플랫폼을 만들었었죠.

나중에 더 나은 경험을 추구하기 위해 프런트엔드를 재구성했는데, 이 재구성이 문제가 되어 전체 프로젝트가 엉망진창이 되었습니다. 프런트엔드와 백엔드 인터페이스가 맞지 않고, 백엔드의 일부 오래된 로직이 새로운 프런트엔드에서 실행되지 않으며, 버그가 매우 많아 처리하기가 매우 어려웠습니다.

이번에는 Claude Code에서 plan mode를 켜고, 주요 흐름에서 버그를 찾고 수정하는 작업을 GLM-5에게 맡겼습니다.

먼저 상세한 계획이 나옵니다.

계획에 문제가 없는지 확인한 후, GLM-5에게 열심히 실행하도록 했습니다(과정에서 브라우저 mcp를 사용하여 제어했습니다).

GLM-5의 실행 속도는 빠르지 않습니다.

하지만 모델이 느린 것이 아니라, 토큰 소모 속도를 보면 눈에 띄게 1초 만에 수천 개로 치솟는 것을 볼 수 있습니다.

하지만 작업이 너무 복잡하기 때문에 GLM-5는 끊임없이 자기 반성하고, 도구를 호출하고, 테스트를 실행해야 합니다.

일부 시간은 종속성 다운로드 또는 명령 실행에 소모됩니다.

이 수정 작업도 40분 이상 걸렸습니다.

어떤 분들은 40분? 그 시간에 제가 다 작성하겠다고 말할 수도 있습니다.

emmm, 하지만 이 40분 동안 저는 녹화 화면을 켜놓고, 비디오를 보거나, 심지어 강아지를 산책시키러 갔습니다.

반면에 GLM-5는 가장 머리 아픈 버그 찾기 및 재구성 작업을 집중해서 도와주고 있습니다.

GLM-5의 실행 속도가 느리다고 생각할 수도 있지만, 최종적으로 얻는 효과는 매우 큽니다.

실행해 보니 문제가 거의 해결되었습니다.

VCR을 참조하십시오.

여기에는 제가 나중에 테스트하면서 발견한 작은 버그를 GLM-5에게 수정하고 최적화하도록 한 효과도 있습니다.

하지만 버그 수정 및 기능 최적화 부분은 정말 GLM-5에게 맡겨도 안심입니다.

이전에는 다른 AI를 사용하여 버그를 수정할 때 버그가 점점 더 많아지고, 프로젝트가 점점 더 엉망이 될까 봐 걱정했습니다. 전형적으로 동쪽 벽돌을 빼서 서쪽 벽을 막는 식이었죠..

이 문제를 피하기 위해 다양한 엔지니어링 수단을 사용하여 AI를 제약해야 했습니다.

예를 들어 매번 수정 범위를 강조하거나, 이러한 내용을 규칙에 작성하거나, 매번 하나의 버그만 수정하고, 수정 후에는 다른 기능도 테스트해야 했습니다... 어쨌든 매우 번거로웠습니다.

하지만 GLM-5를 사용하여 버그를 수정하는 경험은 완전히 달라졌습니다.

저는 항상 현재 상황을 설명하고, 오류 로그를 GLM-5에게 던져주고, 제가 원하는 효과가 무엇인지 알려주기만 하면 됩니다.

GLM-5는 거의 한 번에 수정에 성공하며, 다른 기능에 전혀 영향을 미치지 않습니다.

심지어 한 번의 대화에서 전체 흐름에서 발견된 서로 다른 네 개의 버그를 한꺼번에 GLM-5에게 던져줘도, GLM-5는 조리 있게 하나씩 수정할 수 있습니다.

이러한 안정적인 느낌은 정말 너무 좋습니다.

이제 저는 GLM-5에게 복잡한 개발 작업을 안심하고 맡길 수 있으며, 기본적으로 오류가 발생하지 않습니다.

가끔 문제가 발생하더라도 Claude Code에서 롤백 명령을 실행하여 되돌아가 다시 시작하면 됩니다.

전체 프로젝트를 GLM-5로 최적화한 후 모든 흐름이 기본적으로 완료되었습니다.저도 곧 이 프로젝트를 오픈 소스로 공개할 예정입니다 (다양한 모델 API 부분을 추출하여 구성으로 만들어야 합니다).

「마지막으로」

GLM-5를 체험한 후 가장 큰 감정은 국산 AI가 정말 일어섰다는 것입니다.

며칠 전, 바이트댄스의 Seedance 2.0 출시로 중국 국산 모델이 비디오 생성 분야에서 세계 최고 수준에 도달하여 Sora2와 Veo3.1을 직접 능가했음을 입증했습니다.

그리고 이번 즈푸 GLM-5의 출시는 또 다른 핵심 경쟁 분야인 AI 코딩에서 예상보다 훨씬 뛰어난 결과를 보여주었습니다.

우리는 이전에는 국산 모델이 논리 추론, 코드 작성에서 GPT, Claude Opus, Gemini와 격차가 있다고 말했습니다.

하지만 오늘 GLM-5는 확실한 성능으로 우리에게 그 격차가 좁혀지고 있음을 알려줍니다.

GLM-5는 데모용 장난감에 불과한 것이 아니라 실제로 작업을 돕고, 시스템을 구축하고, 장기적인 작업, 복잡한 문제를 해결하는 데 도움이 되는 생산성 도구입니다.

가장 중요한 것은 오픈 소스라는 점입니다.

이는 모든 개발자, 모든 기업이 더 낮은 비용으로 최고의 AI 아키텍처를 소유할 수 있음을 의미합니다.

또한 현재 GLM의 코딩 플랜이 엄청나게 많이 팔리고 있으며, 공식적으로 긴급 증설 중이며, 이번에는 국산 칩의 만 개 카드 클러스터에 연결된다고 발표했습니다.

하지만 컴퓨팅 파워에 대한 투자가 증가함에 따라 가격이 다소 인상되었지만 다행히 저는 이전에 Max 패키지를 구매했습니다.

여기서 칩에서 모델, 하위 컴퓨팅 파워에서 상위 애플리케이션에 이르기까지 우리만의 세계 최고 수준의 AI 기술 스택을 구축하고 있음을 알 수 있습니다.

2026년은 AI 애플리케이션이 폭발적으로 증가하는 해이자 더욱 광적인 해가 될 것입니다.

최고의 AI 아키텍처를 소유한 듯한 느낌을 경험하고 싶다면 지금 바로 GLM-5를 사용해 보세요.전제는 Max 요금제를 쟁취해야 한다는 거예요, 하하.