智谱GLM-5 tym razem open source, co sprawia, że nawet zaawansowani programiści są zagrożeni...

Naprawdę, AI w 2026 roku jest o wiele bardziej szalona niż w 2025.

Ostatnio ja, osoba, która spędza 16 godzin dziennie w AI, mam trudności z nadążaniem za tempem ewolucji AI. Czuję, że każdego dnia, gdy otwieram oczy, świat się zmienia.

No i wczoraj późno w nocy, Zhipu wypuściło kolejną bombę, bezpośrednio udostępniając jako open source swój obecnie najpotężniejszy flagowy model: GLM-5.

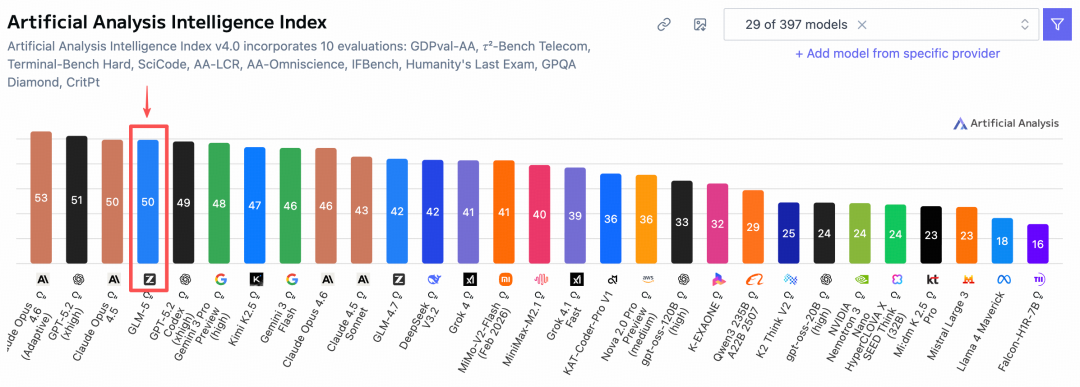

W globalnym autorytatywnym rankingu Artificial Analysis, GLM-5 wyprzedził Gemini i zajął czwarte miejsce na świecie, pierwsze jako open source!

Rzeczywiście, tak jak przewidywałem, pamiętam, jak ostatnio, gdy wydano GLM-4.7, w artykule przewidziałem braciom: zgaduję, że GLM-4.8 lub GLM-5 zostanie wydany przed Świętem Wiosny, nie spodziewałem się, że to prawda, haha 😄

A numer wersji tym razem w końcu nie jest tak jak wcześniej 4.5, 4.6, 4.7, aktualizacja jak wyciskanie pasty do zębów, tym razem bezpośrednio do 5.0.

To pokazuje, że to nie są małe poprawki, ale duży skok w podstawowych możliwościach.

Najpierw przedstawię wszystkim, co nowego w GLM-5:

Mówiąc najprościej, w poprzednich modelach wszyscy powszechnie zwijali Vibe Coding, czyli tak zwane generowanie jednym zdaniem, sprawdzając, kto generuje bardziej efektowne efekty specjalne na stronie internetowej, sprawdzając, kto może jednym zdaniem stworzyć fajną grę.

Ale GLM-5 tym razem nie będzie z tobą tego zwijać (w końcu!), podnosi możliwości dużego modelu z pisania kodu do możliwości budowania systemu.

Co to znaczy? Jego celem nie jest już pisanie pięknych stron front-end, ale ewoluował w architekta systemu, który może wykonywać brudną robotę, ciężką pracę i wykonywać długie zadania.

Podkreśla się Agentic Engineering, czyli możliwości inżynierii agentów.

Spojrzałem na oficjalne dane, skala parametrów wzrosła z 355B do 744B (aktywacja 40), dane przedtreningowe wzrosły z 23T do 28.5T.

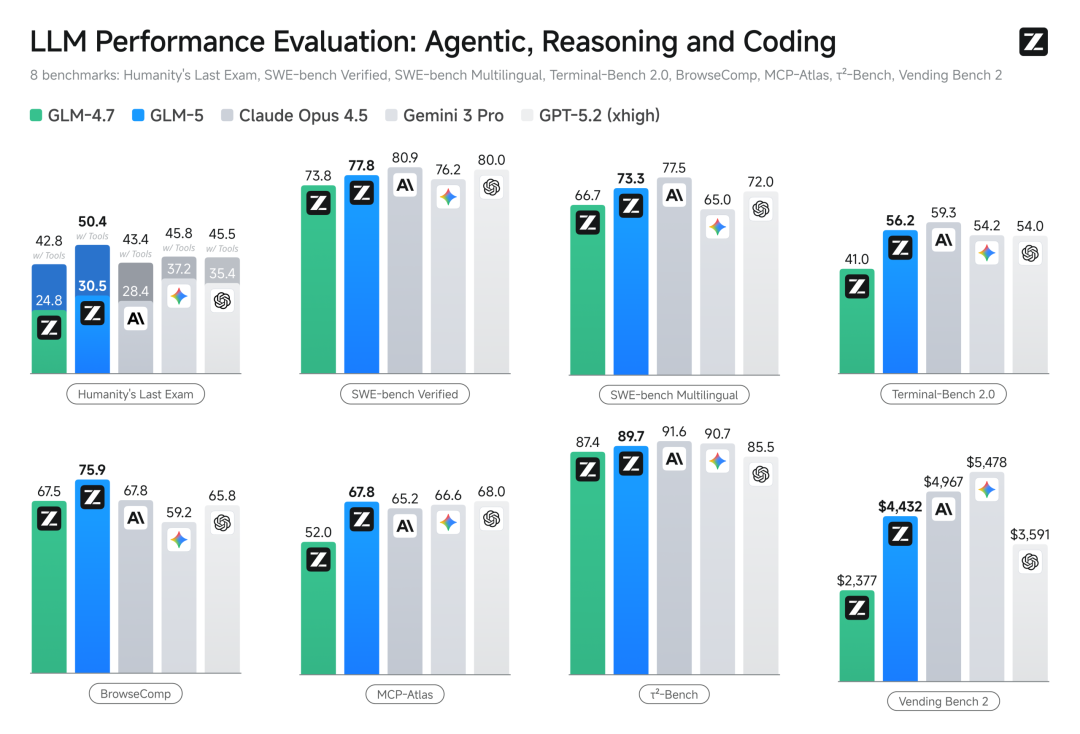

W SWE-bench-Verified, powszechnie uznanym teście porównawczym programowania, uzyskał wynik 77.8, bezpośrednio pozostawiając Gemini 3 Pro w tyle, i można powiedzieć, że jest porównywalny z obecnie uznanym najsilniejszym zamkniętym modelem Claude Opus 4.5.

Obecnie można go używać bezpłatnie na z.ai:

Adres open source:

GitHub: https://github.com/zai-org/GLM-5

Hugging Face: https://huggingface.co/zai-org/GLM-5

ModelScope: https://modelscope.cn/models/ZhipuAI/GLM-5

W rzeczywistości kilka dni temu, na X nagle pojawił się tajemniczy model o nazwie Pony.

Wtedy wielu przyjaciół zgadywało, kim do cholery jest ten Pony? Wiele różnych opinii

W rzeczywistości model o nazwie kodowej Pony to GLM-5, co do tego, dlaczego nazywa się Pony, prawdopodobnie dlatego, że zbliża się Rok Konia 🤔.

Wtedy też po raz pierwszy podłączyłem Pony z OpenRouter do Claude Code, aby go wypróbować, szczerze mówiąc, jest naprawdę silny (popularność na X jest również bardzo wysoka).

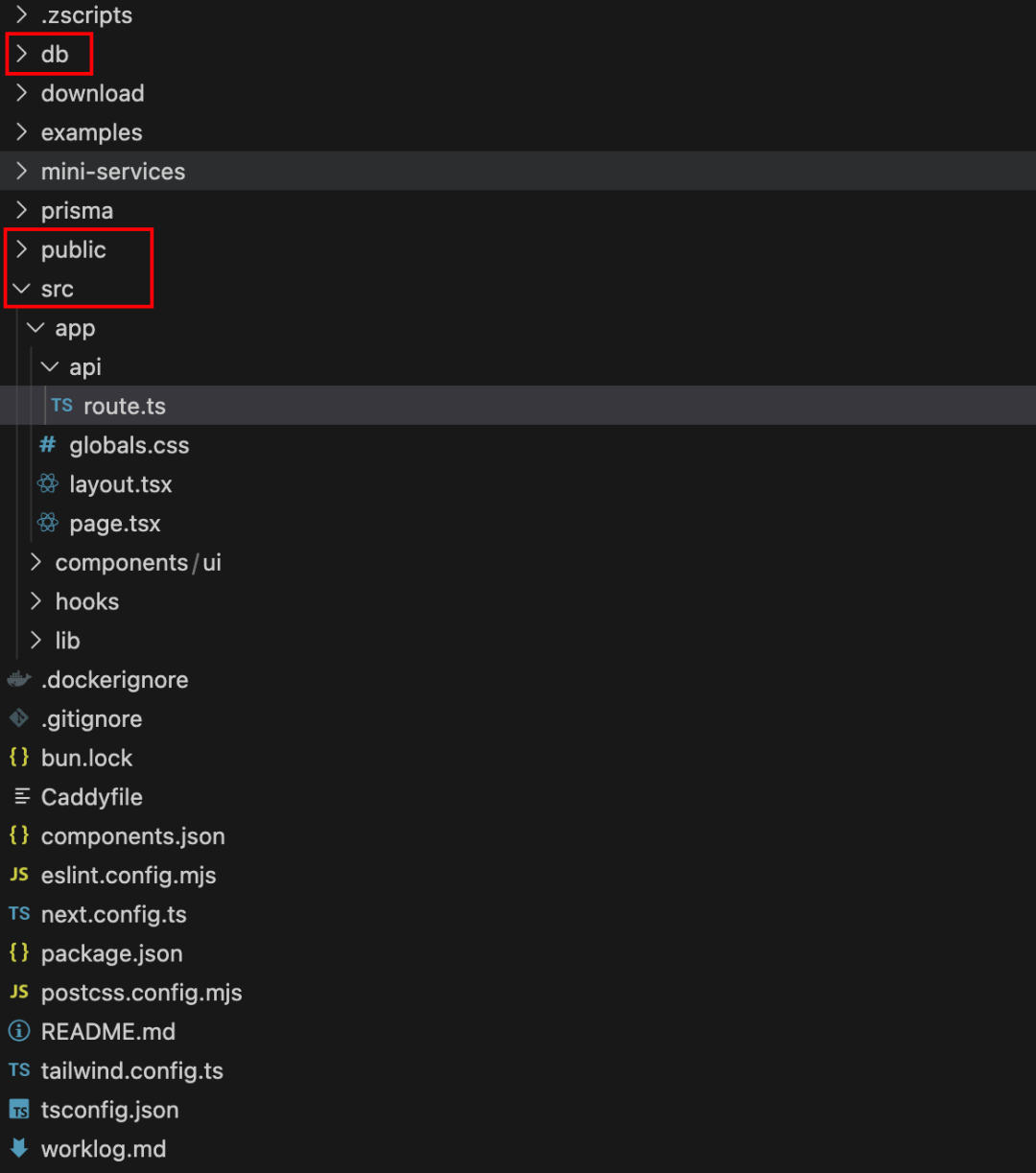

Zajęło tylko 7 minut, aby jednorazowo wygenerować stację tranzytową API!

Chociaż nadal jest to MVP Demo, funkcje strony są już bardzo kompletne i zawierają logikę backendu oraz bazę danych, dane są dynamiczne, mały, ale kompletny.

Po dogłębnym doświadczeniu odkryłem, że GLM-5 podczas tworzenia planu ma smak bardzo podobny do Claude Opus.

Po dogłębnym doświadczeniu odkryłem, że GLM-5 podczas tworzenia planu ma smak bardzo podobny do Claude Opus.

Przyjaciele, którzy znają Claude Opus, wiedzą, że przed rozpoczęciem pracy można go użyć do sporządzenia bardzo szczegółowego i logicznego planu.

GLM-5 ma teraz również tę możliwość.

Na przykład, mam jedną rzecz, którą zawsze chciałem zrobić, ale byłem zbyt leniwy, aby zacząć.

Mam pod ręką Gemini, ChatGPT, Kimi, Zhipu i wiele innych kont członkowskich.

Zwykle, gdy piszę artykuły lub szukam informacji, często chcę posłuchać opinii wielu AI na temat niektórych pytań i porównać je kompleksowo.那我就得打开多个浏览器窗口,复制切换不同窗口粘贴发送多次,然后轮流切换窗口查看结果。

虽然也不是多大的事儿,但次数多了真的很烦。

我就在想,能不能做一个浏览器插件,能统一在一个窗口里面,同时向这四个AI的网页端发送同一个问题,然后在插件里面统一收到回复?

但是这玩意儿还挺麻烦的,因为每个AI网站的结构都不一样,还有各种保护机制,需要去分析它们的DOM结构。

于是,我就把这个复杂的任务交给了GLM-5。

开启Claude Code的Plan Mode先让它做个计划

然后它还会跟我互动,询问我的意见:

最终得到的计划非常详细,真的太长了,有633行。。

然后就按照计划开始吭哧吭哧执行了,没想到第一步初始化项目就跑了50多分钟..

在这个过程中,它自动调用了Playwright MCP工具,自己打开浏览器,去访问那几个AI的网站。

它就像一个真的程序员一样,去键检查元素,去分析输入框在哪里,发送按钮的Class是什么,怎么获取返回的文本流...整个过程全自动,我一行代码都没写。

PS:忘记录屏了,因为我同时还在其他窗口跑另一个任务

等待是值得的,我想要的一次提问、全网AI同时回答的插件,就这么热气腾腾地出炉了。

等待是值得的,我想要的一次提问、全网AI同时回答的插件,就这么热气腾腾地出炉了。

这完全就是我需要的东西~

另外,我之前不是做了一个数字人营销视频一键生成平台嘛。

后来为了追求更好的体验,我重构了一下前端,这一重构不要紧,整个项目可以说是乱成了一锅粥:前后端接口对不上,后端的一些老旧逻辑在新前端面前跑不通,Bug非常多,搞起来很麻烦。

这次,我在Claude Code开启plan mode,然后直接把主流程找bug,改bug的任务甩给了GLM-5

先出来一份详细的计划:

确认计划无误后,我就让它吭呲吭呲开始执行了(过程中用到了浏览器mcp来控制)。

它的执行速度并不快。

但并不是模型慢,很多时候,我看那个Token的消耗速度,肉眼可见地一秒钟就窜到上千了。

但是因为任务太复杂,它需要不断地自我反思、调用工具、运行测试。

也有一些时间是消耗在依赖下载,或者命令执行上。

这个修复任务,也整整执行了40多分钟。

可能有的朋友会说,40分钟?我都写完了。

emmm,但这40分钟里,我就开着录屏,刷视频,甚至去遛了狗。

而它是在全神贯注帮我干活,而且是干那种最让人头秃的找Bug和重构的活。

别看它执行得慢,但是最终得到的效果是非常显著的。

我一运行,好家伙,问题基本都搞定了。

请看VCR:

这里面也有一些效果是我后续自己测的时候发现小Bug,然后让它修复并优化的。

但是在修Bug和优化功能这块,我是真的放心交给它。

以前用别的AI改Bug,经常是担心bug越改越多,项目越改越乱,典型的拆了东墙补西墙..

之前为了规避这个问题,得用各种工程化的手段去约束AI。

比如每次修改 强调范围,或者把这些写到规则里面,或者每次只改一个bug,每次改完,还得测一下别的功能...反正很麻烦。

但是用GLM-5修改Bug,体验完全变了。

我从来就是只需要描述现状,把报错日志丢给它,告诉它我期望的效果是什么。

它几乎都能一次修复成功,而且完全不会影响别的功能。

甚至,我在一次对话中,直接把整个流程中发现的四个不同的Bug,一股脑全扔给它,它也能条理清晰的一个个修好。

这种稳健的感觉,真的太舒服了。

我现在可以放心交给GLM-5帮我完成任何复杂的开发任务,基本不会出错。

即便偶尔有问题,大不了在Claude Code里面执行一下回滚命令,倒回去重来就好了。

整个项目用GLM-5优化了一圈之后,所有流程基本都搞定了。Zamierzam również wkrótce udostępnić ten projekt jako open source (muszę jeszcze wyodrębnić różne API modeli i przekształcić je w konfigurację).

„Na koniec”

Po przetestowaniu GLM-5 moje największe wrażenie jest takie: Chińska sztuczna inteligencja naprawdę stanęła na nogi.

Kilka dni temu ByteDance wydało Seedance 2.0, udowadniając, że chińskie modele osiągnęły już światowy poziom w dziedzinie generowania wideo, bezpośrednio przewyższając Sora2 i Veo3.1.

A tym razem wydanie智谱GLM-5 to odpowiedź, która przekroczyła oczekiwania w innej wymagającej dziedzinie, jaką jest AI Coding.

Zawsze mówiliśmy, że chińskie modele mają luki w logicznym rozumowaniu i pisaniu kodu w porównaniu z GPT, Claude Opus i Gemini.

Ale dzisiaj GLM-5 pokazuje nam konkretnymi wynikami, że ta luka się zmniejsza.

GLM-5 nie jest zabawką, której można używać tylko do tworzenia demonstracji, to narzędzie produktywności, które naprawdę może pomóc w pracy, budowaniu systemów, rozwiązywaniu długich zadań i złożonych problemów.

Najważniejsze jest to, że jest to open source.

Oznacza to, że każdy programista, każda firma może mieć architekta AI najwyższej klasy po niższych kosztach.

Obecnie plan kodowania GLM sprzedaje się jak świeże bułeczki, a urzędnicy wydali ogłoszenie, że pilnie rozbudowują zasoby, a co najważniejsze, tym razem podłączony jest klaster dziesiątek tysięcy kart z chińskimi chipami.

Jednak ze względu na zwiększone inwestycje w moc obliczeniową cena nieco wzrosła, na szczęście wcześniej zdobyłem pakiet Max.

Widać tutaj również, że od chipów po modele, od podstawowej mocy obliczeniowej po aplikacje wyższego poziomu, budujemy własny, światowej klasy stos technologii AI.

Rok 2026 z pewnością będzie rokiem eksplozji aplikacji AI, a także rokiem jeszcze bardziej szalonym.

Jeśli Ty również chcesz doświadczyć uczucia posiadania architekta AI najwyższej klasy, pospiesz się i wypróbuj GLM-5.Warunkiem jest zdobycie pakietu Max, haha.